Clear Sky Science · zh

通过基于奖励更新的GRPO,利用大型语言模型增强另一个大型语言模型的推理能力

教机器把事情想明白

当下许多语言模型能进行聊天、翻译和回答问题,但在像优秀的数学学生或细致的分析员那样展示解题过程方面仍存在不足。本文探讨了如何用一个人工智能系统来提升另一个系统的推理能力,以及如何在不手工构建庞大专业数据集的情况下做到这一点。对于关注人工智能在金融、医疗或科学研究等领域变得更可靠的读者,这项工作提供了一个实用的方法,让模型更清晰、更一致地解释其答案。

从原始文档到可教学示例

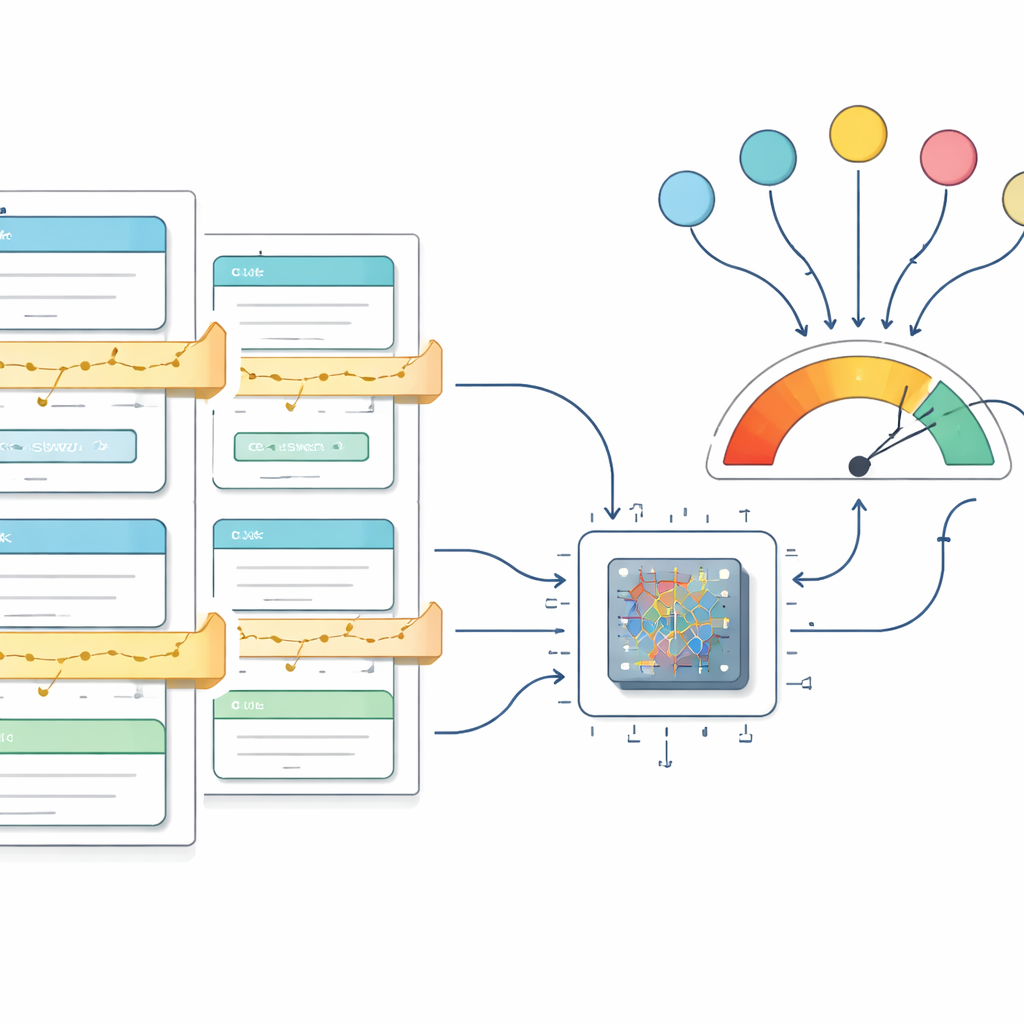

作者从一个简单观察出发:大多数现实世界的信息以混乱的形式存在,如报告、致股东信或网页,而不是整齐的问答格式。为弥合这一差距,他们引入了两个软件工具:Huggify-Data 和 CoT 数据生成器。这些工具将非结构化文本自动切分为问答对,然后请强大的语言模型补全其中缺失的推理步骤。最终每个示例被组织为一个结构化三元组:问题、推理链和答案。关键在于,这一流水线几乎可以指向任何领域,从学校数学到企业财务,使得在无需大量人工标注的情况下构建以推理为中心的训练数据成为可能。

一个模型如何训练另一个模型

一旦这些问题–推理–答案三元组被生成,就用来训练一个较小的“学生”模型,使其以相同的结构化方式思考。学生模型被要求不仅给出最终答案,还要先给出明确分离的解释,随后给出结论。训练由一种称为组相对策略优化(Group Relative Policy Optimization,GRPO)的方法引导,该方法将同一问题的多个候选回答进行比较,并推动模型朝更优的回答调整。论文在此方法上加入了一个额外的奖励项,用以检查模型输出是否遵循期望格式,甚至衡量其与格式良好的参考示例的匹配程度。该奖励会温和地惩罚混乱或不完整的解释,促使模型生成整洁、可解释的答案。

将该方法付诸检验

为了验证该框架在实践中的效果,作者将其应用于两个截然不同的数据集。第一个是 GSM8K,包含需要多步算术推理的小学文字题。第二个数据集由沃伦·巴菲特的年度致股东信构成,目标是捕捉关于投资和公司决策的长篇推理。在两种情况下,该流水线都将原始文本转化为结构化训练数据,并对一个名为 Qwen 2.5 的中等规模模型进行微调。训练过程中,一个简单的评分规则奖励正确且格式良好的回答;随着学习推进,平均奖励稳步上升并在理论最大值处稳定,表明模型在训练数据上已在很大程度上掌握了目标行为。

改进后模型的表现如何

性能以“平均标记准确率”(mean token accuracy)来度量,粗略地说,就是模型输出中有多少小文本片段(标记)与预期匹配。虽然这不同于传统的判对错评分,但很适合评估解释和答案是否以正确的结构生成。在 GSM8K 上,最佳模型达到 98.2% 的标记准确率;在巴菲特信件上达到 98.5%。在相同度量下,这些得分高于诸如 GPT‑4 和 Claude 3.5 Sonnet 等知名系统,而所用的仅是一个参数量为 30 亿的模型,可在租用硬件上不到两天内完成训练。作者还披露了计算成本与硬件配置细节,并开源了所有代码、模型和数据集,便于他人检验与扩展。

这对日常 AI 使用意味着什么

对于非专业读者,主要结论是:可以教会 AI 系统不仅回答问题,而且以有纪律、易于跟随的方式回答,所需数据可从普通文档中自动提取。将富含推理的教师模型、灵活的数据流水线以及既重视正确性又重视清晰度的奖励方案结合起来,作者展示了如何将更小的模型塑造成更可靠的问题解决者。尽管他们指出了局限性——例如需要更强的测试来检验真实理解和安全性——该框架指向了一个未来:组织可以把自身的文本档案转化为定制且透明的 AI 助手,应用于教育、金融等多个领域。

引用: Yin, Y. Use large language model to enhance reasoning of another large language model through reward updated GRPO. Sci Rep 16, 8360 (2026). https://doi.org/10.1038/s41598-026-39296-8

关键词: 大型语言模型, 链式思维推理, 奖励优化, 数据整理, 特定领域人工智能