Clear Sky Science · zh

多模态大型语言模型挑战《新英格兰医学杂志》影像挑战

这对患者与医生为何重要

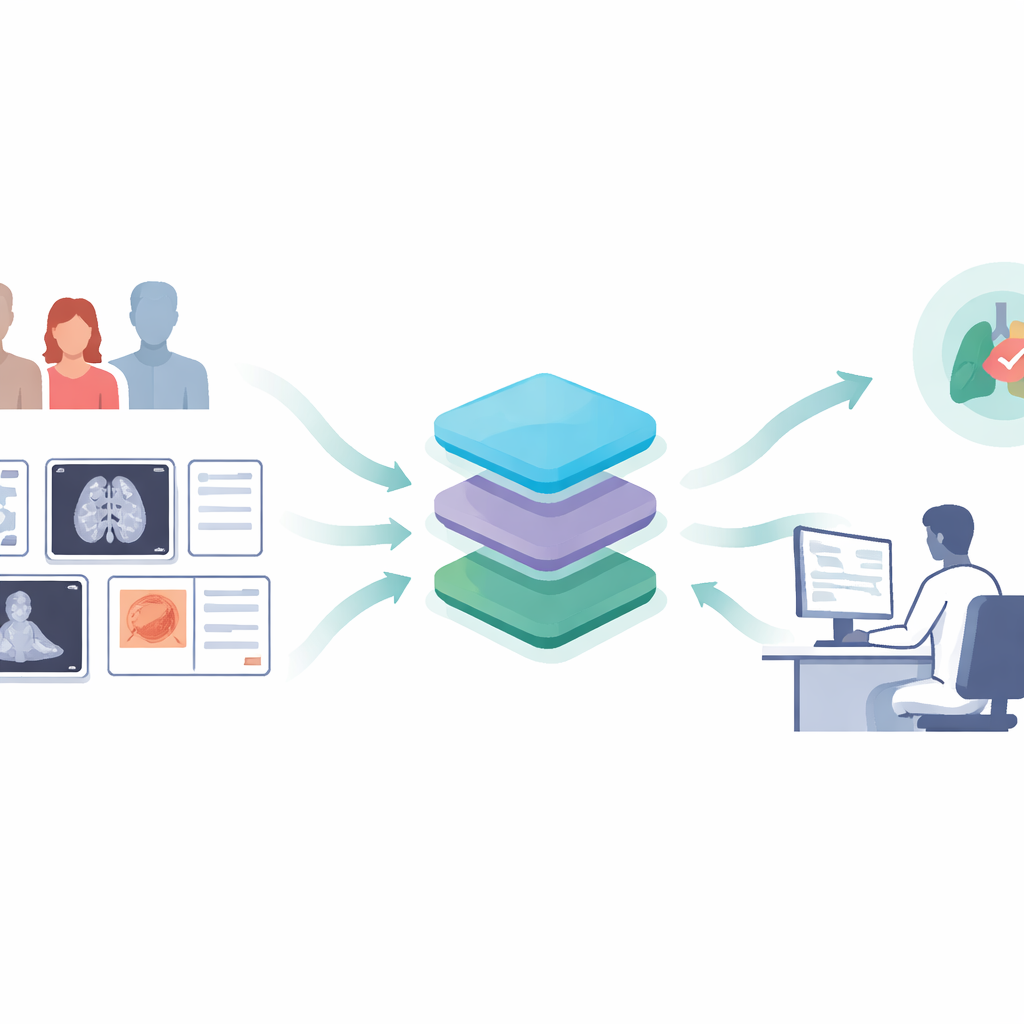

在正确的时间得到正确的诊断,可能意味着迅速治疗与多年痛苦之间的差别。然而,即便是受过高度培训的医生也会错过或延迟诊断,尤其是在罕见或不寻常疾病的情形下。本研究提出了一个引人注目的问题:当将医学影像与临床细节输入到当今最先进的人工智能系统时,它们能否在复杂病例的诊断上超过大量真实医生——如果可以,这对未来医疗意味着什么?

由真实病例构成的巨大难题

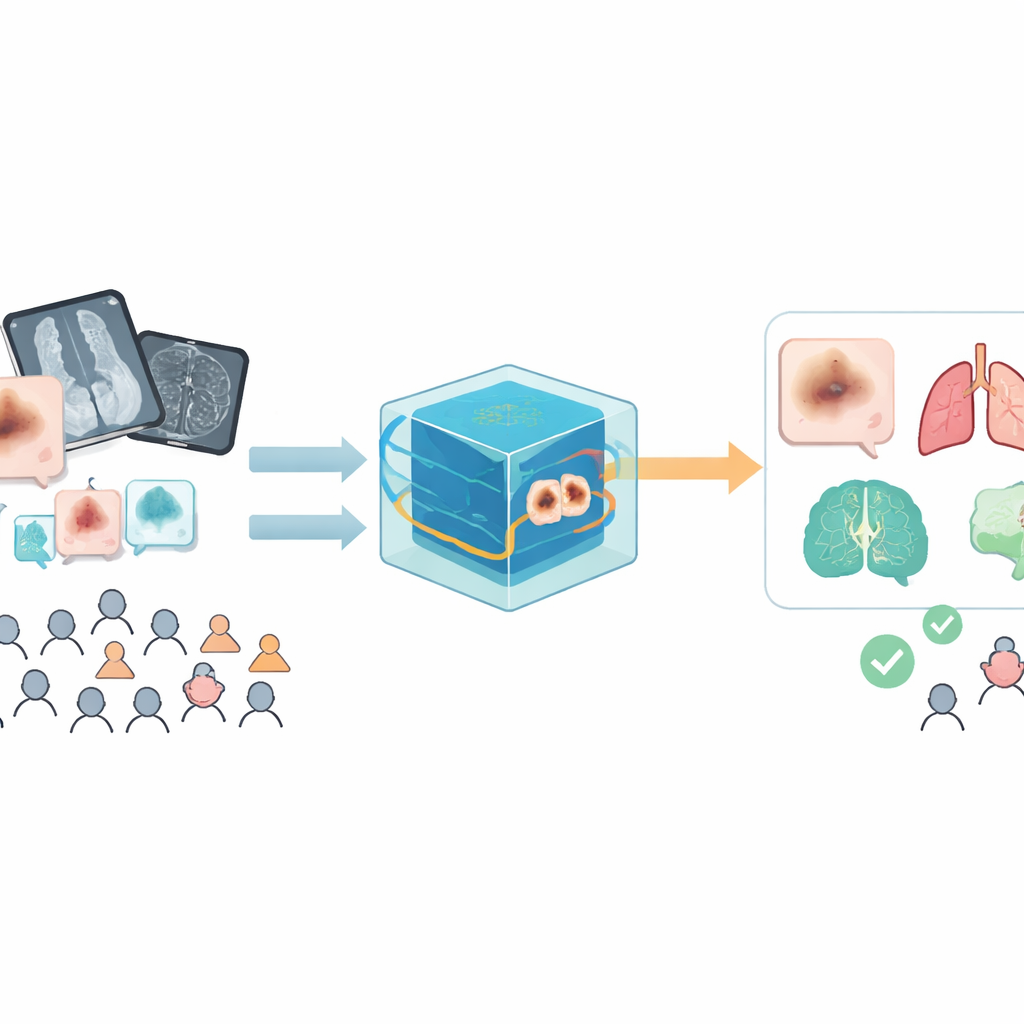

研究人员利用了《新英格兰医学杂志》长期运行的一个专栏“影像挑战”。每个挑战都呈现一例真实病人的影像——例如皮肤照片、X 光片、磁共振或显微镜切片——连同简短的临床病史和五个备选诊断。自2009年以来,每例病例已积累超过60000名医生、逾1600万次的回答,形成了医生在同样难题上表现的独特全球记录。从该档案中,团队挑选了272例,涵盖所有年龄段、两性以及广泛的病种,从感染与免疫疾病到肿瘤、遗传病和外伤等。

让 AI 与医生在同一赛场较量

研究测试了三种领先的多模态大型语言模型——能同时查看图像与读取文本的系统:GPT‑4o、Claude 3.7 和斗宝。每个病例中,模型先仅看到影像并需在五个选项中选择一个并给出解释;随后它们看到影像加临床描述并再次作答。为保持公平,模型在标准设置下运行,关闭了网页搜索与额外推理功能,并且每个病例都在全新会话中测试,以避免早前答案的影响。两位医生将 AI 的回答与《新英格兰医学杂志》的官方解答进行评分,重点是最终选择是否与真实诊断一致,评判标准与人类基准相同。

在疾病与影像类型上均展现超人表现

当同时获得影像与文本时,三种 AI 系统明显超越了全球医生群体。Claude 3.7 与 GPT‑4o 的准确率各约为89–90%,而人类回答的多数票准确率为46.7%——差距超过40个百分点。即使在最困难的病例中(少于40%医生答对),Claude 3.7 仍然有86.5%的诊断正确率。这一优势在大多数疾病类型和影像格式中都成立:模型在药物相关与遗传性疾病上尤其强,并且不仅能处理照片与 X 光片,还能应对内镜、病理切片与混合影像集。模型对男女的表现同样强劲,在一些最脆弱的群体中——例如一岁以下婴儿——模型的准确率比医生高出很多。

不同的“思路”,而非只是更快

或许最令人惊讶的发现是模型在医生答错时常常能答对。近一半病例中,Claude 3.7 在多数医生答错的情况下能给出正确答案,而相反情况(医生正确、模型错误)则很少见。总体上,Claude 3.7 大约每出现十五例“模型优势”案例,才有一例“医生优势”案例。然而,人类与 AI 在选择答案上的一致性较低,这表明系统并非简单地重复人类模式,而是通过不同路径得出正确诊断。临床文本的加入通常大有帮助,使 AI 的准确率较仅凭影像时提高28–42个百分点。但在极少数病例中,额外的细节却把模型从基于影像的正确答案导向错误,这提示存在新的偏差与失败模式,需要仔细研究。

这对未来医疗可能意味着什么

作者总结认为,多模态大型语言模型在这项苛刻的诊断测验上已达到“超人”水平:它们比平均医生群体更准确,且在大多数医生束手无策的情形下仍保持优势。与此同时,与人类选择的低重合度表明它们以互补的方式“思考”,而非成为临床医生的数字复制品。如果谨慎使用,这些系统可以作为强大的第二读者,为疑难或罕见病例提供独立意见,帮助发现人类医生可能遗漏的问题。它们尚不足以取代临床判断,但可能很快成为病床旁和阅片室内宝贵的伙伴,默默地核查我们的工作并扩大对患者的安全网。

引用: Sheng, C., Shen, S., Wang, L. et al. Multimodal large language models challenge NEJM image challenge. Sci Rep 16, 8132 (2026). https://doi.org/10.1038/s41598-026-39201-3

关键词: 医学诊断, 人工智能, 医学影像, 罕见疾病, 临床决策支持