Clear Sky Science · zh

累积局部效应与图神经网络的连接预测

为何理解隐藏连接至关重要

许多塑造我们生活的系统——社交媒体、科学合作、脑网络,甚至网络本身——都可以描述为由节点相连的网络。一个关键问题是哪些新连接在未来可能形成,例如谁会与谁合作或哪篇论文会引用哪篇。现代图神经网络是此类“连接预测”的强大工具,但它们也是黑箱:表现良好却难以看清为何作出某一决定。本文通过调整一种通用的解释技术来应对这一问题,从而我们可以观察改变单个节点的某个属性如何影响与其连接出现的概率。

从简单评分到不透明的图“大脑”

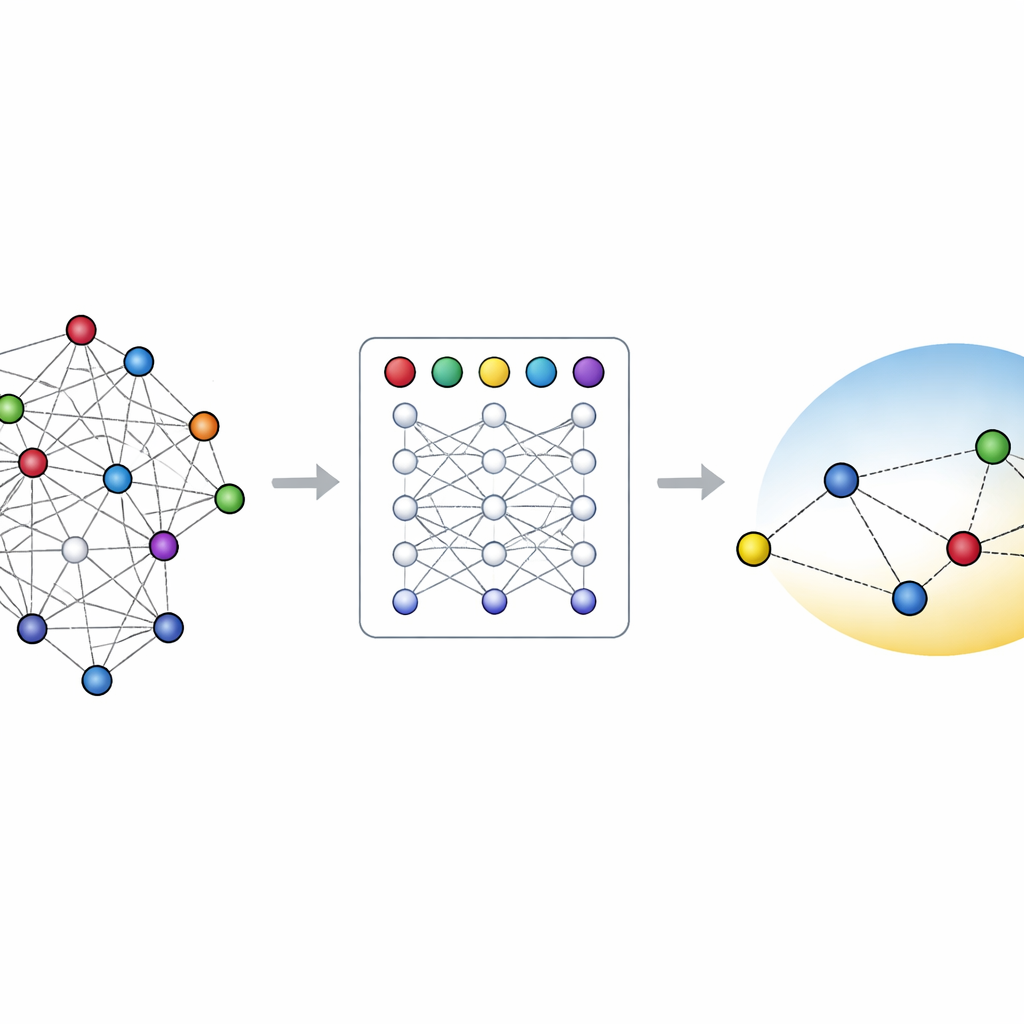

早期的网络科学依赖简单规则来猜测缺失或未来的连接。例如,两个人如果有许多共同朋友,更有可能成为朋友;高度连接的网页往往会吸引更多链接。过去十年,这些手工设计的评分被学习每个节点的紧凑数值描述(或嵌入)的方法所超越。图神经网络更进一步:它们反复沿着边传递信息,使每个节点的嵌入汇集来自邻居及其邻居的信息。这使得它们在连接预测上非常出色,但也意味着其内部运作缠结且难以解释。

观察单一特征如何推动预测

在图之外,解释黑箱模型的一种流行方法称为累积局部效应(ALE)。ALE不仅指出哪些特征重要,还询问当你在其可能取值范围内微调某一特征时,模型的预测如何变化,并将这些局部变化累积成一条平滑曲线。作者将ALE调整用于图神经网络的连接预测:一次改变一个节点的特征,检查该节点与许多其他节点之间预测连接概率的响应。这会生成可视化结果,显示例如增加论文中“大科技”作者的比例或改变脑血管段的垂直位置如何改变模型估计的连接概率。

两种效应计算方式:精确与快速

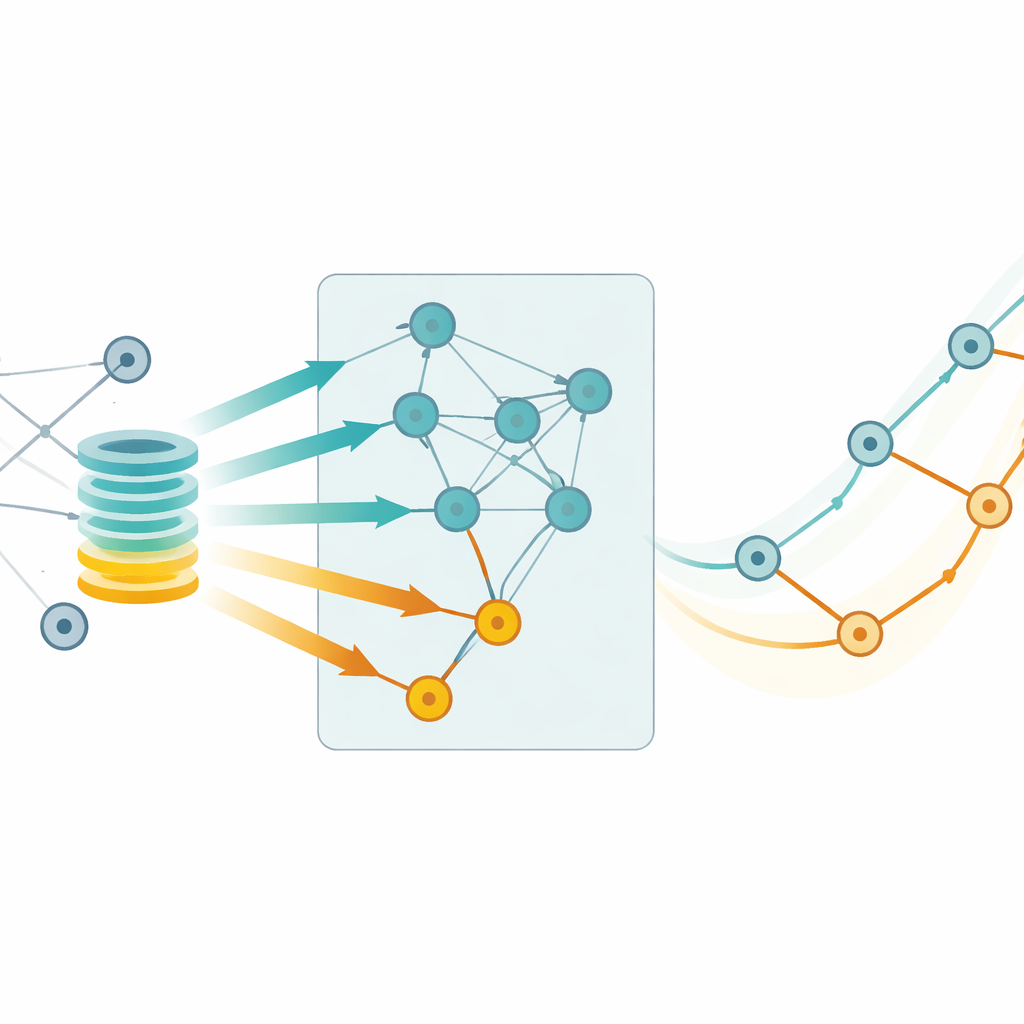

图神经网络为ALE增加了一个复杂性:当你同时改变许多节点时,它们通过信息传递可以相互影响,可能会扭曲解释。因此作者比较了两种策略。在“精确”版本中,每个节点的特征被孤立地修改,因此没有两个被修改的节点会互相污染对方的嵌入——但这在计算上代价高昂。在“近似”版本中,许多节点同时被改变,把数据更像普通表格并忽略这些交互;这要快得多,但可能引入偏差。作者通过系统地改变被修改节点的数量及其被测试的潜在伙伴数量,衡量这些选择如何影响ALE曲线。

在合成图和真实数据上的测试

为检验准确性,团队首先构建了一个合成网络,在该网络中控制连接形成的真实规则是已知的:当特殊的“信号”特征在两个端点都较高时,边更可能出现。在这里,他们可以将ALE曲线直接与真实情况进行比较。结果发现,随着一次修改更多节点,近似方法逐渐偏离真实关系,而精确方法保持忠实。在大型真实数据集上——人工智能论文的引文网络和小鼠脑血管的详细三维地图——他们无法再看到真实规则,因此将经多次运行汇总的精确方法作为黄金标准解释,并检查近似方法偏离的程度。统计检验和置换实验表明,在大多数模型-数据集组合中,两种方法的差异是温和的,尽管近似曲线在不同运行间更为可变。

这些效应揭示了什么

超越方法论,ALE曲线提供了关于模型到底学到了什么的洞见。在引文网络中,它们表明论文中来自大型科技公司的作者比例较高的论文更可能——根据模型——获得引用,呼应了关于工业在人工智能研究中影响力日增的担忧。在血管图中,两种不同的图神经网络架构对血管在脑中高度与其连通性之间的关系学到相反的趋势,强调ALE揭示的是模型的信念,而不必然是生物学真相。这类不一致可以标记出模型架构、训练数据或评估可能需要重新思考的地方。

对读者和从业者的要点

该研究表明,累积局部效应可以被改造用于解释图神经网络的连接预测,提供直观的曲线来显示改变节点特征如何将连接概率向上或向下推动。精确计算这些曲线更可靠但更慢,而更快的近似方法在可接受额外噪声、尤其是在多次运行取平均时,通常已足够。对于已经在标准机器学习模型上使用解释工具的人来说,这带来了一种熟悉且可视的方式来洞察复杂的基于图的系统,并质疑模型所学是否真正符合我们对所关心网络的理解。

引用: Kaczyńska, P., Sienkiewicz, J. & Ślęzak, D. Accumulated local effects and graph neural networks for link prediction. Sci Rep 16, 8574 (2026). https://doi.org/10.1038/s41598-026-39000-w

关键词: 图神经网络, 连接预测, 模型可解释性, 累积局部效应, 网络科学