Clear Sky Science · zh

通过结构化提示微调的大型语言模型实现高效构建肺癌知识图谱

为何将医学文本转化为“地图”很重要

肺癌是全球致死率最高的癌症之一,关于诊断与治疗的信息散见于科研论文、医院病历、在线问诊和传统医学病例集。医生和研究人员难以跟上这些海量文本的步伐。本研究探讨了一种新方法,利用微调过的大型语言模型和精心设计的结构化提示,将这些分散的知识自动转为一个可导航的“地图”——肺癌知识图谱。其目标是让复杂的医学知识更便于计算机检索,并为专家提供更好决策支持工具的输入。

从零散叙述到互联事实

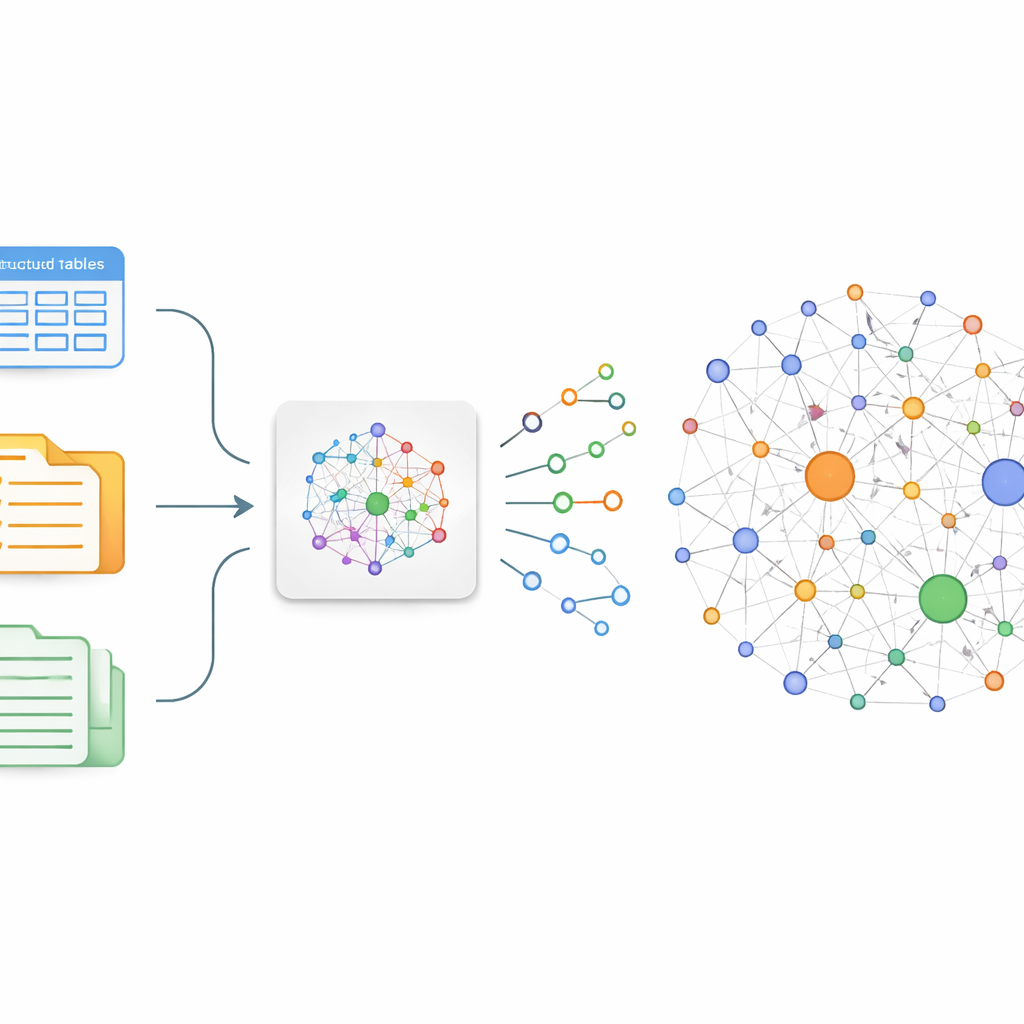

作者聚焦一个简单思路:如果你能可靠地从医学文本中提取“谁对什么做了什么”,就能把这些事实拼接成图谱。实际上,这意味着将自由形式的句子转为称为三元组的基本构件——由实体对和它们之间关系构成,例如“肺癌 – 治疗方式 – 化疗”。传统构建方式要么依赖大批标注员,要么依赖易碎的规则,难以捕捉细微差别与新发现。为此,研究团队对现有中文大型语言模型 ChatGLM-6B 进行微调,使其专门识别来自多种来源(从患者与医生的在线对话到结构化数据库与中医记录)中与肺癌相关的医学三元组。

教会 AI 以整齐单元思考

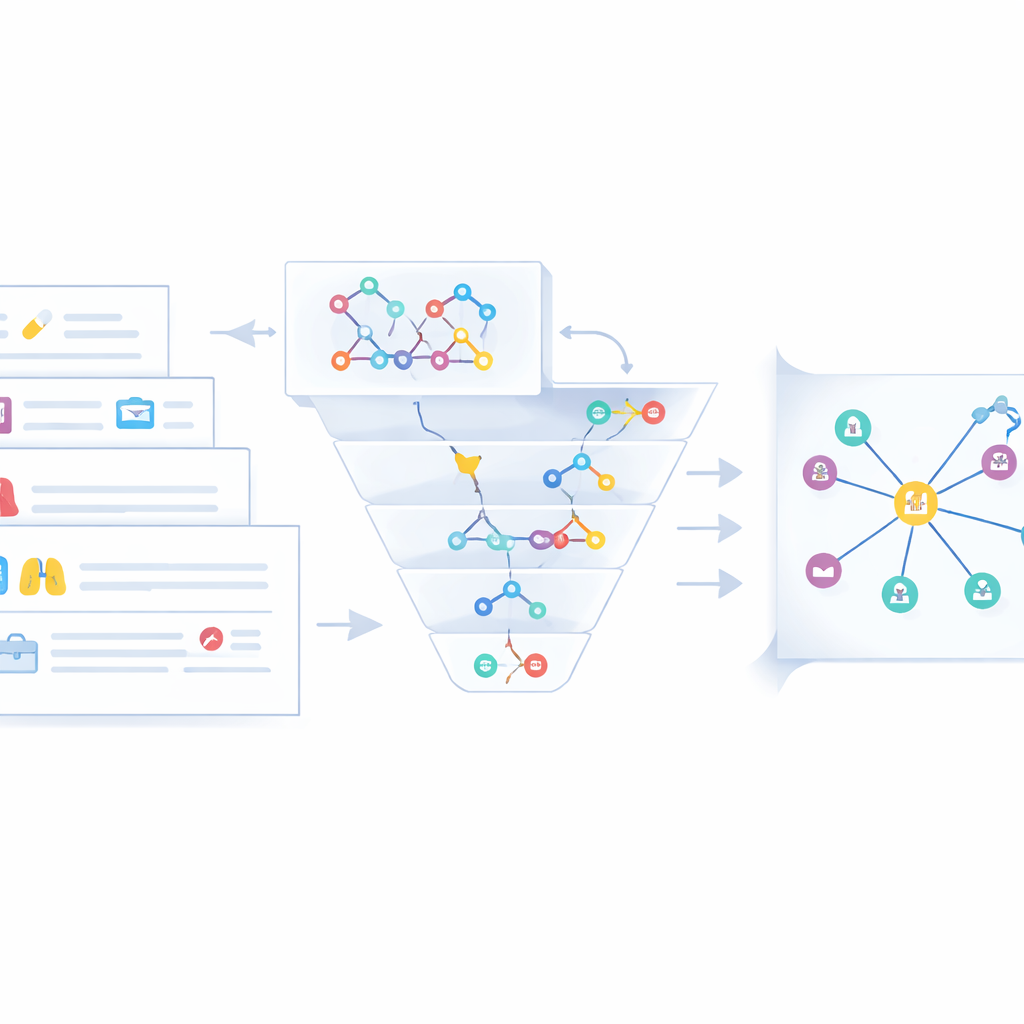

仅仅要求通用语言模型“抽取信息”常常得到杂乱、对话式的输出。研究者因此设计了一套严格的提示方案,并在近 5 万个优质示例上对模型进行微调。每个示例都展示了一条指令和期望的精确三元组式输出。提示要求模型扮演专业文本挖掘专家,仅输出机器可读的结构化三元组,并在句子包含嵌套细节时“逐步思考”,例如同时出现某种治疗、所用药物及其剂量时。角色设定、格式规则与分步推理的结合,使模型(现称 KGLM)从对话助手转变为纪律化的机器可用事实抽取器。

将多种来源合并为一致的图谱

从文本提取出的原始三元组只是开始。同一疾病或药物常以不同名称出现——例如“慢性阻塞性肺疾病”与“COPD”。为避免混乱,作者设计了融合阶段,将来自三类数据流的等价实体合并:非结构化网页文本、半结构化临床病例和现有医学知识图谱。首先采用快速的字符串相似度检查标记明显匹配项;当这不足以判断时,使用更深层的语义相似度模型(Sentence-BERT)在上下文中比较含义。被认定为重复的实体被合并为单一规范节点,优先采用较短名称,其他形式作为别名存储。专家随后审查边界情形,剔除误导性或低质量的断言,最终产出更干净、更一致的肺癌知识图谱,并将其存入 Neo4j 数据库。

这张知识“地图”表现如何?

为评估性能,团队将 KGLM 与基于 BERT 和卷积网络的常规模型以及未微调的原始 ChatGLM 进行比较。在关系抽取任务——判断哪些实体相连以及如何相连——上,微调并受提示引导的 KGLM 达到约 0.82 的 F1 分数,优于所有测试基线,较初始模型大约提升 25%。消融实验表明,每一项提示组件都很重要:去掉专家角色、严格的三元组格式或“逐步思考”指引都会降低准确性,尤其是面对包含嵌套属性或中医术语的复杂句子时。临床与信息学专家小组也评估认为,基于微调和结构化提示构建的图谱相比未微调或无结构化提示的图谱在准确性、可用性和临床相关性上更胜一筹。

对未来医学工具的意义

通俗地说,研究表明:只要有合适的训练与指令,大型语言模型就能高效地将杂乱的真实世界肺癌文本转为结构化、可检索的知识网络。该肺癌知识图谱目前仍是研究原型,且限于中文来源和单一疾病领域,但它指向了一个前景:不断更新的“知识地图”可用于支持决策支持系统、教育工具和研究探索。作者强调,此类图谱须经严格验证并定期更新,不能在无专家监督下直接用于指导临床决策。尽管如此,结果表明微调语言模型与智能提示相结合,能让组织医学知识这一艰巨任务更具可扩展性与时效性。

引用: Zhou, C., Gong, Q., Luan, H. et al. Fine-tuned large language models with structured prompts enable efficient construction of lung cancer knowledge graphs. Sci Rep 16, 9505 (2026). https://doi.org/10.1038/s41598-026-38959-w

关键词: 肺癌, 知识图谱, 大型语言模型, 关系抽取, 医学人工智能