Clear Sky Science · zh

基于DQN的无线供能通信网络能量优化

通过空中为微小设备供能

从智能路灯到隐藏在森林中的火灾报警器,无数微小设备构成了物联网。为它们持续供能是一大难题:电池会耗尽,而在各处敷设电源线又不切实际。本文探讨了一种将能量无线传送给这些设备的方法,并利用人工智能智能地分配能量,使关键传感器更长时间保持在线,整个网络运行得更顺畅。

为什么无线供电需要更智能的控制

无线供能通信网络发射无线电波,设备不仅能将其转换为电能,还能利用这些波进行数据通信。在以往的大多数研究中,这种能量转换被当作简单的线性过程:信号越强,能量成比例增加。实际上,能量采集电路在输入信号较强时会出现“饱和”或“趋平”现象,导致部分能量被浪费。与此同时,真实环境复杂多变:太阳能面板的光照强度会波动,建筑物会阻挡信号,突发事件(例如火情)会使特定节点产生紧急的数据需求。忽视这些变化的静态规则可能导致某些传感器长期能量不足,而其他设备又浪费能量,从而缩短整个网络的寿命。

为供电网络配备一个学习大脑

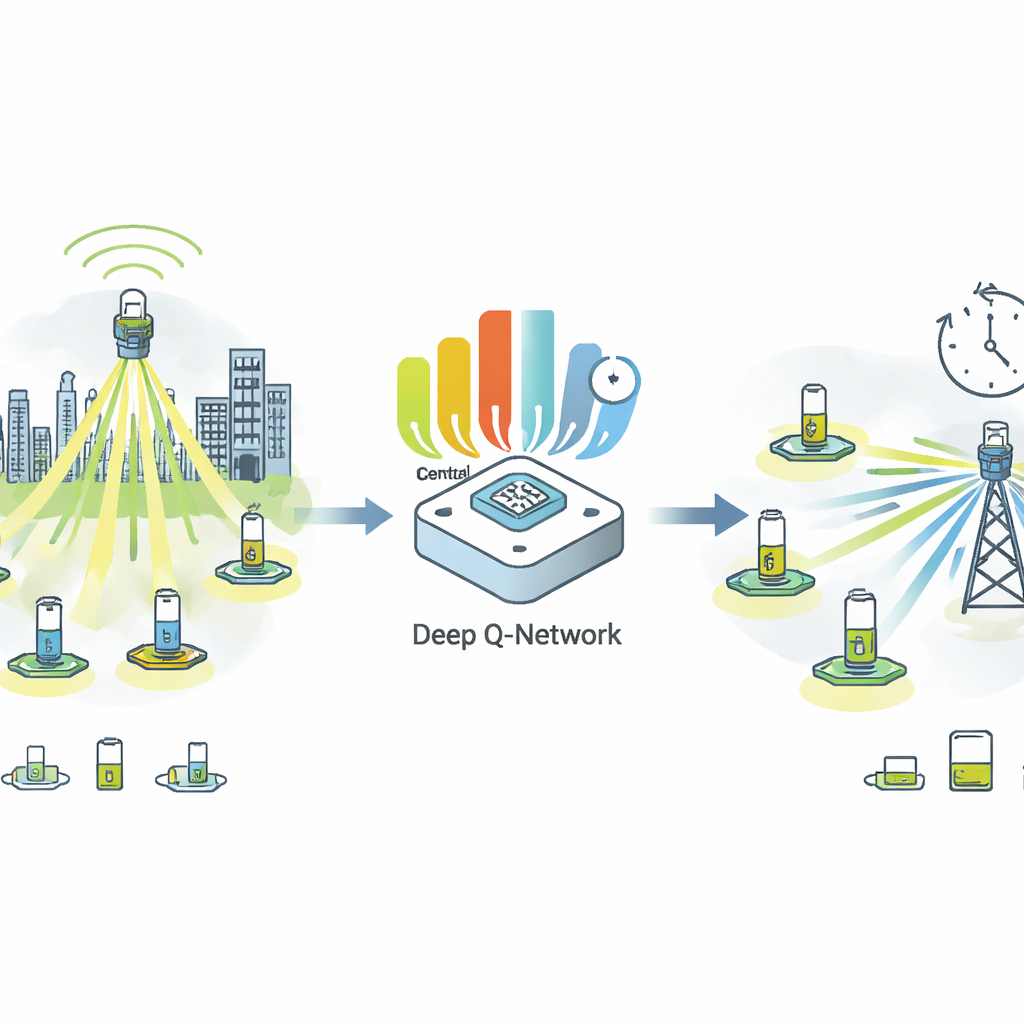

为了解决上述问题,作者设计了一个基于深度Q网络(Deep Q-Network,DQN)——一种强化学习方法的学习型控制器。该控制器不依赖固定的数学公式,而是将网络视为一个随时间进行的博弈。在每一轮中,它观测每个节点剩余的能量、无线链路质量以及各项任务的紧迫程度——例如火灾监测与常规温度检查的优先级不同。基于这些观测,它决定向每个节点发射多少能量。在每次决策后,控制器会接收包含多个目标的反馈:尽可能传输更多有用数据、在节点之间公平分配能量以避免持续忽视某些设备,以及避免对共享电源的浪费性过度使用。经过多轮学习,控制器逐步掌握哪些能量分配模式能带来更好的长期性能。

前瞻性与平衡互相冲突的目标

框架的一个关键组成是预测。系统使用一种名为高斯过程回归(Gaussian Process Regression,GPR)的统计方法来预测节点在近期内可能收集到的能量,例如随着光照条件变化的情况。它还采用了一个灵活的无线信号衰落与反射模型以模拟现实城市环境。这些信息输入到每隔几秒更新一次的决策过程中,使控制器能够在网络条件变化时迅速响应。引导学习的奖励信号融合了三种简单理念:效率(每单位能量传输的比特数)、公平性(能量在节点间分配的均衡程度)和优先级(确保高紧迫性任务获得所需资源)。通过调整这三项的相对权重,网络运营者可以在最大化寿命、严格公平或追求峰值数据率之间进行选择。

仿真揭示的结果

由于真实世界的实验仍在进行,作者在详细的计算机仿真中评估了他们的方法,仿真网络包含30个无线供能设备,并扩展到100个节点的场景。与简单的固定能量分配策略和较传统的学习方法相比,新控制器能使网络持续运行更久——在节点关闭前的轮次数大约增加一半左右。它还使设备间能量水平的差距更小,意味着“断电点”更少、节点早期失效的情况大幅减少。所学策略对突发变化(例如信号质量骤降或任务紧迫度激增)的适应速度快数倍,并在各种无线条件下保持更高的数据吞吐量。值得注意的是,作者关注了实际细节,展示了该学习模型的精简版本可在许多物联网设备使用的低成本微控制器上运行,决策时间在几十毫秒量级。

从仿真走向现实的传感器网格

研究得出结论:将无线供电与基于学习的控制器配对,能够显著延长传感器网络的寿命和可靠性,尤其是在环境不可预测且任务优先级各异的情况下。通过承认采集电路会饱和、无线环境会波动以及某些传感器在特定时刻更为重要,该方法比静态规则更能平衡互相冲突的需求。作者也明确指出,目前的结果主要来自仿真,确切收益仍需在实际硬件上验证。不过,他们的工作指向了这样一个未来:大量微小设备能够长时间无人值守地运行,智能地从空气中汲取能量,同时保持关键数据的持续流动。

引用: Chen, H., Wang, X., Yuan, L. et al. DQN-empowered energy optimization for wireless powered communication networks. Sci Rep 16, 7987 (2026). https://doi.org/10.1038/s41598-026-38904-x

关键词: 无线供电, 物联网, 能量采集, 强化学习, 传感器网络