Clear Sky Science · zh

通过变分推断进行面部表情识别

从面孔读取情感

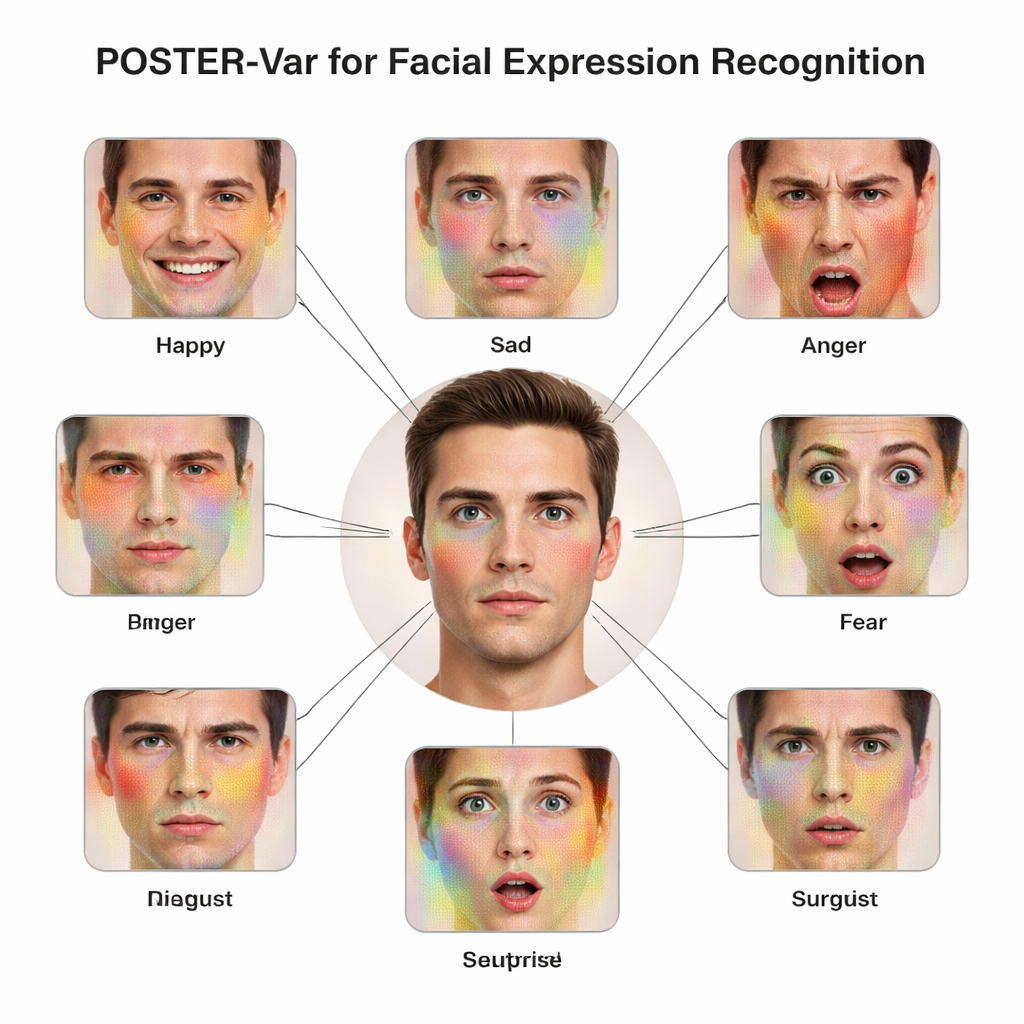

我们的面孔持续传达情绪,但这些信号往往并不简单。一个微笑可能掩盖紧张,而“中性”的表情可能同时混合着无聊与恼怒。本研究提出了POSTER-Var,一种新的人工智能(AI)系统,旨在比现有的面部表情工具更准确地读取这些微妙且混合的情绪,有望改善从人机交互到心理健康监测等多个领域。

为什么情绪不是简单的开/关

大多数现有的面部表情识别系统将情绪视为清晰、彼此分离的类别:开心、难过、生气等。实际上,心理学表明表情是基本情绪的混合体,不同情绪可能在同一张脸上以不同强度同时出现。传统的AI模型通常会把每张图像强行归为一个确定标签,忽视不确定性和情感的连续、梯度性质。这使得它们在光照、姿态以及人为标注不一致等噪声较多的现实场景中表现脆弱。作者认为,未来的系统必须承认一张脸可能暗示多种不同强度的情绪,并且计算机应以概率的方式进行推理,而不是二元的有/无判断。

让模型拥抱不确定性

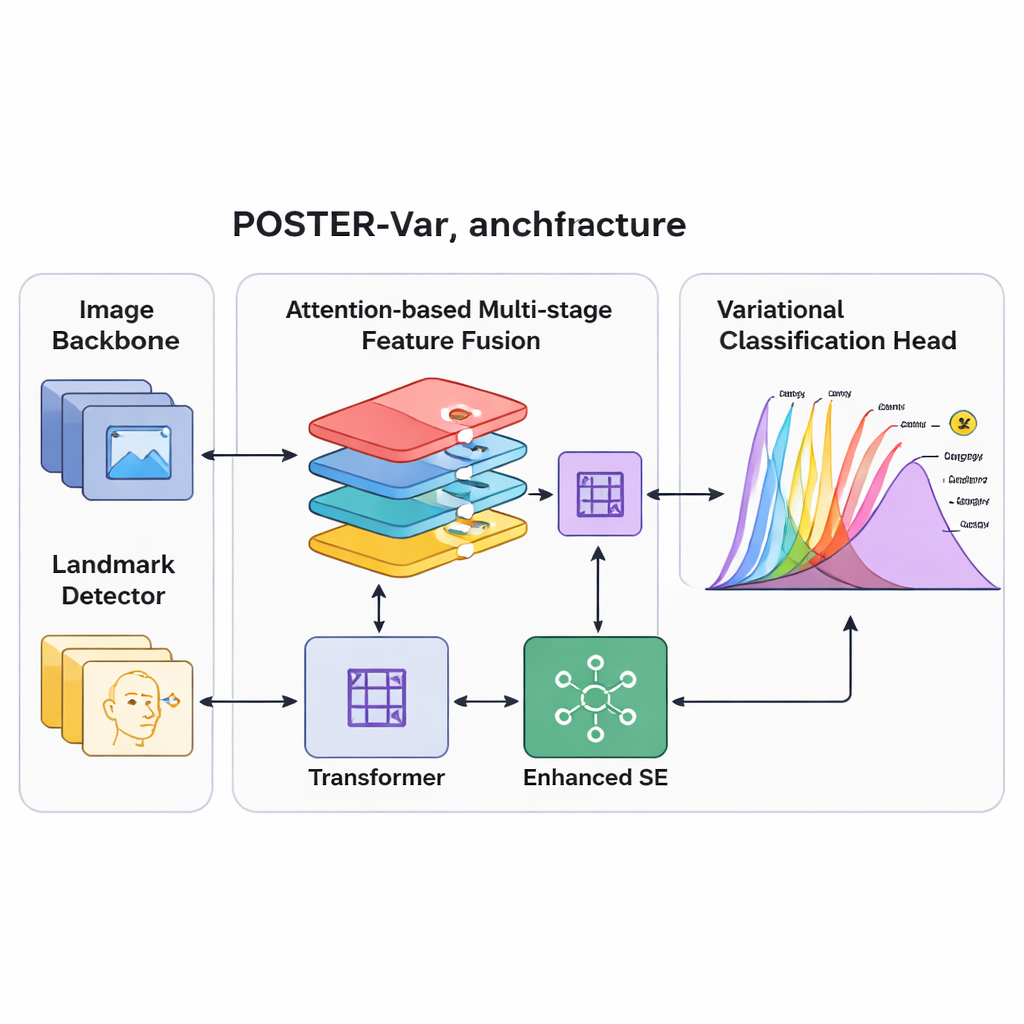

为更好地契合这种复杂现实,研究团队基于现代概率建模中的一种技术——变分推断。POSTER-Var系统并非为每种情绪给出单一固定分数,而是将面部特征映射到一个“潜在空间”,在该空间中每种情绪由一个概率分布表示,通常呈钟形曲线。在训练期间,系统从这些学习到的分布中采样,鼓励它探索对每张脸的一系列可能解释。然而在测试时,它只使用这些分布的中心来给出稳定的预测。关键在于,POSTER-Var去除了早期变分设计中额外的解码和全连接层,将概率表示本身作为最终决策信号。这种简化的“基于变分推断的分类头”(Variational Inference-based Classification Head,简称VICH)使模型在保持高效与准确的同时量化不确定性。

多尺度观察面部

识别表情还需要观察面部的不同部位和不同细节层级:嘴角的曲线、眼形以及整体配置都很重要。POSTER-Var在一个强大的先验系统(POSTER++)基础上改进了多尺度特征的融合方式。它使用多种注意力机制来融合来自标准图像骨干网络和面部关键点检测器的信息,后者跟踪例如眼角和嘴唇边缘等关键点。一个“层嵌入”会标注每个特征图在处理金字塔中的位置与语义层级,帮助网络识别不同细节的来源。非线性变换与增强的通道注意力模块随后对这些特征重新权衡,提升对表情有信息量的特征,同时抑制诸如背景杂乱或身份特征等干扰。

对系统进行测试

研究者在三个广泛使用的现实世界数据集上评估了POSTER-Var:RAF-DB、AffectNet和FER+。这些数据集包含数十万张在非受控条件下拍摄的面孔,每张图像都有若干基本情绪之一的标签。在所有基准测试中,POSTER-Var要么匹配要么超过了当前的最先进方法。例如,它在RAF-DB上的准确率约为93%,在FER+上约为92%,并在AffectNet的7类和8类设置中都有小幅提升。消融实验(移除单个组件)表明,层嵌入和变分分类头均显著提升了性能,且变分组件在更困难、类别不平衡的数据集上尤其有帮助。注意力图的可视化显示POSTER-Var比基线方法更关注更广泛、更有意义的面部区域,而其学习到的情绪分布图展示了它在模糊案例中如何更好地区分例如“悲伤”和“中性”。

这对现实应用意味着什么

通俗地说,POSTER-Var教会机器把面部表情看成不像红绿灯那样绝对,而更像天气预报:可能有主要的“晴朗”情绪,同时夹杂“多云”的暗示,而预报应当承认不确定性。通过对情绪建模完整分布而非单一猜测,系统在面对噪声标签和细微混合表情时变得更稳健。研究表明,这类概率化方法可成为下一代情感感知技术的基础,使虚拟助手、社交机器人和行为研究工具更敏锐地捕捉我们面孔所不完全透露的复杂情感生活。

引用: Lv, G., Zhang, J. & Tsoi, C. Facial expression recognition via variational inference. Sci Rep 16, 7323 (2026). https://doi.org/10.1038/s41598-026-38734-x

关键词: 面部表情识别, 情感人工智能, 概率建模, 变分推断, 计算机视觉