Clear Sky Science · zh

基于注意力的工作负载预测与异构计算环境的动态资源分配

更聪明的计算机为何事关每个人

在你观看的每部电影、打开的每张地图或与之对话的每个 AI 助手背后,巨大的计算机仓库日夜默默运行。随着人工智能变得更强大,这些数据中心正被推到极限:它们必须在多种机器上同时处理多类任务,同时控制成本、速度和能耗。本文提出了一种新的方法,用于预测这些计算资源在近期内的需求,并在不同类型的硬件之间调配工作,使服务保持快速可靠,同时减少电力浪费。

多种任务,多种机器

现代数据中心不再依赖单一类型的服务器。相反,它们将传统处理器与高性能图形芯片、定制 AI 板卡和可重编程电路结合在一起。不同的 AI 任务——例如训练大型语言模型、提供实时推荐或分析图像——与这些机器的匹配方式各不相同。如今,运营方常常使用固定规则或基于昨日使用情况的简单预测来分配资源。当需求突然激增时,这可能导致响应变慢或服务协议被打破;需求下降时,昂贵的硬件可能处于空闲状态,白白耗电却少有实质工作。

学会关注重要之处

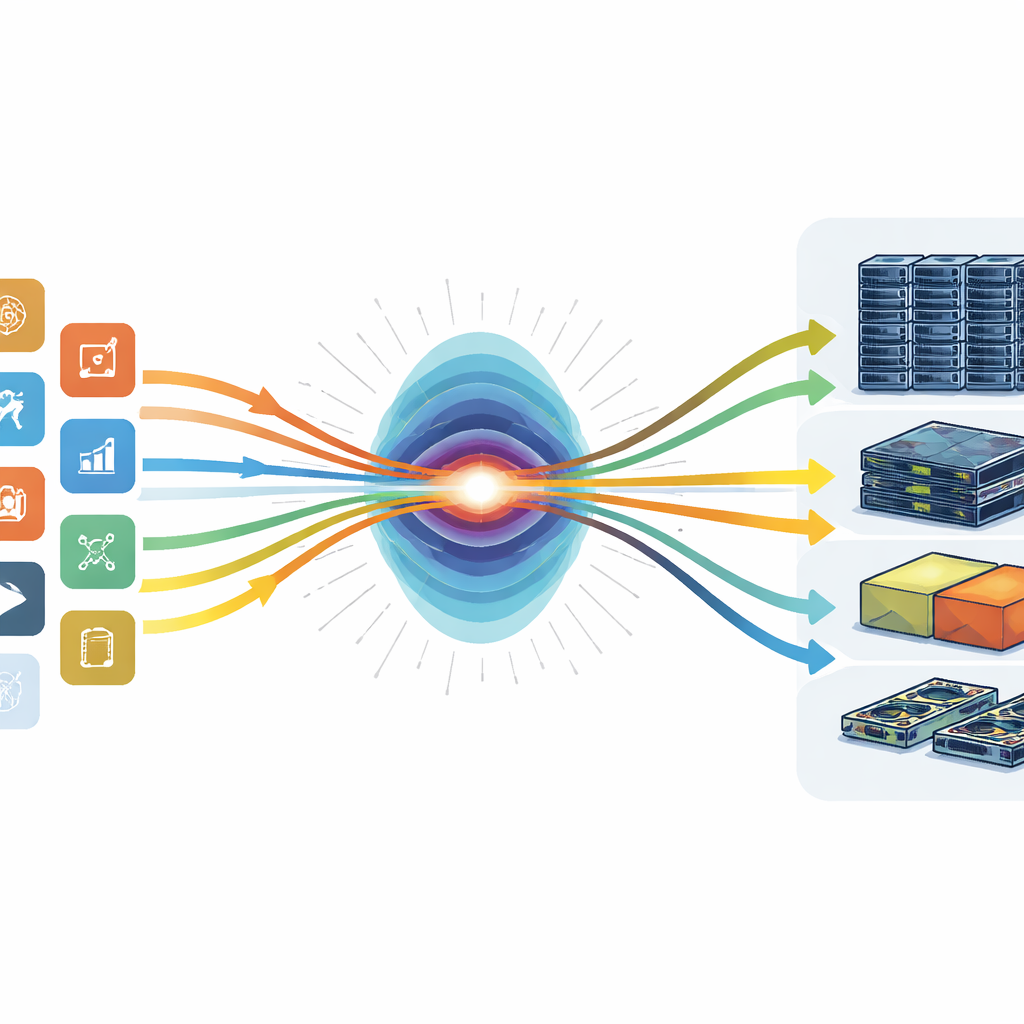

作者借用了前沿 AI 模型中的一个概念——“注意力(attention)”,并将其应用于数据中心管理。系统不是把所有历史使用数据一视同仁,而是学习哪些时间点和哪些任务类型对预测未来最有用。模型的一部分侧重于每个工作负载(如训练任务或在线服务)随时间的变化。另一部分则横向观察同一时刻运行的不同工作负载,以发现隐藏的关联,例如一批训练任务完成后常常会引发相关在线查询的激增。通过将这两种视角叠加,系统能比早期方法更准确地预测未来对处理器、内存和加速器的需求。

把预测转化为更好的决策

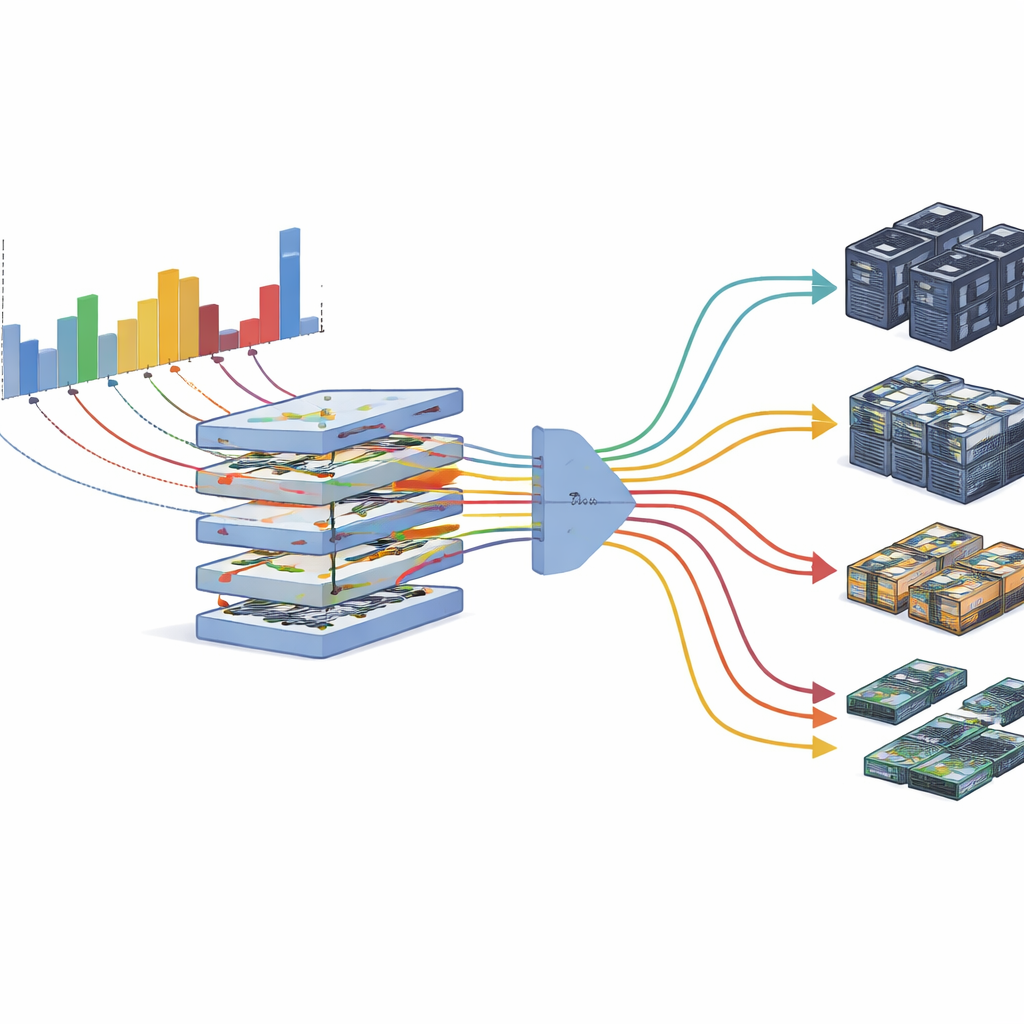

仅有预测还不够;数据中心必须据此采取行动。框架的第二部分将这些预测转为关于在哪台机器上运行每个任务的具体决策。作者将此视为在三个目标之间的平衡:尽快完成任务、尽量节能以及保持机器处于忙碌而非空闲状态。调度器将数据中心表示为不同设备的网络,并使用优化过程选择任务放置方案,根据运营者的偏好在这些目标之间进行权衡。鉴于预测永远不完美,系统还评估自身的不确定性并在必要时留出安全余量,同时实时监控实际情况,通过暂停低优先级任务或在使用情况偏离预期时迁移任务来进行调整。

对系统进行实测

为了检验该方法的实际效果,研究人员构建了一个具有现实混合处理器、GPU 和专用 AI 硬件的测试集群,并向其输入来自 Google、阿里巴巴和一个学术实验室的真实数据中心的详细活动记录。他们将该方法与流行的预测工具和调度策略进行了比较,包括生产系统中使用的技术和基于强化学习的控制器。基于注意力的预测器在准确性上始终更胜一筹,尤其是在 AI 工作负载中常见的剧烈突发情况下。当与他们的动态分配器结合时,系统将整体硬件利用率提高到约四分之三到五分之四的水平,平均作业完成时间缩短约四分之一,能耗降低约15%,同时将服务违规保持在非常低的水平。

这对普通用户意味着什么

对非专业人士而言,最重要的结论是:数据中心内更智能的协调可以在不需要新芯片或新建筑的情况下,使 AI 服务更快、更便宜、更环保。通过在海量使用数据中学会“关注”关键位置,该框架帮助现有硬件完成更多有用工作、减少空闲时间。这意味着公司可以在降低电费和碳足迹的同时,提供更流畅的应用和更强大的 AI 工具。随着类似的预测与分配系统逐步推广与成熟,互联网背后的无形机械不仅可能变得更强大,也将更可持续。

引用: Shao, S., Ding, X., Zhao, B. et al. Attention-based workload prediction and dynamic resource allocation for heterogeneous computing environments. Sci Rep 16, 8571 (2026). https://doi.org/10.1038/s41598-026-38622-4

关键词: 数据中心调度, AI 工作负载预测, 异构计算, 节能计算, 资源分配