Clear Sky Science · zh

在隐藏状态威胁模型中对差分隐私随机梯度下降进行更严格的隐私审计

这对日常技术有什么意义

现代应用不断从我们的数据中学习,从照片和消息到病历不一而足。保持这种训练安全的主要方法之一称为差分隐私,它通过加入精心调整的噪声,使得单个人的数据不会显著突出。但我们如何知道这些保护在实际中真正奏效,尤其是对于当今使用的深度神经网络?本文探讨了这个问题,展示了在何种情况下隐藏模型的“训练过程”确实有助于隐私——以及在何种情况下并非如此。

隐私学习应当如何工作

差分隐私随机梯度下降(DP-SGD)是隐私保护机器学习的主力算法。它按小批次逐步训练模型,对每一步的梯度(改进方向)进行裁剪并在更新模型之前加入随机噪声。理论上给出了个人数据对最终模型影响的上界,通常用一个称为 epsilon 的隐私参数来概括。与此同时,“隐私审计”试图攻击训练好的模型,看看在实践中到底能提取到多少信息。如果理论与审计结果相符,我们就可以信任我们的隐私计量;如果不一致,就表明有重要内容被忽略了。

仅公布最终模型时会发生什么变化

早期的大多数审计都假设对手很强大,能够看到训练过程中的每个中间模型检查点。实际上,许多机构只发布最终模型,而不公开完整的训练历史。这种更现实的设置称为隐藏状态威胁模型。最近的理论工作表明,至少在简单凸问题中,隐藏中间模型可能随时间放大隐私保护:早期使用的数据会被随后带噪的更新“冲淡”。然而,现代深度学习依赖高度非凸的模型,其损失面崎岖复杂。因此尚不清楚在这些情况下是否也会出现同样的放大效应——或者现有攻击只是太弱,无法暴露全部的隐私损失。

对手推动模型的新方法

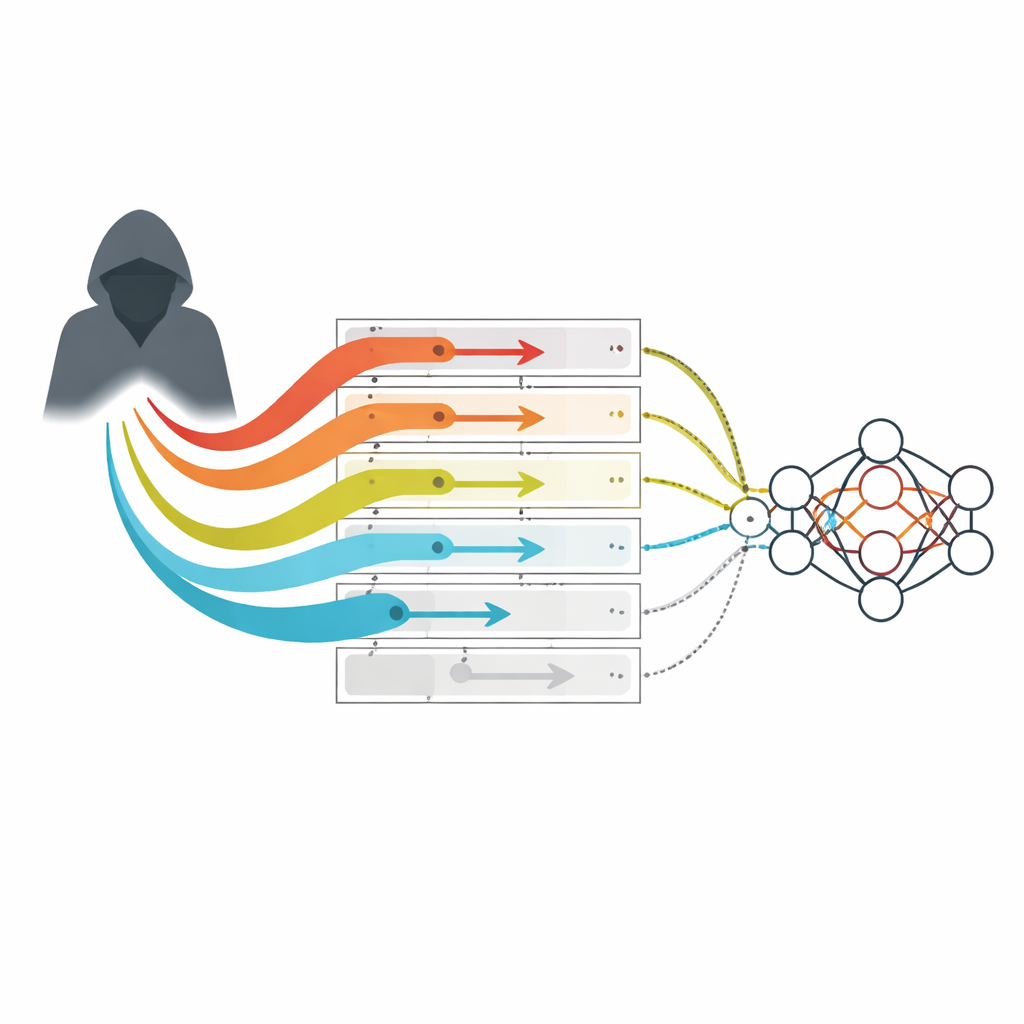

作者提出了一类新型的、针对隐藏状态模型的“梯度构造”对手。与传统基于损失的攻击(设计特殊数据点然后观察其训练期间损失如何变化)不同,这类对手直接指定在存在最坏情况数据点时会施加的一系列梯度。他们选择总是达到裁剪阈值并与很少被更新的参数方向对齐的梯度,这使得即便看不到中间模型,其影响也更容易被检测到。文中研究了两种简单变体:一种随机选择参数方向,另一种通过模拟训练过程找到最少被更新的方向,然后沿该方向注入强且重复的梯度。

实验揭示的真实隐私风险

利用该框架,论文对图像和表格数据集上的 DP-SGD 进行了审计,使用了常见架构如卷积网络和残差网络,以及一个小的全连接模型。当构造的梯度在每一步训练中都被使用时,新型对手即使只看到最终模型也能匹配严格的理论隐私界限。这意味着在这种极端情况下,隐藏中间检查点并不能提供任何额外的隐私保护。当构造梯度较少地插入时,情况会有所不同:对于相对于噪声水平较大的大批量,审计结果仍接近理论(再次表明真实放大效应很小),但对于较小的批量和较高的噪声,出现了一个差距,表明在非凸设置下确实存在真实但适度的隐私放大。

窥探最坏情况极限

为了解隐藏状态模型中隐私的绝对极限,论文还研究了一个更极端的理论对手:该对手不仅构造梯度,还设计整个损失景观,使得特殊数据点的影响能在多次迭代中持续存在。在这个受控设置下,结果清晰地区分了两种情形:在大批量下,基于标准理论的隐私计量基本上是紧的;但在小批量和较大噪声下,关于数据点的早期信息会随着时间部分被遗忘。关键的是,这种放大比简单凸问题中已知的要弱,并且从未完全抹去隐私风险。

这对用户与从业者意味着什么

对非专家而言,结论是仅仅隐藏深度学习模型的训练历史并不会神奇地保证更强得多的隐私保护。当一个人的数据在训练中被非常频繁地使用时,他们面临的风险接近当今保守理论所预测的水平。在更有利的情形下——小批量且噪声显著——确实会出现一些额外保护,但这种保护是有限的,并不会将风险降为零。此项研究既验证了现有隐私计量的部分结论,也指出了其局限,为只共享最终模型时 DP-SGD 能提供多少保护描绘了更清晰、更现实的图景。

引用: Bhuekar, A. Tighter privacy auditing of differentially private stochastic gradient descent in the hidden state threat model. Sci Rep 16, 8365 (2026). https://doi.org/10.1038/s41598-026-38537-0

关键词: 差分隐私, DP-SGD, 隐私审计, 机器学习安全, 隐藏状态模型