Clear Sky Science · zh

在低查询预算下的高查询效率基于决策的对抗攻击

为什么图像中的微小瑕疵能愚弄聪明的机器

现代人工智能可以以令人印象深刻的准确度识别人脸、动物和日常物品。然而,这些系统同样可能被对图像进行肉眼几乎察觉不到的微小改动所欺骗。本文探讨了一种在尽可能少询问模型的前提下制造此类“误导”图像的新方法,揭示了当今模型的脆弱性以及攻击者在现实环境中可能如何利用这些弱点。

攻击者如何从外部探测 AI 系统

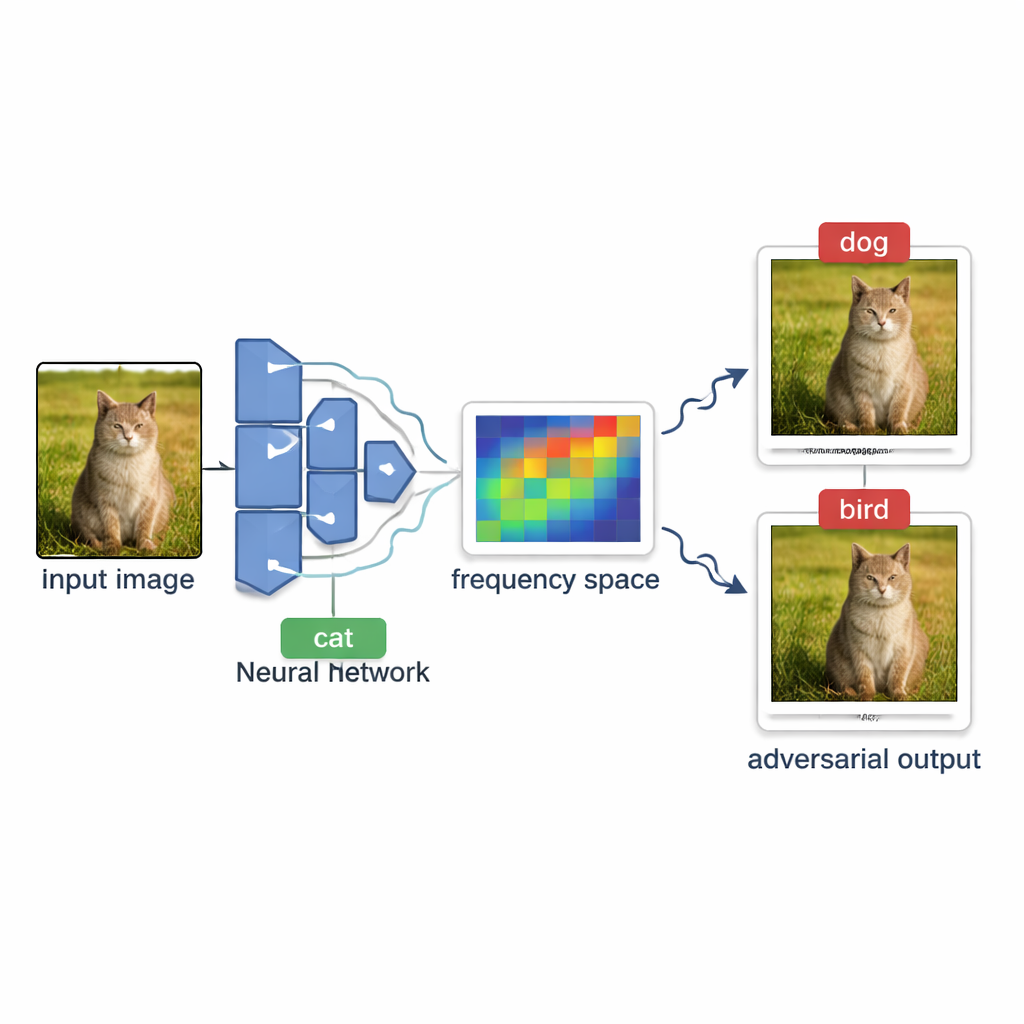

在许多真实服务中——例如在线照片标注或内容过滤——模型表现得像一个黑箱。外部人员可以上传图像并仅看到最终标签,例如“狗”或“停车标志”,但看不到内部的置信度分数或模型结构。在这样的条件下创建误导性图像被称为基于决策的黑箱攻击。挑战在于在无法看到模型“改变主意”的接近程度的情况下,温和地调整一张普通图片让模型产生错误判定,同时又不能发送过多测试图像以致系统注意到或查询成本过高。

一种用极少问题进行搜索的新方法

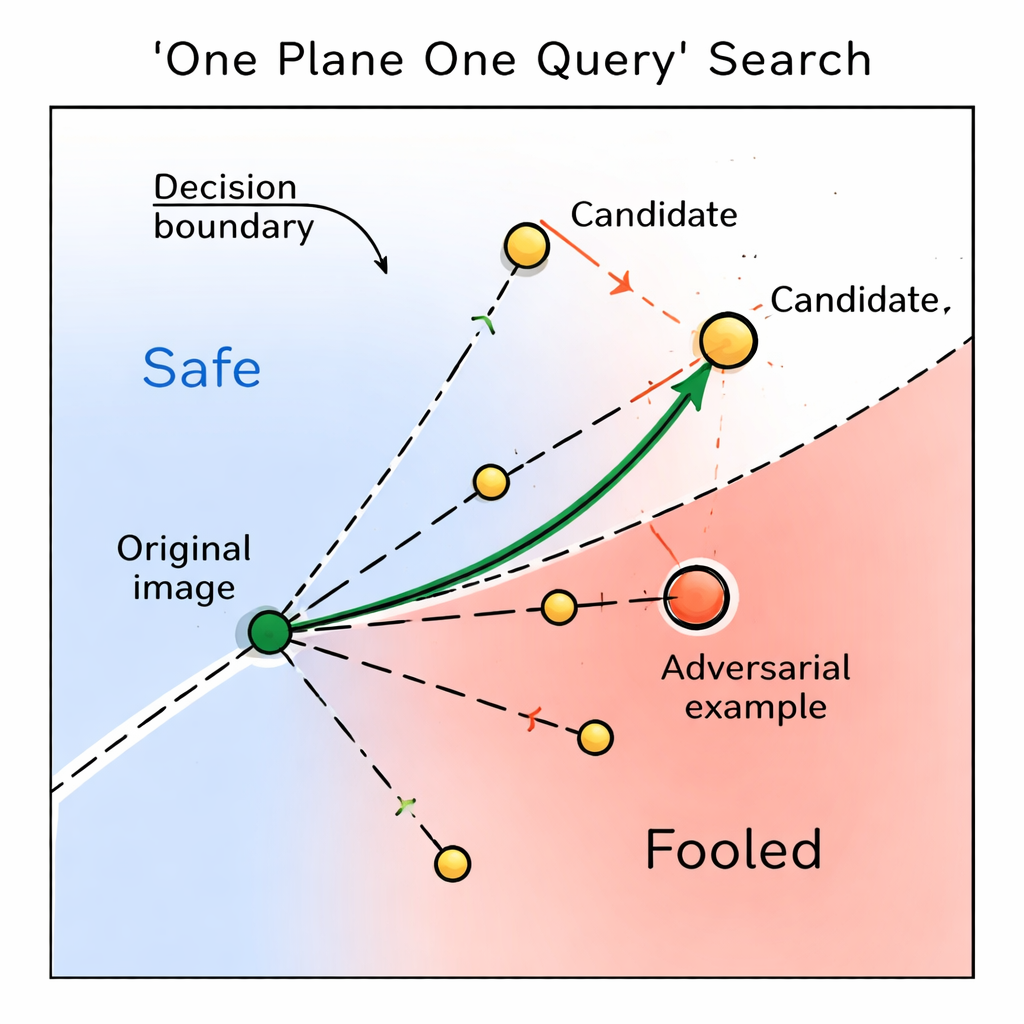

作者提出了 OPOQA(One Plane One Query Attack),一种设计上节省查询但仍能生成高质量对抗图像的方法。与在单一猜测方向上反复探测不同,OPOQA 以轮次方式工作。每一轮,它从已有的误导图像和原始干净图像出发,提出若干沿精心选择方向的新候选图像。关键在于每个方向最多探测一次,这样有限的查询预算就能用于探索更多可能性,而不是在单一猜测上过度细化。

顺着图像中的平滑波动前进

为选择有前景的方向,OPOQA 借助了这样一个理念:最有效且难以察觉的改动往往是平滑的、宽泛的变化,而非尖锐的像素级噪声。该方法使用一种称为离散余弦变换的数学工具,将图像转换到“频域”视角,在那里缓慢、温和的变化集中在一处。它随机采样其中的几个低频分量,将它们转换回普通像素改动,并用作探索的基本方向。每个采样方向帮助定义一条连接原始图像、当前对抗图像和一个新候选图像的平面二维曲面。在这些曲面上,OPOQA 选择单个点进行测试,平衡两个目标:在尽量接近原始图片的同时仍很可能将模型推向错误决策。

挑选最佳候选并实时自适应

一旦 OPOQA 生成了一小批候选图像,它会测量每个候选与原始图像的距离并按从小到大的顺序排序。然后按该顺序查询模型。一旦找到一个被模型误分类的候选,它就停止并将该图像作为下一轮的起点。如果没有候选成功欺骗模型,OPOQA 会保留之前的最佳对抗图像,但会调整一个内部参数,该参数控制下一步操作的保守或激进程度。这种“贪婪”策略——始终接受当前可得的最佳被误分类图像并动态调节步长——使得攻击能在不浪费查询的情况下,聚焦于微妙而有效的扰动方向。

实验揭示了 AI 的薄弱环节

研究人员在大规模 ImageNet 基准的 200 张图像和六种广泛使用的神经网络模型上测试了 OPOQA,包括 Inception-v3、ResNet、VGG、DenseNet 和视觉变换器。在每张图像严格限制为最多 1,000 次查询的条件下,OPOQA 与若干领先攻击方法相当或表现更好。例如,在 Inception-v3 上,它成功欺骗了 94% 的图像,同时保持的改动微小到人眼几乎不可见,较之前最优方法提高了数个百分点。跨模型来看,OPOQA 往往能更早达到高成功率——使用更少的查询——尽管在非常大的查询预算和长时间微调下,一些竞争方法会迎头赶上或超过它。

这对日常 AI 安全意味着什么

该研究表明,即便攻击者只能看到最终决策并且探测机会有限,当今的视觉系统仍然可能被欺骗。通过智能地探索温和的低频变化并谨慎分配每次查询,OPOQA 能生成对人类看起来相同但会误导机器的图像。对非专业读者来说,结论是:AI 的“视觉”仍相当脆弱——它可以被以难以察觉的微妙方式推离正确轨道。认识并研究此类高效攻击是强化现实系统(例如安防摄像头、医学影像工具和自动驾驶车辆)以抵御可能被忽视的操纵行为的重要一步。

引用: Tuo, Y., Yin, M. & Che, S. Query-efficient decision-based adversarial attack with low query budget. Sci Rep 16, 6886 (2026). https://doi.org/10.1038/s41598-026-38428-4

关键词: 对抗示例, 黑箱攻击, 深度学习安全, 图像分类, 查询高效攻击