Clear Sky Science · zh

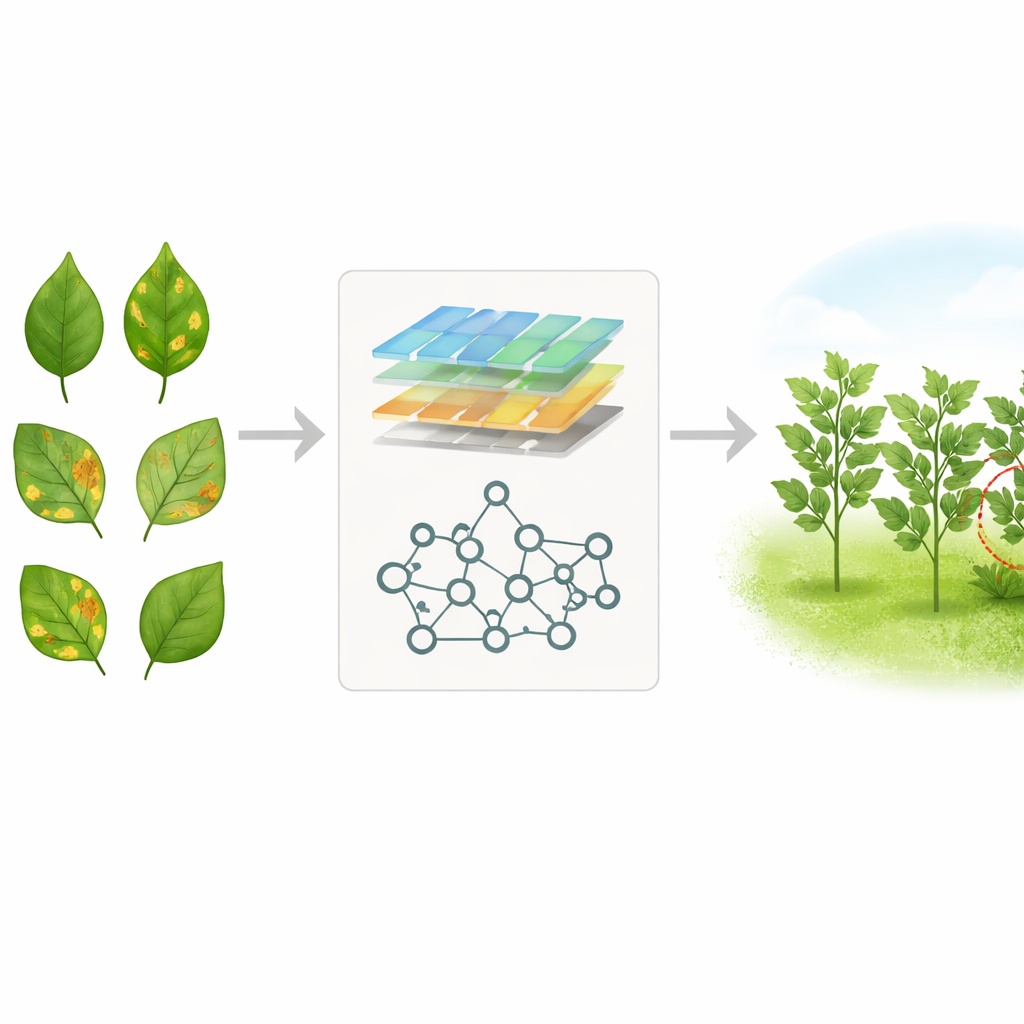

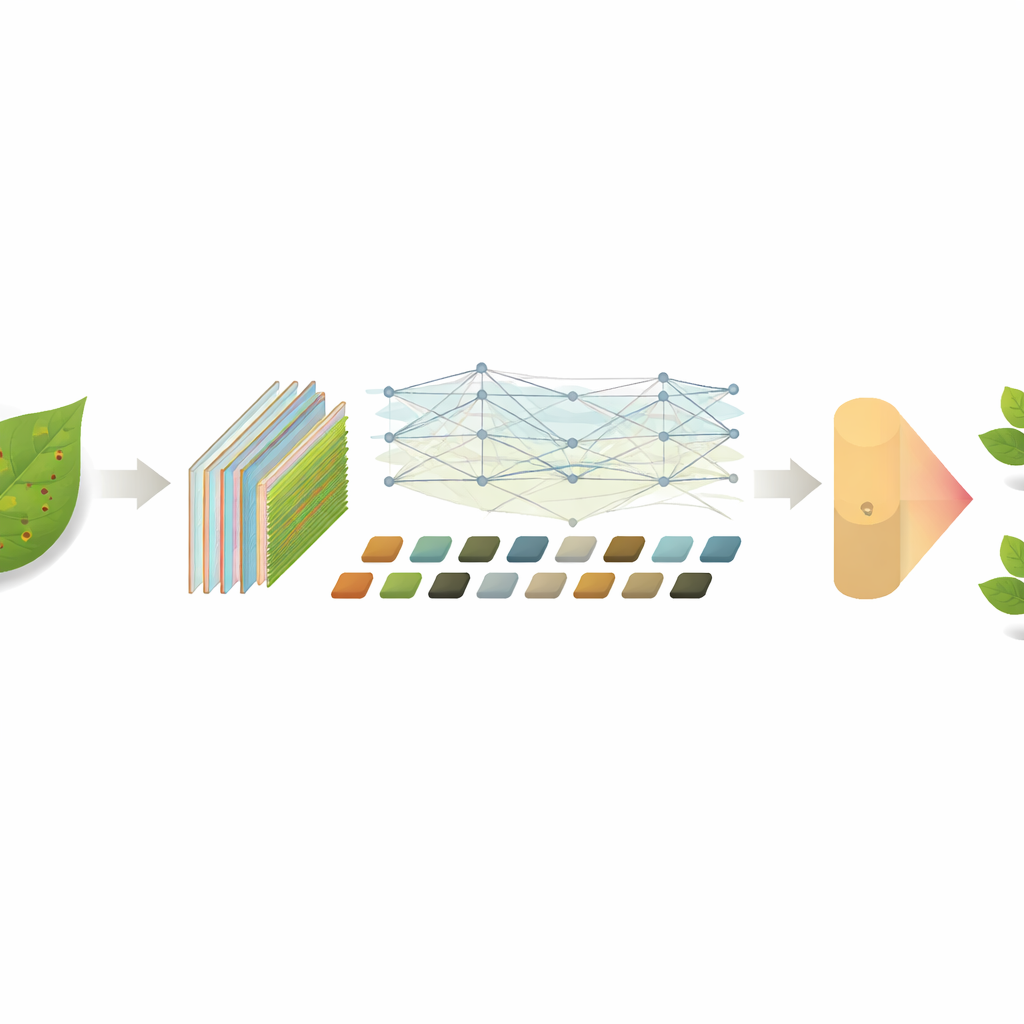

一种结合卷积与变换器模型的混合深度学习框架,用于稳健的植物病害分类

为什么发现病株很重要

植物病害每年默默摧毁世界大量粮食,削减产量、损害农民收入并威胁粮食安全。及早发现这些病害并不容易:田地广阔、植保专家稀缺,且许多症状很微弱。本文探讨一种新型人工智能能否仅凭普通照片识别数十种叶片病害,为智能手机或野外摄像头工具提供路径,帮助农民在问题扩散前采取行动。

从人工判断到数字之眼

传统诊断依赖人工目测叶片并有时送检实验室。该过程缓慢、带有主观性,并且在农村地区常常不可得。过去十年间,研究者训练计算机程序来读取叶片图像。早期系统要么依赖工程师手工设计的视觉特征,要么使用擅长捕捉纹理、颜色与边缘的卷积神经网络。尽管这些方法提高了准确率,但在病征微弱、分布在叶片各处或不同病害外观相似时仍然困难。新研究提出了一个问题:将两种现代人工智能方法结合,能否在这些棘手情况下提供更可靠的判断。

融合两种观测方式

作者构建了一个混合系统,将卷积网络与一种较新的图像模型——视觉变换器融合在一起。第一部分 EfficientNet-B7 像放大镜一样扫描叶片照片,捕捉微小斑点、脉络和颜色变化等细节。其输出随后被重整并传入变换器(ViT-B16),后者擅长注意图像不同区域之间的长距离关联。通过将精细特征转为一系列小补丁,并让变换器评估每个补丁与其他补丁的相互作用,系统既能理解局部瑕疵,也能把握叶面上的整体模式。这种组合旨在模仿熟练农艺师既仔细观察病斑又考虑其位置和周边情况的方式。

用成千上万片叶子教系统

为了训练和测试模型,研究者使用了一个包含21,534张图像的大型公开数据集,覆盖38种不同状况,包括多种病害和来自苹果、番茄、葡萄与玉米等作物的健康叶片。他们将照片标准化为统一尺寸,并通过旋转、翻转和缩放等数据增强手段模拟真实田间的复杂情况。模型先从已有图像数据中学习通用视觉模式,然后在该植物数据集上进行微调。在整个训练过程中,团队不仅跟踪总体准确率,还监测模型对每种病害的识别率及误报情况,确保在常见与罕见类别上都能保持稳健表现。

混合方法的表现如何

在未见图像上的评估显示,该混合模型能在98.13%的情况下正确分类植物健康状况与病害,并在精确率、召回率以及两者平衡的严格评估指标上保持高分。它既能处理健康叶片,也能识别困难病症,尽管非常早期的症状仍更具挑战性。作者将其系统与多种流行替代方法进行比较,包括独立的卷积网络、纯变换器模型、轻量移动网络、像 YOLO 这样的快速检测器,以及支持向量机与随机森林等经典工具。在这些一对一测试中,混合模型始终领先,甚至略胜过仅使用 EfficientNet 或多个网络集成的强劲竞争者。

这对农田与粮食意味着什么

从实际角度看,该研究表明将图像的两种互补“视角”——清晰的局部细节与广域上下文——结合起来,可以显著提升自动植物病害检测能力。当前系统仍需要较清晰的照片并在配备图形处理器的机器上运行效果最佳,但同样的设计理念可以被改造成适用于智能手机、无人机或低成本野外设备的轻量版本。随着这些工具成熟,它们可为农民提供快速、现场的病害定位与建议,支持更早的处理、减少化学投入并提高收成稳定性。对普通读者来说,核心信息是:更智能的相机和算法正成为保护全球粮食供应的有力助手。

引用: Jawed, M.M., Tufail, F.A., Ahmed, M.Z. et al. A hybrid deep learning framework using convolutional and transformer models for robust plant disease classification. Sci Rep 16, 9704 (2026). https://doi.org/10.1038/s41598-026-38209-z

关键词: 植物病害检测, 深度学习, 视觉变换器, 精准农业, 图像分类