Clear Sky Science · zh

使用Swin Transformer与双注意力多尺度融合网络的乳腺癌诊断深度学习框架

这对患者和医生为何重要

乳腺癌是女性中最常见的癌症之一,乳腺X线摄影(乳房钼靶)是早期筛查的主要手段。然而,对这些X线图像的解读很困难,即便是专家也可能错过细微的警示信号。本研究提出了一种新的人工智能(AI)系统,旨在通过结合两种强有力的“观察”方式来帮助放射科医师更可靠地发现乳腺癌:一种抓取整体结构的视角与一种放大微小细节的视角。

同时看到森林与树木的挑战

现代AI系统已经能够辅助医学影像的阅读,但大多数依赖单一模型类型。卷积神经网络善于发现局部模式,例如锋利的边缘或小的高亮斑点;而视觉Transformer(一类较新的模型)擅长理解整幅图像中各部分之间的关系。然而乳腺X线影像同时需要这两种能力:癌变可能表现为微小的钙化点或轻微的组织变形,其临床意义又取决于这些征象在整个乳房结构中的位置与关系。同时,现实的乳腺影像数据集相对有限且常常不平衡,癌症样本远少于正常检查,这使得AI系统容易过拟合或产生偏差。

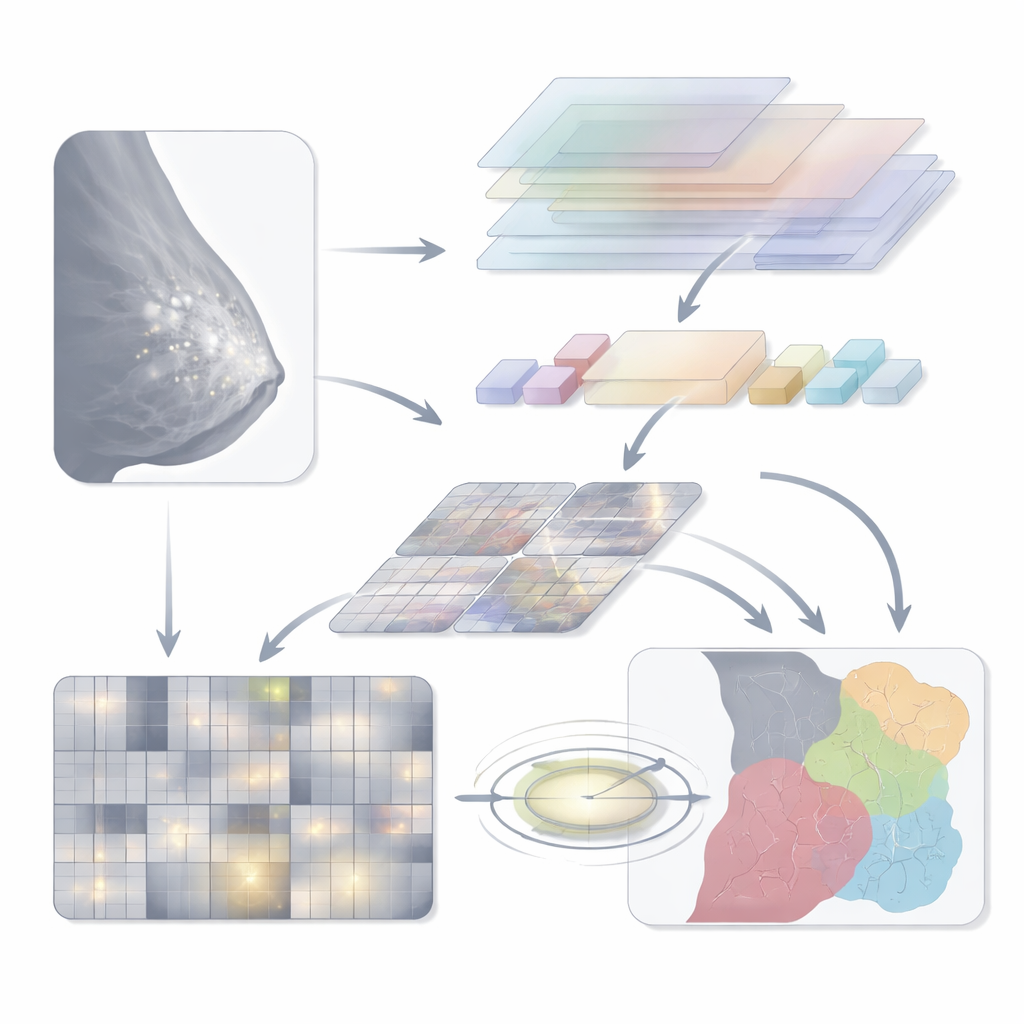

一套既看全局又放大细节的双通路AI

作者提出了一个混合模型,称为Swin‑DAMFN,专门用于融合全局与局部视觉信息。一个分支基于Swin Transformer,将乳腺图像划分为窗口并利用注意力机制捕捉远端上下文——即乳房不同区域之间的关联。第二个分支是自定义的卷积网络:双注意力多尺度融合网络(DAMFN)。该分支针对捕捉极其细微的细节(如微钙化和轻微组织畸变)进行调优。其内部的专用模块以多尺度和多方向分析图像,然后通过注意力机制强调那些临床上更有信息量的区域,同时弱化背景组织的影响。

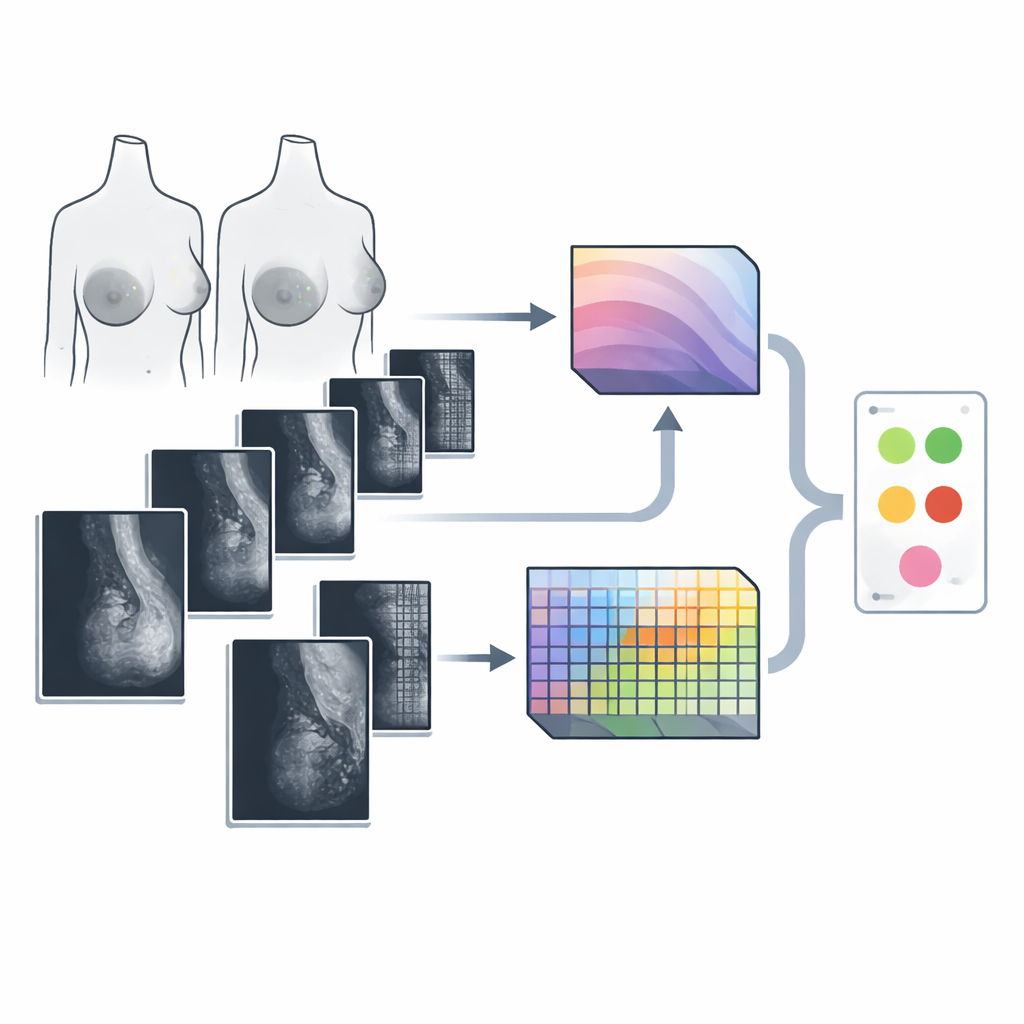

用更多更丰富的图像来教学系统

鉴于真实乳腺X线数据集有限且偏向非癌病例,研究者通过两种互补方式增强训练数据。首先,他们使用一种称为条件生成对抗网络(conditional GAN)的生成模型来合成逼真的乳腺图像块,尤其是用于代表性不足的恶性类别。生成的图像有助于平衡类别并向模型展示更多疾病外观的变体。其次,他们对真实与合成图像施加光度变化——对亮度、对比度和锐度进行小幅随机调整。这迫使AI关注真实的解剖学模式而非表面的照明或噪声,从而提高其推广到新影像的能力。

诊断过程中各部分如何协同工作

在分析阶段,经预处理的乳腺X线图像同时输入到两个分支。Swin Transformer输出对全局结构的紧凑摘要,而DAMFN生成丰富的局部特征图。这些特征随后被对齐到相同尺寸并融合为单一表示。一个轻量级的“三重注意”模块进一步通过跨通道和空间维度交叉校验来精炼这种融合,引导模型聚焦于最可能含有病变的区域。最后,一个简单的分类头对信息进行平均并给出多个类别的预测,例如正常组织、良性发现或不同类型的恶性病变。

结果在实践中的意义

团队在两个广泛使用的公开数据集CBIS‑DDSM和MIAS上测试了Swin‑DAMFN,并与多种流行深度学习模型进行了比较。他们的系统在CBIS‑DDSM上达到了约99%的准确率,在MIAS上接近99%,且具有同样较高的灵敏度(发现癌症的能力)和特异性(避免误报)。详尽的消融实验表明,每个组成部分——双分支、基于注意力的融合和数据增强策略——都对性能提升做出了贡献。作者也指出仍需在更多样化的医院数据上进行更广泛的测试,但研究结果表明,像Swin‑DAMFN这样的混合AI系统有望成为乳腺癌筛查中的有力助手,帮助放射科医师更早且更一致地识别危险病变,同时减轻工作负担和不确定性。

引用: Aldawsari, M.A., Aldosari, S.J., Ismail, A. et al. A deep learning framework for breast cancer diagnosis using Swin Transformer and Dual-Attention Multi-scale Fusion Network. Sci Rep 16, 8941 (2026). https://doi.org/10.1038/s41598-026-37969-y

关键词: 乳腺癌, 乳腺X线摄影, 深度学习, Transformer模型, 医学影像人工智能