Clear Sky Science · zh

RiemannInfer:通过黎曼几何改进变换器推理

这对日常 AI 用户的重要性

现代聊天机器人和 AI 助手能够解决数学问题、撰写文章,甚至解释医学话题,但我们仍然不真正清楚它们如何得出结论,也不清楚如何让它们更可靠地推理。本文介绍了“RiemannInfer”——一种通过将模型内部活动视为在弯曲几何曲面上运动来洞察大型语言模型(LLM)的方法。这一视角不仅提供了对系统思维方式更直观的描绘,还能使其推理更快、更准确。

把 AI 思考变成一次几何旅程

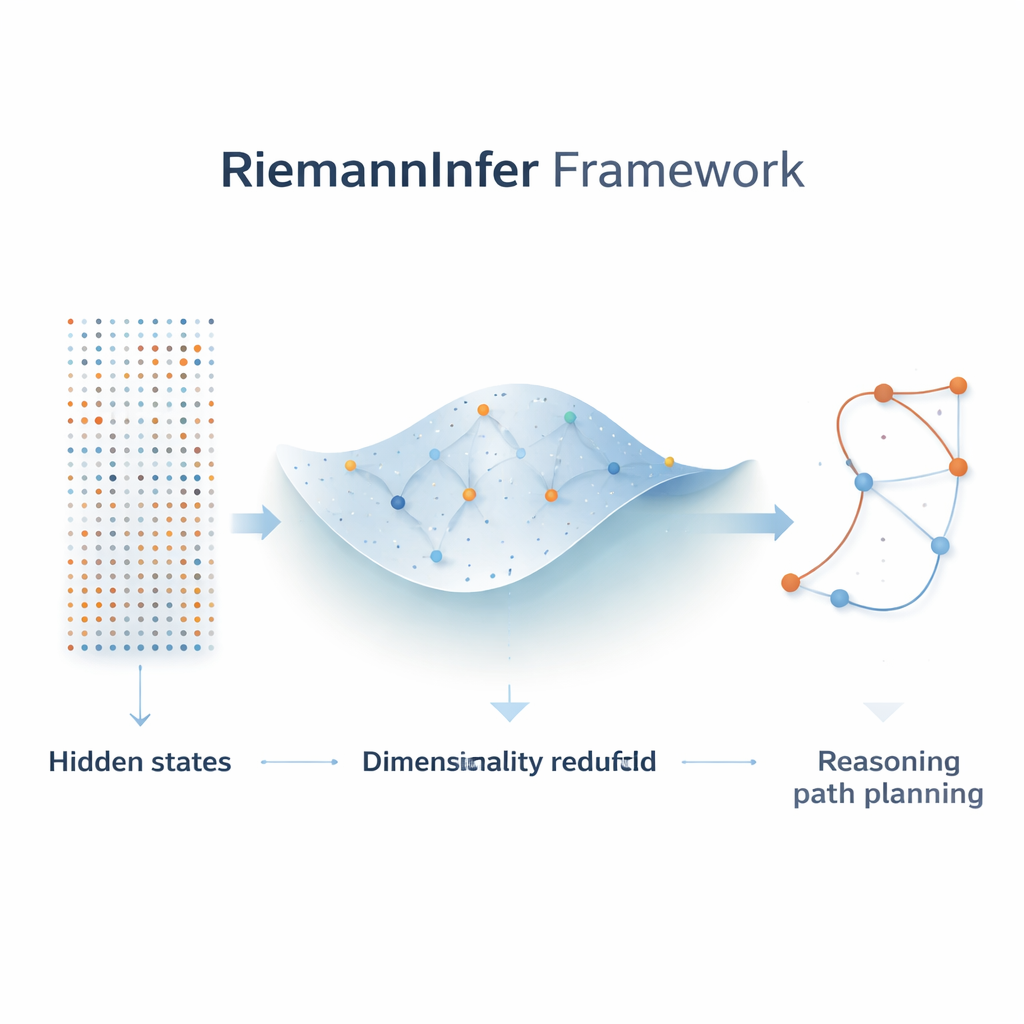

在如 GPT-4 或 Llama 之类的 LLM 内部,句子中的每个词由高维向量表示,多层“注意力”决定词与词之间的相互影响强度。作者观察到,这些隐藏状态可以被视为位于一个庞大空间中的点,而该空间的整体形状编码了模型对语言的理解。他们不再把推理当作一系列文本上的概率计算,而是将其重新解释为寻找路径的问题:模型在这个空间中从初始状态(问题)沿着一条路线移动到最终状态(答案)。利用黎曼几何——研究弯曲表面的数学工具,他们构建了一个捕捉注意力模式如何弯曲和拉伸内部景观的曲面流形。

在不丢失全貌的前提下压缩复杂性

由于 LLM 的原始内部空间极为庞大,RiemannInfer 的第一步是缩减该空间,同时保留其基本结构。作者将研究点如何连接的拓扑学技术与一种流行的降维算法 UMAP 结合。在降低维度之前,他们分析隐藏状态点云的“形状”,以确保关键连通性模式在压缩后仍然保留。结果是一个低维空间,其中 token 之间的重要关系——例如哪些词彼此高度关注——在很大程度上被保存。这个紧凑的几何地图使得对距离、最短路径和曲率等进行精确计算成为可能。

从注意力构建弯曲地图

核心创新是将注意力权重转化为一种几何上的距离度量。当模型在两个 token 之间给出强注意力时,RiemannInfer 将它们视为在流形上彼此靠近;弱注意力则将它们置于更远的位置。基于这些关系,作者定义了度量——决定长度与角度的数学规则——并用它来计算测地线(弯曲空间中的“直线”)以及曲率(衡量空间弯曲程度)。多头注意力自然成为多种度量的混合体,每种度量捕捉语言结构的不同方面,比如语法或语义。通过这种构造,模型的决策可以解释为在一个峰谷反映信息密度或稀疏性的景观中选择特定路径。

规划低消耗的推理路径

一旦构建了流形,作者把推理重新表述为寻找从问题到答案的一条“轻松”路径——即最小化沿途总工作量的路径。他们借用了登山的类比:攀登陡峭、崎岖的路线比沿着更平缓的山脊到达同一峰顶需要更多能量。在 LLM 场景中,曲率扮演了陡峭程度的角色,模型的推理工作对应于沿路径内部不确定性被减少的量。结合测地线和曲率的近似公式与高效的图搜索算法(如 Dijkstra 算法),RiemannInfer 能快速识别出最小化该工作量的路线,有效地引导模型朝着更高效的思维链条前进。

在真实模型上的实验结果

作者在多种最先进的 LLM 上测试了 RiemannInfer,包括 GPT‑4o、Llama‑3‑405B 和 DeepSeek‑V2‑400B,使用了如 GSM8K、MATH500、StrategyQA 和 AGIEval 等要求严格的数学与推理基准。无一例外,将这些模型与 RiemannInfer 框架结合后,其准确率提高了几个百分点——在性能前沿虽是小幅度却具有意义——同时保持或略微提升了速度。与一种更简单的纯线性方法的比较显示,忽视隐藏状态的曲率几何会严重损害性能,强调了流形视角的重要性。

总体意义:赋予 AI 推理物理感受

对于非专业读者而言,关键结论是作者把大型语言模型的晦涩内部机制变得更可感知:把良好推理比作沿着平滑、低消耗的路径穿越一片弯曲的地形。通过把注意力模式和推理步骤落到几何与物理概念上——距离、曲率与功——RiemannInfer 提供了既能改进实际结果又能作为概念桥梁的框架,把 AI 与连续空间的物理学联系起来。尽管当前方法仍是近似的,许多细节有待完善,这一框架指向了未来可以用几何与物理语言来分析、优化乃至设计 AI 思维过程的方向。

引用: Mao, R., Zhang, Z., Yang, M. et al. RiemannInfer: improving transformer inference through Riemannian geometry. Sci Rep 16, 6636 (2026). https://doi.org/10.1038/s41598-026-37328-x

关键词: 大型语言模型, 几何深度学习, 黎曼流形, 注意力机制, 推理效率