Clear Sky Science · zh

针对量子抗性与零信任的AI安全的范畴框架

为什么保护 AI 需要一种新型“锁”

随着人工智能进入医院、工厂和家庭,驱动这些系统的模型正成为黑客的重要攻击目标。同时,未来的量子计算机威胁着许多当前用于保护数据的加密方案。本文提出了一种新的保护 AI 模型的方法,旨在同时抵抗巧妙的人为攻击者和未来的量子设备,并能在体积小、成本低的设备上运行。

围绕 AI 构建“永不信任”的堡垒

作者从一种称为“零信任”的安全理念出发。零信任并不假定公司网络内部的任何事物都是安全的,而是将每一次访问尝试都视为可疑。在所提出的设计中,外部客户端必须先通过基于 ESP32 的代理,然后通过基于 ESP32 的安全代理才能到达受保护的本地网络上的 AI 模型。每个请求都会核查请求者是谁、想要哪个模型、何时请求以及来自何处。访问权限是狭窄的、时限性的,并与特定角色绑定,因此即使系统某一部分被攻破,攻击者也无法自由横向移动到其他模型或数据。

能在量子计算机面前存活的“锁”

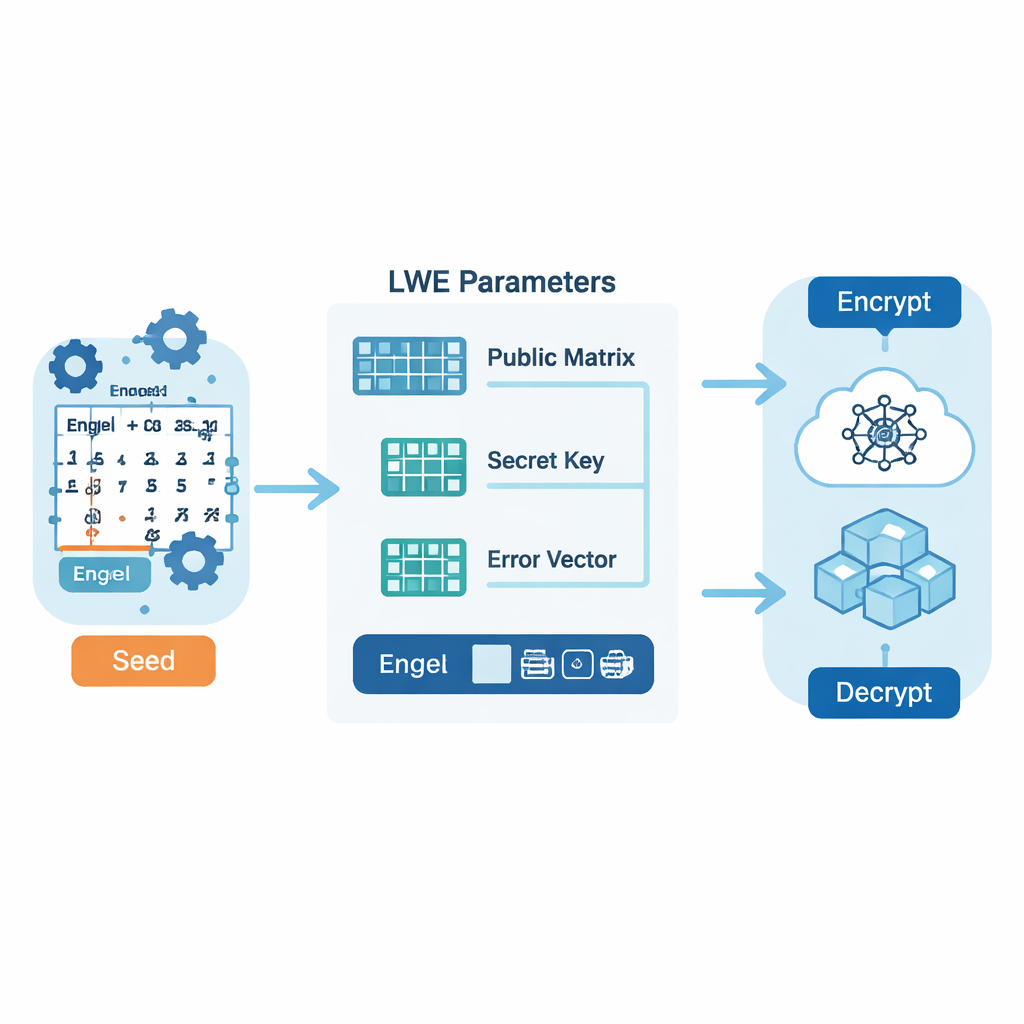

为了保护通过该零信任网关传输的消息,系统依赖于一类称为基于格的后量子密码学的技术。与当今熟悉的数论难题不同,这些方案将信息隐藏在高维数值格中,人们认为即便对量子机器来说也很难破解。该工作的一项关键技术转折是作者如何生成驱动加密的“看似随机”的数值。他们不是使用传统的随机数生成器,而是从一个秘密实数开始,使用称为 Engel 展开的方法将其扩展为长的数位序列,然后用混沌映射进一步搅拌。这产生了一连串既结构化以便高效存储和重现、又足够不可预测以抵御已知攻击的值。

将深奥的数学变成安全蓝图

该框架的独特之处在于作者采用了称为范畴论的数学分支来描述整个安全工作流。范畴论不侧重于底层代码,而是将每个密码操作——例如密钥生成、加密或随机序列的重排——视为抽象对象之间的一种箭头,并将安全策略看作这些箭头之间的更高级映射。通过这种组织方式,作者可以将重要保证(例如“先加密后解密会还原原始消息”,或“改变某个参数不会悄然削弱安全性”)表达为简单的图示规则。这提供了一份严谨的核对清单,有助于确保在替换或升级组件时设计仍然健全。

让强安全在微小硬件上可行

除了理论,论文还报告了在低成本 ESP32 微控制器上对代理和安全代理的完整实现,这些设备位于 AI 服务之前。尽管执行了量子抗性加密,这些设备仍保持高效:加密约需 11 毫秒,解密不到 3 毫秒,内存使用在加密操作后仍留有超过 90% 的空闲堆。功耗测量显示一个大约 300 毫瓦的稳定基线,在进行密格计算密集时会短暂峰值至 500 毫瓦以下,适合电池供电的传感器。在测试中,该系统阻止了超过 1,000 次未授权访问中的 100%,且总体对 AI 响应时间的增加不到一秒,其中大部分时间花在模型自身而非加密上。

为将来升级做好准备而不破坏安全性

相同的数学框架还支持“密码灵活性”(crypto‑agility):能够用另一个密码构件替换现有构件——例如将今日的基于格方案替换为未来标准——而无需从头重新设计系统。在范畴视角下,每个密码算法都是可插拔的模块,模块之间的安全转换表现为保存机密性和完整性等安全目标的结构化映射。这减少了必须更改的代码量以及在新后量子标准或硬件优化到来时所需的重新测试量。

这对普通用户意味着什么

对于非专业人士而言,实用的信息是:面向未来且强健的 AI 安全不必只限于大型数据中心。通过结合零信任检查、量子抗性数学以及关于各部分如何配合的严密推理,作者表明即使体积小、成本低的芯片也能成为强大 AI 模型的可信守门人。他们的原型拒绝了所有未授权请求、保持延迟低,并且能够随着密码学最佳实践的变化而演进。如果被广泛采用,这类方法可以帮助确保人们依赖的 AI 服务——从智能农业到医疗监测——即使在攻击者和计算技术变得更复杂时仍能保持安全。

引用: Cherkaoui, I., Clarke, C., Horgan, J. et al. Categorical framework for quantum-resistant zero-trust AI security. Sci Rep 16, 7030 (2026). https://doi.org/10.1038/s41598-026-37190-x

关键词: 后量子密码学, 零信任架构, AI 模型安全, 基于格的加密, 嵌入式物联网安全