Clear Sky Science · zh

通过 PPO 与 GAN 生成的对抗性攻击评估步态系统脆弱性

为何欺骗行走模式至关重要

我们大多数人即使在远处也能凭借走路的方式认出亲友。计算机现在也能做类似的事情:所谓“步态识别”系统分析一个人的行走风格,在无需指纹或面部扫描的情况下识别身份。这些工具在安防和监控中使用日益广泛。本研究提出了一个令人不安的问题:利用人类难以察觉但机器会响应的细微、精心设计的改动,欺骗此类系统有多容易?答案对隐私、安全以及我们在关键场景中对人工智能的信任程度具有重大影响。

计算机如何读取我们的步态

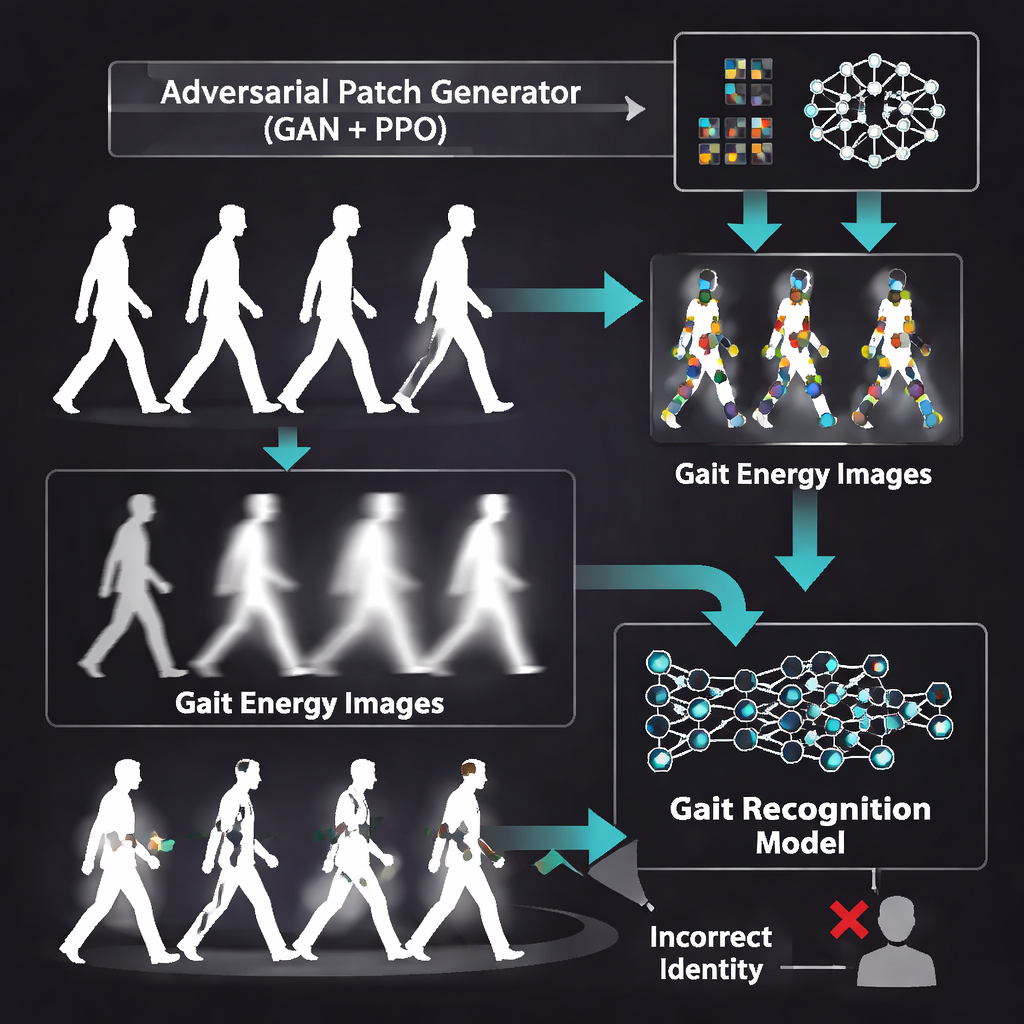

现代步态识别依赖于深度学习,与面部识别和自动驾驶使用的是同一类技术。与观察单幅静止图像不同,这些系统将行走者的多帧图像合成为一张“步态能量图”(gait energy image),这是一种模糊的轮廓图,捕捉了完整步伐周期中身体部位的移动。定制的神经网络接着学习区分不同人的步态,即便服装或携带物品发生变化。在对两套主要研究行走视频集(CASIA-B 和 OU-ISIR 数据集)的测试中,作者的基线模型在超过 97% 的情况下正确识别出人员——这一强劲表现可能暗示该技术已接近实际部署的水平。

能欺骗智能摄像头的无形贴片

论文的核心不是构建更强的识别系统,而是有意破解它以揭示弱点。研究人员生成了小型“对抗性贴片”——方形的像素区域,外观看似无害,但在数学上被精心调整以混淆神经网络。为了创建这些贴片,他们使用了生成对抗网络(GAN),这是一类通过与内部判别器对抗而学会生成逼真图像的人工智能。GAN 直接在步态能量图上训练,使其输出自然融入那种幽灵般的轮廓之中。这些贴片被设计得足够微妙,以至于人眼快速浏览行走图像时通常不会注意到异常。

让学习代理发现薄弱环节

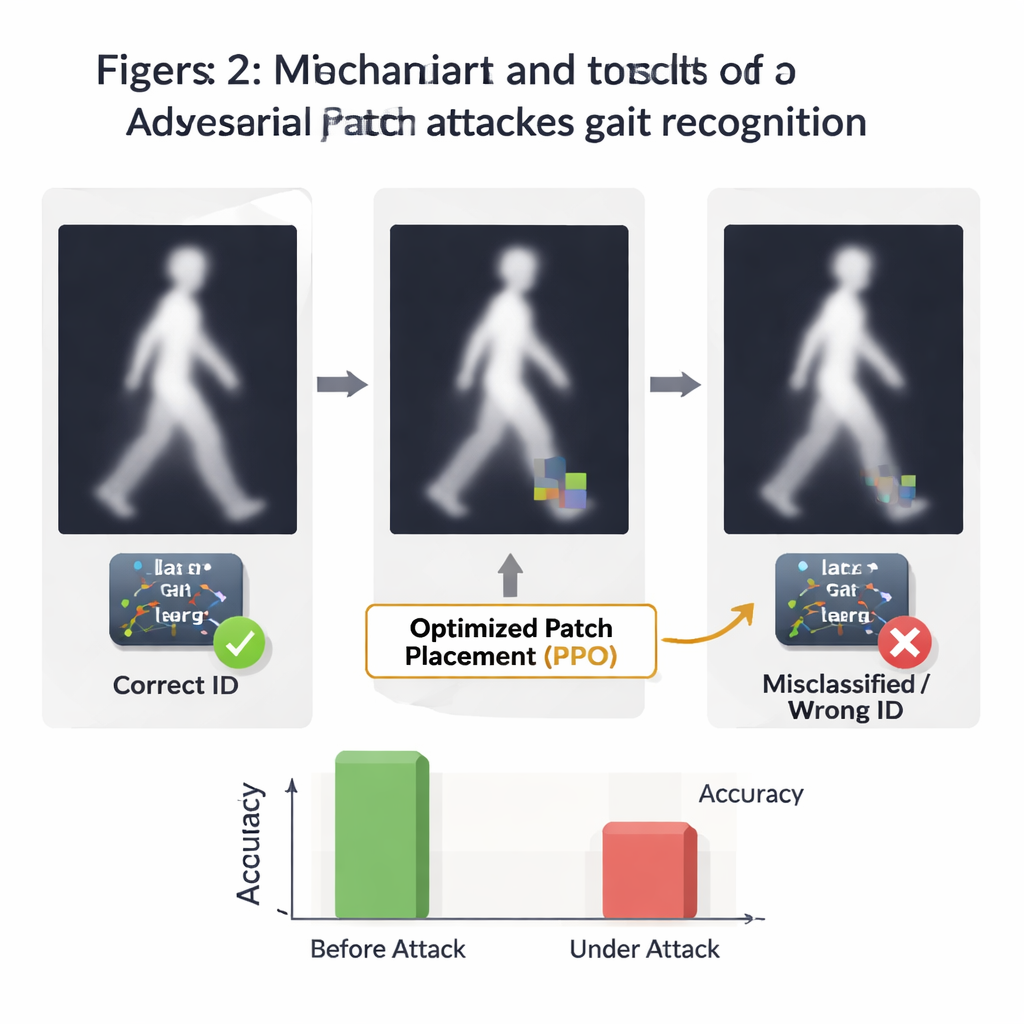

贴片放置的位置可能与其外观同样重要。为发现最具破坏力的位置,作者采用了一种名为 Proximal Policy Optimization(PPO)的强化学习方法。他们将每张步态图像视为网格状环境,让软件“代理”移动贴片——上、下、左或右——同时观察识别系统置信度下降的幅度。当某个位置导致模型误识别该人时,代理会获得奖励;失败则会被惩罚。经过多次试验后,代理学会了一种将贴片放置在步态图像中特别脆弱区域的策略,通常靠近模型最依赖的运动部位。

发动攻击时会发生什么

在同时训练了贴片生成器与放置策略后,团队对他们自身性能优异的步态识别器发起攻击。在正常条件下,该系统表现出优异的准确率、低误报率以及正确与错误匹配之间的强烈区分。一旦加入对抗性贴片,性能便急剧下滑。根据贴片在图像中允许移动的范围和激进程度,攻击成功率可超过 60%,正确识别的人数比例可能降至原来的近三分之一。曾经显示接近完美区分真用户与冒名者的曲线向随机猜测的基线倾斜,揭示了模型在没有明显可见畸变的情况下也能被轻易扰乱的脆弱性。

这对日常安全意味着什么

对非专业读者而言,结论很明确:在实验室中看似高度准确的步态识别系统,在面对机设计的巧妙篡改时可能出人意料地脆弱。研究表明,将生成图像工具与试错式学习相结合,可以产生微小、几乎不可见的改动,从而造成严重的识别错误。该工作并非为现实世界滥用提供蓝图,而是作为警示和测试框架。它为系统设计者提供了一种探测和衡量其模型脆弱性的方法,并强调在将步态识别广泛用于监控、门禁或其他关键应用之前,必须构建对抗此类攻击的防御措施。

引用: Saoudi, E.M., Jaafari, J. & Jai Andaloussi, S. Evaluating gait system vulnerabilities through PPO and GAN-generated adversarial attacks. Sci Rep 16, 6039 (2026). https://doi.org/10.1038/s41598-026-37011-1

关键词: 步态识别, 生物特征安全, 对抗性攻击, 深度学习, 强化学习