Clear Sky Science · zh

使用视觉变换器与时空学习进行实时火焰与烟雾检测

为何更快的火灾警报至关重要

家庭、工厂和森林中的火情可能在几分钟内变得致命。如今,许多报警器仍依赖于只有在明火充分形成后才会触发的热量或烟雾传感器。本文介绍了一种新的计算机视觉系统,能够几乎即时地在摄像头画面中识别出火焰和烟雾的迹象,即便在低光或浓雾等具有挑战性的条件下也能工作。研究人员将多种先进的人工智能技术整合到单一模型中,旨在为消防员、城市规划者和环境机构提供更早的预警——有可能挽救生命、财产和生态系统。

检测火焰的日益挑战

现代城市与森林越来越多地由摄像头监控,但要教会计算机可靠地识别图像和视频中的火焰与烟雾并不容易。传统方法使用在静态图像或短片上表现良好的神经网络,然而它们常在复杂的真实场景中遇到困难。一张快照可能显示出看似烟雾的东西,但实际上只是雾气或尾气。以视频为中心的系统能够追踪形态随时间的变化,但往往运行缓慢且对硬件要求高。因此,早期模型经常发出误报或错过细微、快速变化的危险信号——尤其在光线不佳、烟雾密集或背景杂乱时。

用于图像与视频的混合型AI“观察者”

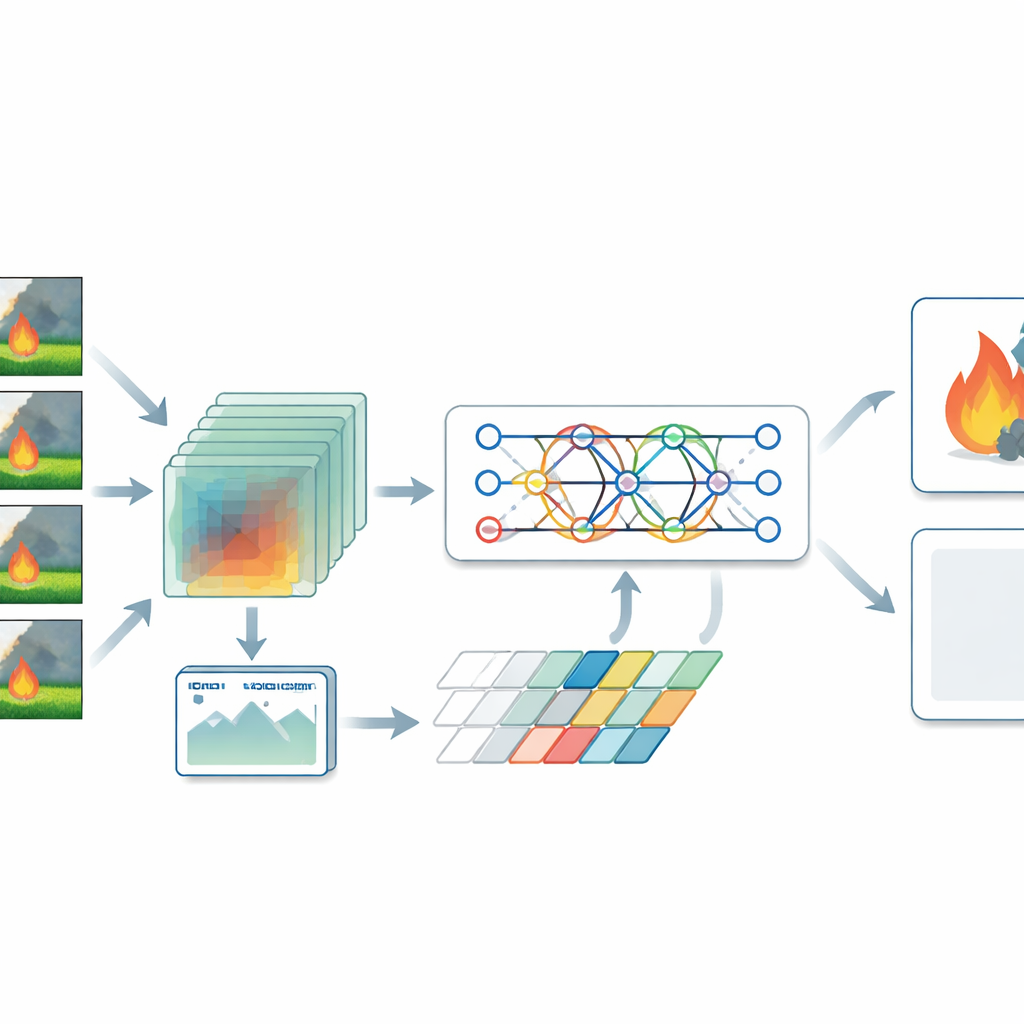

作者提出了一种将火灾检测视为空间和时间问题的混合模型。针对静态图像,他们使用了一类称为视觉变换器的神经网络,将图像视为若干补丁并学习远处区域之间的关联。这有助于识别广泛的模式,例如烟雾在山谷中蔓延的细丝或森林中分散的火焰。对于视频,系统依赖三维卷积网络同时处理帧堆栈,捕捉烟火随时间变化的动态。随后,一个变换器编码器审视这些变化模式,重点关注最可能表明危险的时刻和区域,而不是对每一帧给予同等权重。

融合线索与平衡数据

系统的关键步骤是一个融合层,将静态图像的细节线索与来自视频的运动模式混合。通过结合这些互补视角,模型能够更好地区分真实火情与日落眩光、雾或云层等无害的相似现象。研究人员还注意到,许多公开数据集中的火灾样本远多于非火灾样本,这会导致模型倾向于过度报告火情。为应对这一问题,他们通过精心的数据增强生成了各种现实的非火场景——调整亮度、裁切与翻转图像,并模拟雾蒙蒙的清晨或昏暗室内等情形。随后,他们使用一种在火灾与非火灾错误上明确平衡的损失函数来训练模型,从而提升了日常使用中的可靠性。

将系统付诸测试

为评估方法的效果,作者在两个广泛使用的数据集上进行了测试:一个来自NASA Space Apps Challenge、近一千张的静态图像集,另一个来自Kaggle的与火情相关的视频集。在预处理与样本平衡之后,他们将混合模型与众所周知的基线模型并列训练和评估,例如ResNet、VGG、LSTM、纯3D卷积网络以及这些传统方法的若干混合组合。新系统在NASA图像上的准确率约为99.2%,在视频数据集上为98.3%,明显优于通常在中80%到中90%区间的传统模型。它的运行速度也足够快——每帧仅数十毫秒,并且模型体积适中,适合部署在诸如小型GPU和嵌入式板等边缘设备上。

这对日常安全意味着什么

用通俗的话说,这项研究表明,经过精心设计的人工智能可以实时监视摄像头画面,并可靠地回答一个简单而关键的问题:“此刻这里是否有火或危险的烟雾?”通过结合广泛的视觉上下文、随时间的运动信息以及对最有指示性的细节的智能关注,混合模型大幅减少了漏报与误报。随着进一步的调优并接触更多样化的场景——例如密集城市、地下空间和极端天气——它有望成为更智能警报系统、野火监测网络和工业安全工具的实用核心,比许多现有解决方案作出更快、更准确的反应。

引用: Lilhore, U.K., Sharma, Y.K., Venkatachari, K. et al. Real time fire and smoke detection using vision transformers and spatiotemporal learning. Sci Rep 16, 8928 (2026). https://doi.org/10.1038/s41598-026-36687-9

关键词: 火灾检测, 烟雾检测, 计算机视觉, 变换器模型, 实时监测