Clear Sky Science · zh

用于细粒度情感分析的多关系双注意力图变换器的科学报告

为何评论中的微小线索至关重要

在线评论常常包含复杂的混合情感:一家餐厅可能“食物很棒但服务很慢”,一部手机可能“屏幕很漂亮但电池续航很差”。企业和研究者希望计算机能理解这类细节化的意见,而不仅仅判断整篇评论是正面还是负面。本文提出了一种新的人工智能模型,能够聚焦句子中特定部分——例如“服务”或“电池寿命”——并精确识别人们对每个方面的情感,即便这些线索分散且微妙。

超越一刀切的情感判断

传统情感分析把句子或评论当作一个整体文本块,判断其总体是正面还是负面。这对简单评论有效,但当人们在同一句话里一边称赞一边批评时就会失败。基于方面的情感分析领域关注的是:针对每个具体目标(例如餐评中的“服务”、“环境”或“员工”),情感如何。早期方法依赖人工规则或简单的机器学习统计词频,随后发展为按序列读取文本的神经网络模型(如从左到右的阅读方式)。这些序列模型提高了准确率,但在捕捉长距离关联和微妙信号方面仍然不足,尤其是在重要词语相距较远或被“但”“尽管”等转折词连接时。

将句子变成连通地图

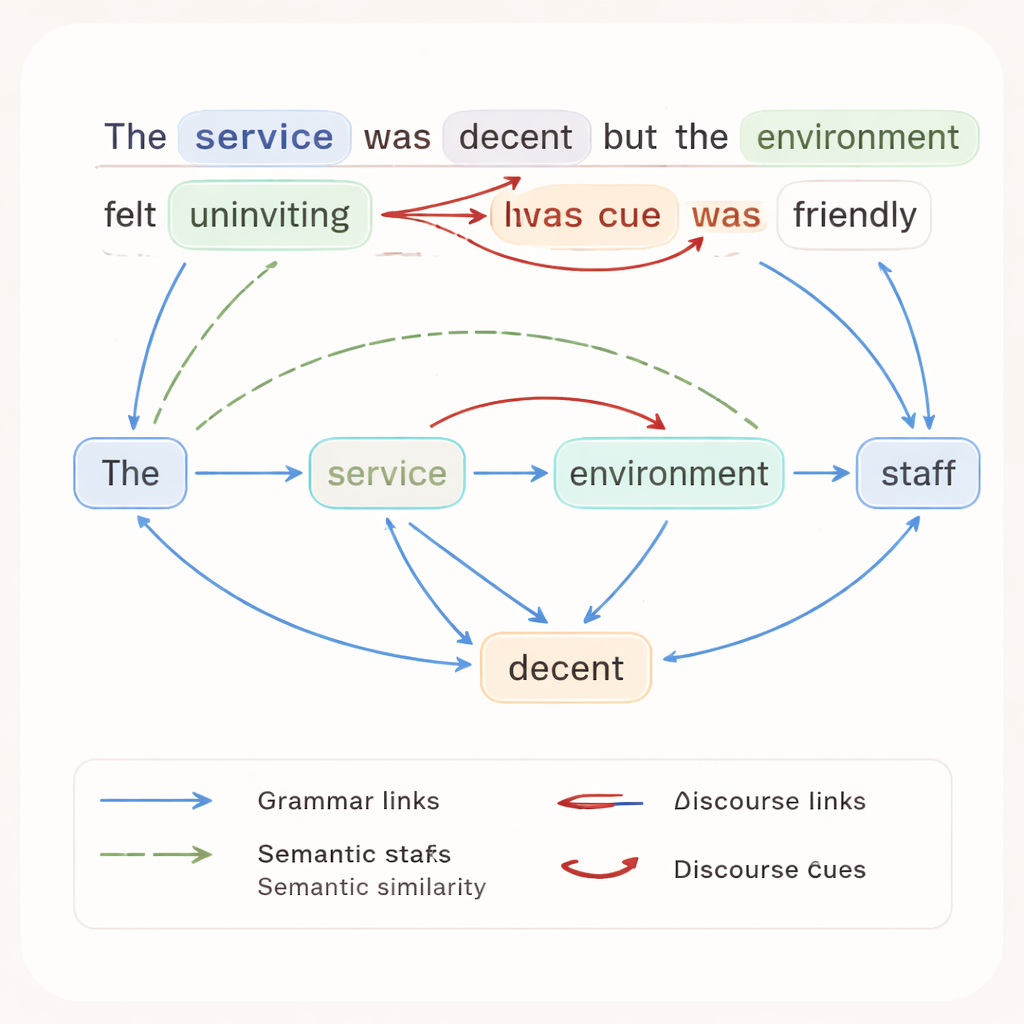

作者主张,要真正理解细粒度意见,计算机应把句子看作网络而不是直线。在他们的方法中,每个词成为图中的一个节点,不同类型的关系成为边。一类边表示语法关系,例如哪个词是主语或宾语;另一类边连接语义相近的词,即便它们不相邻;第三类标记话语线索——像“但”“然而”“尽管”这样的词通常标示情感的转折。在句子“The service was decent but the environment felt uninviting although the staff was friendly”中,这个图展示了对不同方面的赞扬与批评如何交织在一起。

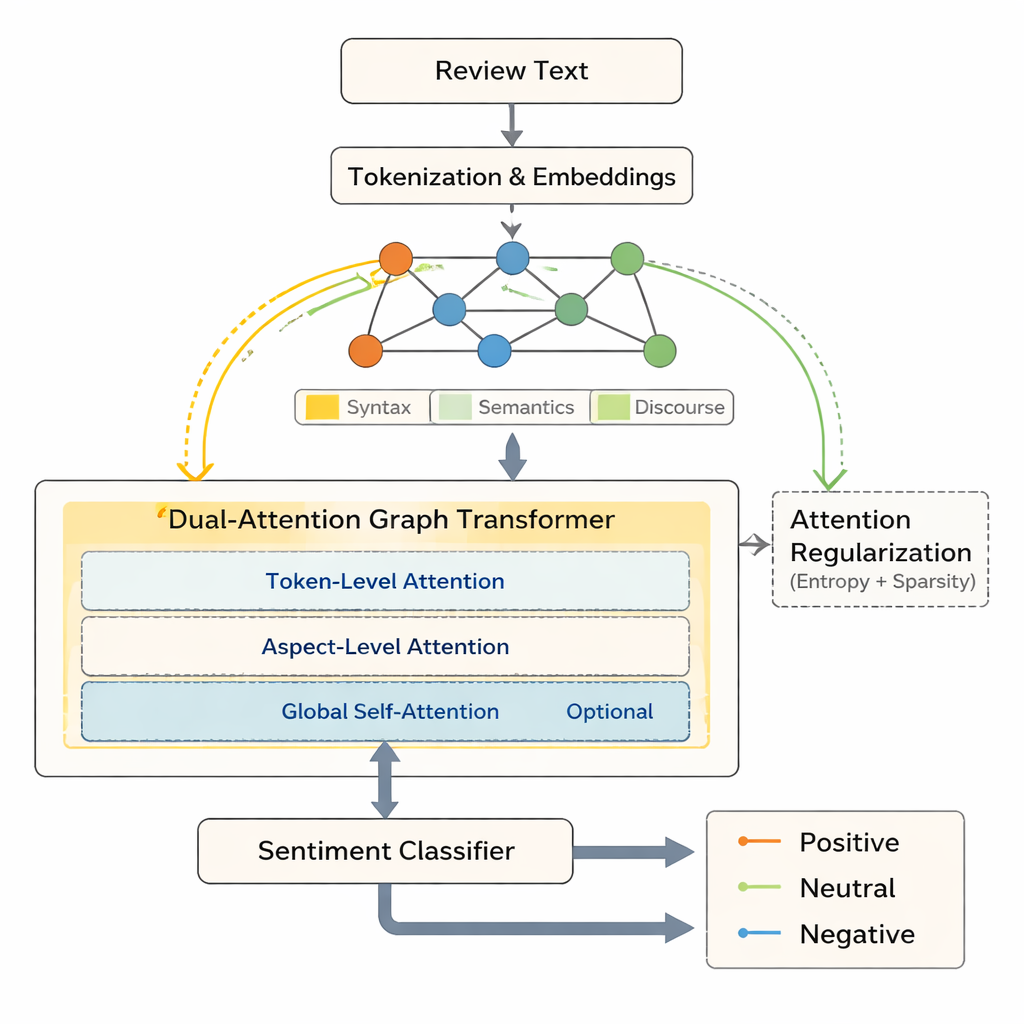

对上下文和目标的双重聚光

基于这种图视角,本文提出了多关系双注意力图变换器(Multi-Relational Dual-Attention Graph Transformer,MRDAGT)。该模型采用适配于图结构的变换器风格注意力机制。一个注意力头广泛关注句子中所有词之间的关系,收集有用的局部上下文;另一个注意力头专门聚焦于所考察的方面——例如“服务”或“环境”——并提升那些影响该目标情感的词的权重,如“体面”或“不吸引人”。当一句话中存在多个方面时,可选的全局注意力层帮助模型衡量它们之间的互动。实际上,系统发出两束协调的聚光灯:一束照亮整体句子结构,一束直接聚焦于要判断情感的方面。

让机器注意力更具选择性和可解释性

现代人工智能的一大问题是注意力权重可能过于分散,使决策难以解释。MRDAGT通过两种正则化手段来应对这一点。熵惩罚抑制过于平坦的注意力,促使模型更集中地关注少数重要词;同时,L1稀疏项将许多注意力连接压向零,剔除弱且嘈杂的联系。两者共同产生“聚焦稀疏性”:模型倾向于在真正相关的词—方面对上赋予清晰且较高的权重,同时忽略干扰。对三个基准数据集(正式的笔记本评论、复杂的多句评论和非正式的推特帖子)上的实验表明,MRDAGT在准确率上通常优于已有强方法约一到两个百分点,并且产生更清晰、更易解释的注意力图。

对实际观点挖掘的意义

对非专业读者而言,结论是该模型为从混乱的真实文本中挖掘意见提供了更精确、更可信的手段。与其只说一条评论“总体上偏正面”,MRDAGT可以分别报告顾客喜欢设备的运行速度但不满意电池,或食客赞赏咖啡馆的员工却抱怨噪音。由于其注意力模式与人类直觉一致——关注转折词、情感形容词和方面词——分析师更容易看出模型为何做出特定判断。作者提出,这一方法可以支持更好的产品设计决策、更精细的社交媒体监测,并可扩展到多种语言乃至包含音频和图像的多模态数据,同时保持较为透明的推理过程。

引用: Anilkumar, A.P., Kim, SK. & Yoon, YC. Scientific reports multi relational dual attention graph transformer for fine grained sentiment analysis. Sci Rep 16, 7236 (2026). https://doi.org/10.1038/s41598-026-36490-6

关键词: 基于方面的情感分析, 图神经网络, 变换器注意力, 观点挖掘, 自然语言处理