Clear Sky Science · zh

结合 ALBERT 驱动上下文与 EHO 优化架构的深度情感模型

为什么更聪明的情感阅读很重要

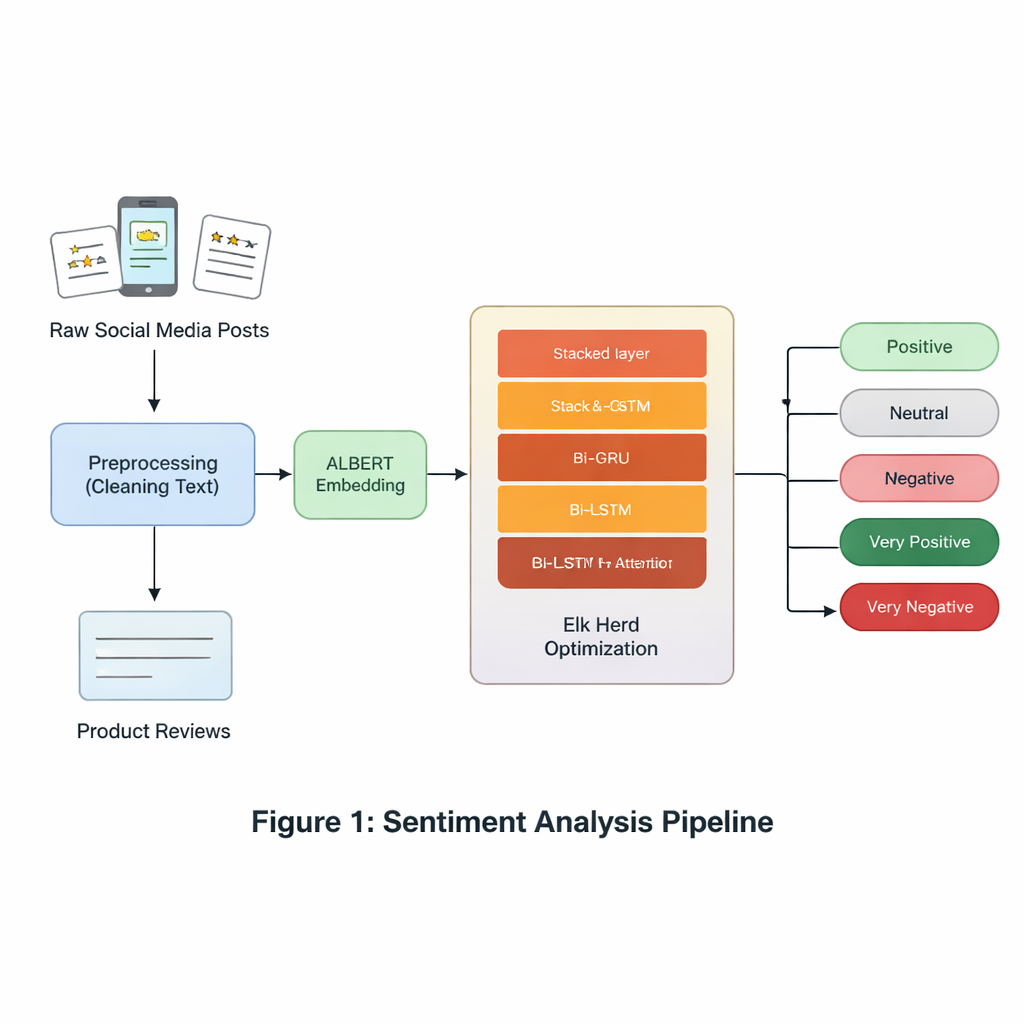

每天都有数百万人在互联网上分享关于产品、服务、政治和事件的观点。将这股文本洪流转化为可靠的洞见,对企业、政府和研究者都至关重要。然而我们的在线语言十分混乱:讽刺性笑话、俚语、拼写错误和罕见情绪常常让计算机困惑。本文提出了一种新的情感分析系统,旨在更准确地读出这些情绪,同时比许多现有人工智能模型使用更少的计算资源。

从简单词频到具上下文感知的阅读

早期的情感分析工具把文本当作一袋无关的词,统计“好”或“糟糕”等词出现的频率。这种方法忽略了词序和微妙的上下文,例如“not bad”更接近“相当不错”。深度学习方法通过把文本作为序列来处理有所改进,但通常需要大量带标签的数据和高强度计算。像 BERT 这样的 Transformer 模型进一步提高了准确性,但其庞大体量使得在客户服务平台或社交媒体监控系统等现实场景中运行代价高昂。本文作者通过将若干更轻量但强大的组件组合成一个精简系统来应对这一挑战。

更精简的大脑来理解文本

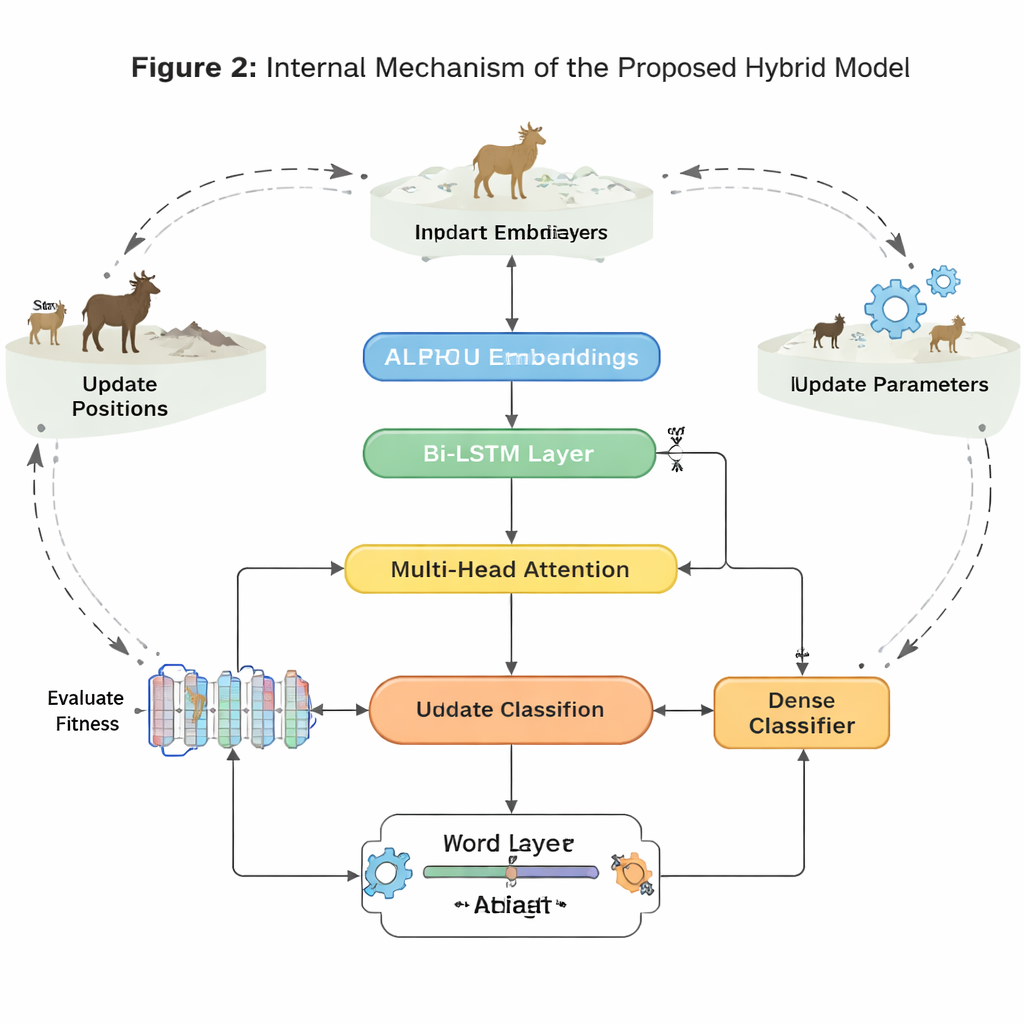

模型的核心是 ALBERT——BERT 的一个紧凑版本。ALBERT 将句子中的每个词转化为具有上下文感知的数值表示,捕捉到词义如何随着邻近词而变化。与大型模型不同,ALBERT 通过层间参数共享和词汇表压缩来降低内存使用。这使得在标准硬件上运行变得更容易,同时不会牺牲过多理解能力。这些基于 ALBERT 的词表示成为后续一系列专门层的输入,这些层侧重于情感在句子中如何展开。

让两种记忆系统协同工作

为了跟踪意义如何随词序变化,系统使用了两种循环网络:GRU(门控循环单元)和 LSTM(长短期记忆单元),且二者均采用前向与后向双向运行。GRU 在以较少参数跟踪短语时效率更高,而 LSTM 在记忆较长文本跨度的信息时表现更好。通过在双向 LSTM 层之上堆叠双向 GRU 层并加入注意力机制,模型能够突出句子中最具情感权重的部分——例如在一条总体积极的评论中出现的“除了电池续航”这一短语。该混合设计旨在同时捕获语气的快速变化和可能改变整体情感的长程上下文。

受自然启发的调优以应对难题

在架构之外,作者还解决了一个关键的现实问题:情感数据集通常是不平衡且含噪的。厌恶或惊讶等情绪以及中性陈述出现得比明显的正负情绪少,导致许多模型忽视它们。为了解决这一点,论文采用了 Elk Herd Optimization(麋鹿群优化),这是一种基于麋鹿移动、竞争和群体形成行为的自然启发搜索策略。在神经网络生成内部情感向量之后,该优化步骤通过迭代改进“适应度”分数来微调这些向量对各类别的表示,尤其是对稀有类别的表示。该过程有助于模型避免浅层解并提升其区分微妙或代表性不足情绪的能力。

将模型付诸测试

作者在六个广泛使用的数据集上评估了他们的系统,包括推特帖子、餐馆和笔记本电脑评论,以及一个将非常正面与非常负面意见与更中等观点区分开的五级影评基准。在这些不同来源上,新方法在准确率和 F1 分数(一种平衡正确命中与漏判的指标)方面持续优于若干先进的图模型和基于变换器的对手。五分类影评任务和代表性不足的情感类别上收益尤为显著,表明该方法既能处理细粒度情绪,也能应对数据倾斜。消融研究——逐一移除组件——证实了 ALBERT、GRU–LSTM 组合设计、注意力机制以及受麋鹿启发的优化各自对整体表现的贡献。

这对日常应用意味着什么

对非专业读者来说,关键结论是这项研究提供了一种更高效且更可靠的方法来解读大量在线观点。通过将紧凑的语言模型与互补的记忆层和一种生物启发的调优步骤结合,该系统能够更准确地读懂弦外之音,尤其是在情感微妙或数据偏斜时。这使其在现实应用中具有前景,例如跟踪客户满意度、监测公众健康态度或评估对政策和事件的反应,在这些场景中准确性和计算成本都很重要。

引用: Oqaibi, H., Sharma, S. A deep sentiment model combining ALBERT-driven context and EHO-optimized architecture. Sci Rep 16, 5784 (2026). https://doi.org/10.1038/s41598-026-36389-2

关键词: 情感分析, ALBERT, 深度学习, 文本分类, 元启发式优化