Clear Sky Science · zh

基于互信息的分层 NBV 决策用于动态环境下的主动语义视觉 SLAM

能未雨绸缪的机器人

随着机器人从工厂走入家庭、医院和办公场所,它们必须在充满人群和其他移动物体的环境中导航。本文提出了一种让机器人“未雨绸缪”的新方法,帮助其决定往哪看、如何移动,从而构建可靠的周围环境地图——即便这些环境不停移动也能应对。该工作对任何关注更安全的服务机器人、更聪明的送货机器人或未来需要与人共享空间(而非穿过空荡走廊)的家庭助手的人都具有意义。

为什么行走的人会让机器人困惑

为了自主移动,许多机器人使用一种叫视觉 SLAM 的技术,借助摄像头同时构建地图并估计自身位姿。在静态环境中这方法表现良好,但当有人经过、遮挡视野或携带物品时就很容易失效。一个常见的修正手段是使用“语义”视觉,使机器人能识别并在建图时忽略行人、车辆和椅子等物体。然而,这对主动选择路径的机器人会产生新问题:如果丢弃了太多视觉线索,机器人可能彻底丢失自身位置信息。摄像头视场有限使得问题更为严峻,因为一个近距离经过的人就能遮挡掉对机器人有用的大部分场景。

一个两层的选视策略

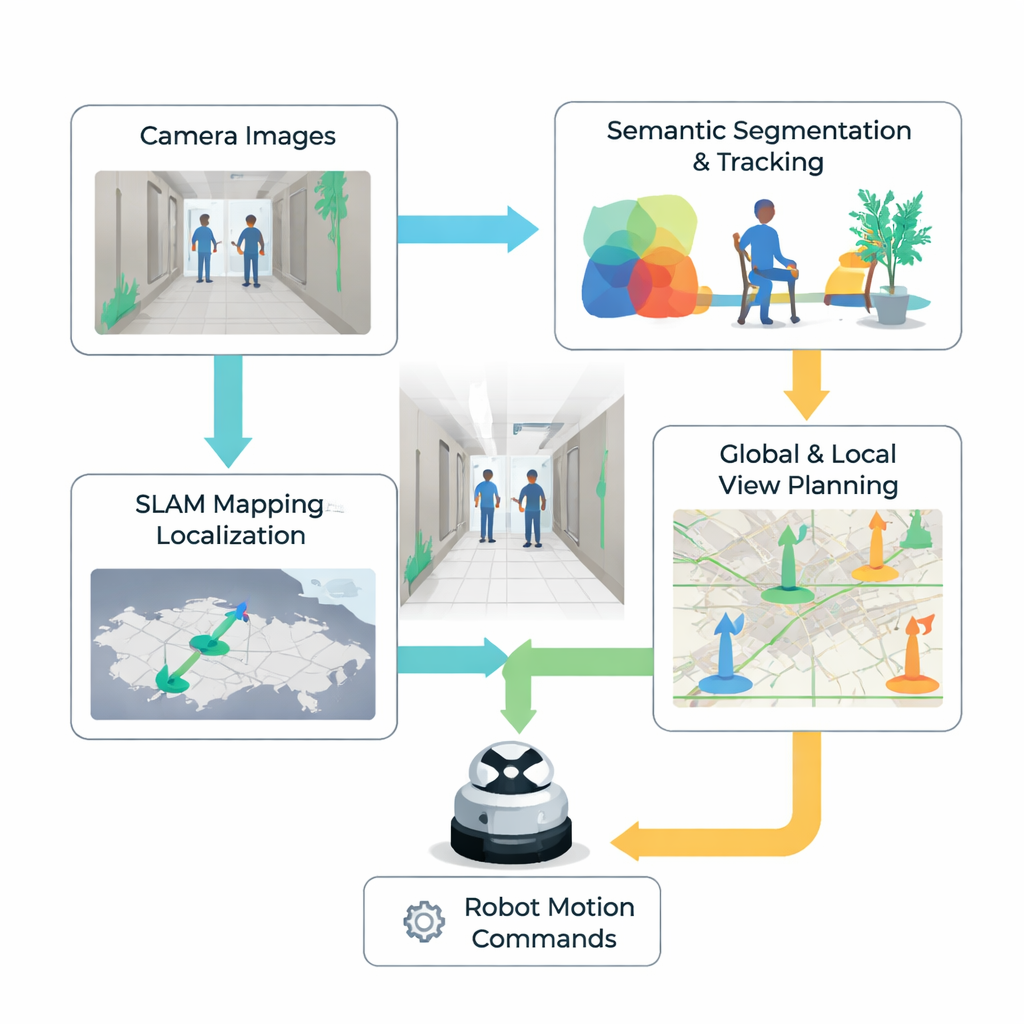

作者提出了一个分层决策系统,帮助机器人以更有信息量的方式决定下一个观测点。在高层,机器人维护一个俯视网格地图,标注空闲、占用和未知区域。它通过估计每个潜在远处观测点能减少多少地图不确定性来评估这些点,这一概念源自信息论。机器人偏好那些能揭示大块未探索区域的位置,同时也权衡需要行驶多远和转动摄像头的代价。一旦选择了有前景的区域,低层过程接管,对机器人在该邻域内应如何移动和朝向进行细化,以确保其窄视角摄像头能观察到足够有用的细节。

识别稳定特征并规避不稳定目标

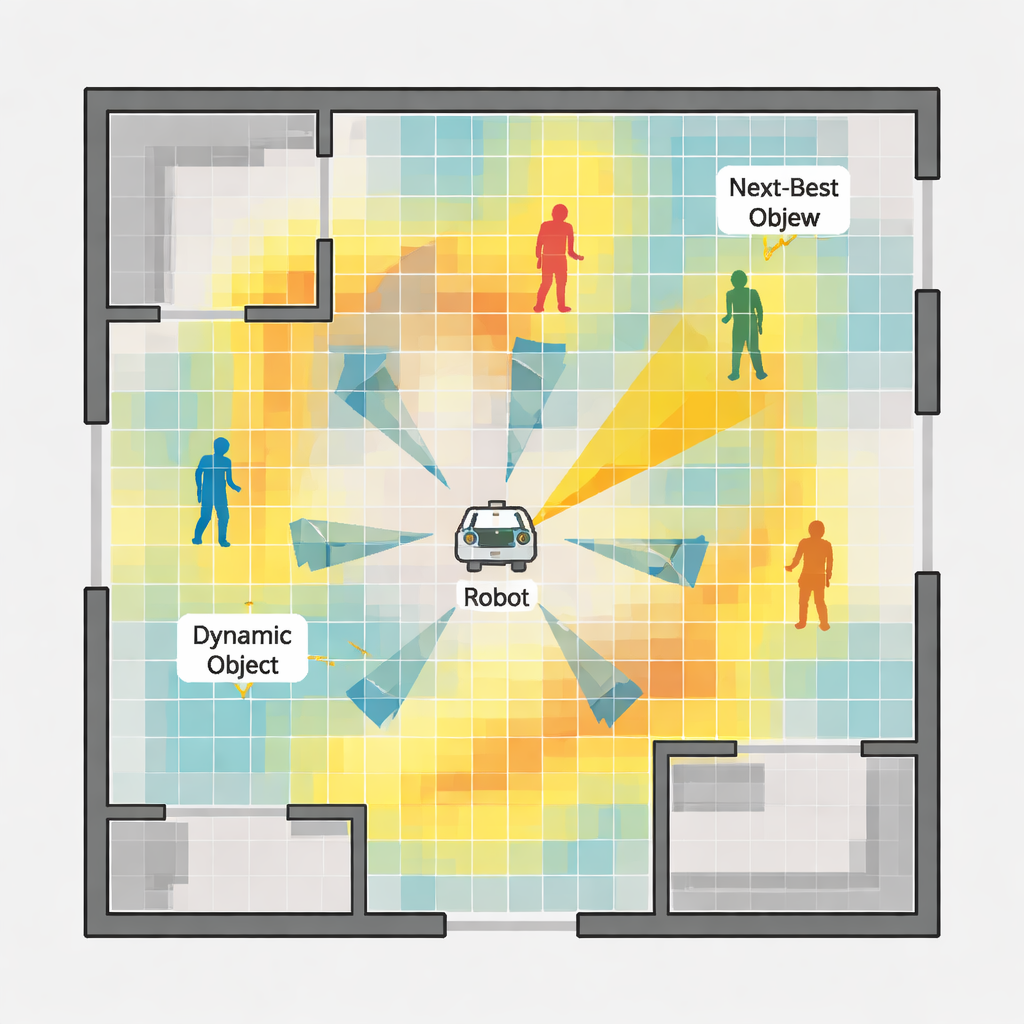

局部决策过程的核心是从每帧图像构建的“特征概率图”。系统首先检测视觉地标——场景中的角点和纹理模式,这些通常随时间稳定且有助于运动跟踪。随后使用现代目标检测器识别可能移动的物体(如行人),并在帧间对其进行跟踪。通过分析这些物体的运动,系统不仅估计它们当前的位置,还预测其短期内可能出现的位置。将这两类信息融合成图像上的一张热图:亮区表示有较高概率观测到可靠地标,暗区则标示特征稀少或可能被移动物体遮挡的地方。机器人据此判断哪种小幅动作——向左转、向右转或前进——将为其下一步提供最清晰且最稳定的视角。

在虚拟世界和现实中的测试

研究人员在两个不同规模与复杂度的模拟室内空间中进行了测试,每个场景中均有徘徊的虚拟行人,并随后在一台实际机器人上于真实室内环境中进行了验证。他们将该方法与几种主要旨在覆盖空间或缩短行程距离的既有探索策略进行了比较。在模拟中,新系统生成的地图畸变更少,在探索过程中定位精度更高且耗时大致相当或更少。它也更少出现定位丢失或与移动人员过于接近的情况。在真实世界实验中,该方法能在一台商用机器人计算机上实时运行,证明了其在实验室外部署的可行性。

对日常机器人的意义

通俗地说,这项工作教会机器人在人群周围更谨慎地选择观察和移动方向。通过结合场景理解、运动预测与信息增益度量,机器人可以朝向既信息丰富又更安全的视点移动,而不是简单地向最近的未探索角落前进。这使其内部地图更可靠、动作更可预测,而这些正是必须与人共用拥挤空间的机器人所需的关键要素。挑战仍然存在——例如突如其来的大量人群遮挡摄像头——但该方法标志着朝着能够优雅应对现实世界混乱与动态特性的家庭与服务机器人迈出了一步。

引用: Yang, Z., Sang, A.W.Y., Muthugala, M.A.V.J. et al. Mutual information-based hierarchical NBV decision for active semantic visual SLAM under dynamic environments. Sci Rep 16, 5847 (2026). https://doi.org/10.1038/s41598-026-36259-x

关键词: 主动 SLAM, 机器人导航, 动态环境, 语义建图, 下一最佳视角