Clear Sky Science · zh

用于航拍图像小目标检测的跨阶段边缘信息融合网络

为何从高空发现微小细节很重要

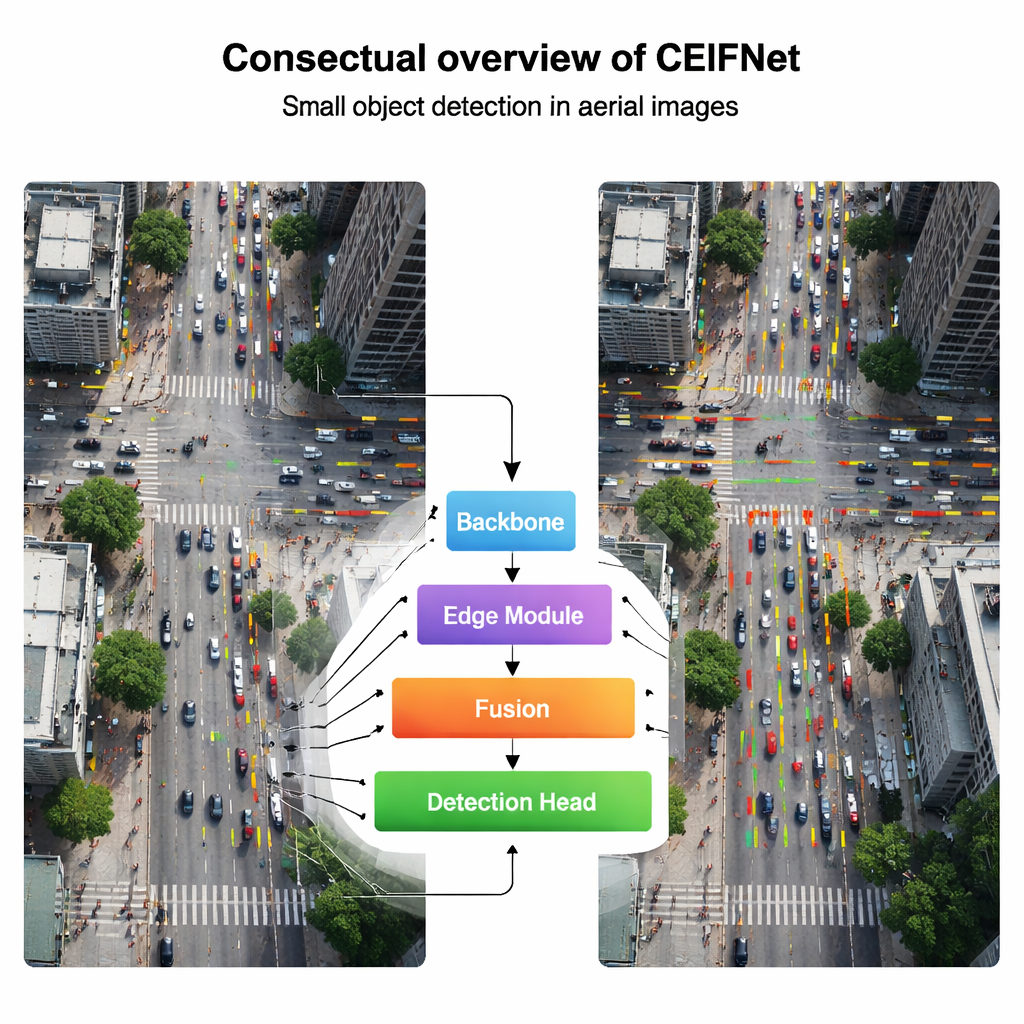

从交通监测和灾害响应到农作物管理,我们的世界越来越多地由无人机从空中监视。然而,在这些航拍图像中,我们最关心的许多目标——人员、车辆或动物——往往仅占几个像素宽。本文提出了一种新的计算机视觉系统 CEIFNet,专门用于更准确、更快速地发现这些微小目标,即便它们被纷繁的城市街道、田地或夜间噪声所包围。

在大画幅中看清小目标

传统的目标检测系统主要为地面照片设计,在那类图像中,车辆或行人通常占据画面中明显的一部分。然而在无人机影像中,相机可能位于数百米高处,每个目标都很微小,且在神经网络内部对图像进行缩减时很容易被模糊或丢失。作者解释说,像 YOLO 系列这样的单阶段检测器在日常场景表现良好,但当目标既很小又尺度差异大时会遇到困难。为理解整幅场景而反复下采样,往往会抹去这些小目标的微弱信号。

将特写视觉与大局语境融合

为了解决这一问题,CEIFNet 结合了两种互补的观察方式。一条路径采用经典卷积滤波器,擅长捕捉角点和纹理等清晰的局部模式;另一条路径采用类 Transformer 的注意力机制,善于关联图像中相距较远的部分并理解整体场景。在称为跨阶段变换器块的核心构建单元中,输入的图像特征被分流:大部分通道通过轻量级卷积路径,而较小一部分通过用于推理长程关系的注意力路径。随后将它们重新组合,使网络在不显著增加计算成本的前提下,同时具备精细细节感知和全局意识。

用边缘作为微小目标的导航图

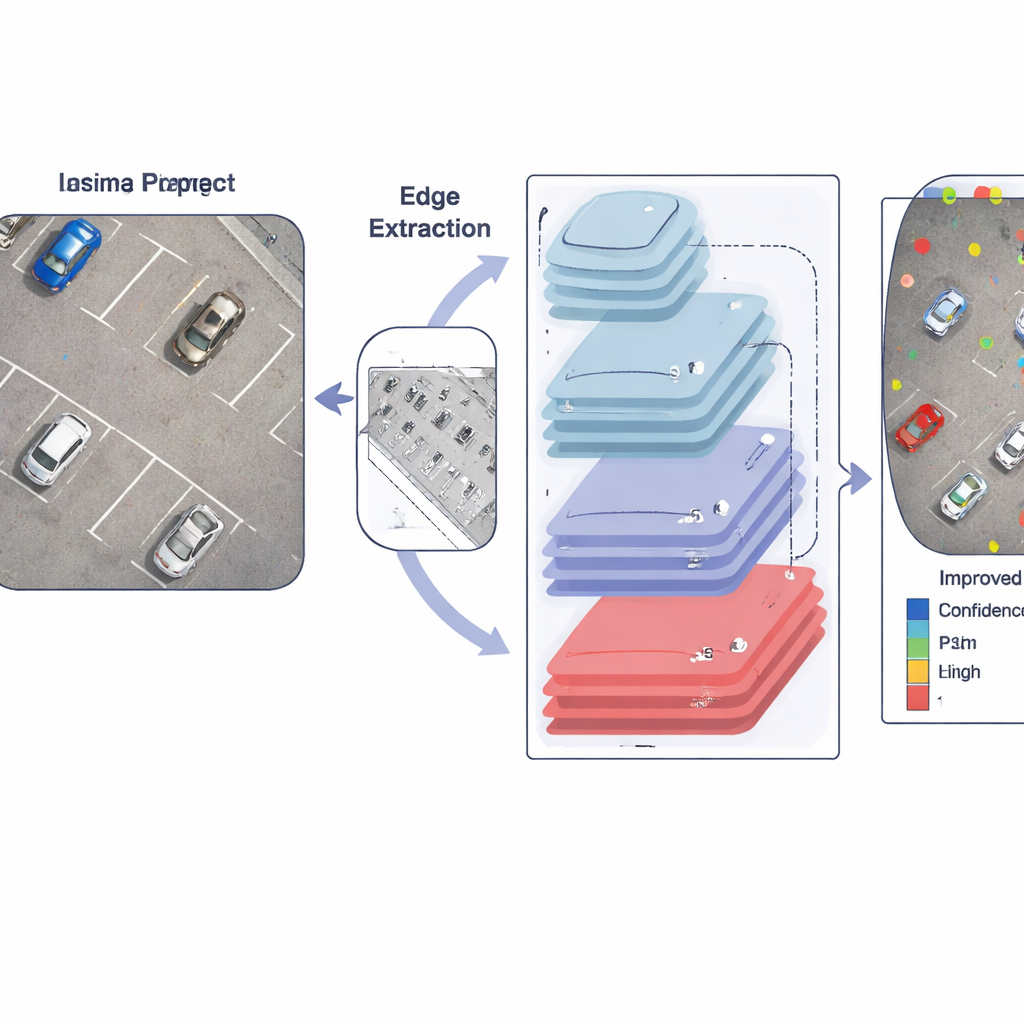

论文的一个关键见解是,当目标只有几个像素宽时,物体边界——边缘——尤其有价值。作者并非仅依赖学习到的滤波器,而是有意将边缘信息注入网络。一个专门模块首先应用 Sobel 算子——一种简单但稳健的边缘检测器,以突出亮度急剧变化的位置,例如车辆或人物轮廓周围。这些边缘图随后被汇聚为多种尺度以匹配不同的特征尺度,并通过跨通道模块进行融合。随着图像在网络中向更深层传递,这些强化的边缘提示会被重复地注入后续层,帮助模型在通常的模糊与缩减过程中持续追踪小目标的起止位置。

适应尺寸、位置与场景复杂性

在输出端,CEIFNet 使用一个动态检测头,能够根据所见自动调整其行为。与使用固定滤波器不同,该最终阶段同时应用三种形式的注意力:它可以偏好特定目标尺寸、关注图像中最有希望的位置并强调最具信息量的特征通道。结合保留额外细粒度层的特征金字塔结构,这使得系统对现实无人机影像中密集且微小的目标(从拥挤的路口到繁忙的停车场以及夜间热红外场景)更为敏感。

在真实无人机场景中验证效果

研究人员在两个要求较高的无人机数据集上测试了 CEIFNet:VisDrone2019(包含白天的城市和近郊场景)和 HIT-UAV(一组热红外集合,其中许多目标微弱且很小)。在这两者上,新系统比强大的基于 YOLO 的基线和多种其他现代检测器都检测得更准确,同时仍能在高性能显卡上达到实时运行速度。细致的消融实验显示,每个组件——混合块、边缘模块、额外细粒度层和动态检测头——都对整体提升有贡献。

对日常技术的意义

对非专业读者而言,结论是 CEIFNet 为无人机在大而复杂场景中“注意到小事物”提供了更智能的途径。通过保留边缘信息、将局部细节与全局语境混合并动态调整注意力,网络能够发现其他系统容易忽视或定位不准的小目标。这使得航拍监测在交通安全、搜救和精准农业等任务中更可靠,并指向未来能够从更高、更广视角中提取可信信息的系统发展方向。

引用: Xiao, J., Li, C., Chen, H. et al. Cross-stage edge information fusion network for small object detection in aerial images. Sci Rep 16, 7639 (2026). https://doi.org/10.1038/s41598-026-36251-5

关键词: 航拍目标检测, 小目标, 无人机成像, 基于边缘的视觉, 深度学习