Clear Sky Science · zh

在保护隐私的前提下生成脑部MRI报告通俗摘要的安全性与效果

为什么你的检查报告会让人感到困惑

越来越多的患者可以在线查看自己的检查结果,包括来自脑部影像的详细放射科报告。但这些文档是为医生撰写的,而不是为患者,充斥着陌生术语,容易引发担忧而非安心。本研究探讨现代人工智能(AI)程序能否在不将敏感医疗数据发送到远程商业服务器的情况下,安全地将真实的急诊脑部MRI报告(针对因头痛就诊的法语患者)转换为患者可以理解的通俗摘要。

把医生的语言翻成日常用语

研究人员集中于“通俗摘要”:简短说明在保留医学事实的同时,用日常语言表达,并将发现与患者的症状直接关联。他们使用了三种大型语言模型(LLM)——Llama 3.3、Athene V2 和 Mistral Small——全部在一家法国大学医院的内部计算机上运行,确保没有报告离开安全的医院网络。每个AI系统都收到相同指令:用法语为患者写一段4–6句的摘要,涵盖所有关键点,解释难懂术语,并将影像发现与患者的头痛联系起来。

医生如何评判准确性与安全性

从近600份在2022年为因头痛就诊的急诊患者撰写的脑部MRI报告中,团队随机选取了105份。三位经验丰富的神经放射科医师分别阅读每份原始报告以及三份匿名的AI生成摘要(每种模型各一份)。他们对摘要的医学正确性、完整性、对患者教育的帮助程度以及该文本是否足以直接在患者的在线门户展示进行了评分。平均而言,评分较高:医生认为这些摘要总体上是准确和全面的,并且常常适合临床使用。尽管如此,大约五分之一的摘要至少包含一个问题,例如错误解释缩略语、稍微不准确的解剖描述、措辞别扭或捏造了原报告中不存在的细节。

非医生究竟能理解多少

为评估这些摘要是否真正帮助了外行读者,研究人员招募了11名在医疗信息学领域工作的非医师人员,他们经常处理健康数据但并非受过医生训练。这组人评估了30份MRI报告,其中一些为原始形式,另一些则附加了AI摘要。他们对自己理解每份报告的程度、向亲友解释结果的自信心以及若该报告为自己会感到的焦虑程度进行了评分。他们还回答了简单的是/否问题:这份报告中是否存在异常,以及是否有发现可以合理解释患者的头痛?

更清晰的报告,理解力有适度但真实的提升

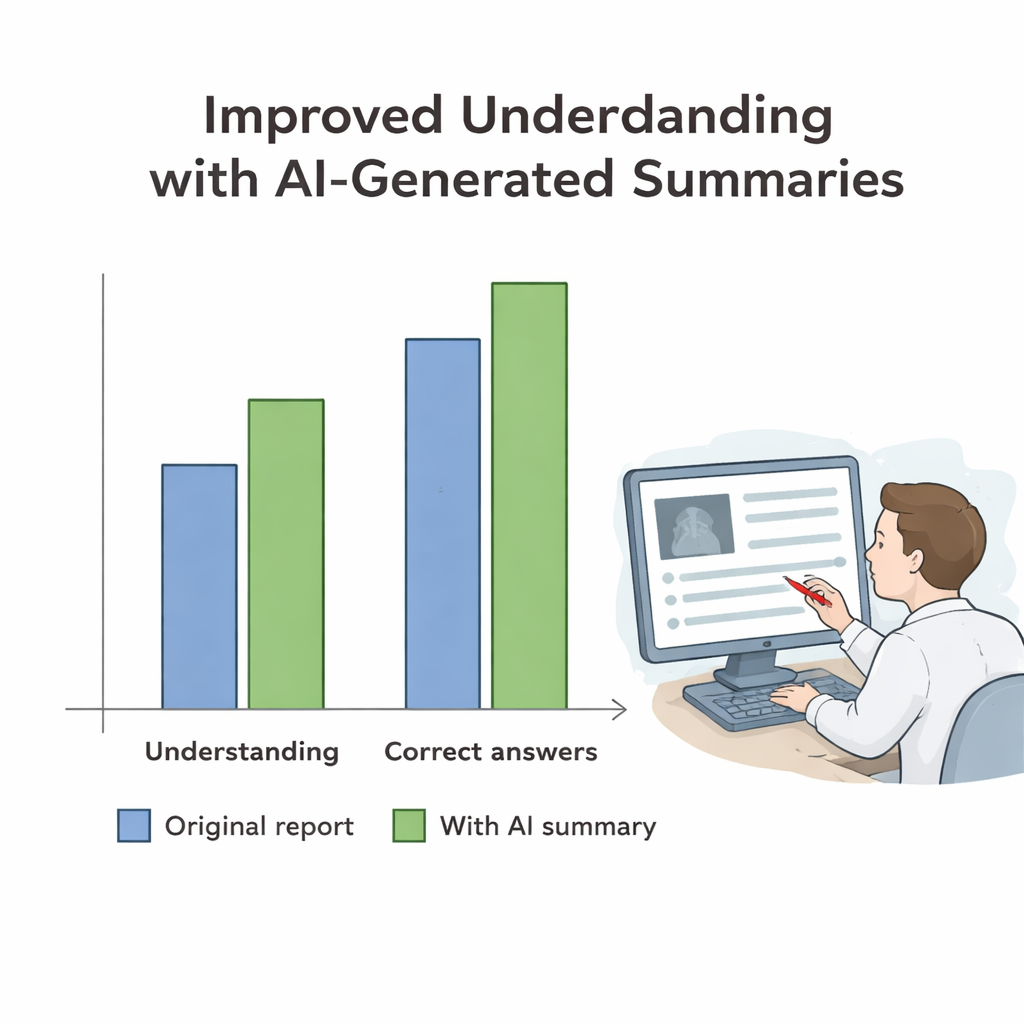

加入AI生成的摘要显著提高了参与者自感的理解程度,将平均自评理解从“中等”提升到“较高”。他们在与他人讨论结果的信心也有所上升,同时报告的焦虑感略有下降。在客观理解方面,效果较为温和但仍有意义。参与者在识别扫描是否异常以及识别可能导致头痛的发现方面表现更好,改进主要集中在包含真实异常的报告中。对于正常扫描,人们在识别没有严重问题方面已经接近完美,因此摘要带来的额外益处较小。

为何仍需人工监督

尽管这些保护隐私的AI工具显著提高了报告的可理解性并在事实理解上带来小但重要的提升,它们并非完美。大约20%的摘要包含医学或语言错误,常与棘手的医学缩略语有关,或因英语和中文词汇混入法语句子而出错。由于即便是小错误也可能误导患者,作者主张应在“人机协同”的框架下使用AI:模型起草面向患者的摘要,放射科医师快速审核并在其到达患者前进行修正。以这种方式使用,研究表明在院内部署的AI可以帮助医院在将敏感健康数据留在内部的同时,提供更清晰、更让人安心的脑部MRI结果解释。

引用: Le Guellec, B., Bentegeac, R., Shorten, L. et al. Safety and efficacy of privacy-preserving models to create Lay summaries of brain MRI reports. Sci Rep 16, 6316 (2026). https://doi.org/10.1038/s41598-026-36081-5

关键词: 放射科报告, 患者沟通, 脑部MRI, 大型语言模型, 医疗隐私