Clear Sky Science · zh

具有高斯分布修复方法和柯西反向学习的增强广义正态分布优化器用于特征选择

为何挑选合适的数据至关重要

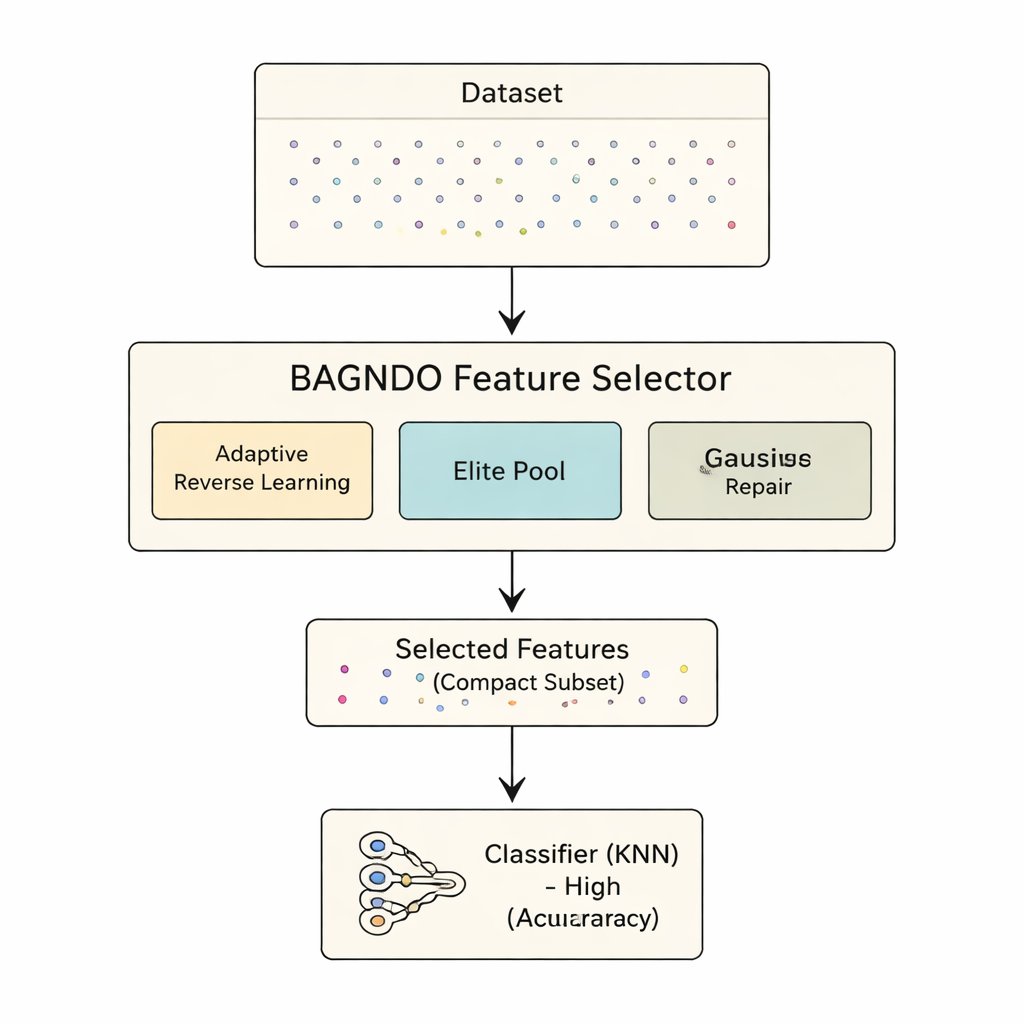

现代生活依赖数据,从医学影像和银行记录到社交媒体动态。然而,更多的数据并不总是更好。当计算机被要求同时从数千个原始测量值中学习时,处理速度会变慢、运行成本上升,且出乎意料地准确性可能下降。本文提出了一种更聪明的方法来筛选这些测量值,只保留真正重要的部分,采用一种名为二元自适应广义正态分布优化器(Binary Adaptive Generalized Normal Distribution Optimizer,简称 BAGNDO)的新算法。

线索过多的问题

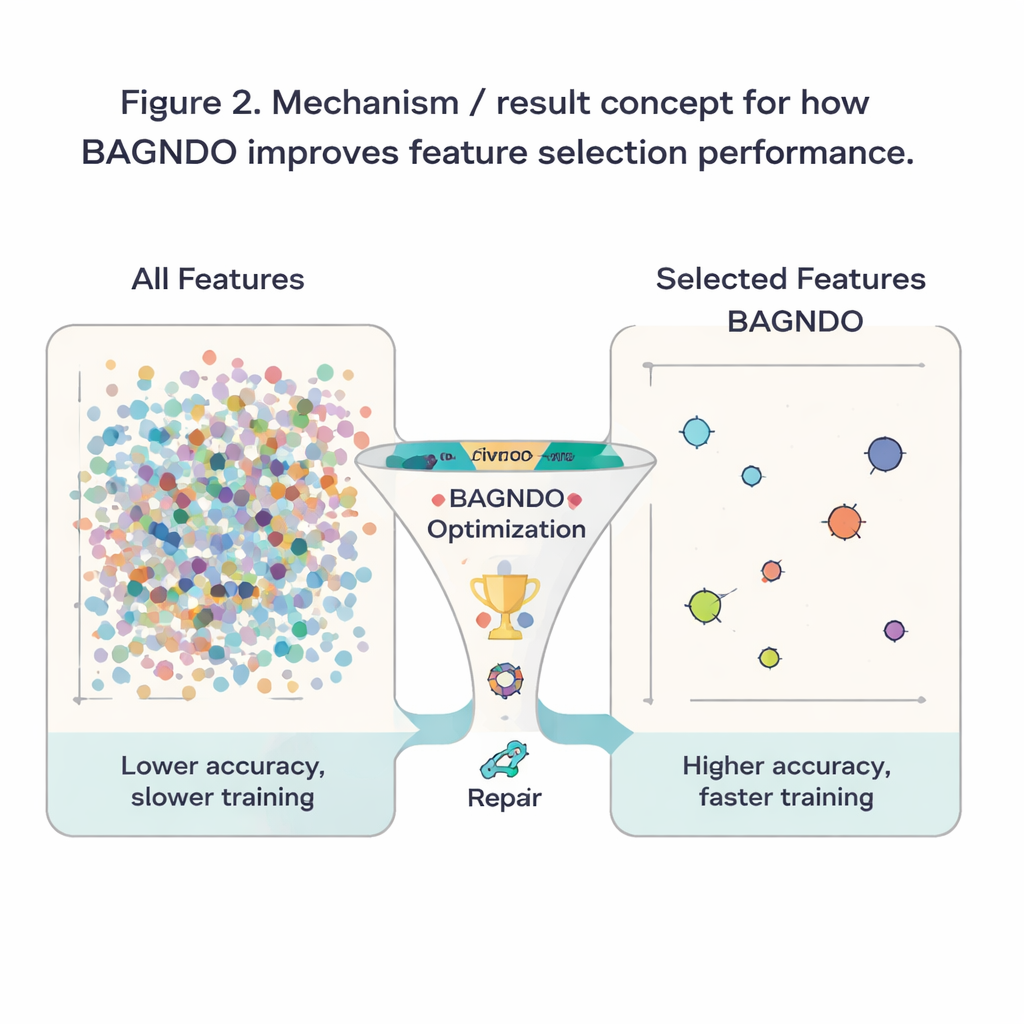

想象用数百项化验、影像和问卷答案来诊断疾病。许多“特征”可能是噪声、冗余或根本无关,把它们全部输入分类器有时会造成混乱而非帮助。特征选择的目标是挑出更小但信息量更高的输入子集,使机器学习模型变得更快、更便宜、更可靠。简单的统计过滤器可以去除明显无用的特征,但它们不会针对所使用的具体模型进行调整,且常常忽略变量之间微妙的组合关系。更高级的“包裹式(wrapper)”方法通过直接测试分类器性能来评估特征集,但这会产生巨大的搜索问题:随着特征数量增长,可能的子集数量呈爆炸式增长。

聪明地搜索而非盲目尝试

为了解决这种爆炸式增长,研究人员依靠元启发式算法——受自然或物理过程启发的搜索策略,平衡广泛探索与局部精细搜索。其中一种方法,广义正态分布优化器(GNDO),将候选解视为从灵活的钟形曲线中抽取的样本,并逐步将该曲线移动到更好的解附近。GNDO 在工程和能源领域表现良好,但在特征选择问题上它往往过早陷入仅仅尚可的解,难以在全局探索与局部细化之间取得良好平衡。作者指出这是一个关键差距:GNDO 优雅的数学原理并不自动转化为对高维、二元决策(保留哪些特征)的强劲性能。

对经典引擎的三方面升级

提出的 BAGNDO 框架通过三项协同思想对 GNDO 进行升级。第一,自适应柯西反向学习策略定期使用重尾概率分布生成当前解的“镜像”版本,鼓励大胆跳入未探索的搜索空间区域,防止算法陷入局部停滞。第二,精英池策略不仅保留单个最佳解,还保留一小组表现优异的解以及一个混合的“引导”候选者。这个更丰富的领导组有助于在保持多样性的同时引导搜索朝有希望的区域前进。第三,基于高斯分布的最差解修复方法会检视最弱的候选解,并将其朝向从精英组学到的模式轻微调整,有效地将糟糕解回收为更好的解而不是直接丢弃。

将该方法付诸测试

为检验这些想法在实践中的效果,作者将 BAGNDO 应用于来自 UCI 库的 18 个知名基准数据集,涵盖医学诊断、游戏、信号等多种领域。在每个案例中,算法都在搜索能使标准 k 近邻分类器获得高预测精度的特征子集。BAGNDO 与九个强劲的竞争算法进行了对比,包括粒子群优化、遗传算法类方法以及若干现代群体智能算法。在这些测试中,BAGNDO 一贯找到更小的特征集,同时保持甚至提高预测准确率。在 18 个数据集中有 14 个,BAGNDO 实现了在最紧凑特征子集上的最佳准确率,统计检验也证实这些提升并非偶然。

对日常机器学习的意义

对非专业读者来说,结论可以简明概括为:作者构建了一个更有纪律性的“特征挑选器”,帮助学习算法聚焦于数据集中真正重要的信息。通过更好地协调广泛探索、精英引导和对差解的修复,BAGNDO 剔除不必要的输入,同时保持或提升准确率。这意味着模型更快、存储和计算成本更低,并且通常能更清晰地指出哪些测量或问题最具信息性。尽管该方法比一些更简单的替代方案计算上更耗费资源,但对于准确性和可解释性至关重要的问题,如医学决策支持与工业监测等,它提供了一个强有力的工具。

引用: Ghetas, M., Elaziz, M.A. & Issa, M. Enhanced generalized normal distribution optimizer with Gaussian distribution repair method and cauchy reverse learning for features selection. Sci Rep 16, 4794 (2026). https://doi.org/10.1038/s41598-026-35804-y

关键词: 特征选择, 元启发式优化, 机器学习, 降维, 分类准确率