Clear Sky Science · zh

CRFusion:一种用于 BEV 地图构建的新型激光雷达—摄像头融合网络

为自动驾驶汽车打造更聪明的数字地图

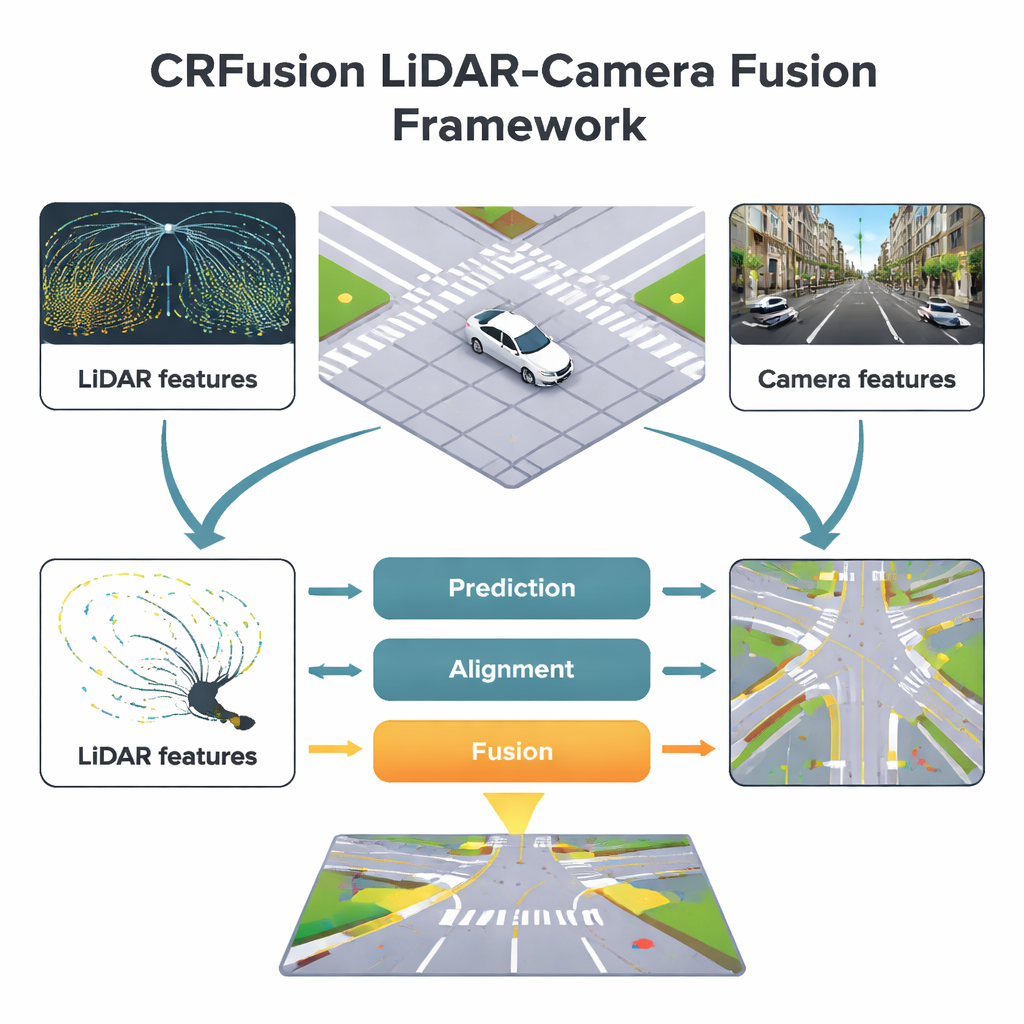

对于自动驾驶汽车来说,理解前方道路就像在阅读一张不断变化的地图。车辆必须准确知道车道、人行横道和道路边缘的位置,即使在黑暗、雨天或视线被遮挡的情况下也如此。本文介绍了 CRFusion,一种将激光雷达和摄像头结合起来构建更清晰、更可靠的城市街道顶视图(BEV)地图的新系统,帮助自动驾驶车辆更自信地保持车道并避让行人。

为何“两只电子之眼”胜于一只

现代自动驾驶汽车主要依赖两类传感器。摄像头捕捉丰富的彩色图像,便于远处识别车道标线、交通标志和人行横道;激光雷达(LiDAR)发出光脉冲并测量回波,构建车辆周围精确的三维距离与形状信息。两者各有弱点:摄像头在弱光或恶劣天气下容易失效,而激光雷达随距离增加会变得稀疏且不完整。CRFusion 致力于将这些优缺点融合到单一的鸟瞰图中——在该顶视图上,每个像素代表地面的一小块区域,并被标注为车道、隔离带或行人过街处。

填补远距视觉的空白

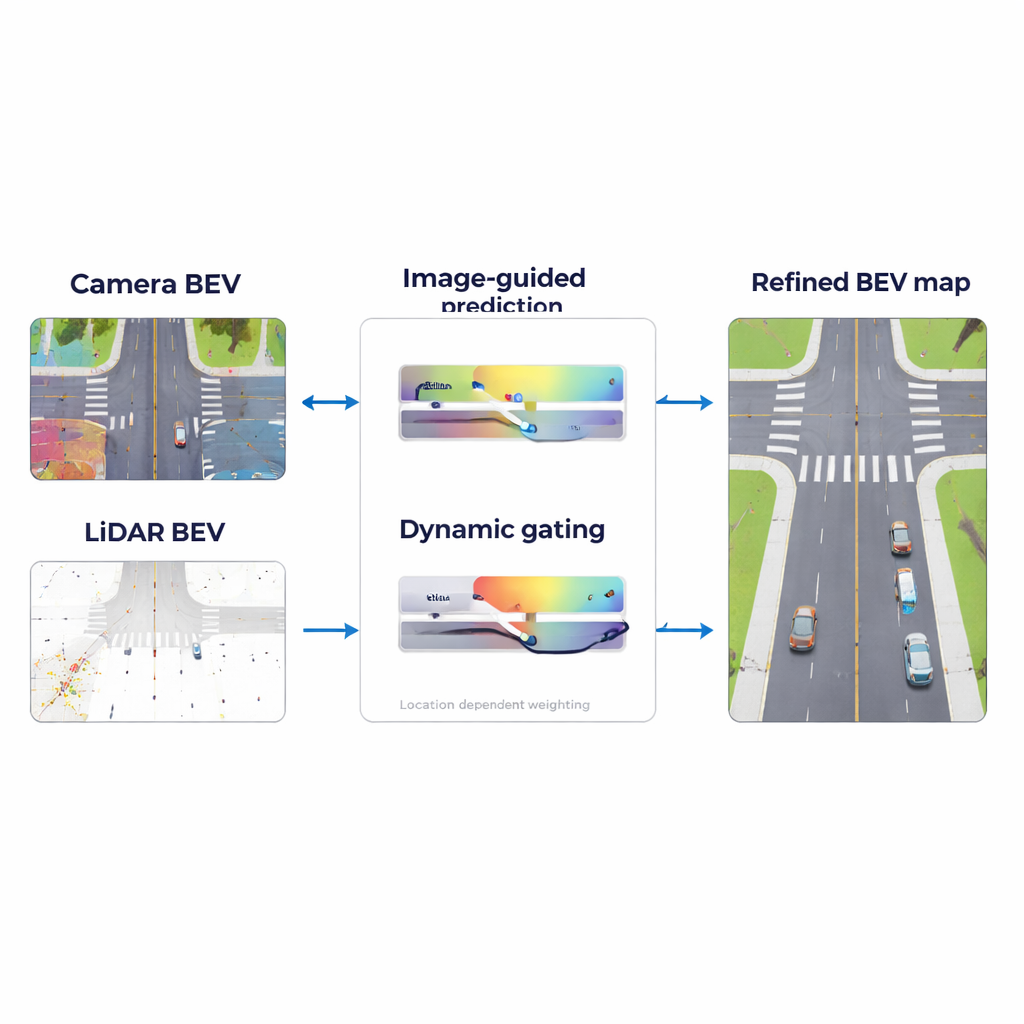

道路制图的一大挑战是激光雷达在远距离常常无法捕捉到细节,而这恰恰是提前规划最需要的信息。CRFusion 通过“激光雷达范围预测器”来应对这一问题。简而言之,系统利用摄像头对远处道路的观测,推断出若激光雷达密集且完整时会获得的测量结果。一个称为注意力的机制帮助模型判断摄像头视野的哪些部分最能解释激光雷达图中空缺或不确定的区域。随后系统通过比较地图中相邻区域来细化预测,增强连续车道线等一致性模式并抑制随机噪声。

让传感器就同一画面达成一致

即便摄像头和激光雷达都正常工作,它们的观测也不会完全对齐。距离估计或传感器安装的小误差会导致摄像头看到的车道标线与激光雷达读数出现轻微偏移。CRFusion 引入了一个对齐步骤,温和地“扭曲”摄像头的顶视特征,使其更好地匹配激光雷达视图。该过程使用一个轻量的校正网络预测摄像头地图中每一点应被微调的方式。结果是,两种传感器的视图描述相同的物理路面位置,从而使后续的融合更加可靠。

适应白天、夜晚和恶劣天气

在将两种传感器视图对齐后,系统仍需在每个位置决定信任哪一方更大。阳光充足、车道标线清晰的高速公路,与雨夜拥挤的城市街道截然不同。CRFusion 通过“动态门控融合”模块解决这一问题,该模块在地图上为摄像头与激光雷达特征分配灵活的权重。当激光雷达回波强、例如靠近的道路边缘或稳固物体时,系统更依赖激光雷达;当视觉线索更清晰、例如远处明亮的人行横道时,则更依赖摄像头。这些权重由数据自动学习,使融合策略能随环境条件平滑调整。

在真实世界数据中证明其优势

研究者在广泛使用的自动驾驶数据集 NuScenes 上测试了 CRFusion,该数据集包含不同城市、天气和时间的众多驾驶场景。与现有领先方法相比,CRFusion 在中远距离(最高至 90 米)处能生成更精确的车道边界、隔离带和人行横道。它改善了与地面真实地图的重叠质量指标和单个车道段检测能力;消融研究表明,每个主要组件——远距预测、对齐网络和动态融合——都带来了显著提升。可视化示例显示了更平滑的车道连续性和更清晰的人行横道,证实系统生成的地图更像经认真绘制的道路规划图。

对日常驾驶意味着什么

对非专业读者而言,主要结论是 CRFusion 通过让摄像头和激光雷达以更聪明的方式“互相交流”,帮助自动驾驶汽车构建更清晰、更可靠的街道地图。通过从摄像头视图预测缺失的激光雷达信息、对齐两种传感器视角并根据情境调整对各自的信任程度,系统减少了盲点和不确定性。这使自动驾驶车辆在复杂、拥挤的城市街道上更接近于像谨慎的人工驾驶员在清晰标线下行驶那样自信。

引用: Guan, Y., Wang, T., Cheng, Q. et al. CRFusion: a novel LiDAR-camera fusion network for BEV map construction. Sci Rep 16, 5169 (2026). https://doi.org/10.1038/s41598-026-35551-0

关键词: 自动驾驶, 激光雷达-摄像头融合, 高清语义地图, 鸟瞰图感知, 城市道路制图