Clear Sky Science · zh

用于无人机影像小目标检测的增强型 YOLOv11n:更高精度、更少参数

为什么从空中识别微小目标很重要

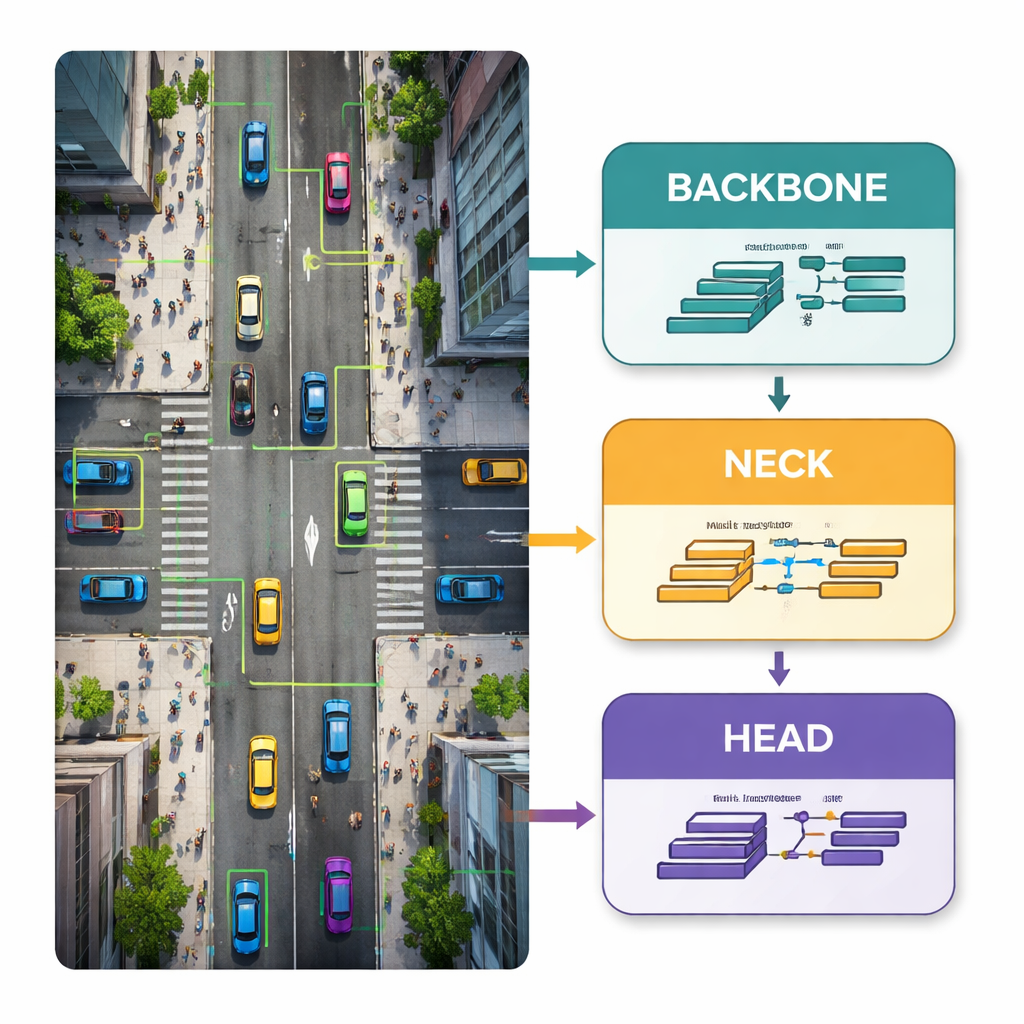

小型无人飞行器正迅速进入日常生活,从交通监测和灾害救援到包裹投递。但存在一个棘手的问题:当无人机从数百米高空俯瞰时,行人、汽车和船只会缩小到只有几个像素。常规计算机视觉系统常常漏检这些微小目标,或将它们与背景杂波混淆。本文提出了对流行检测系统 YOLOv11n 的更聪明、更轻量化的改进,专门针对无人机图像中的微小目标进行优化,同时仍能在轻量级机载计算平台上高效运行。

在微小、模糊细节中看得更清楚

无人机影像对算法来说是苛刻的环境。大多数目标小于 32×32 像素,很多甚至不足 16 像素。运动、振动、光照变化、霾以及复杂的城市背景都使这些微小目标更难区分。同时,无人机常依赖性能有限的处理器和受限的能耗,因而大型模型不可行。作者以紧凑的实时检测器 YOLOv11n 为起点,重新设计其内部组件,从小而低对比度的区域中挤出更多有用信息,而不会使模型臃肿。他们的目标简单但要求很高:在小目标上显著提高精度,同时保持相同或更少的可学习参数,并在边缘硬件上保持可接受的速度。

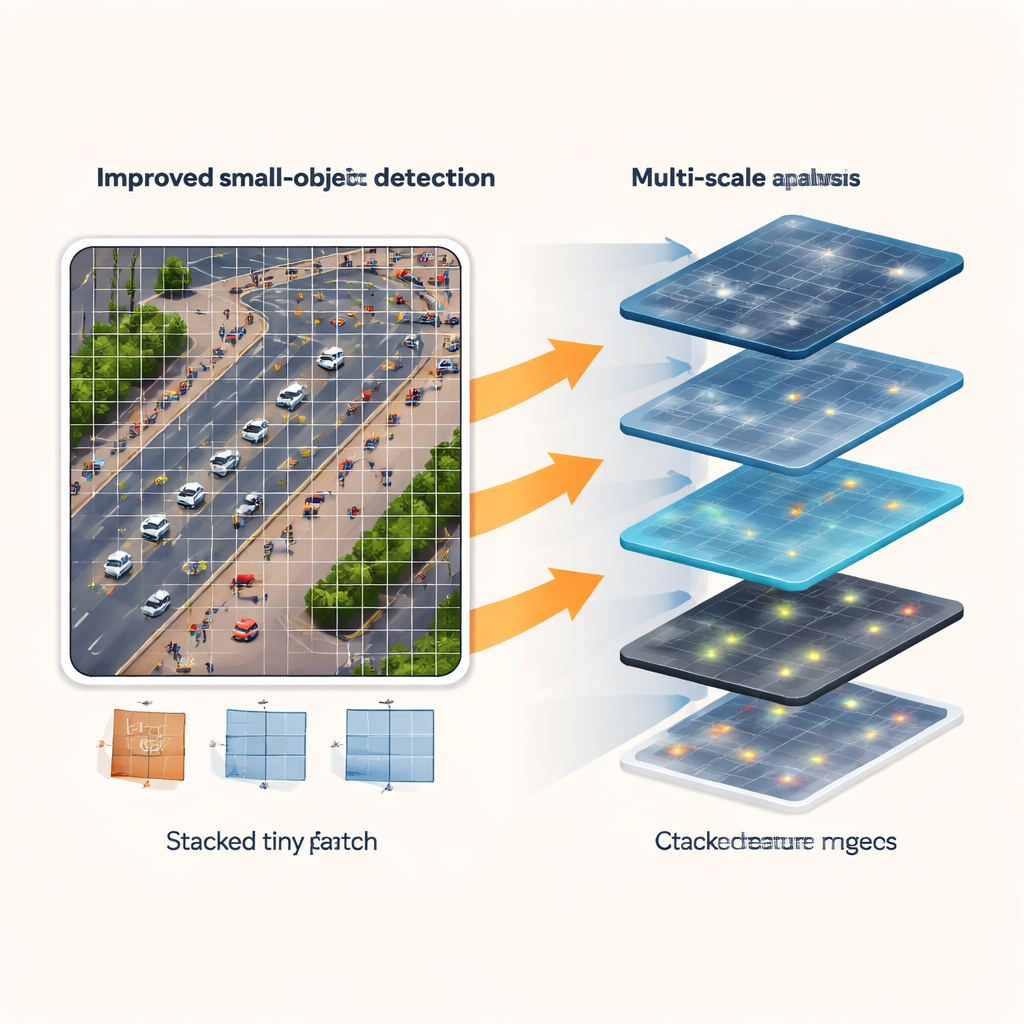

从多尺度场景中学习

第一个改进集中在网络如何“观察”场景。新提出的多尺度边缘特征自适应选择(MSEAF)模块不是通过单一固定尺寸窗口查看,而是同时在多个尺度上观察图像。粗略视角捕捉道路、建筑和人群的整体布局,而更精细的视角则跟踪单辆汽车或个体行人。边缘增强步骤强调那些在微小图像块中容易被冲淡的边界和形状。随后一个智能融合机制提升最具信息量的区域,同时抑制背景噪声。这种多尺度、边缘感知的表示为网络其余部分提供了更丰富的起点,有助于发现难以察觉的目标。

在网络传递中保留小目标信息

传统的 YOLO 网络在信息从输入到输出传递时会反复缩小特征图。对大目标来说这没问题,但对微小目标可能是致命的:经过多次下采样后,一个行人在内部特征图上可能只占据一两个像素,甚至完全消失。为防止这种情况,作者重塑了网络中间的“颈部”结构,并新增了一个在更高分辨率特征上工作的 P2 检测头。名为 ScalCat 与 Scal3DC 的自定义模块谨慎地融合来自不同层的信息,使浅层的细节与深层的上下文相互强化。其结果是一个能够在多尺度上追踪小型汽车和行人的检测器,而不是为了速度而牺牲它们。

更精确的决策,参数更少

最后一步是简化预测阶段,即检测头。在原始设计中,通道数较多的深层主要用于处理大型目标,而在无人机制图中大型目标相对稀少。新的共享重参数化检测头(SRepD)在尺度间均衡了通道数,并采用了一种巧妙的训练策略:训练期间,若干专门化卷积分支探索不同的特征突出方式;推理时,这些分支在数学上被合并为单一且简单的卷积。该共享重参数化设计在提高特征融合效果的同时,实际上减少了参数数量,并保持了对边缘设备可控的计算量。

实际测试中的数据说明了什么

增强模型在三个具有挑战性的公开数据集上进行了测试:VisDrone2019(混合城市场景)、TinyPerson(极小人体,覆盖陆地与海上)和 HazyDet(无人机视角下的重雾车辆)。在 VisDrone2019 上,与原始 YOLOv11n 相比,新设计在关键准确率指标(mAP50)和精度上提高了 4.6 个百分点,同时参数减少约 8.5%。在 TinyPerson 上,改进更为显著——mAP50 提升约 5.9 个百分点,精度提升 5.6 个百分点,参数也有类似的下降;该紧凑模型甚至优于一个参数量多四倍的更大 YOLOv11s。在有雾条件下,升级后的检测器在准确性和鲁棒性指标上也均超过基线模型,同时在低功耗的华为 Atlas 200 DK 边缘板上保持实时速度。

这对日常无人机应用意味着什么

对非专业读者来说,主要结论是:这项研究表明无人机可以在提高观测清晰度的同时变得更节省资源。通过重新思考网络在哪儿以及如何寻找细节、在管道中保留高分辨率信息以捕捉微小目标、并简化预测机制,作者打破了精度与模型大小之间的常见权衡。由此得到的系统能更好地识别拥挤、起雾或复杂场景中远处且微小的人员与车辆,而无需笨重硬件。这类进步使得用于交通安全、搜救与环境监测的可靠实时航拍监控更接近日常部署。

引用: Zhu, H., Xie, X. Enhanced YOLOv11n for small object detection in UAV imagery: higher accuracy with fewer parameters. Sci Rep 16, 5536 (2026). https://doi.org/10.1038/s41598-026-35301-2

关键词: 无人机目标检测, 小目标识别, YOLO 神经网络, 航拍影像分析, 无人机边缘 AI