Clear Sky Science · zh

增强注意力的 MobileNetV2 模型用于稳健的森林火灾检测与分类

为何更快的火情预警至关重要

在全球范围内,野火变得更烈、更广、更昂贵。几分钟的差别可能意味着可控的小火或造成生态系统破坏、城市弥漫浓烟并带来数十亿美元损失的区域性灾难之间的区别。本研究探讨了如何用紧凑的人工智能(AI)模型在普通图像和视频中迅速发现森林火灾的最初迹象,速度足以在无人机、监控摄像头和分布在脆弱地带的低功耗传感器上运行。

用智能摄像头守护林地

传统的火情瞭望塔和人工值守通过实时视频监控广袤林区往往难以应对,尤其是在夜间或有烟雾、雾霾的条件下。作者将森林火灾检测问题简化为一个二元判断:这张图像中是否有火?他们构建了一个平衡的数据集,共计 5,121 张包含火和非火场景的图片,来源于森林、城市和工业场所,并覆盖白天、夜晚以及烟雾或雾霾环境。通过谨慎平衡数据并人工核验标签,研究旨在教会 AI 系统识别真实环境中的火焰,而非仅限于理想实验样本。

为现场设计的精简 AI

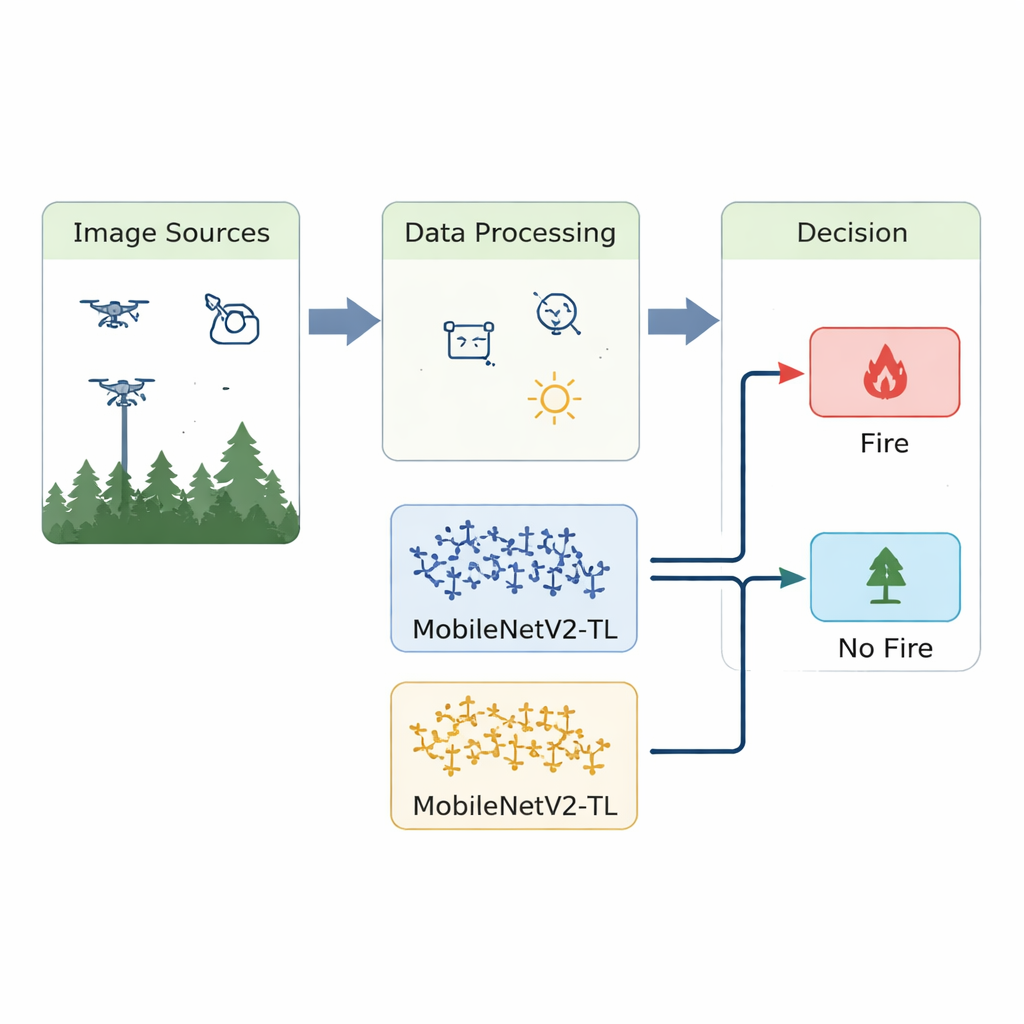

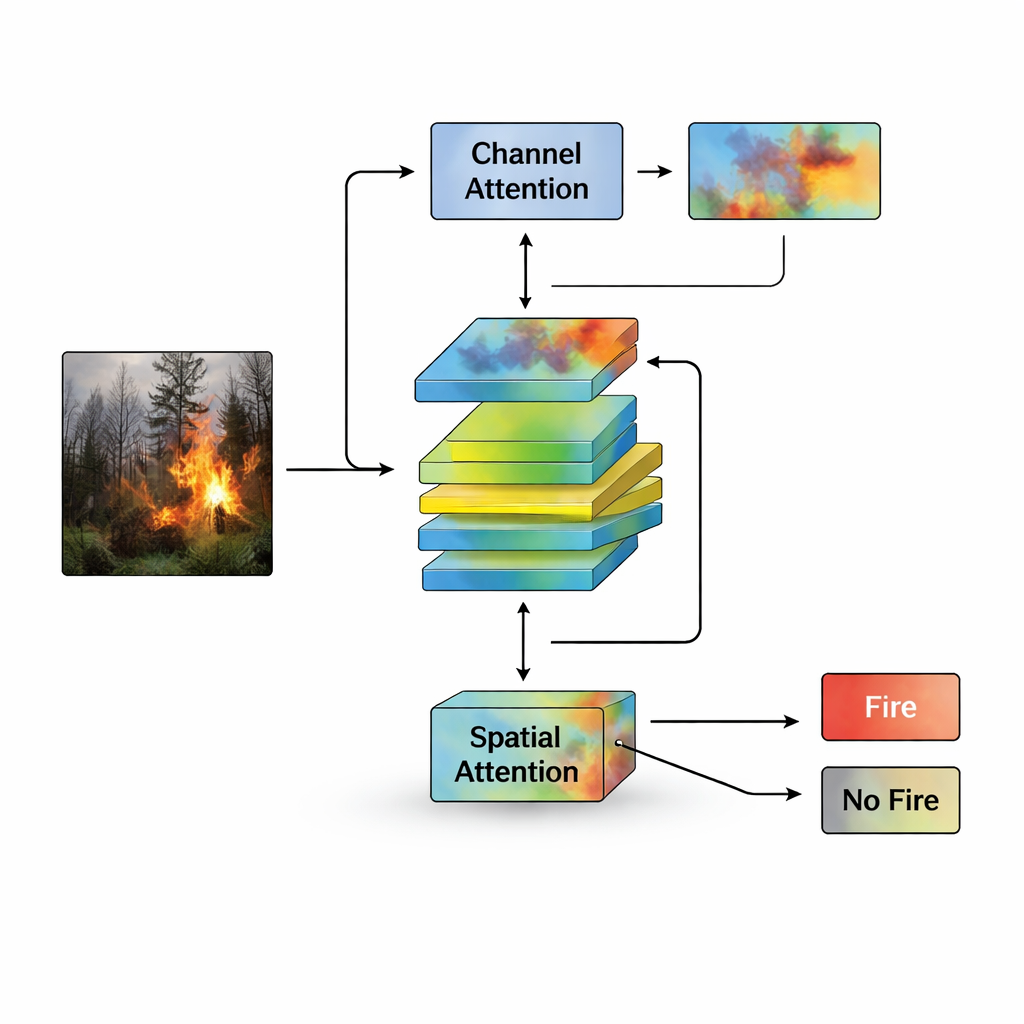

许多强大的图像识别系统过于庞大,无法在无人机或低成本监控摄像头内的小型计算机上运行。为解决这一问题,研究基于 MobileNetV2 架构,这是一类为速度和内存节约而设计的神经网络。第一个模型称为 Att-MobileNetV2,增加了“注意力”机制,帮助网络聚焦于识别火焰的典型颜色、纹理和边缘,同时忽略如被阳光照亮的云层或明亮建筑灯光等干扰。第二个模型 MobileNetV2-TL 则依赖迁移学习:重用从数百万张通用照片中学到的视觉特征,只训练一个小型的任务专用头部来区分有火与无火,从而保持较低的处理时间和能耗。

在艰难的真实条件下训练

为了模拟真实火情监测中的复杂条件,研究人员不仅收集多样化图像,还对每张训练图像施加受控的变换——如小幅旋转、翻转以及亮度或对比度调整——以模拟不同的摄像角度和光照。两种模型在相同规则下进行训练和评估,采用准确率、精确率和召回率等标准指标,并检查漏报与误报的频率。Att-MobileNetV2 的准确率约为 99.6%,而 MobileNetV2-TL 约为 98.4%。关键在于,这些结果是在只有几百万参数且每张图像仅需十亿次运算的一小部分的条件下得到的,能够在单个图形处理器上在约 10–12 毫秒内作出决策。

用更小的模型超越更大的系统

这两种紧凑模型与传统机器学习方法和更复杂的深度网络进行了比较。在相同的训练与测试条件下,Att-MobileNetV2 在正确识别火情与正确判定安全之间取得了最佳平衡,而 MobileNetV2-TL 则展现出特别高的召回率,意味着它很少漏检真实火灾——这是预警系统的关键属性。将两者组合成集成模型则表现更佳,表明它们对场景的“观察”方式具有互补性。在独立的公开数据集上的测试显示,这些模型在新图像上仍能保持强劲性能,表明其泛化能力超出训练样本的特定图片。

这对未来消防安全意味着什么

简言之,这项工作表明,小型且高效的 AI 模型可以在普通硬件(如搭载于无人机、瞭望塔或路边摄像头的设备)上早期且可靠地发现森林火灾。通过注意力机制聚焦图像中关键区域以及利用迁移学习重用已有的视觉知识,所提出的系统达到了与更庞大模型相当甚至更优的准确性。尽管在浓雾等极端条件下仍存在挑战,该方法指向了一种由智能、低成本传感器组成的网络,能够更早发出警报,帮助消防人员更快响应,并可能阻止小火星演变为灾难性野火。

引用: Ul Haq, I., Husnain, G., Iqbal, A. et al. Attention-enhanced MobileNetV2 models for robust forest fire detection and classification. Sci Rep 16, 4805 (2026). https://doi.org/10.1038/s41598-026-35207-z

关键词: 森林火灾检测, 野火监测, 深度学习, 边缘人工智能, 计算机视觉