Clear Sky Science · zh

一种准确的实时水下物体分割:改进的双域 YOLOv11-UOS,结合物理引导自适应增强与注意力增强

用更清晰的“数码之眼”深入海洋

我们的海洋正越来越多地由智能摄像头搭载的水下机器人来探索,而不仅仅依赖潜水员和潜艇。这些摄像头用于寻找沉船、检查海底管道,以及监测珊瑚礁和鱼群。但水下影像常常浑浊、带有蓝绿色偏色并充斥视觉干扰,使得人类甚至计算机也难以识别物体。本文介绍了一种新的计算机视觉系统:它先净化水下图像,然后快速定位并描绘图中物体的轮廓,足以用于实时机器人任务。

为什么水下成像如此困难

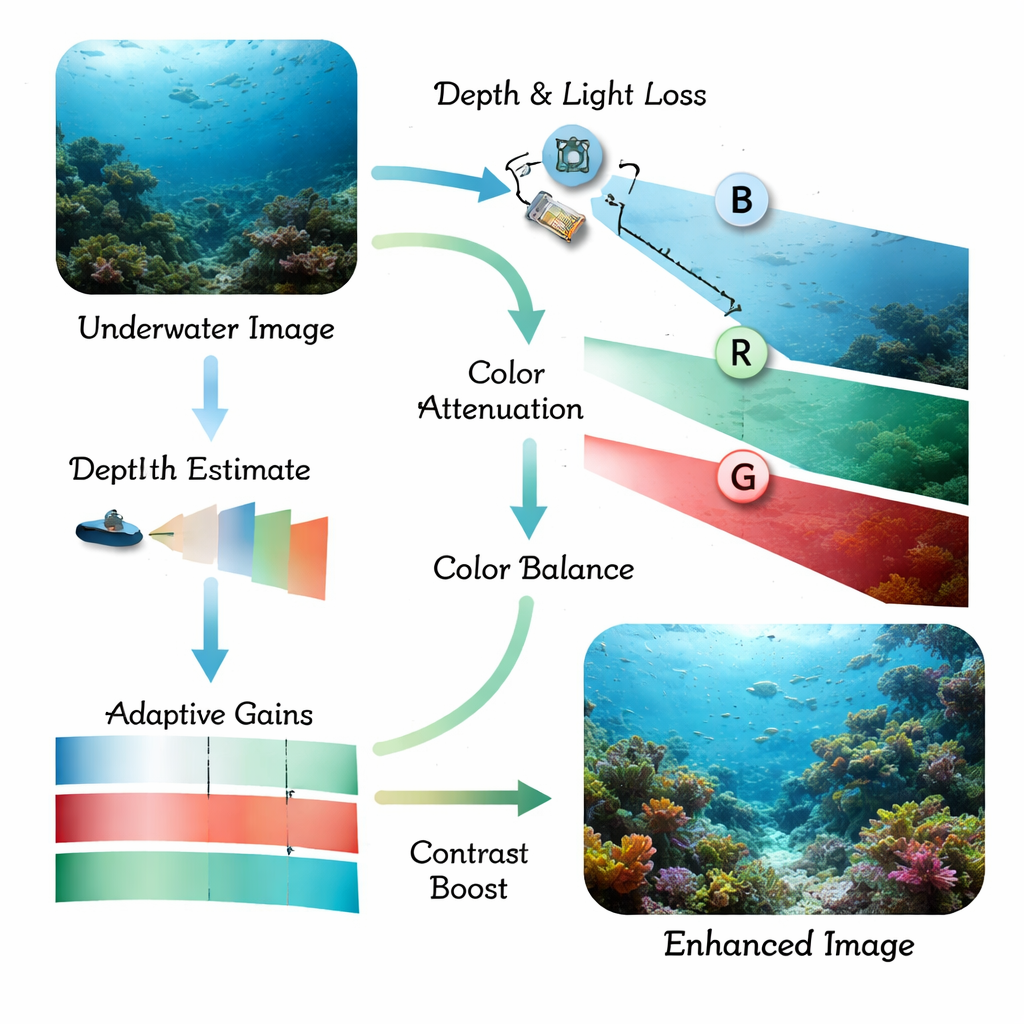

光在水中的表现与空气中大不相同。当阳光向下传播时,红色成分最先衰减,随后是绿色,最终留下偏蓝的色调和低对比度的场景。水中的微小颗粒会散射光线,产生雾霾,使边缘模糊、细节被掩盖。传统的目标检测程序,甚至现代深度学习模型,在面对这些失真图像时也表现不佳:鱼类与珊瑚融为一体,人工构筑物消失在背景中,低光场景几乎不可读。以往的研究通常只处理图像净化或目标检测其一,导致最终系统常常过慢、脆弱,或在特别浑浊的水域仍然识别失败。

两步策略:先清理,再聚焦

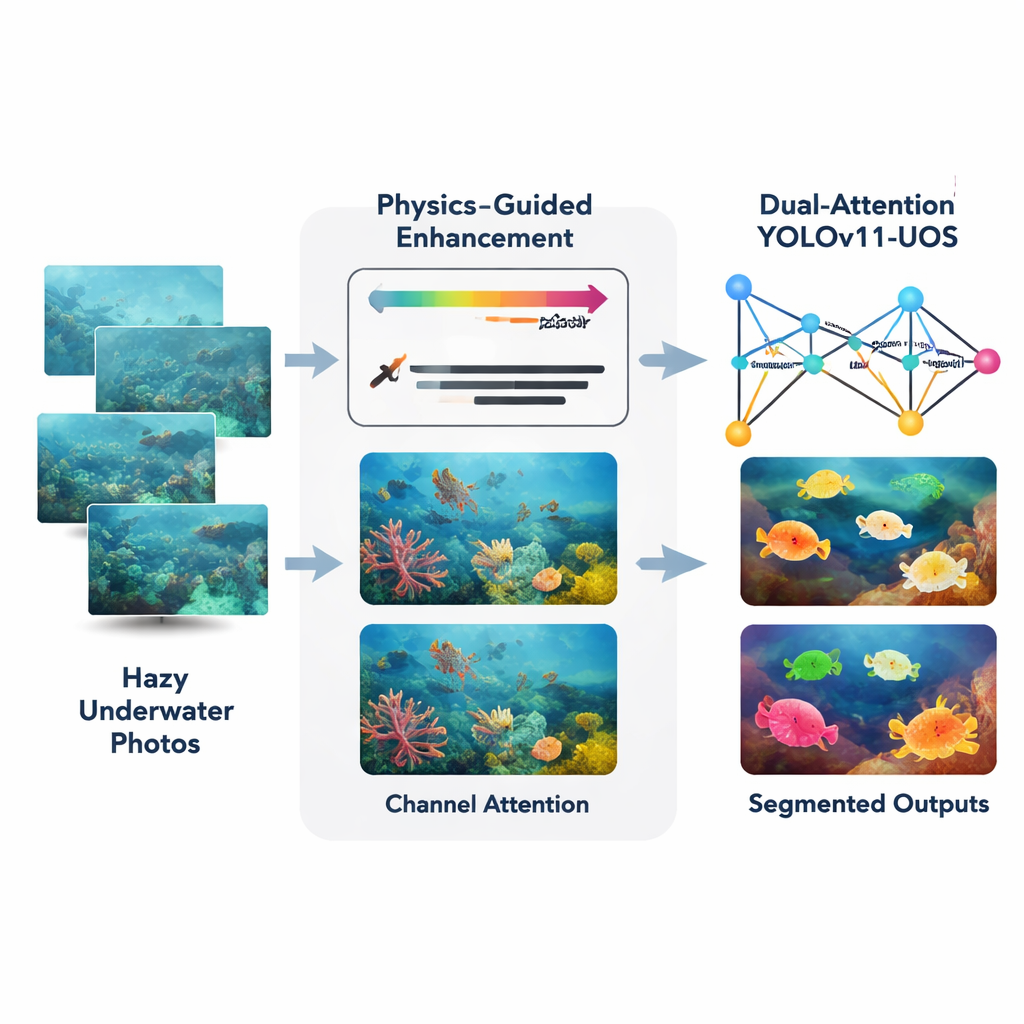

作者提出了一种结合方法,围绕一种最近的实时检测器 YOLOv11 构建,并在此基础上针对水下场景和实例分割(为每个物体绘制精确轮廓)进行定制。首先,一个名为自适应物理引导增强(Adaptive Physics‑Guided Enhancement)的前端模块接收原始水下照片,并利用简化的光在水中吸收与散射的物理模型进行校正。该模块估计场景中各部分相对于相机的距离,然后补偿红光相比绿光和蓝光更强的损失,从而恢复更自然的色彩并提升局部对比度。同时,通过谨慎的基于直方图的步骤在不放大噪声的前提下锐化边缘,即便在黑暗或浑浊区域也能保持效果。

教网络该看哪里

图像被净化后,会传入一个升级的 YOLOv11 主干网络,该网络加入了注意力机制。这些新增模块有点像聚光灯和颜色滤镜。空间注意力让网络更多关注重要区域——比如鱼的轮廓或水下文物的边缘——并忽略沙地或随水摆动的植物等干扰背景。通道注意力调整系统对不同颜色和纹理模式的权重,使有用的视觉线索被强化而无关的信息被弱化。双重注意力阶段协同作用,有助于网络在最终判断物体位置与类别前构建更清晰的内部表示。

在真实海域与严苛条件下的测试

为检验系统在实际中的表现,研究者在多个公开水下图像数据集以及一个包含 7000 多张来自沿海不同深度与浑浊程度照片的新标注数据集上进行了训练与测试。他们采用标准的检测与分割指标,并将方法与常用模型(如 U‑Net、DeepLab、基于 Transformer 的分割器)以及不带新模块的基线 YOLOv11 系统进行了比较。增强加注意力的组合设计使平均检测准确率相比基线 YOLOv11 提升约 6.5 个百分点,物体轮廓更干净、漏检与误检明显减少。更重要的是,该系统在现代图形处理器上仍能以约 38 帧/秒的速度运行,足以满足机器人平台的近实时需求。

对海洋机器人和研究的意义

简而言之,这项研究表明智能的预处理与有针对性的注意力能够显著提升水下视觉能力。通过先逆转部分破坏水下照片的物理效应,再引导检测网络聚焦最有信息量的区域和颜色,该方法能够提供更清晰、更可靠的鱼类、珊瑚与人工结构轮廓。这有助于自主水下航行器安全导航、监测脆弱的海洋生态系统以及在无人监督下检查关键海底基础设施。极度浑浊的水域或极深处极度缺乏红光的场景仍存在挑战,但这一框架为稳健的实时水下视觉奠定了实用的一步,可支持未来的三维制图与多传感器海洋探索。

引用: Deluxni, N., Sudhakaran, P., Alroobaea, R. et al. An accurate realtime underwater object segmentation using improved dual-domain YOLOv11-UOS with physics guided adaptive enhancement and attention-boosting. Sci Rep 16, 4804 (2026). https://doi.org/10.1038/s41598-026-35001-x

关键词: 水下视觉, 海洋机器人, 图像增强, 物体分割, 计算机视觉