Clear Sky Science · zh

审视人类在决策中对人工智能的依赖

为什么我们对智能机器的信任很重要

从电影推荐到简历筛选再到刑事司法,人工智能(AI)在越来越多地帮助人们做决策。我们中的许多人假设计算机比人类更少偏见、也更准确。但当人们接受来自 AI 系统的建议时,实际会发生什么——他们会明智地使用这些建议,还是过度依赖?这项研究探讨了人们对 AI 指导与来自其他人的指导的反应差异,以及这对 AI 在日常决策中日益增长作用的含义。

用真实与伪造面孔测试真实受试者

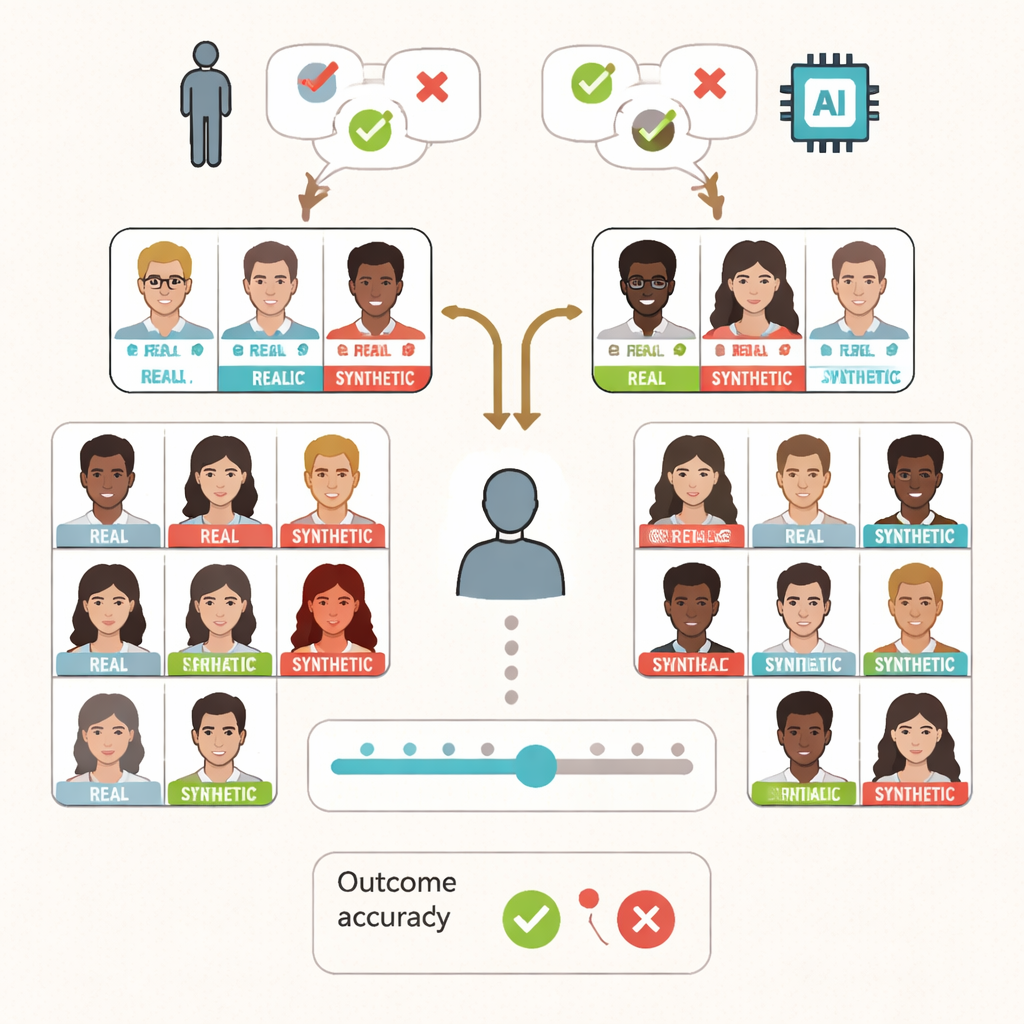

研究人员让295名成年人执行一项看似简单的任务:判断屏幕上的面孔是真实照片还是由 AI 生成的假面。每位参与者看到了80张面孔——一半真实、一半合成——这些面孔是从早期工作中精心挑选的,使大多数人可以大致判断正确,但并非完美。每张面孔旁边都有一条简短的提示,说明该面孔是“真实”还是“合成”。参与者被告知这些建议要么来自一组人类专家,要么来自一个 AI 系统,尽管实际上所有建议都是预先设定的,而且只有一半时间是正确的。

使用建议,但并非盲从

核心问题是人们会否简单地遵循建议,还是会自行思考。结果表明,参与者并没有表现得像被动按键的人。他们在建议恰好正确时更倾向于采纳,而在建议错误时更可能忽视,无论这些建议据称来自人类还是 AI。辨别真实与合成面孔的总体准确率保持在大约三分之二——与先前研究中没有任何建议的一组受试者的表现非常相近。换句话说,所谓 AI“帮手”的存在并未总体上显著提高或破坏表现。

对 AI 的积极态度何时适得其反

然而,在这些平均值之下,出现了更微妙的模式。参与者还完成了关于他们通常信任他人程度以及他们对 AI 感受的调查。那些对 AI 持更积极态度的人在接受 AI 指导时实际上在辨别真假方面变得更差。他们比持更谨慎或消极 AI 观点的参与者更难区分真实与合成面孔。当人们认为建议来自人类时,这种效应并未出现,这表明 AI 的建议可能以独特方式塑造并有时扭曲我们的决策。研究还发现,那些声称总是依赖建议的人表现比那些表示有时或根本不使用建议的人更差。

人类仍然扮演决策者的角色

研究人员深入分析了人们如何在自身判断与建议之间取得平衡。平均而言,参与者表现出将面孔标记为真实的偏向,而那些报告更倾向信任他人的人的这种偏向略有增加。然而,人们使用建议的方式看起来是“有策略”的:他们似乎在自己不太确定时特别依赖建议。信心评分与表现相当吻合——当人们感觉更有信心时,通常更准确——这表明即便在 AI 参与的情况下,参与者对自己何时判断正确或错误有相当合理的把握。

这对日常 AI 工具意味着什么

对普通读者而言,关键结论是 AI 并不会神奇地消除人类偏见,也不会自动压倒我们的判断。人们常常将 AI 的建议视为与人类建议相似,并且在建议看起来无用时能够忽视它。但当某人已经对 AI 持非常积极的看法时,他们可能更倾向于依赖 AI,从而降低自己的准确性。随着 AI 系统扩展到医疗、安全和司法等关键领域,设计者和政策制定者需要了解这些人的倾向。该研究表明,有效使用 AI 不仅取决于更好的算法,还取决于让人们了解何时信任机器——以及何时信任自己。

引用: Pearson, J., Dror, I., Jayes, E. et al. Examining human reliance on artificial intelligence in decision making. Sci Rep 16, 5345 (2026). https://doi.org/10.1038/s41598-026-34983-y

关键词: 人工智能, 人类决策, 对 AI 的信任, 自动化偏见, 深度伪造面孔