Clear Sky Science · zh

Multi-TPC:一个包含语音、动作与凝视的三人会话多模态数据集

我们在谈话时如何移动与注视为何重要

面对面交谈时,人们做的远不止言辞交换。我们会前倾、点头、相互瞥视,并在恰当处停顿。这些微妙的动作在三人对话中更为重要,因为注意力与发言顺序不断变化。然而直到现在,科学家和工程师们几乎没有高质量的数据,展示语音、身体运动与眼动在小组对话中如何协同工作。本文介绍了一个旨在填补这一空白的新数据集,帮助构建更自然的虚拟助理、社交机器人以及研究日常人类交互的工具。

三人会话的新视角

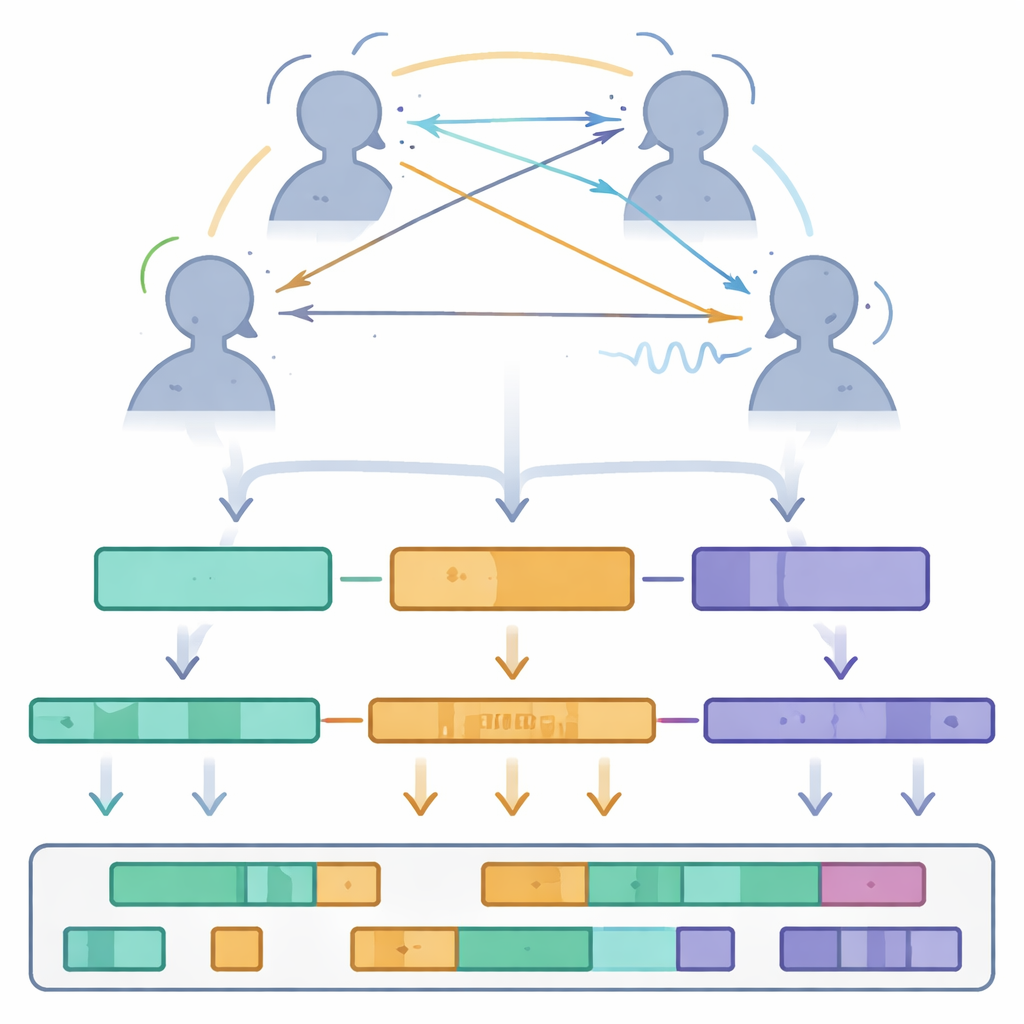

作者提出了 Multi-TPC,这是一个公开可用的三人会话集合,在实验室中使用动作捕捉、眼动仪和独立麦克风录制。与许多早期资源侧重单一说话者或仅两人对话不同,Multi-TPC 捕捉了站成三角形的三名陌生人之间的自发讨论,参与者可以自由选择话题。数据集中包含来自 21 名青年成人、共计超过 5.3 小时的录音,分为 24 个会话。数据集为会话中的每一个时刻提供了关于每位参与者如何说话、如何移动身体以及他们注视何处的详细信息。

会话是如何被记录的

为构建该数据集,团队创建了混合录制装置。每位参与者穿戴带有反光标记的全身动作捕捉服,使八台摄像机阵列能够在三维空间中追踪他们的姿势、头部运动和手势。轻便的眼动追踪眼镜,佩戴感觉类似普通眼镜,测量每个人在视野中的注视位置。夹在颈部附近的无线麦克风为每位说话者单独记录音轨。录制前,对参与者进行了系统校准,并指示他们保持形成等边三角形的大致固定位置,边长约一米。一个对摄像机、眼动仪与麦克风都可见的打板为所有设备提供了精确的同步提示,保证动作、凝视与语音可以逐帧对齐。

对数据的清理、组织与丰富

采集原始信号只是第一步。研究者们对动作数据进行了仔细处理,标注所有标记并使用数学插值填补小的缺口,同时交叉核对附近标记位置。音频录音通过降噪方法进行清理,然后输入语音识别软件生成逐词转录,随后进行了人工校正。以像素为单位测量的凝视点被转换为显示每个人在空间中注视方向的三维角度。所有信号被下采样到每秒 60 帧并同步,然后以简单、开放的格式存储。最终数据集按模态组织——动作、凝视、音频、文字和如响度与音高等韵律特征,并附有清晰的文件命名规则,便于研究者跨三名参与者追踪任一时刻的所有信号。

数据集揭示的群体谈话特征

利用 Multi-TPC,作者对三人会话如何展开进行了初步的统计概览。他们测量了发言轮次与静默,发现典型的发言轮次持续约 2.7 秒,相邻的停顿略超一秒。他们还将点头与摇头视为听者反馈,平均约每秒发生四分之一次点头或摇头——这表明听者在不发言的情况下持续传达注意力与态度。凝视分析显示,人们很少长时间直接注视他人面部。相反,他们常常稍微偏开视线,而且凝视模式会随说话者是谁、是否有停顿或是否有多人同时说话而变化。在重叠发言期间,参与者的凝视更均匀地分布或远离两位对话者,这暗示了对话话语权的不确定性。

该资源对未来技术的重要性

通过将这些信息层合并为一个有良好文档且可共享的数据集,Multi-TPC 为研究小组如何通过言语与动作管理轮流发言、注意力与反馈提供了新基础。对普通读者而言,结论是会话的“舞蹈”——谁在何时发言、谁看向何处以及细微的点头如何塑造对话流——现在被细致记录。对科学家与开发者而言,这为构建在群体场景中更像真人反应的虚拟角色与社交机器人,以及更深入研究我们如何通过声音、身体与凝视相互协调,打开了大门。

引用: Lee, MC., Deng, Z. Multi-TPC: A Multimodal Dataset for Three-Party Conversations with Speech, Motion, and Gaze. Sci Data 13, 429 (2026). https://doi.org/10.1038/s41597-026-06819-x

关键词: 多模态会话, 手势与凝视, 社交交互数据集, 轮流发言, 虚拟代理