Clear Sky Science · zh

使用高效 Metropolis-Hastings 算法在深度学习中获得可靠的不确定性估计

为何更智能的不确定性很重要

从医学影像到自动驾驶,现代人工智能常在那些自信但错误可能带来危险的场景中作出决策。标准的深度学习系统在识别模式方面表现出色,但在说明自身不确定性方面常常很差。本文致力于缩小这一差距:提出新的方法,使深度神经网络具备可靠的不确定性度量,同时将传统贝叶斯方法的巨大计算开销控制在可接受范围内。

从猜测到有据的置信

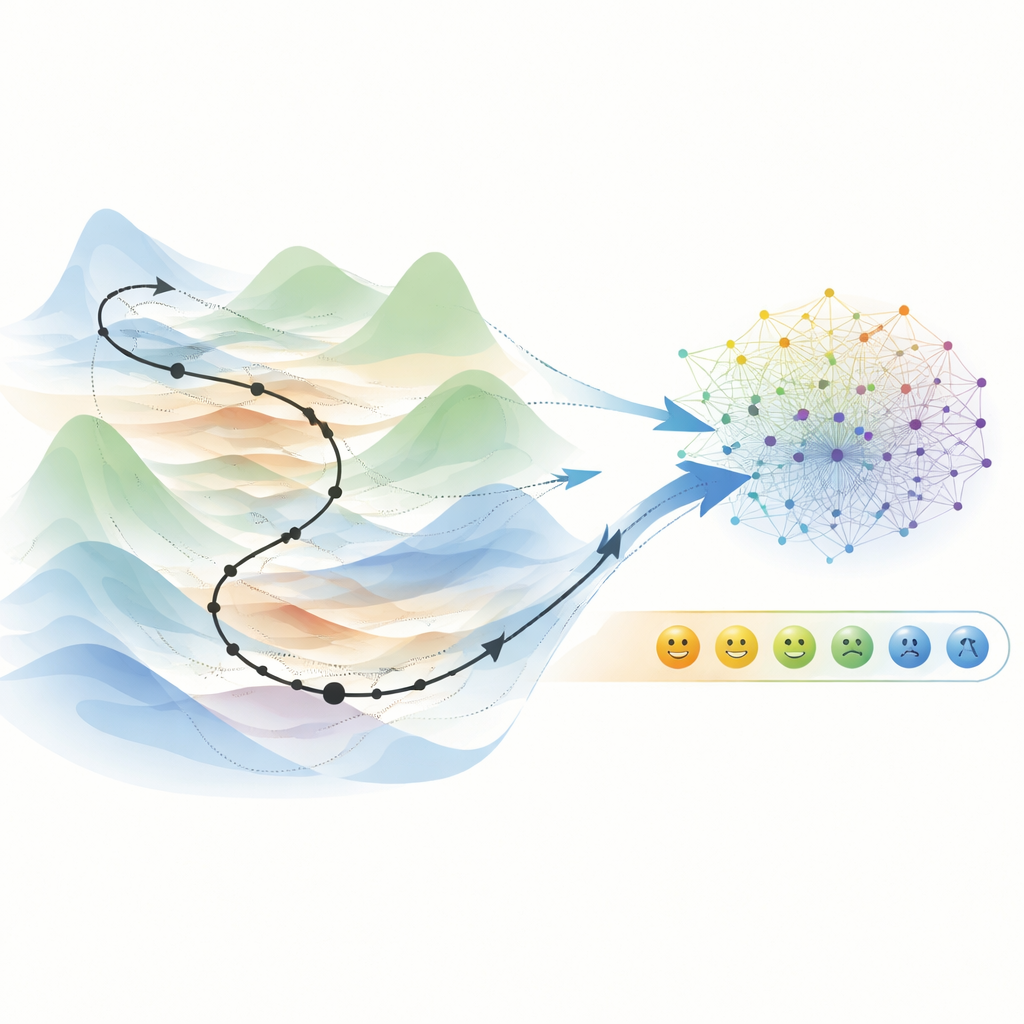

在日常的深度学习中,模型通常训练一次然后直接使用。它会输出一个单一的最佳猜测,但很少给出该猜测可信度的判断。贝叶斯神经网络走的是另一条路:不是固定一组参数,而是把参数视为随机变量,尝试刻画一整套可能的模型分布。对这些模型的预测求平均,既能显示最有可能的答案,也能揭示模型应有多少自信。难点在于,用像哈密顿蒙特卡罗这样的黄金标准方法准确地从该分布中抽样,对如今的大网络和大数据集来说代价极高。

更快的采样而不丢失全局视角

作者们关注一类方法,称为随机梯度哈密顿蒙特卡罗(stochastic gradient Hamiltonian Monte Carlo),该方法已经借鉴了标准训练中的思想——小批量和带噪声的梯度——以加速采样。缺失的成分是一个可靠的“过滤器”,用于决定哪些试探性的参数更新应被保留。在经典的哈密顿蒙特卡罗中,这一角色由 Metropolis-Hastings 的接受步骤担当,它能纠正数值误差并防止采样器漂移到错误区域。把这种接受步骤引入带噪声、小批量的深度学习环境很困难,因为它通常需要对全数据集进行评估,并且当接受率太低时可能阻碍进展。

两种新的行走策略

本文提出了两种互补的策略。第一种称为广义随机梯度哈密顿蒙特卡罗(GSGHMC),设计了一种可在小批量上运行的接受测试,同时保留了一个重要性质:对完整问题的真实极值仍能被正确识别。它采用精心选择的数值积分器,使得逐步接受在仅看到数据切片的情况下也能保持稳定。这样得到的采样器高效且接近真实的贝叶斯图景,能够生成具有良好校准置信度分数的模型集合。

利用长轨迹提高预测质量

第二种方法,称为哈密顿轨迹集成(Hamiltonian Trajectory Ensemble, HTE),则做出了一种有意的权衡:它不坚持完全的贝叶斯行为,而是偏向于在参数空间中进行长时间、受动量驱动的行走,这类似于激进的训练过程。在每条轨迹结束时,采用类似 Metropolis 的检验来决定是否保留该模型快照。因为这些路径倾向于落在损失地形中宽广且可泛化的低谷,所以收集到的模型形成了多样但集中的集合。在图像分类基准(如 EMNIST 和 CIFAR-10)上,HTE 在强贝叶斯基线之上最多可提升约六个百分点的准确率,并且比普通的确定性训练提高若干个百分点,同时仍能提供有用的不确定性信息并在检测域外输入方面表现良好。

更小的集合,更聪明的使用

在测试时采样数百或数千个模型听起来代价很高,因此作者们还研究了实际需要多少集合成员。通过贪婪地丢弃对性能影响很小的模型,他们发现通常可以保留大约三分之一的集合而不损害准确率,尽管要维持非常精确的校准通常需要更多成员。在图像任务和一个混沌时间序列预测问题上,他们的方法持续优于或匹配诸如变分推断、蒙特卡罗 dropout 和更简单的深度集成等流行替代方法,尽管训练成本高于普通的确定性学习。

这对真实世界的人工智能意味着什么

对于非专业读者,核心信息是我们可以让深度学习不仅更准确,而且更诚实地表明它不知道什么,而无需超级计算机级别的资源。通过将经典采样思想巧妙地融入现代基于小批量的训练,这两种方法在效率、鲁棒性和校准不确定性方面结合良好,比许多现有技术提供了更好的预测和更值得信赖的置信估计。这种组合是将深度学习安全部署到那些过度自信代价可以用生命衡量——而不仅仅是百分点——的敏感领域的一步关键进展。

引用: Schmal, M., Mäder, P. Reliable uncertainty estimates in deep learning with efficient Metropolis-Hastings algorithms. Nat Commun 17, 2531 (2026). https://doi.org/10.1038/s41467-026-70015-z

关键词: 贝叶斯神经网络, 不确定性估计, 哈密顿蒙特卡罗, 深度学习集成, 随机梯度 MCMC