Clear Sky Science · zh

用于视觉分布外建模的 7T 合成图像 fMRI 数据集

这对理解视觉与人工智能为何重要

我们的眼睛每天接收形形色色的图像,从森林与面孔到路牌和屏幕噪点不等。然而,大多数关于大脑和人工智能的研究都建立在视觉世界的狭窄切片上:自然场景的照片。本文介绍了一种新型大脑数据集,有意跳出这种舒适区,使用精心设计的合成图像来严苛检测我们对人类视觉的理论以及受其启发的 AI 模型。

搭建新的视觉测试平台

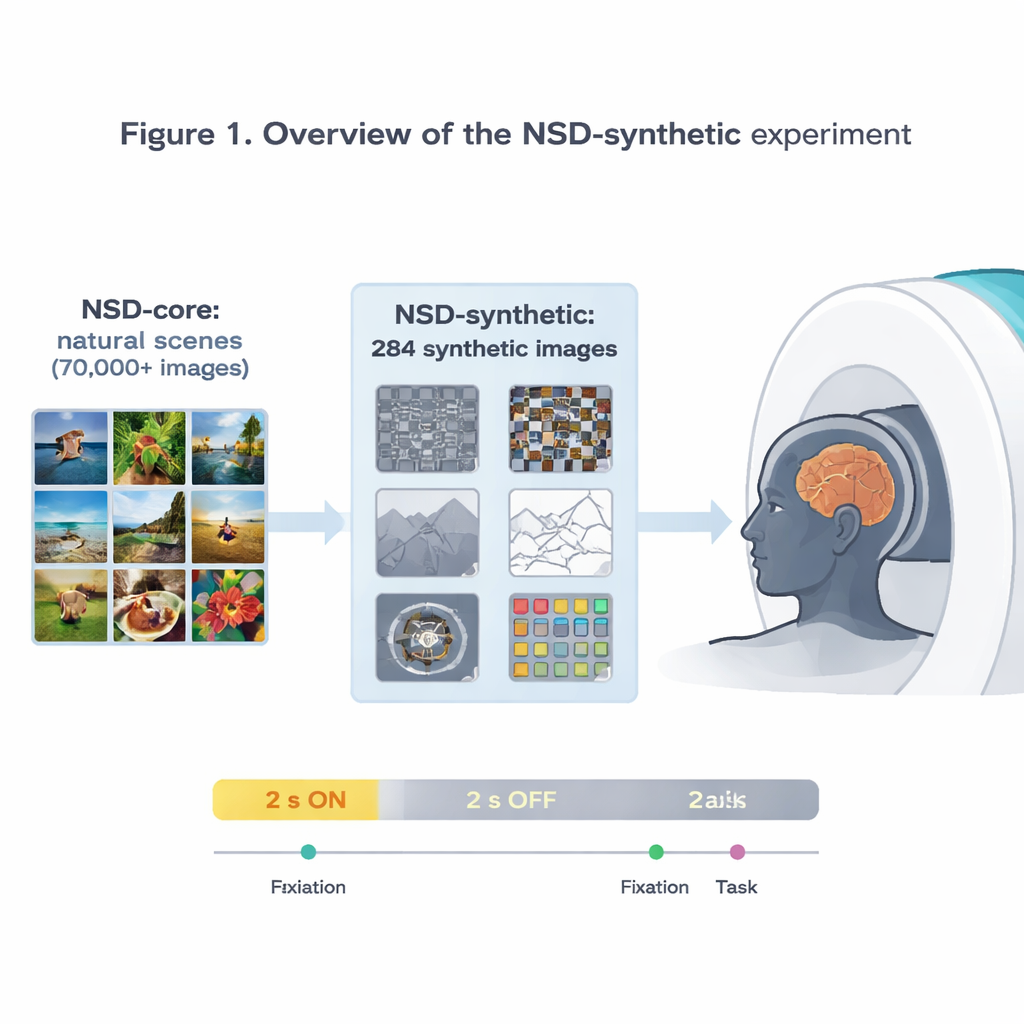

作者扩展了具有影响力的自然场景数据集(NSD),该数据集在 7 特斯拉超高分辨率 MRI 下记录了受试者观看数万张照片时的大脑活动。原始数据集已经推动了对视觉皮层如何响应图片的一些最准确模型的发展。但由于这些图像大多是相对普通的照片,很难判断一个在 NSD 上表现良好的模型是真正捕捉了视觉的一般性原理,还是仅仅对那类图像“饮食”产生了专门化。为了解决这一点,研究团队再次扫描了同样的八名志愿者,这次向他们展示 284 张刻意超出常见照片范畴的“合成”图像。

奇异图像,可靠的大脑响应

这些合成图像涵盖八大类:不同类型的视觉噪声、简单的自然场景及其变体(如颠倒或线描)、对比度降低或相位打乱的场景、在不同位置放置的单词、用于探测对精细图案敏感性的螺旋光栅,以及鲜艳色彩的噪点块。在受试者要么注视一个微小闪烁点、要么执行简单图像比较任务时,研究者每 1.6 秒测量一次大脑活动。结果显示,这些看起来奇怪的刺激仍能产生强烈且可靠的信号,尤其是在对边缘、对比和颜色等基本特征有反应的早期视觉区。皮层活动模式与已知的专门化区域偏好相符,例如对置于中央的单词响应最强的文字选择区,以及对环境图像响应最强的场景选择区。

证明数据确为“分布外”

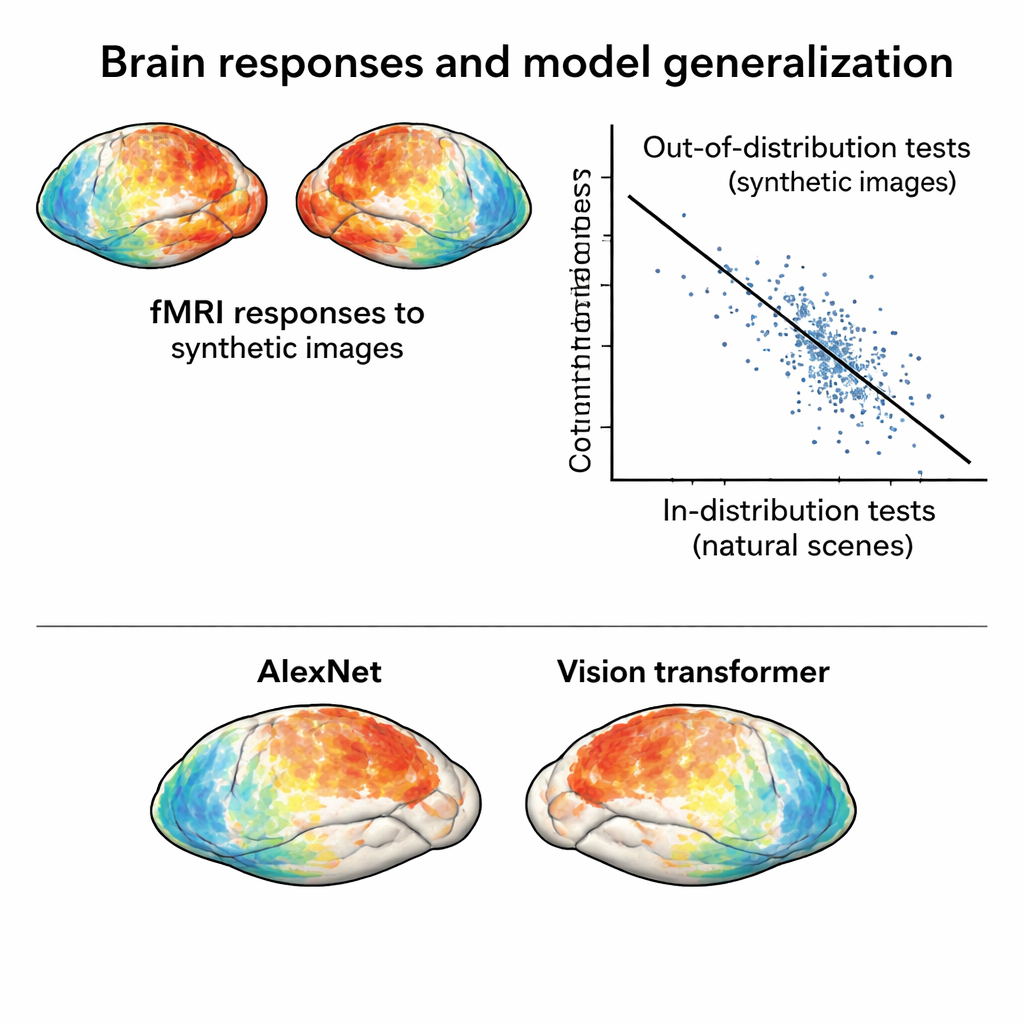

要使这一新数据集能挑战模型,其引发的大脑反应必须确实不同于自然照片引发的响应。作者将原始 NSD 与合成实验的活动模式压缩到一个二维映射上,该映射反映了不同图像间响应的相似性。在该空间中,合成图像的响应与自然照片的响应分别聚类,即使在考虑扫描会话差异的情况下也如此。此外,合成图像按视觉类型自然分组——噪声与噪声聚在一起,光栅与光栅聚在一起——表明大脑根据这些刺激的底层结构组织它们,而不仅仅依据表面外观。

将大脑与 AI 模型置于更严苛的考验

有了这个新的“分布外”数据集,团队训练了标准的编码模型:用来从深度神经网络提取的图像特征预测大脑响应的数学工具。仅在自然照片上训练的模型在类似照片的测试中表现良好,但在预测合成图像的响应时准确度明显下降。这种性能下降并非由于数据噪声——合成响应实际上非常干净——而是模型真实失效所致。关键是,在这些更严苛的条件下比较不同神经网络架构会揭示在分布内测试中几乎看不出的差异。例如,当面临合成图像时,现代视觉 Transformer 和自监督网络都优于经典卷积网络,这表明模型的训练方式强烈影响其鲁棒性。

模型能走多远,超出熟悉图像的范围?

作者进一步将与训练数据的“距离”视为一个连续变量,而非二分标签。他们衡量每幅图像的大脑响应在自然场景响应云团中的远近。某幅合成图像在该空间中越远,模型的表现通常越差,也越难仅凭大脑活动准确识别出被试看到的是哪张图像。他们还展示了即使在普通照片的世界中,巧妙选择的测试集也可表现为“轻度分布外”:模型在与训练集属于同一簇的图像上表现最好,在与之较远的自然场景上表现较差,而在合成刺激上表现最差。这种分级图景将新数据集变成一个工具,用于探查当前模型究竟漏掉了哪些视觉结构。

这对未来大脑与 AI 研究意味着什么

对非专业读者而言,关键结论是:在熟悉图片上表现出色,并不能保证一个受大脑启发的 AI 模型真正捕捉了我们的视觉机制。通过与原始 NSD 一并发布 NSD‑synthetic,作者提供了一个公开的“碰撞测试跑道”给视觉模型:在图像变得更抽象、更丰富色彩或更不自然时,观察它们在哪里崩溃。由于该数据集是开放获取并与已有的广泛使用资源紧密集成,它很可能成为测试和改进人类视觉理论及模拟该机制的人工网络的标准基准。

引用: Gifford, A.T., Cichy, R.M., Naselaris, T. et al. A 7T fMRI dataset of synthetic images for out-of-distribution modeling of vision. Nat Commun 17, 1589 (2026). https://doi.org/10.1038/s41467-026-69345-9

关键词: 视觉皮层, fMRI 数据集, 合成图像, 分布外, 深度神经网络