Clear Sky Science · zh

大型语言模型的马赛克记忆

为什么“近似复制”很重要

像 ChatGPT 这样的大型语言模型从海量文本中学习,有时会记住其中的片段。这引发了关于隐私、版权以及我们如何公平评估这些系统实际知识的担忧。本文表明,记忆并不仅仅是完全的复制粘贴。相反,语言模型可以从多种略有不同的版本重建段落,就像拼接马赛克一样。理解这种隐蔽的记忆形式对关心安全、可靠人工智能的人至关重要。

一种新的机器记忆视角

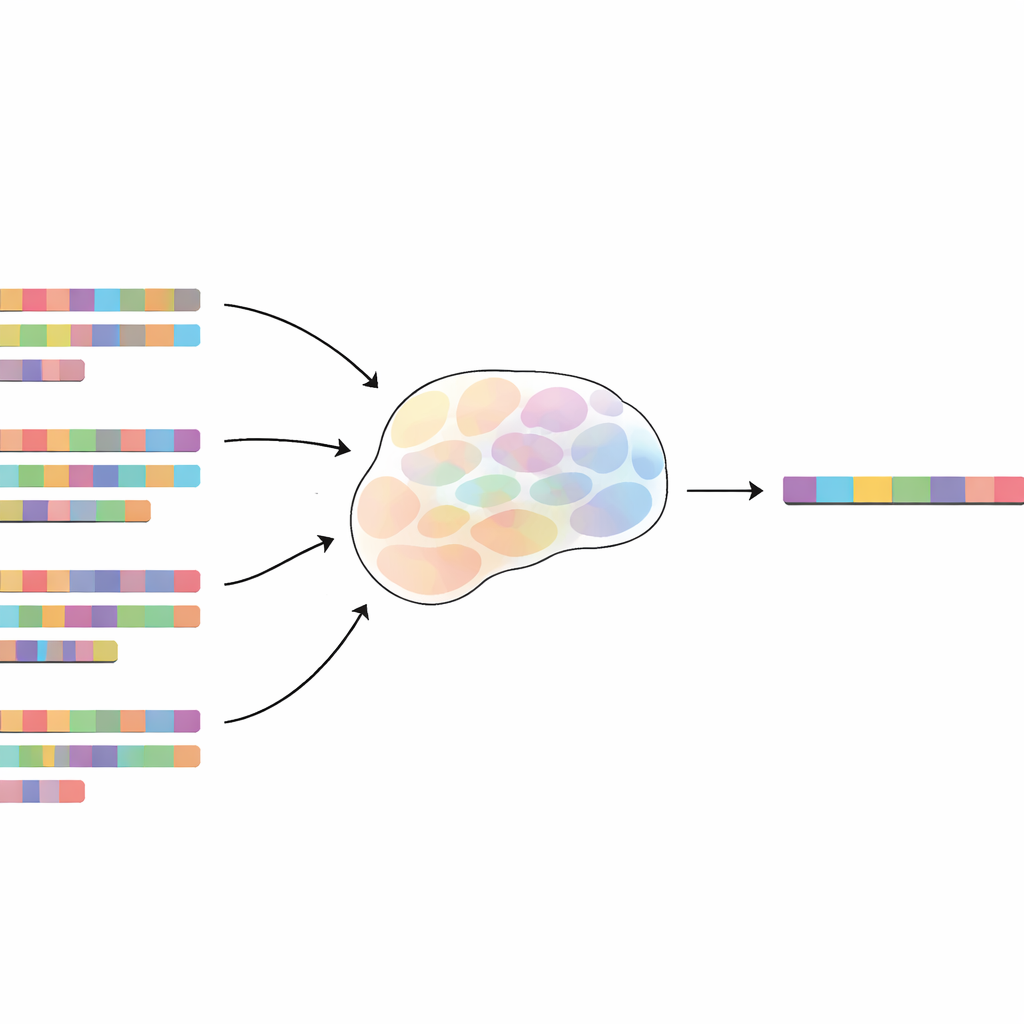

大多数人以为只有模型多次看到完全相同的句子时才会记住它。作者通过引入“马赛克记忆”来挑战这一观点。在这种观点下,模型可以不仅仅从完全重复中记住一段 100 字的文本,还可以从许多模糊重复中记住——这些版本中一些词被删除、替换或打乱。为了仔细研究这一点,他们在模型的训练数据中植入了人工测试短语,称为“金丝雀”,并加入了许多被修改的版本。训练完成后,他们使用一种称为成员推断攻击的隐私测试来衡量判断某个金丝雀是否存在于训练集中的难易程度。

模糊复制为何仍会留下清晰痕迹

通过将模糊重复与完全重复比较,研究人员定义了“等效完全重复”:衡量一个模糊副本与一个完美副本相比对记忆贡献多少。他们发现即便是非常轻微的改动也几乎不会削弱记忆。如果每个副本中大约 10% 的词被随机替换,一个模糊副本仍然贡献约 60–65% 的等效值。即使有一半的词被更改,每个改动版本仍然相当于大约 15–20% 的完整副本。该效应很稳健:在关键短语之间加入随机填充词或将句子片段打乱会降低记忆效果,但不会消除它。模型似乎能够忽略噪音,关注重叠片段,并将它们拼接回去。

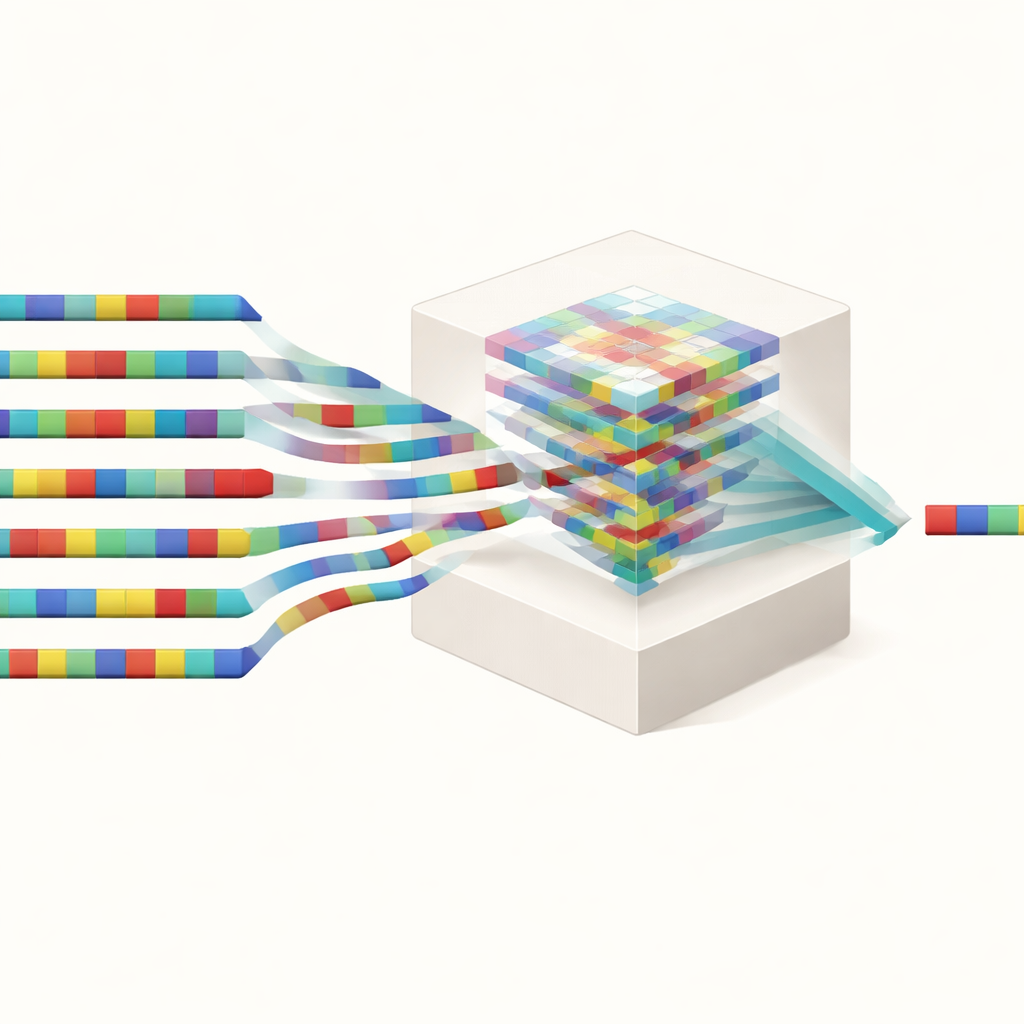

模型存储主要是形式而非意义

考虑到现代语言模型能解数学题、遵循指令并在语言之间翻译,人们可能会认为它们的记忆与意义相关。但令人惊讶的是,研究发现恰恰相反。当作者用保持句子含义的替代词替换词语时,与用随机词替换相比,记忆仅略有提高。由其他 AI 系统生成的意译——保留相同思想但改变许多表面细节——除非仍与原始段落共享许多短词序列,否则对记忆的贡献相对较少。在一系列测试中,真正驱动记忆的是精确标记(模型的基本子词单元)上的重叠,而不是共享的思想。换言之,模型的马赛克记忆主要关于形式,而非意义。

真实训练数据中的隐蔽重复

接着,作者考察了在一个流行且经过大量清洗的用于训练语言模型的网页数据集 SlimPajama 中,模糊重复有多常见。尽管该数据集已经移除近似相同的文档,研究团队发现许多恰好出现 1,000 次的 100 标记序列也有成千上万的近似版本。对于小的编辑距离——大约 10% 的字符被更改——平均上模糊重复的数量约为精确重复的 4 倍,而在更大但仍有影响的距离上则多出数万条。重要的是,业界常用的“去重”技术通常只删除长的精确重叠,这会放过大多数这些模糊副本。这意味着模型仍然可以通过从许多略有改动的来源拼凑来记住敏感或受版权保护的材料。

对隐私、公平性与控制的意义

这些发现具有广泛影响。就隐私而言,它们表明仅仅从训练数据中清除精确重复并不够:个人或机密信息可以通过一族相似段落被记住。就版权和基准测试而言,模糊重复可能导致模型复现受保护文本,或通过以掩饰形式看到的测试材料人为提高得分。对于“去学习”特定数据的努力来说,仅删除一个问题示例并不足以,如果许多变体仍然存在。总体而言,这项工作揭示了语言模型记忆是由许多小重叠构成的复杂马赛克,这对现有的安全工具提出了挑战,并呼吁开发更智能、更细粒度的训练数据清理与审计方法。

引用: Shilov, I., Meeus, M. & de Montjoye, YA. The mosaic memory of large language models. Nat Commun 17, 2142 (2026). https://doi.org/10.1038/s41467-026-68603-0

关键词: 语言模型记忆化, 模糊重复, 数据隐私, 训练数据去重, 基准数据污染