Clear Sky Science · zh

用于动态光场显示的单视图神经照明估计与编辑

为什么你的虚拟世界应与客厅相匹配

任何戴过虚拟或混合现实头显的人都会注意到这一点:数字物体看起来格格不入,光照和阴影与所在房间并不协调。本文旨在解决这一问题。作者提出了一种方法,使头显能够仅凭单个相机视图“理解”你真实环境中的光照,然后利用这些信息让虚拟物体看起来确实属于你的世界——无需特殊的光探针、复杂的采集或繁重的重新校准。

让空间中的光更易处理

在物理学和计算机图形学中,场景的外观由完整的“光场”决定:空间中每个方向上流动的所有光线。精确重建该光场通常需要大量数据,需多张图像和精细测量。现代 3D 技术如神经辐射场可以将场景存储在神经网络中,但通常会把采集时存在的光照“烘焙”进去。这意味着虚拟场景仅在原始条件下看起来正确,当真实房间的光照变化时就会失真。作者的目标是突破这一限制:从最少的数据中找到对真实世界照明的紧凑描述,然后用它灵活地对神经 3D 场景进行重光照。

教头显读懂房间光照

框架的第一部分是计算光学感知(COP)模块,旨在从单张相机视图读取光照。COP 并不重建整个光场,而是关注主导光源:其方向和强度。一个多尺度神经网络扫描输入图像以寻找物理提示——明亮反射、明暗渐变和阴影——同时一个特殊的插值步骤校正了相机压缩亮度的非线性方式。由此得到的数值估计更忠实于场景中的真实能量。第二阶段称为语义解析器,会进一步精炼这些数值并生成对光照的简短文本式描述(例如,光来自上方并偏右)。数值与文字的组合使估计更稳定,也便于在后续阶段使用。

用新光重绘物体

有了这种紧凑的照明描述,第二个模块——生成光传输合成(GLTS)——接手工作。GLTS 从现有的 3D 神经表示开始,该表示先在原先烘焙的光照下渲染一次。在推断出的光方向、强度和文本描述的引导下,一个生成网络“重绘”该视图,使高光和阴影与新环境相匹配。为了让结果既真实又与物体细节相符,GLTS 融合了两类引导:来自照明参数的全局控制和直接从观测图像提取的细节。通过专门的训练过程,仅关注单个物体对不同光照的响应,模型学会以物理合理的方式移动反射并软化阴影边缘,而不是简单地应用通用风格滤镜。

从多视图构建一致的 3D 光场

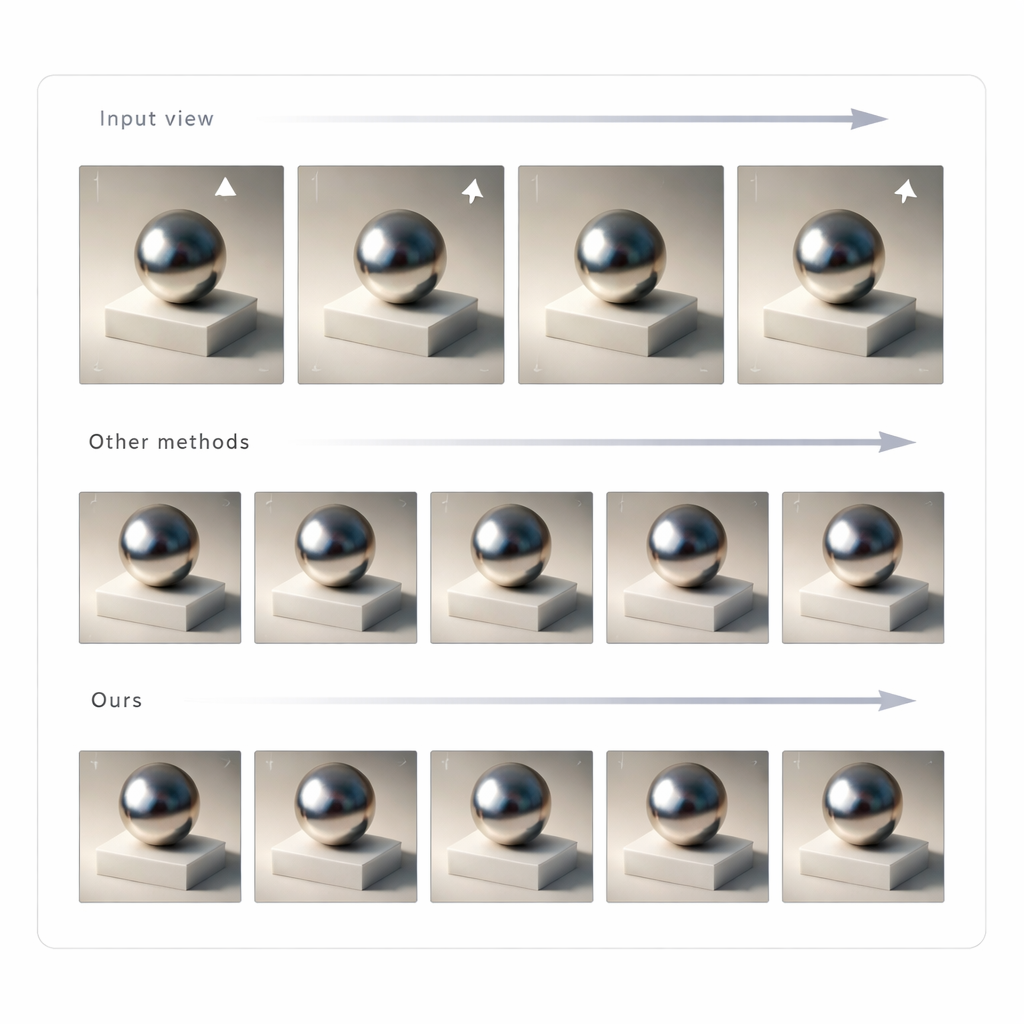

仅改变单张图像不足以令人信服地实现混合现实;随着你移动头部,光照必须保持一致。为此,作者使用 GLTS 从多个视点生成一组重光照图像,然后将这些图像作为重建 3D 场景的目标。一个联合优化过程同时调整神经 3D 表示和虚拟相机位置,使得渲染新的模型能再现所有合成视图。这一步纠正了生成网络引入的细微畸变,并生成一个从任意角度看起来稳定且可信的一致 3D 资源。该团队将其方法与若干最先进的重光照方法进行了比较,发现其在像素级别和基于感知的指标上都能更清晰地与真实图像一致,且阴影与反射更自然。

这对未来头显意味着什么

对非专业读者来说,关键结论是:这项工作展示了未来的 VR、AR 和混合现实设备如何仅凭头显摄像头的一瞥,便能将虚拟内容适配到真实世界的光照条件中。系统无需繁琐的采集设置或为每个新场景重新训练定制模型,而是估计主要光照条件、重生成在这些条件下应有的场景外观,并重建一致的 3D 表示。结果是虚拟物体的亮度、光泽和阴影会像真实物体那样对环境做出响应,为混合现实体验从叠加式图形向更像真实世界补充的方向迈进。

引用: Hong, X., Xie, J., Sheng, J. et al. Single-view neural illumination estimation and editing for dynamic light field display. Light Sci Appl 15, 147 (2026). https://doi.org/10.1038/s41377-026-02234-4

关键词: 混合现实照明, 神经光场, 单视图重光照, 虚拟现实显示器, 计算成像