Clear Sky Science · tr

Akut psikiyatri bakımında saldırganlık öngörülerinin makine öğrenimi ile adalet analizi

Gerçek insanlar için neden önemli

Hastaneler, travmatik kısıtlama yöntemlerine başvurmadan zararları önlemeyi umarak hangi hastaların saldırganlaşabileceğini tespit etmek için yapay zekâya yöneliyor. Ancak bu tahmin araçları adil değilse, kimlerin “tehlikeli” olarak görüldüğünü zaten şekillendiren eşitsizlikleri daha da kötüleştirebilirler. Bu çalışma acil bir soruyu gündeme getiriyor: bir makine psikiyatri servisinde kimlerin yüksek riskte olduğuna karar vermeye yardımcı olduğunda, tüm hastalara eşit davranıyor mu?

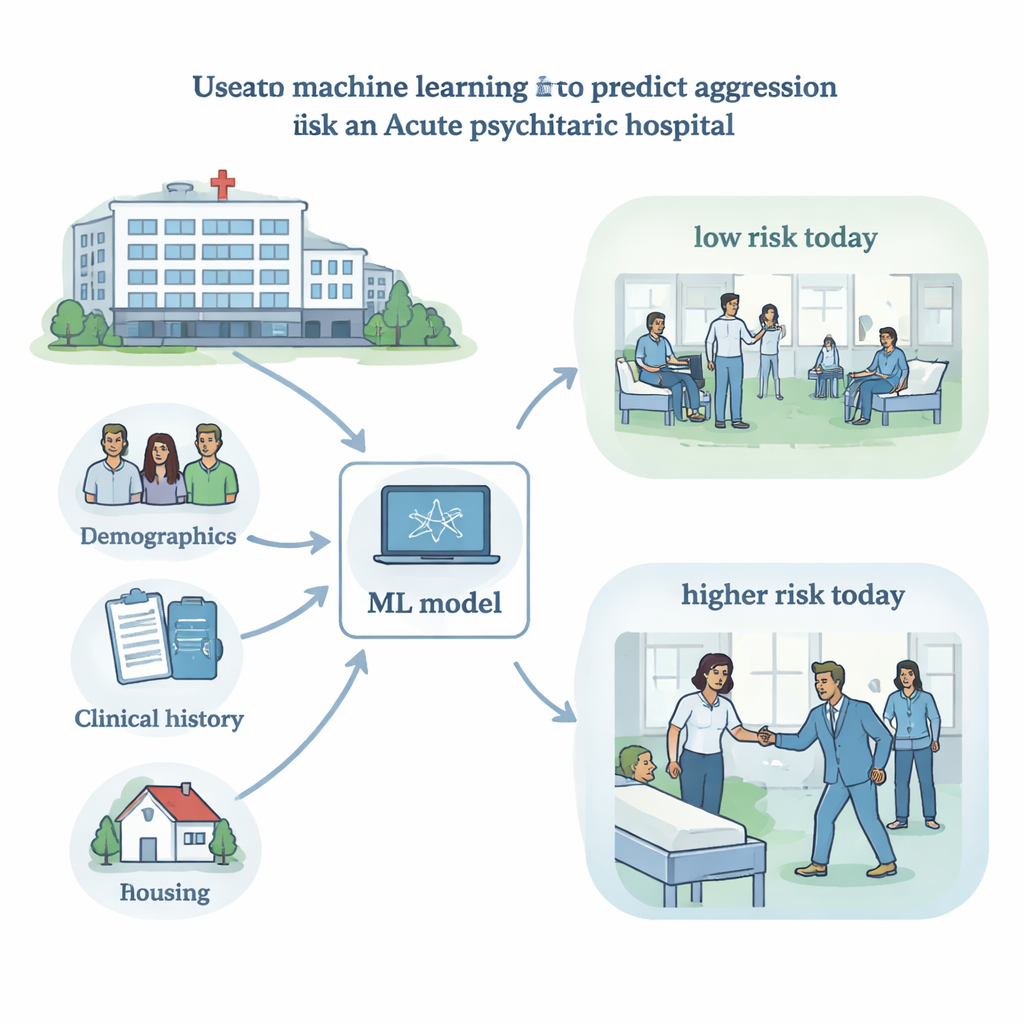

Kısa vadeli riski işaretlemek için hastane verilerinin kullanımı

Araştırmacılar, 2016–2022 yılları arasında büyük bir Kanada ruh sağlığı hastanesinin akut psikiyatri birimlerinde tedavi gören 17.000’den fazla hastanın kayıtlarını inceledi. Bir hastanede kalış sırasında en çok üç güne kadar, personel Dinamik Durumsal Saldırganlık Değerlendirmesi (DASA) adı verilen standart bir yatak başı kontrol listesini kaydetti; bu liste sinirlilik veya sözlü tehditler gibi yakın zamanda meydana gelmesi muhtemel saldırganlığı işaret edebilecek davranışları puanlıyor. Ekip bu puanları kabulde toplanan tanı, yaş, cinsiyet, ırk veya etnik köken, barınma durumu ve kişinin hastaneye geliş biçimi gibi bilgilerle birleştirerek hastanın sonraki 24 saat içinde bir saldırganlık olayıyla (kısıtlama veya tecrit kullanımı dahil) ilişkili olup olmayacağını tahmin eden bir makine öğrenimi modeli eğitti.

Tahmin aracının genel performansı

En iyi performans gösteren sistem, rastgele orman (random forest) adı verilen yaygın bir makine öğrenimi yöntemini kullandı. Ayrılmış test verileri üzerinde yüksek riskli günleri çoğu zaman doğru sıraladı ve yaklaşık 0.81 civarında bir “eğri altı alan” (AUC) elde etti; bu, psikiyatrideki benzer araçlarla karşılaştırılabilir bir düzey. Ancak saldırganlık nadirdi—her olay içeren güne karşı yaklaşık 33 olaysız gün vardı—dolayısıyla model hâlâ birçok gerçek olayı kaçırdı ve bazı yanlış alarmlar üretti. Önemlilik ölçümleri, demografilerden ziyade anlık klinik faktörlerin, özellikle sinirlilik ve önceki son olaylar gibi DASA maddelerinin tahminlere en güçlü katkıyı sağladığını gösterdi. Bu, modelin klinik olarak anlamlı uyarı işaretlerini yakaladığını gösterse de performans ölçütleri tek başına herkes için eşit derecede güvenilir olup olmadığını ortaya koymadı.

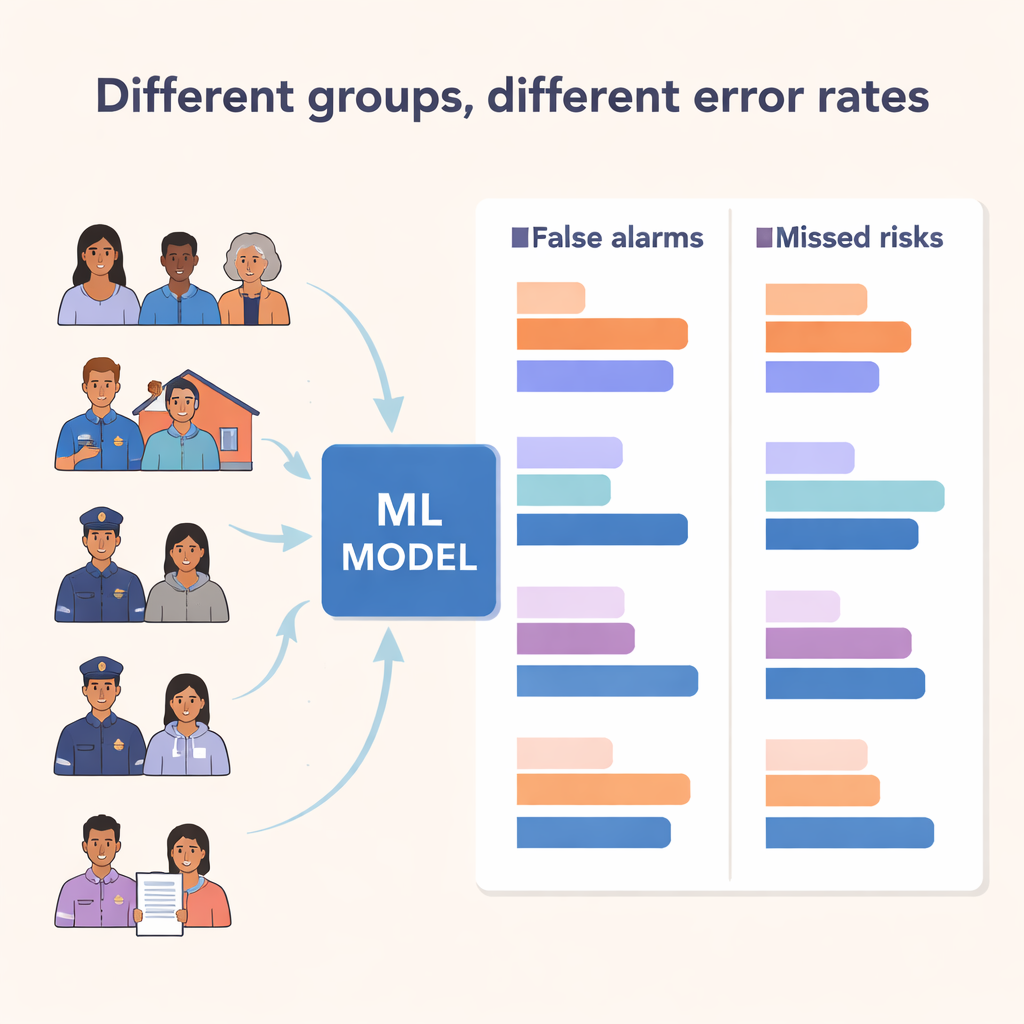

Farklı gruplar arasında eşitsiz hatalar

Çalışmanın özünde bir adalet kontrolü vardı. Ekip, modelin risk işaretlediği ama hiçbir şeyin olmadığı yanlış pozitifler ile modelin doğru bir şekilde bir olayı önceden tahmin ettiği doğru pozitifler olmak üzere iki hata türüne odaklandı. “Eşitlendirilmiş olasılıklar” (equalized odds) olarak bilinen yaygın bir standarda göre adil bir modelin, gruplar arasında benzer yanlış pozitif ve doğru pozitif oranlarına sahip olması gerekir. Bunun yerine araştırmacılar büyük farklılıklar buldu. Yanlış pozitifler Orta Doğulu ve Siyah hastalar, erkekler, polisin getirdiği kişiler ve evsiz veya destekleyici konutlarda yaşayanlar için daha yüksekti. Bazı gruplar—örneğin polisin getirdiği hastalar veya istikrarsız barınma durumu olanlar—hem daha yüksek tespit oranlarına hem de daha yüksek yanlış alarmlara sahipti; bu, modelin onlar için ekstra hassas olacak şekilde ayarlandığını düşündürüyor. Diğerleri, örneğin Siyah hastalar, daha fazla yanlış alarm ve gerçek riski doğru tanıma konusunda daha zayıf bir yetenek gibi endişe verici bir birleşim yaşadı.

Kimlikler kesiştiğinde uçurumlar genişliyor

İnsanların deneyimleri birden fazla özellik tarafından aynı anda şekillendirildiğinden, araştırmacılar ayrıca ırk veya etnik köken ile cinsiyetin birleşimi gibi örtüşen kimlikleri inceledi. Burada en büyük kırmızı bayrak Orta Doğulu erkekler için ortaya çıktı; bu grup herhangi bir grubun en yüksek yanlış pozitif oranına sahipti, oysa Orta Doğulu kadınlar böyle bir oran göstermiyordu. Siyah ve Yerli erkekler de aynı kökenden olan kadınlara kıyasla yükselmiş yanlış pozitiflerle karşılaştı. Bu desenler, belirli ırksallaştırılmış gruplar ve erkekler arasında daha yüksek polis müdahalesi, zorunlu yatış ve yanlış tanı gibi iyi belgelenmiş ruh sağlığı hizmeti eşitsizliklerini yansıtıyor. Makine öğrenimi sistemi bu eşitsizlikleri yaratmadı, ancak bunlarla dolu verilerden öğrendi—ve klinik kararlarda bunları güçlendirme riski taşıdı.

Bu, psikiyatride gelecekteki yapay zekâ için ne anlama geliyor

Yazarlar, herhangi bir öngörüsel araç uygulamaya konulmadan önce adalet analizinin isteğe bağlı bir ek değil, temel bir güvenlik kontrolü olarak ele alınması gerektiğini savunuyor. Eğitim verilerini ayarlamak veya farklı gruplar için farklı uyarı eşiklerini belirlemek gibi teknik “önyargı giderme” yöntemlerinin yardımcı olabileceğini, ancak alttaki kayıtlar zaten eşitsiz muamele ve zorlayıcı uygulamaları yansıtıyorsa bunların sınırlı olduğunu belirtiyorlar. Sonuçta, hangi modelin “adil” sayılacağına karar vermek sadece matematiksel bir problem değil; hastalar, klinisyenler ve toplulukların katılımını gerektiren toplumsal ve etik bir sorudur. Bu çalışma, makine öğreniminin kısa vadeli saldırganlık riskini belirlemede yardımcı olabileceğini, ancak adalet titizlikle ölçülüp tartışılmadıkça ve ele alınmadıkça yapısal ırkçılık, cinsiyetçilik ve barınma eşitsizliklerini sessizce yeniden üretebileceğini gösteriyor.

Atıf: Wang, Y., Sikstrom, L., Xiao, R. et al. Fairness analysis of machine learning predictions of aggression in acute psychiatric care. npj Mental Health Res 5, 16 (2026). https://doi.org/10.1038/s44184-026-00194-6

Anahtar kelimeler: algoritmik adalet, psikiyatrik saldırganlık, sağlıkta makine öğrenimi, sağlık eşitsizlikleri, risk tahmin modelleri