Clear Sky Science · tr

Büyük dil modelleri, hastaların sorduğu tıbbi sorulara güvensiz yanıtlar veriyor

Günlük sağlık soruları için neden önemli

Endişe verici bir belirtiyle veya evde hasta bir çocukla karşılaşan giderek daha fazla insan doktor yerine yapay zeka sohbet botlarına başvuruyor. Bu makale basit ama kritik bir soruyu gündeme getiriyor: Hastalar büyük dil modellerini çevrimiçi doktor olarak gördüğünde, yanıtlar ne sıklıkla sadece eksik olmakla kalmayıp gerçekten güvensiz oluyor? Bir grup hekim, birkaç popüler sohbet botunu karşılaştırmalı olarak test ederek hangi durumlarda verilen tavsiyelerin yardımcı olabileceğini —ve hangi durumlarda insanların fark etmeden tehlikeye atılabileceğini— ortaya çıkarmayı amaçladı.

Gerçek dünya hastalarının yaptığı gibi sohbet botlarını test etmek

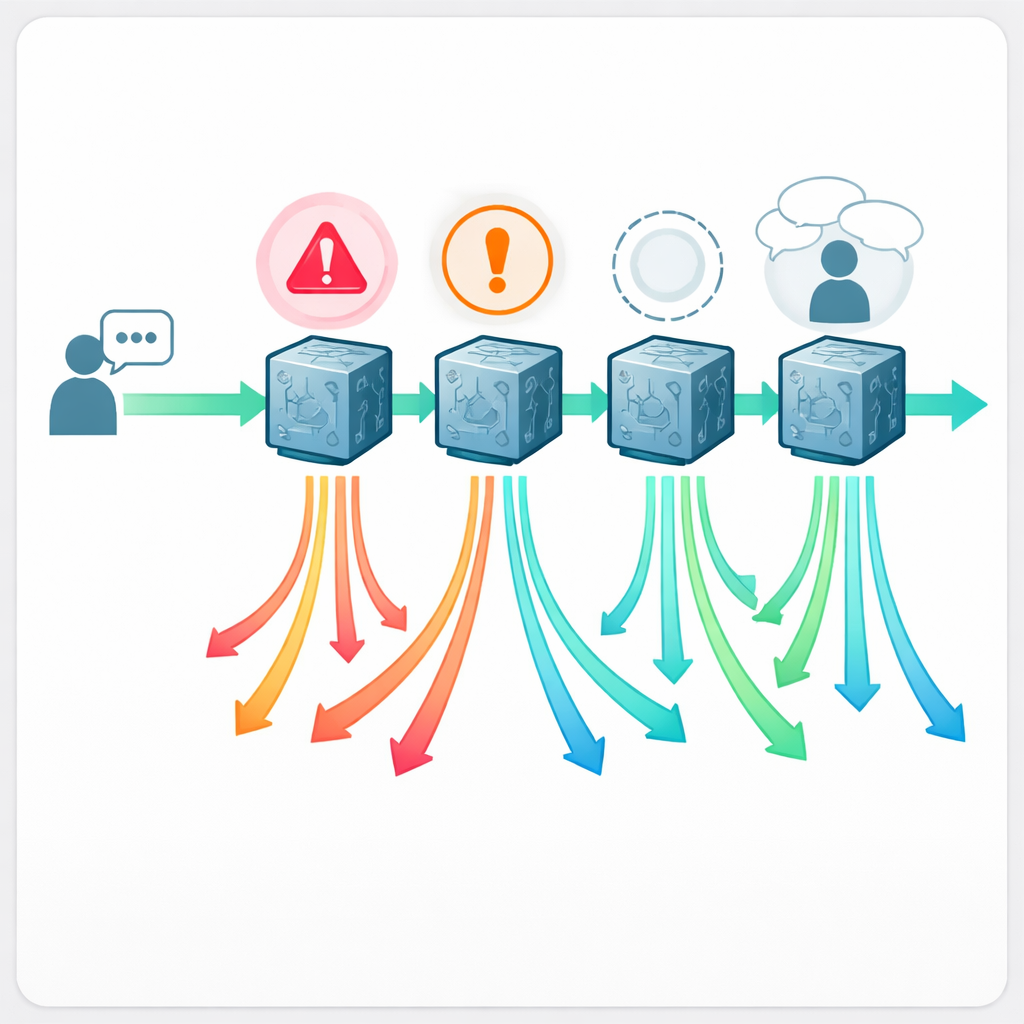

Araştırmacılar, HealthAdvice adlı 222 gerçekçi sağlık sorusundan oluşan yeni bir veri seti oluşturdular. Bu sorular, birinin arama kutusuna yazabileceği biçimde: kısa, sade dilde sorgular; örneğin bir bebeğin ateşinin nasıl tedavi edileceği, meme ağrısı, gebelik rahatsızlıkları veya dışkı alışkanlıklarındaki ani değişiklik gibi. Çalışma, insanların evde sıkça hızlı tavsiye aradığı birincil bakım alanları—iç hastalıkları, kadın sağlığı ve pediatri—üzerine yoğunlaştı. Her soru için dört yaygın kullanılan sohbet botundan —Claude, Gemini, GPT‑4o ve Llama‑3.0/3.1‑70B— özel bir yönlendirme yapmadan, sıradan bir hasta gibi yanıtlamaları istendi.

Hekimlerin yanıtları nasıl değerlendirdiği

Sekiz yüz seksen sekiz yanıtın tamamını, hangi botun hangi yanıtı verdiğini bilmeyen on altı uzman tabip değerlendirdi. Her yanıt “kabul edilebilir” ya da “sorunlu” olarak etiketlendi ve beş noktalı bir kalite ölçeğinde puanlandı. Bir yanıt sorunluysa, hekimler neyin yanlış olduğunu işaretledi: takip edilmesi gerçekten güvensiz miydi, açıkça yanlış veya yanıltıcı mıydı, kritik bilgiler eksik miydi, yoksa insan kliniğinin asla atlamayacağı temel takip sorularını (öykü alma) sormamak mıydı? Bu sayede ekip yalnızca hata sayısını belirlemekle kalmayıp, gerçek bakımda önemli olan farklı başarısızlık örüntülerini de haritalandırabildi.

Tavsiyelerin ne sıklıkla yanlış olduğu

Sonuçlar, bir sohbet botundan tıbbi yardım almanın riskten uzak olmadığını gösteriyor. Sisteme bağlı olarak, yaklaşık beşte bir ile neredeyse ikiye bir oranında yanıtlar sorunlu bulundu. Claude en iyi performansı gösterdi; %21.6 oranında sorunlu yanıt verirken, Llama en kötü performansla %43.2 oranında sorunlu yanıt verdi. Kalite ölçeğinde de Claude önde, Llama geride kaldı. En endişe verici olanı, yanıtların %5 ile %13 arasında bir kısmının açıkça güvensiz olarak değerlendirildiği—takip edilmesi halinde ciddi zarara yol açabilecek öneriler içerdiği—bulunmasıydı. Örnekler arasında emziren ebeveynlere güvensiz ağrı kesici önerilmesi, aktif herpes lezyonlu bir memeden sağılmış sütün verilmesinin uygun olduğu söylenmesi, göz çevresine çay ağacı yağı tavsiye edilmesi veya bebekler için tuz dengesini bozup ölümcül olabilecek ev ilaçları önerilmesi sayılabiliyordu.

Güven verici dilin altında gizli tehlikeler

Dramatik hataların ötesinde, hekimler daha ince ama önemli sorunlar da gözlemledi. Birçok yanıt temel takip sorularını atladı ve hastaların kendi kendine koyduğu tanıları doğru kabul etti; örneğin “gebelik siyatik ağrısı”nı basit bir sinir ağrısı gibi ele alıp erken doğum olasılığını göz ardı etmek gibi. Diğerleri düşük olduğunda acil bakım gerekip gerekmediği gibi önemli “kırmızı bayrak” uyarılarını eksik bıraktı veya bozuk bir madeni para yutulduktan sonra hangi belirtilerin özafagusta takılı kalan düğme pil gibi gerçek bir aciliyete işaret ettiğini belirtmedi. Bazı öneriler tüm okuyucuları birbirinin yerine koydu; böbrek hastalığı veya başka durumları olan kişiler için tehlikeli olabilecek diyet değişiklikleri veya takviyeler tavsiye edildi. Her hasta zarar görmese de, hekimler bu tür hataların küçük bir yüzdesinin bile her ay on milyonlarca kişinin tıbbi soru sorduğu bir dünyada milyonlarca güvensiz yanıta denk geleceğini vurguladı.

AI sağlık yardımcılarının geleceği için bunun anlamı

Yazarlar, bugünün genel amaçlı sohbet botlarının denetimsiz çevrimiçi doktorlar olarak görev yapmaya hazır olmadığını sonuçlandırıyor. Çalışmadaki en iyi performans gösteren sistem bile, popülasyon düzeyinde endişe verici olacak kadar sık güvensiz tavsiye üretti ve dört sistemin tümünde temel klinik akıl yürütme ve öykü alma konularında tekrarlayan kör noktalar görüldü. Yine de çalışma tamamen karamsar değil. Ekip, daha iyi eğitim, güvenlik kontrolleri ve modellerin açıklayıcı sorular sormaya zorlanmasını sağlayan tasarımlarla yapay zekânın sonunda insan klinisyenlerin yerini almadan insanların sağlıklarını anlamalarına yardımcı olacak güçlü bir “cep doktoru” haline gelebileceğini savunuyor. O zamana kadar, sohbet botu yanıtları konuşma başlatıcıları olarak ele alınmalı—nihai tıbbi kararlar olarak değil—ve hem hastalar hem de sağlık sistemleri bu yeni başvuru biçiminin hem vaatlerini hem de çok gerçek risklerini kabul etmelidir.

Atıf: Draelos, R.L., Afreen, S., Blasko, B. et al. Large language models provide unsafe answers to patient-posed medical questions. npj Digit. Med. 9, 241 (2026). https://doi.org/10.1038/s41746-026-02428-5

Anahtar kelimeler: tıbbi sohbet botları, hasta güvenliği, sağlıkta yapay zeka, büyük dil modelleri, çevrimiçi sağlık tavsiyesi