Clear Sky Science · tr

Büyük dil modelleri ile sağlık profesyonellerinin tanı ve triyajdaki bağımsız ve işbirlikçi performansı

Bir sonraki doktor randevunuz için neden önemli

Belirtilerinizi çevrimiçi bir sohbet botuna yazdığınızda veya bir yapay zeka uygulamasına neyin yanlış olabileceğini sorduğunuzda, doktorların hastanelerde şimdi test ettiğiyle aynı tür bir teknolojiyi kullanıyorsunuz: büyük dil modelleri (LLM’ler). Bu çalışma basit ama hayati bir soruyu soruyor: bu araçlar gerçekten hastalıkları ne kadar iyi teşhis ediyor ve bir vakayı ne kadar acil sayacaklarını nasıl belirliyor—gerçek sağlık profesyonelleriyle kıyaslandığında ve ikisi birlikte çalıştığında ne oluyor?

Araştırmacılar büyük resmi nasıl inceledi

Yazarlar tek bir sohbet botunu tek bir klinikte test etmedi. Bunun yerine 2020 ile 2025 arasında dünyanın farklı yerlerinde yürütülen 50 ayrı çalışmanın kanıtlarını birleştirdiler. Bu çalışmalar göz hastalıklarından beyin görüntülemeye ve acil bakıma kadar pek çok uzmanlık alanını kapsıyordu. Her birinde, doktorlara ve bir veya daha fazla LLM’ye aynı gerçek veya dikkatle tasarlanmış hasta olguları verildi. LLM’lerden olası tanıları önermeleri veya bir hastanın ne kadar hızlı bakıma ihtiyaç duyduğunu belirlemeleri istendi; doktorlar da aynı şekilde değerlendirme yaptı. Bazı çalışmalarda doktorlara ayrıca yapay zekanın önerileri gösterilerek bunun performanslarını iyileştirip iyileştirmediği gözlendi.

Yapay zekâ sistemleri tek başına ne kadar iyi?

Tüm çalışmalar bir arada değerlendirildiğinde, yapay zekâ araçları doğru tanıyı sıklıkla listelerinin bir yerine koyabiliyordu, ancak tek bir cevap seçmeleri istendiğinde genellikle doktorların gerisinde kaldılar. Sadece en iyi tahmin sayıldığında, LLM’ler ortalama olarak sağlık profesyonellerinden yaklaşık %11 daha az doğruydu. İzin verilen tahmin listesi uzadıkça bu fark küçüldü ve sonunda kayboldu—on olası tanıya izin verildiğinde, yapay zekâ sistemlerinin doğru olanı doktorlar kadar olası şekilde listeye dahil etme olasılığı en az onlar kadar yüksekti. Triyaj kararlarında—bir vakanın ne kadar acil olduğunu ve hangi bakım düzeyinin gerektiğini değerlendirmede—yapay zekâ ve insanlar genel olarak benzer performans gösterdi. Ancak bireysel modeller ve test düzenleri arasında sonuçlar büyük ölçüde değişti; bu da bazı araçların diğerlerinden çok daha güvenilir olabileceğine işaret ediyor.

Doktorlar yapay zekâyı bir ekip arkadaşı olarak kullandığında ne oluyor?

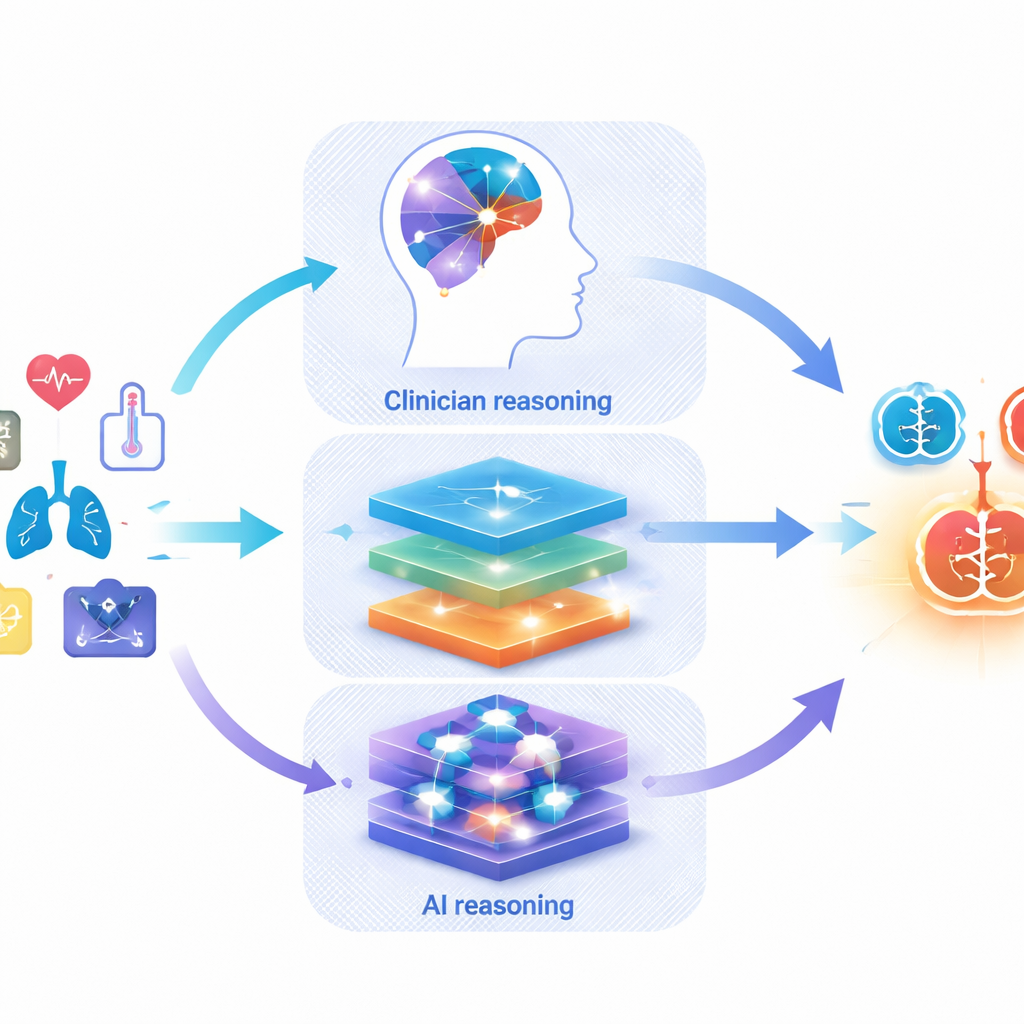

Dokuz çalışma doğrudan işbirliğini inceledi: doktorlar önce yalnız çalıştı, sonra bir LLM’in yardımıyla görevi tekrarladı. Burada haberler cesaret vericiydi. Yapay zekâ desteğiyle doktorlar genel olarak daha doğruydular, özellikle birkaç olası tanı verme izni olduğunda. Örneğin bir LLM yardımıyla, kısa aday listelerindeki doğrulukları, kaç seçenek dikkate alındığına bağlı olarak yaklaşık %10–%40 oranında arttı. Bu, yapay zekânın olasılıkları genişleten ve klinisyenleri daha az bariz durumları düşünmeye iten bir beyin fırtınası ortağı olarak özellikle faydalı olduğunu; nihai kararı ise insan uzmanın verdiğini gösteriyor.

Bugünün sonuçları gerçek hayattan daha iyi görünebilir

Rakamlar umut verici görünse de, yazarlar mevcut çalışmaların çoğunun kusursuzdan uzak olduğunu uyarıyor. Birçoğu düzenli, ders kitabı tarzı olgu özetlerine veya öğretim amaçlı seçilmiş nadir vakalara dayanıyordu; hastaların gerçek kliniklerde sunduğu dağınık, eksik hikâyeler çoğunlukla yoktu. Sadece birkaç çalışma gerçek zamanlı hastalar kullandı. Olguların nasıl seçildiği, yapay zekâ araçlarının nasıl yapılandırıldığı ve yanıtların nasıl değerlendirildiğine ilişkin ayrıntılar sıklıkla eksikti. Görüntüler—taramalar veya deri fotoğrafları gibi—daha az kullanıldı ve yalnızca görüntüler test edildiğinde deneyimli klinisyenler yapay zekâyı açıkça geride bıraktı. Araştırmacılar ayrıca genç klinisyenlerin ve uzmanların yapay zeka önerilerine farklı tepki verebileceğini; veri gizliliği, gizli önyargı ve makine önerilerine aşırı güven gibi konuların günlük uygulamada büyük ölçüde test edilmediğini vurguluyor.

Bu hastalar ve bakımın geleceği için ne anlama geliyor

Genel olarak çalışma, mevcut sohbet botları ve LLM’lerin doktorunuzun yerini alacak kadar hazır olmadığını, ancak yakında değerli yardımcılar haline gelebileceklerini öne sürüyor. Akıllıca kullanıldıklarında, daha geniş olası tanı listeleri oluşturulmasına ve daha doğru karar vermeye yardımcı olabilirler; özellikle doktorlar hâlâ kontrolü elinde tutup yapay zekâyı kesin hüküm yerine ikinci bir görüş olarak gördüğünde. Ancak bu araçlar rutin bakıma entegre edilmeden önce, yazarlar daha iyi tasarlanmış, gerçek dünya denemelerine, daha net raporlama standartlarına ve güvenlik, adalet ve gizlilik etrafında güçlü korumalara ihtiyaç olduğunu savunuyor. Hastalar için bu, yapay zekânın bakım ekibinizin daha geniş düşünmesine ve daha hızlı hareket etmesine yardımcı olabileceği, ancak güvenilir herhangi bir sistemin yeni bir ilaç veya tıbbi cihaz kadar titizlikle test edilmesi gerektiği anlamına geliyor.

Atıf: Chen, M., Wu, Y., Ma, J. et al. Independent and collaborative performance of large language models and healthcare professionals in diagnosis and triage. npj Digit. Med. 9, 222 (2026). https://doi.org/10.1038/s41746-026-02409-8

Anahtar kelimeler: tıbbi tanı yapay zeka, klinik triyaj, büyük dil modelleri, doktor yapay zeka işbirliği, dijital sağlık güvenliği