Clear Sky Science · tr

İnsan–büyük dil modeli işbirliği klinik tıpta: sistematik bir inceleme ve meta-analiz

Günlük Sağlık Hizmetleri İçin Neden Önemli

Hekimler giderek daha güçlü yapay zeka sohbet botlarına, yani büyük dil modellerine, karmaşık vakaları değerlendirmede, not yazımında ve tıbbi testleri yorumlamada yardım için başvuruyor. Bu çalışma basit ama kritik bir soruyu soruyor: hekimler bu araçlarla iş birliği yaptığında hastalar gerçekten fayda sağlıyor mu? En iyi mevcut denemelerin sonuçlarını bir araya getirerek yazarlar, yanıtın abartıldığı kadar basit olmadığını gösteriyor—bazen işbirliği yardımcı oluyor, bazen çok az etkisi oluyor ve bazı durumlarda bile işin önüne geçebiliyor.

Araştırmacıların İncelediği Konular

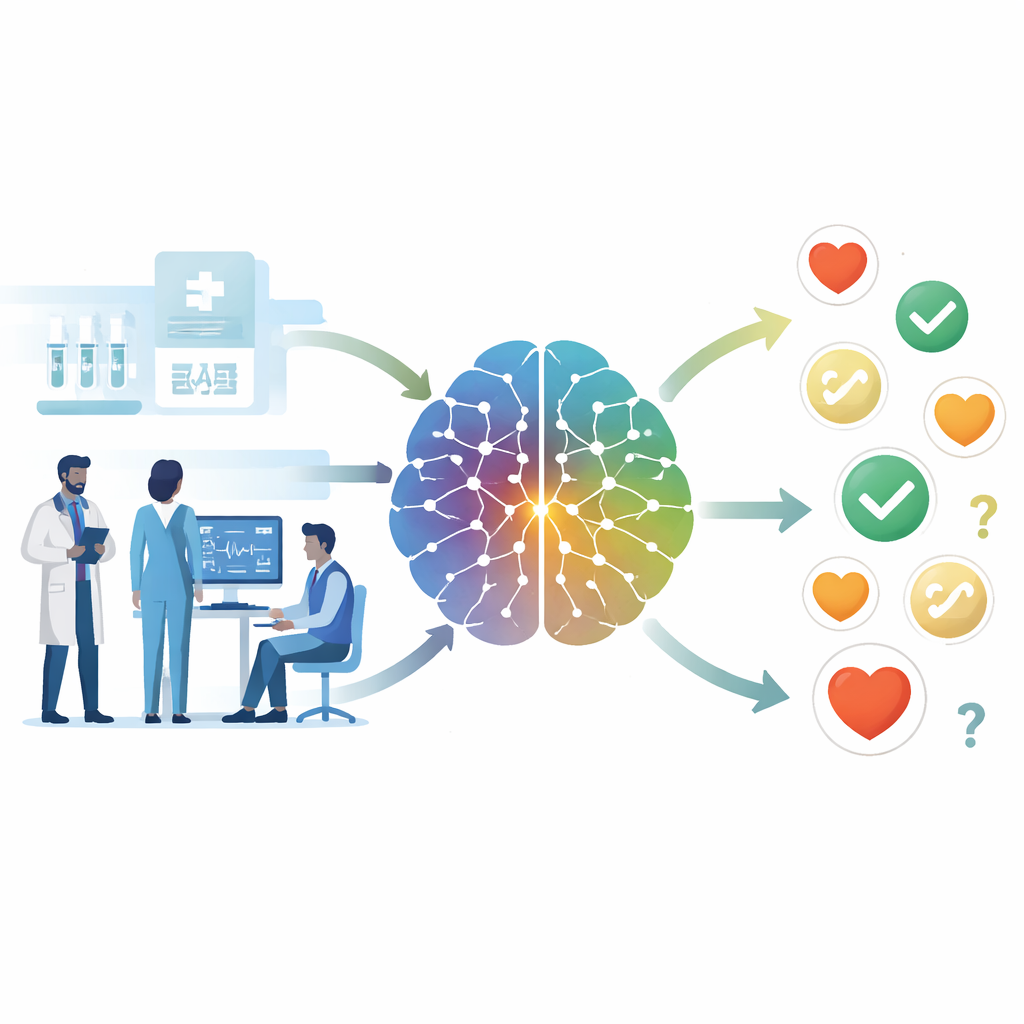

Ekip, GPT-4 gibi büyük dil modelline dayanan bir yapay zeka sisteminin yardımıyla veya onsuz çalışan klinisyenleri karşılaştıran çalışmaları bulmak için büyük tıp veritabanlarını sistematik olarak taradı. Dahil edilebilmesi için bir çalışmanın “hekim artı yapay zeka” iş akışını doğrudan yalnızca hekimlerin sağladığı olağan bakımla ve bazen de yapay zekanın tek başına çalışmasıyla karşılaştırması gerekiyordu. Klinik görevler, ağır hasta tanısı koymaktan beyin görüntülerini yorumlamaya, klinik notların yazılıp okunmasına ve göğüs ağrısı gibi yaygın yakınmaların yönetimine kadar gerçek problemleri kapsıyordu. Toplamda, analizin belkemiğini oluşturan 10 hakemli deneme bulundu; sonuçların sağlamlığını kontrol etmek için birkaç ön baskı çalışması ek olarak kullanıldı.

Hekim–Yapay Zeka Takımlarının Performansı Nasıl Oldu

Bu çalışmaların genelinde, hekimlerle yapay zekanın eşleştirilmesi tanısal ve yönetim kalitesinin bazı ölçülerinde küçük ama dikkat çekici iyileşmeler gösterdi. Vaka kararları için ayrıntılı puanlama sistemleri kullanan iki randomize denemede, hekim–yapay zeka takımları tek başına hekimlere kıyasla yaklaşık beş yüzde puanı daha yüksek puan aldı. Basitçe ifade edilirse, yalnız çalışan hekimler yaklaşık 100 kritik karar veriyorsa, yapay zekanın eklenmesi bu kararlardan yaklaşık beşinin yanlış yapılmasını önleyebilir. Ancak yazarlar altındaki verilerin zayıf olduğuna vurgu yapıyor: bu tahminlere yalnızca birkaç deneme katkıda bulundu ve olası gerçek dünya sonuçlarının aralığı, başka ortamlarda fayda olmamasını—hatta zarara yol açmasını—içerecek kadar geniş.

Hız, Dokümantasyon ve Gizli Hatalar

Birçok kişi yapay zekanın hekimlerin zamanını boşaltacağını umuyor. Burada elde edilen kanıt etkileyici değildi. Görevlerin ne kadar sürdüğünü ölçen üç denemeyi birleştirdiklerinde, esasen hiçbir genel zaman tasarrufu bulamadılar. Bazı simüle edilmiş egzersizlerde hekimler yapay zeka ile biraz daha hızlıydı; gerçek bir klinik çalışmada ise ziyaret süresine net etki neredeyse sıfırdı, ancak bazı alt gruplar mütevazı kazanımlar gördü. Dokümantasyon benzer şekilde “karışık” bir tablo sundu. Yapay zeka yardımı notları genellikle daha net ve daha yapılandırılmış hale getiriyordu ve uzman olmayanların teknik göz bakım raporlarını daha iyi anlamalarına yardımcı oldu. Yine de araştırmacılar gerçekleri kontrol ettiğinde, yapay zeka destekli notların yaklaşık üçte birinin hâlâ hata içerdiğini buldular. Bu ikilik—daha iyi görünen kayıtların hâlâ yanlış olabilmesi—açık güvenlik endişeleri doğuruyor.

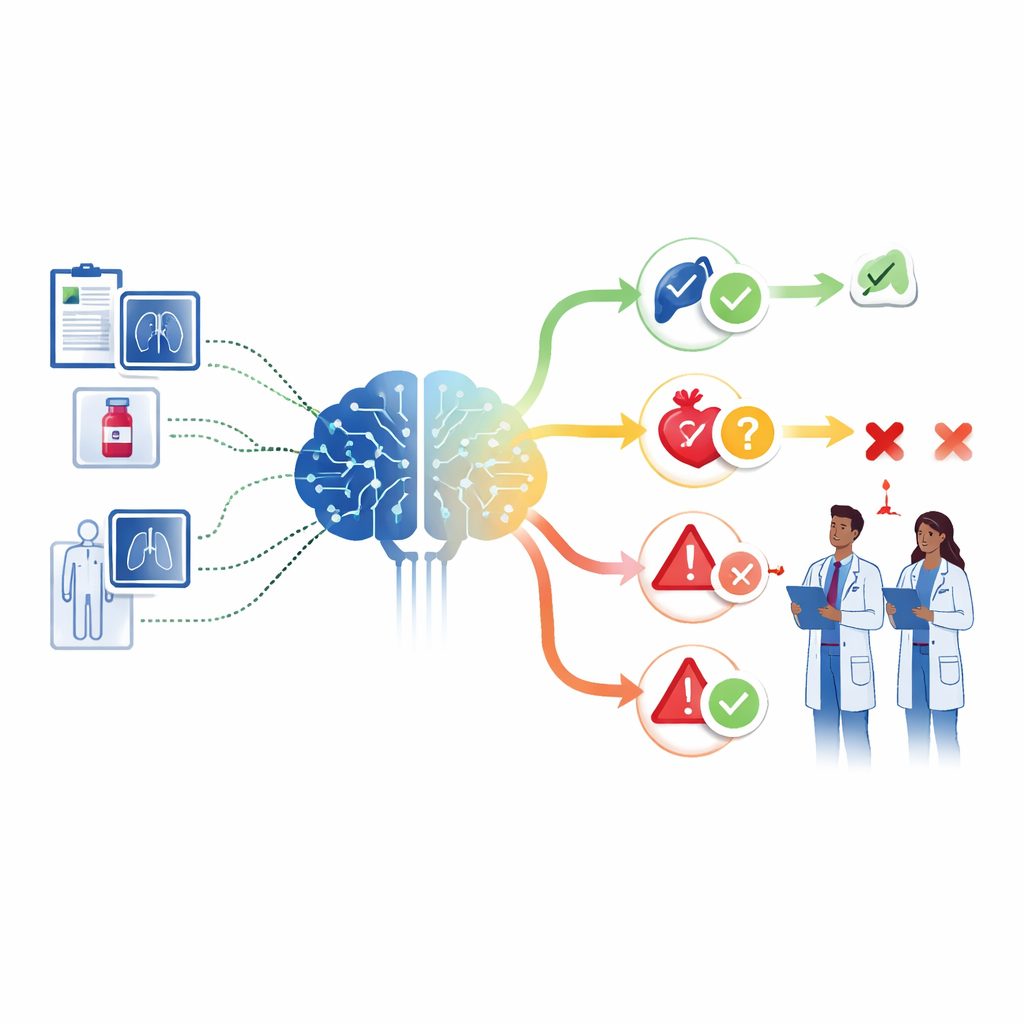

İşbirliğinin Makineyi Yenemediği Durumlar

Dikkat çekici bir bulgu, yapay zekanın tek başına da test edildiği denemelerden çıktı. Ağır hasta çalışmasının birinde, yapay zekanın tek başına performansı hekim–yapay zeka takımı kadar iyiydi ve tek başına çalışan birçok hekimden daha iyiydi. Başka bir çalışmada ise yapay zeka tarafından üretilen test raporları, ister yapay zeka asistan olarak kullanılsın ister kullanılmasın, insan uzmanlarınkinden açıkça daha kötüydü. Birlikte ele alındığında bu sonuçlar yazarların “işbirliği paradoksu” olarak adlandırdığı şeyi açığa çıkarıyor: süreç içine bir insan eklemek güçlü bir yapay zekanın üzerinde otomatik olarak bir iyileşme sağlamıyor ve bazı durumlarda işbirliği her iki tarafın da güçlü yönlerini zayıflatabiliyor. Tavsiyenin nasıl sunulduğu, hekimlerin ona ne kadar güvenip güvenmediği ve aracın günlük iş akışına nasıl yerleştirildiği gibi faktörler, işbirliğinin yardımcı olup olmayacağını etkiliyor.

Hekim–Yapay Zeka Takımlarının Geleceği İçin Ne Anlama Geliyor

Genel olarak, derleme şimdiden gerçekleşmiş bir devrimden ziyade temkinli bir umut tablosu çiziyor. Hekim–yapay zeka takımları bazı karar puanlarını mütevazı şekilde iyileştirebilir ve tıbbi yazıyı daha okunur kılabilir, ancak güvenilir şekilde zaman kazandırmıyorlar ve hâlâ endişe verici sayıda gerçek hata üretiyorlar. Yazarlar, sağlık sistemlerinin bu araçları hataları yakalamaya odaklanan güçlü korunmalarla kademeli olarak uygulamaya koyması gerektiğini savunuyor. Ayrıca yapay zeka desteğini sadece kontrollü vaka simülasyonlarında değil, yoğun hastaneler ve kliniklerde test eden daha büyük gerçek dünya klinik denemeleri çağrısında bulunuyorlar. Böyle kanıtlar gelene kadar en güvenli yol, büyük dil modellerini güçlü ama yanılabilir asistanlar olarak görmektir—ve iş akışlarını, klinisyenlerin yapay zeka önerilerini pasif alıcılar değil eleştirel gözden geçiriciler ve koruyucular olarak davrandığı şekilde tasarlamaktır.

Atıf: Wang, G., Zhang, K., Jiang, J. et al. Human–large language model collaboration in clinical medicine: a systematic review and meta-analysis. npj Digit. Med. 9, 195 (2026). https://doi.org/10.1038/s41746-026-02382-2

Anahtar kelimeler: insan–Yapay Zeka işbirliği, klinik karar desteği, büyük dil modelleri, tanısal doğruluk, tıbbi dokümantasyon