Clear Sky Science · tr

Büyük dil modelleri kullanarak tıbbi cihaz düzenleyici bilimini ölçeklendirmek

Hastalar ve doktorlar için neden önemli

Modern tıp, taramaları okumak, hayati belirtileri izlemek ve doktorlara kararlarında yardımcı olmak için yapay zekâ kullanan “akıllı” cihazlarla hızla doluyor. Yalnızca Amerika Birleşik Devletleri’nde binin üzerinde böyle araç zaten Gıda ve İlaç Dairesi (FDA) tarafından onaylanmış veya kabul edilmiş durumda. Her cihaz karmaşık raporlar ve güvenlik kayıtları bırakan bir belge izi oluşturuyor. Bugün bu bilgilerin çoğu hâlâ elle eleniyor; bu yavaş, pahalı ve gerçekliğin gerisinde kalmaya eğilimli bir süreç. Bu makale, ileri düzey sohbet botlarının arkasındakiyle aynı tür yapay zekâ olan büyük dil modellerinin bu belgeleri ölçekli biçimde güvenilir şekilde okuyup düzenleyicilerin, araştırmacıların ve kamunun bu cihazların nasıl tasarlandığını ve ne kadar güvenli performans gösterdiklerini anlamasına yardımcı olacak kullanılabilir verilere dönüştürüp dönüştüremeyeceğini araştırıyor.

Aşırı sayıda karmaşık belge sorunu

Her yapay zekâ destekli tıbbi cihaz kalın karar özetleri, güvenlik raporları ve geri çağırma bildirimleri ile birlikte gelir. Bu belgeler uzun, yoğun jargonla yazılmıştır ve sıklıkla tablolar, görseller ve tutarsız biçimlendirme içerir. Önceki araştırmalar, bir cihazın onaydan önce nasıl test edildiği ya da arızalandığında tam olarak neyin yanlış gittiği gibi temel sorulara yanıt vermenin yüzlerce PDF’in satır satır okunmasını gerektirdiğini göstermiştir. Basit arama araçları ve desen eşleştirme kimlik numaraları gibi bariz ayrıntıları bulabilir, ancak bir çalışmanın birden fazla hastanede yapılıp yapılmadığı veya bir cihazın gerçekten bir hastanın yaralanmasına ya da ölümüne katkıda bulunup bulunmadığı gibi yargı gerektiren daha derin sorularla zorlanırlar. Yapay zekâ özellikli cihaz sayısı patladıkça, bu manuel yaklaşımı sürdürmek imkânsız hale geldi.

Uzman gibi okuyan bir yapay zekâ hattı

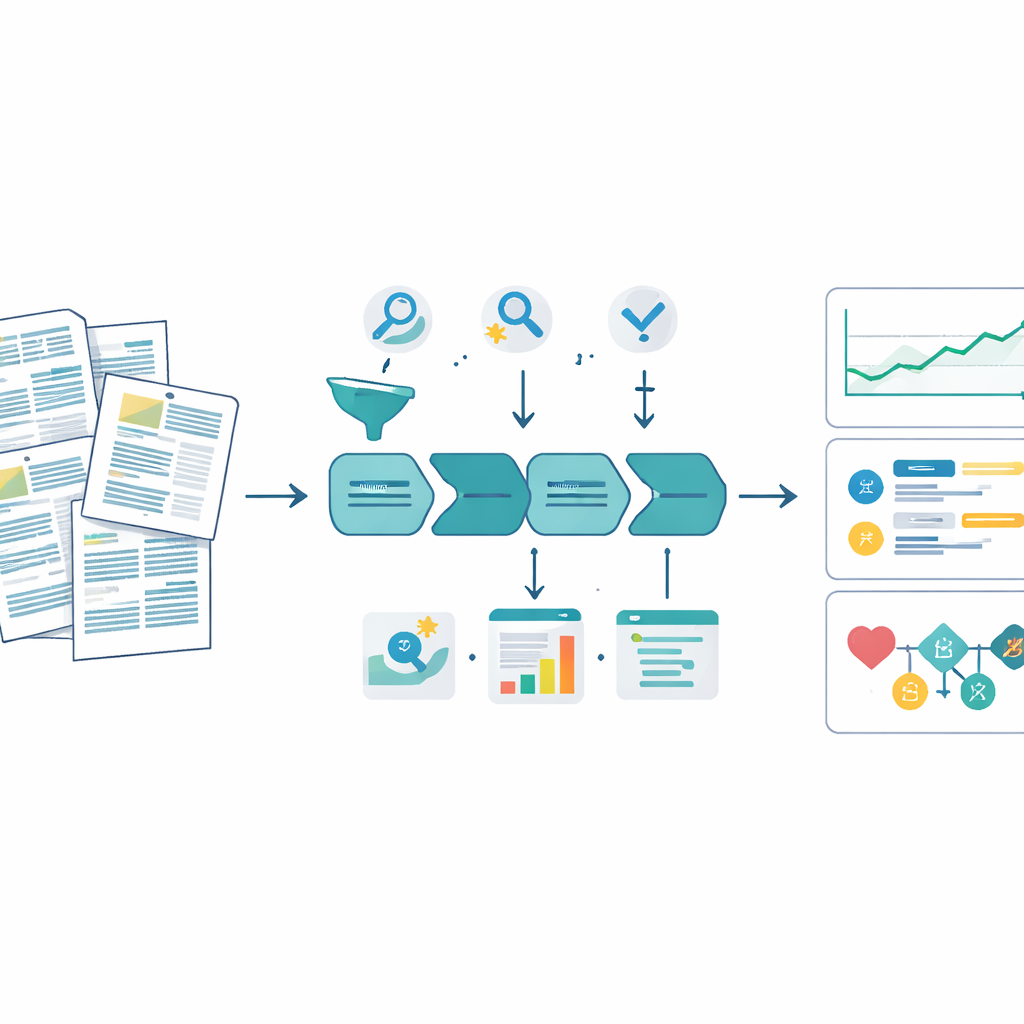

Yazarlar bu zorluğu ele almak için en son teknoloji bir büyük dil modeline dayanan genel bir iş hattı (pipeline) kurdular. Önce, 2025 ortasına kadar 1.247 yapay zekâ veya makine öğrenimi cihazına ait tüm kamuya açık FDA karar özetlerini ve güvenlik raporlarını ile 1.852 ile ilişkili advers olay raporunu bir araya getirip PDF’leri temizlediler ve gerektiğinde optik karakter tanıma kullandılar. Ardından, modeli geniş soruları bir kerede yanıtlamaya zorlamak yerine çalışmayı daha küçük, iyi tanımlanmış alt görevlere böldüler. Her belge türü için model, resmi FDA rehberliğine dayanan ayrıntılı talimatlar ve insanların bilgiyi nasıl etiketleyeceğine dair örnekler aldı. Modelden adım adım akıl yürüterek katı, yapılandırılmış bir formatta çıktılar üretmesi istendi; serbest biçimli metni “çalışma sahası sayısı”, “güvenlik olayı türü” veya “cihaz değişikliği türü” gibi net alanlara dönüştürdüler.

Gerçek düzenleyici sorularda doğruluğu kontrol etmek

Bu sistemin güvenilir olup olmadığını görmek için ekip, daha önceki araştırmacıların aylarca elle inceleme yaptığı üç vaka çalışması yürüttü. İlk olarak, cihazların onaydan önce nasıl test edildiğini yeniden gözden geçirip denemelerin prospektif (ileriye dönük veri toplama) olup olmadığını ve birden fazla hastaneyi kapsayıp kapsamadığını sordular. Model çıktıları ile uzman etiketlerini karşılaştırdıklarında, insan etiketleyiciler arasındaki uyuma benzer şekilde sıklıkla yüzde 80–90’ların üzerinde uyum oranları gördüler. İkincisi, arızalar, yaralanmalar veya ölümlerle ilgili güvenlik raporlarını yeniden etiketlemek ve cihazda neyin yanlış gittiğini sınıflandırmak için modeli kullandılar. İnsan inceleyiciler, üreticinin orijinal kodlarını modelin önerileriyle—hangisinin hangisi olduğunu bilmeden—karşılaştırdıklarında, modelin seçimlerini büyük çoğunlukla tercih ettiler; özellikle ölüm gibi hassas kategorilerde modelin tercihleri öne çıktı. Üçüncü olarak araştırmacılar, onay öncesi belgelerden daha sonraki güvenlik raporlarına ayrıntıları bağlayarak, eski seçimlerin—örneğin geçmiş geri çağırmaları olan bir önceki cihazın seçilmesi veya büyük donanım değişiklikleri yapılması—ilerideki sorun riskine istatistiksel olarak bağlı olup olmadığını incelediler.

Güvenlik ve denetim hakkında bulguların ortaya koydukları

Doğrulandıktan sonra bu iş hattı ekiplerin bu analizleri onlarca cihazdan bilinen tüm yapay zekâ özellikli tıbbi araç popülasyonuna ölçeklendirmesine izin verdi. Örneğin, prospektif klinik değerlendirmelerin üç on yıl boyunca nispeten nadir kaldığını, cihazların yaklaşık onda birinde görüldüğünü, oysa çok merkezli testlerin anılmasının önemli ölçüde arttığını buldular. Güvenlik raporlarında model, metinde tanımlanan problem türü ile FDA’ya gönderilen kodun eşleşmediği örüntüler keşfetti—örneğin donanım arızalarının görüntü kalite sorunları olarak etiketlendiği durumlar. Onay öncesi özellikleri daha sonraki güvenlik olaylarına bağladıklarında, önceki modelleri geri çağırma veya advers olay geçmişi olan cihazların yeni raporlarda çok daha yüksek risk gösterdiğini, oysa klinik testlerle desteklenen cihazların daha düşük risk eğilimi sergilediğini gördüler. Bu sonuçlar keşif niteliğindedir ancak artık rutin olarak sorulabilecek türden soruları değil tek seferlik projeleri gösterir.

Sınırlamalar, güvenceler ve ileriye dönük yol

Yazarlar yaklaşımlarının kusursuz olmadığını ve uzman yargısının yerine geçmemesi gerektiğini vurguluyorlar. Yaklaşık yüzde 80 doğruluk büyük resmi analiz etmek için yeterli olabilir, ancak tek bir cihaz veya hasta hakkında karar vermek için yeterli olmayabilir. Performans cihaz türlerine ve yıllara göre değişebilir ve temel FDA belgelerinin ve güvenlik veritabanlarının kalitesi hâlâ önemli bir darboğazdır. Yine de bu çalışma, dikkatle tasarlanmış dil modeli sistemlerinin yapılandırılmamış düzenleyici metin dağlarını günler içinde yapılandırılmış, denetlenebilir verilere dönüştürebileceğini gösteriyor. Genel okuyucu için çıkarım şudur: tüketici sohbet botlarını güçlendiren aynı yapay zekâ teknolojileri, gözetleyicilerin ve araştırmacıların yapay zekâ tıbbi cihazlarının nasıl inşa edildiğini, test edildiğini ve izlendiğini takip etmelerine de yardımcı olabilir—bu da sorunların daha hızlı tespit edilmesine ve daha güvenli kuralları ve ürünleri şekillendirecek daha iyi kanıtlara yol açabilir.

Atıf: Li, H., He, X., Subbaswamy, A. et al. Scaling medical device regulatory science using large language models. npj Digit. Med. 9, 221 (2026). https://doi.org/10.1038/s41746-026-02353-7

Anahtar kelimeler: Yapay zekâ tıbbi cihazları, düzenleyici bilim, büyük dil modelleri, FDA güvenlik raporları, sağlık teknolojisi denetimi