Clear Sky Science · tr

GWKNN: G metriği yeniden yapılandırması ve Gri Kurt Optimize Edicisi ile geliştirilmiş k-en yakın komşu algoritması

Günümüzün Veri Bolluğu İçin Daha Akıllı Desen Tanıma

Tıbbi taramalardan banka işlemlerine kadar modern yaşam okyanuslarca veri üretiyor. Bu bilgilerin çoğu otomatik olarak kategorilere ayrılmak zorunda: sağlıklı mı hasta mı, sahte mi normal mi, istenmeyen mi gerçek mi. Bu tür görevler için klasik bir işçi at k-en yakın komşu (KNN) algoritmasıdır; yeni bir örneği en benzer geçmiş örneklere bakarak etiketler. Ancak veri kümeleri büyüdükçe, daha karmaşık ve dengesiz hale geldikçe bu basit fikir kırılganlaşıyor. Makale, noktalar arasındaki mesafeleri daha akıllıca kullanan ve nadir ama önemli durumları daha adil ele alan GWKNN adlı yenilenmiş bir KNN sürümünü tanıtıyor.

Basit Benzerlik Neden Yetersiz Kalır

Geleneksel KNN, bir veri noktasının tüm özelliklerinin eşit katkı sağladığını varsayar ve benzerliği standart düz hat uzaklığı ile ölçer. Bu, veriler düşük boyutlu ve düzgün ayrılmış olduğunda iyi çalışabilir, ancak gerçek dünya verileri sıklıkla yüksek boyutlu, gürültülü ve farklı türde bilgiler karışımıdır. Bu durumlarda sıradan uzaklık yanıltıcı olabilir ve algoritmanın yararsız komşuları seçmesine neden olabilir. Aynı zamanda birçok veri kümesi dengesizdir: yaygın kategoriler baskın iken erken evre bir hastalık gibi nadir ama kritik kategoriler az temsil edilir. KNN yakın örnekler arasında oy kullanırken, çoğunluk sınıfı bu azınlık vakalarını boğma eğilimindedir ve taraflı, bazen tehlikeli kararlar ortaya çıkar.

Algoritmaya Daha İyi Bir Uzaklık Hissi Öğretmek

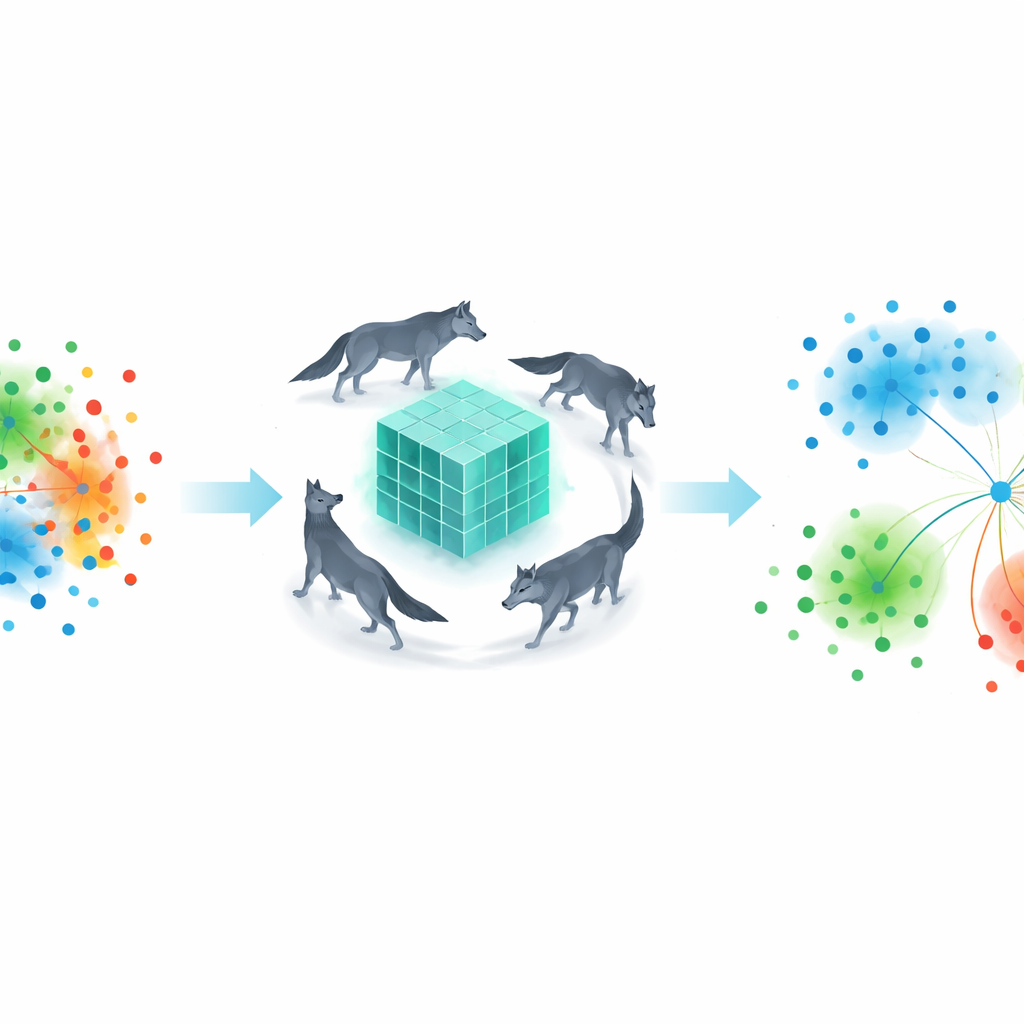

GWKNN’deki ilk büyük yenilik öğrenilmiş bir uzaklık ölçüsüdür. Alışılmış düz hat kuralını sabitlemek yerine, yazarlar algoritmanın kategorileri en iyi ayıracak şekilde veri noktalarının ne kadar uzak olması gerektiğini keşfetmesine izin veriyor. Bunu, bilgilendirici özelliklerin daha fazla, gereksiz olanların ise daha az önem taşıyacağı şekilde uzayı yeniden şekillendiren esnek bir “G metriği” olarak kodluyorlar. Bu metriği ayarlamak için yöntem, gri kurtların avlanma davranışından ilham alan bir sürü zekâsı prosedürü kullanıyor. Gri Kurt Optimize Edicisi (Grey Wolf Optimizer) adı verilen bu süreç, veriş alanını germe ve sıkıştırma yollarını keşfederek sınıflandırma hatalarını azaltan ve matematiksel kararlılığı koruyan çözümleri tutuyor. Birçok yineleme boyunca sanal “kurtlar”, benzer noktaların daha güvenilir kümeler oluşturduğu bir uzaklık kuralına yakınsıyor; bu, yüksek boyutlu, karmaşık veri kümelerinde dahi işe yarıyor.

Nadir Vakaların Sesini Yükseltmek

İkinci geliştirme oy verme önyargısını hedef alıyor. Standart KNN, yalnızca k komşusundan kaç tanesinin hangi sınıfa ait olduğunu sayar ve çoğunluğu seçer. GWKNN bunun yerine her oyu, o sınıfın tüm eğitim verilerindeki yaygınlığına göre ağırlıklandırıyor. Daha az görünen sınıflara daha güçlü ağırlıklar verilir; çok sık görülen sınıflar daha zayıf ağırlık alır. Küçük bir düzeltme terimi, aşırı nadir kategorilerin kararı domine etmesini engeller. Böylece yeni bir veri noktası birkaç azınlık sınıfı örneğine ve birçok çoğunluk örneğine yakınsa, azınlık sinyalleri otomatik olarak boğulmaz. Şema hesaplama açısından basittir ama güçlü bir etkiye sahiptir: sınıflandırıcıyı nadir ama anlamlı desenlere daha fazla dikkat etmeye iter, azınlık sınıfları için adaleti ve geri çağırmayı (recall) iyileştirir.

Yeni Yöntemi Teste Sokmak

GWKNN’nin pratikte gerçekten yardımcı olup olmadığını görmek için yazarlar, bunu iyi bilinen UCI deposundan 12 kıyas veri kümesinde değerlendirdiler. Bu koleksiyonlar finansal veriler, tıbbi ölçümler, el yazısı, bitki tohumları ve hem ikili hem çoklu sınıf sorunları içeren birkaç yüksek boyutlu kanser ve gen ifadesi veri setini kapsıyor. Dört KNN sürümünü karşılaştırdılar: temel çıplak versiyon, yalnızca yeni uzaklık metriğine sahip versiyon, yalnızca yeni oy ağırlıklarına sahip versiyon ve her iki fikri birleştiren tam GWKNN. Ayrıca GWKNN’yi destek vektör makineleri, karar ağaçları, rastgele ormanlar, lojistik regresyon, Naive Bayes ve bir sinir ağı dahil olmak üzere yedi yaygın sınıflandırıcıyla kıyasladılar. Tekrarlı eğitim–test bölmeleri boyunca yalnızca ortalama doğruluğu değil, sonuçların ne kadar dalgalandığını da izlediler.

Sonuçlar: Daha Doğru ve Daha Tutarlı

Bileşik GWKNN yaklaşımı çoğu veri kümesinde en iyi veya en iyi ile eşit performans gösterdi; özellikle çok sayıda özelliğe ve dengesiz sınıf büyüklüklerine sahip olanlarda öne çıktı. Göreceli olarak basit görevlerde tüm yöntemler iyi performans gösterdi ve kazanımlar ılımdı, ancak GWKNN yine de doğrulukta hafif iyileşme ve değişkenlikte azalma eğilimi gösterdi. Binlerce özelliğe sahip daha zor gen ifadesi veri setlerinde avantajlar daha belirgindi: öğrenilmiş uzaklık metriği algoritmanın daha anlamlı komşuluklar oluşturmasına yardımcı oldu ve ağırlıklı oy verme az temsil edilen sınıfların tanınmasını iyileştirdi. Tüm veri kümeleri üzerinde yapılan istatistiksel testler, GWKNN’nin sıralamalarının standart KNN ve bazı klasik modellerden anlamlı biçimde daha iyi olduğunu doğruladı; bu da gelişmelerin yalnızca şans eseri değil, farklı veri koşullarında sağlam olduğuna işaret ediyor.

Günlük Veri Kararları İçin Anlamı

Uzman olmayanlar için çıkarım şu: GWKNN çok sezgisel bir fikri—“benzer geçmiş durumlara bak”—veri odaklı gerçeklikle daha iyi eşleştirmek üzere rafine ediyor. Benzerliği ölçmeyi öğrenerek ve oy verme sırasında nadir kategorilerin etkisini artırarak yöntem hem daha doğru hem de daha adil olmaya çalışıyor. Bu ekstra incelik, özellikle çok büyük ve yüksek boyutlu veri kümeleri için artan hesaplama maliyeti getiriyor olsa da, GWKNN azınlık vakalarının doğru sınıflandırılmasının gerçekten önemli olduğu erken hastalık tespiti veya dolandırıcılık tespiti gibi görevler için güçlü bir potansiyel gösteriyor. Çalışma, klasik algoritmaların optimizasyon ve adalet içgörülerinden yararlanılarak günümüzün bilgi ölçeği ve karmaşıklığıyla başa çıkacak şekilde nasıl yükseltilebileceğini gösteriyor.

Atıf: Guo, Z., Liu, G., Liu, W. et al. GWKNN: an enhanced k-nearest neighbor algorithm with G metric reconstruction and Grey Wolf Optimizer. Sci Rep 16, 8857 (2026). https://doi.org/10.1038/s41598-026-41851-2

Anahtar kelimeler: k-en yakın komşular, uzaklık ölçütü öğrenimi, sınıf dengesizliği, sürü zekası, veri sınıflandırma