Clear Sky Science · tr

Gizli Homomorfik Şifreleme ile Sağlık AI’sında Federated Learning için Stokastik Poisson‑gömülü gizlilik çerçevesi

Makineleri Eğitirken Tıbbi Sırları Güvende Tutmak

Hastaneler, COVID‑19 gibi hastalıkları daha erken ve daha doğru tespit etmeye yardımcı olabilecek çok sayıda röntgen görüntüsü topluyor. Ancak bu görüntüler son derece kişisel nitelikte ve sıkı gizlilik düzenlemeleri, güçlü yapay zeka (AI) araçlarını eğitmek için verileri tek bir yerde toplamakta zorluk çıkarıyor. Bu çalışma, hastanelerin ham görüntülerini kimseye vermeden ortak bir röntgen tanı sistemi üzerinde işbirliği yapmasına imkân tanıyan bir yöntem gösteriyor; amaç hasta verilerini kilitli tutarken yüksek doğruluk elde etmektir.

Tıbbi Veri Paylaşmanın Neden Bu Kadar Zor Olduğu

Modern AI, büyük ve çeşitli veri kümeleriyle gelişir, ancak hastaneler genellikle görüntüleri yerel olarak depolar ve bunları merkezi bir sunucuya göndermeye isteksiz ya da yasal olarak yetkisizdir. Tüm verileri tek bir veritabanına kopyalamaya dayanan geleneksel yaklaşımlar, sızıntı ve siber saldırı risklerini artırır, kamu güvenini zedeler ve düzenlemeleri ihlal eder. Hastanelerin ortak bir modeli birlikte eğittiği “federated learning” gibi daha yeni yöntemler bile tam güvenlik sağlamaz: zeki saldırganlar bazen model güncellemelerinden geriye doğru çalışarak hasta görüntülerinin nasıl göründüğünü tahmin edebilir. Aynı zamanda tıbbi veriler sıklıkla dengesiz ve dağınıktır; bazı hastanelerde belirli bir hastalığın örnekleri diğerlerinden çok daha fazla olabilir, bu da eğitimi dengesizleştirip güvenilirliği azaltabilir.

Ham Röntgenleri Hiç Paylaşmayan İşbirlikçi Bir Ağ

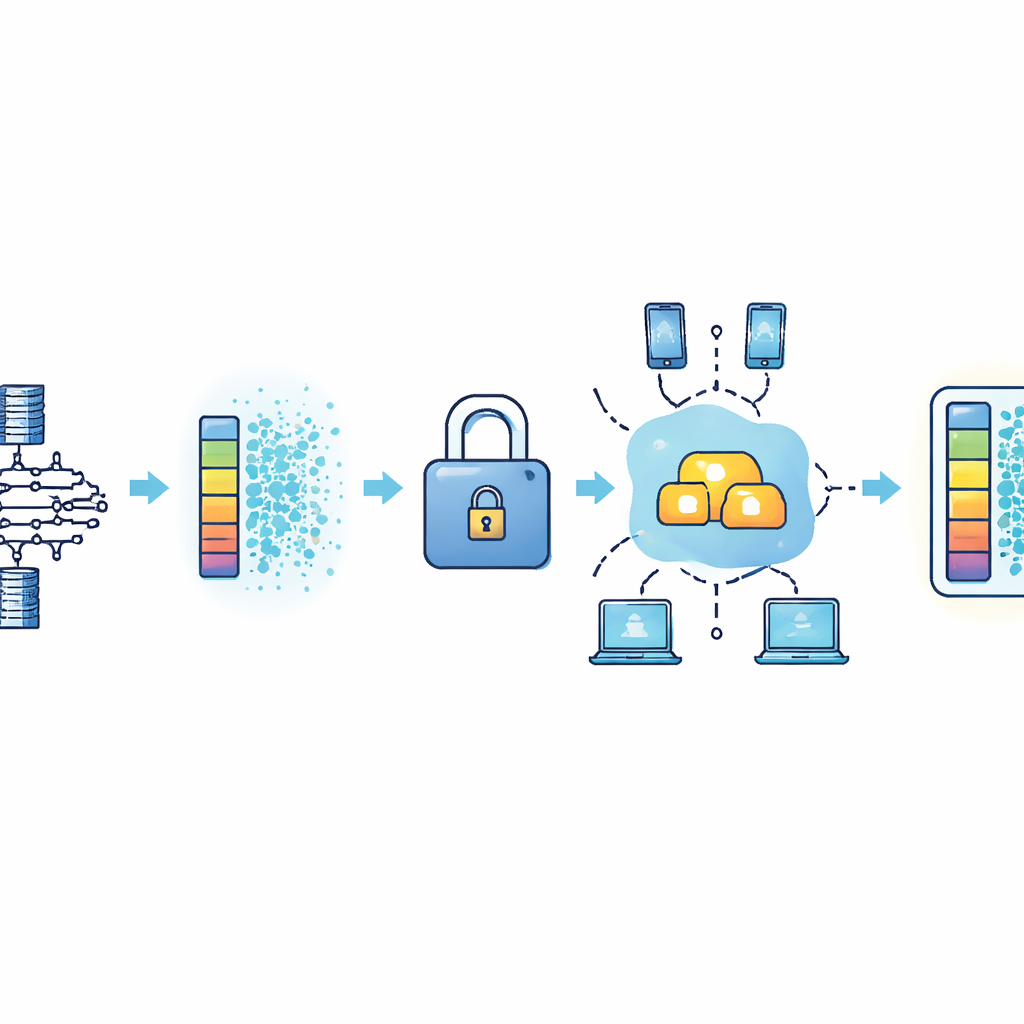

Yazarlar, COVID‑19’u normal göğüs röntgenlerinden ayırt etmek için ResNet‑50 olarak bilinen güçlü bir görüntü tanıma modeline odaklanan bir federated learning çerçevesi tasarlıyor. Her hastane bu modelin kendi kopyasını yerel görüntüleri üzerinde eğitiyor ve tüm röntgenleri kurum içinde tutuyor. Görüntü göndermek yerine hastaneler, yalnızca yerel modellerinin nasıl değişmesi gerektiğini sayısal olarak tanımlayan güncellemeler gönderiyor. Merkezi bir sunucu bu güncellemeleri ortalayıp geliştirilmiş bir global model oluşturuyor ve sonra iyileştirilmiş modeli her hastaneye geri iletiyor. Bu döngünün tekrarı, paylaşılan modelin bireysel taramaları açığa çıkarmadan tüm katılımcıların ortak deneyiminden yararlanmasını sağlıyor.

Ek Gizlilik için Dijital “Gürültü” ve Kilitli Zarflar

Saldırganların model güncellemelerinden hasta görüntülerini yeniden oluşturmasını engellemek için çerçeve, federated learning’in üzerine iki gizlilik tekniği ekliyor. İlk olarak, her hastane model güncellemelerine dikkatle ayarlanmış rastgele gürültü ekliyor; bu, radyodaki sesi biraz karıştırarak bireysel konuşmaları ayırt etmeyi zorlaştırırken genel iletinin yine de anlaşılmasını sağlamak gibidir. İkinci olarak, güncellemeler ağ üzerinden gitmeden önce, sunucunun bunları açık halde görmeden toplamaya izin veren bir yöntemle şifreleniyor—sanki değerler mühürlü zarfların içinde toplanıyormuş gibi. Sadece güvenilen bir anahtar sahibi birleşik sonucu açabiliyor ve merkezi sunucu hiçbir hastanenin güncellemesini düz metin halinde görmüyor. Bu adımlar birlikte hasta verilerini tersine mühendislikle elde etmeye yönelik girişimleri zorlaştırmayı ve aynı zamanda paylaşılan modelin kullanılabilirliğini korumayı amaçlıyor.

Sistemi Teste Sokmak

Ekip, dengelenmiş bir COVID‑19 ve normal göğüs röntgenleri seti üzerinde, birden fazla hastaneyi ayrı eğitim sahaları olarak simüle ederek çerçeveyi değerlendiriyor. Üç düzeni karşılaştırıyorlar: tüm verilerin toplanıp merkezi olarak eğitildiği klasik merkezi eğitim, ek koruma olmayan standart federated learning ve gizlilik‑güçlendirilmiş yaklaşımları. Eklenen gürültü ve şifrelemeye rağmen korumalı sistem çarpıcı biçimde yüksek skorlar elde ediyor—yaklaşık %99,6 doğruluk ve benzer şekilde güçlü precision, recall ve F1 değerleri—havuzlanmış ve korumasız federated sürümlerle eşleşiyor veya onları geride bırakıyor. İletişim turları, eğitim kaybı ve hesaplama süresi ölçümleri, siteler işbirliği yaptıkça doğruluğun istikrarlı şekilde arttığını, şifrelemeden kaynaklanan ek zaman maliyetinin ise ılımlı kaldığını gösteriyor. Sistemin parçaları kapatılıp açılan ablation deneyleri, seçilen gürültü seviyelerinin ve şifreleme‑ve‑sıkıştırma stratejisinin yalnızca küçük performans ödünleriyle güçlü gizlilik sunduğunu doğruluyor.

Gelecekteki Bakım için Anlamı

Uzman olmayanlar için temel mesaj, bu çalışmanın birçok hastanenin röntgenlerinden ham görüntüleri asla açığa çıkarmadan AI eğitmek için pratik bir tarif gösterdiğidir. Yüksek performanslı bir görüntü modelini dijital “gürültü” ve şifreli toplama ile birleştirerek çerçeve, hastanelerin hasta kayıtlarını kurumda tutarken ve meraklı gözlerin erişiminden uzak tutarken birlikte doğru tanı araçları oluşturabileceğini gösteriyor. Nispeten küçük bir veri kümesi üzerinde ve COVID‑19 röntgenlerine odaklanarak test edilmiş olsa da aynı fikirler diğer hastalıklara, görüntüleme türlerine ve hatta finans gibi diğer hassas alanlara da genişletilebilir. Kısacası, çalışma güçlü AI ile güçlü tıbbi gizliliğin birbirine karşı değil, birbirini güçlendirebileceği bir gelecek yönünde işaret ediyor.

Atıf: Gomathi, R., Saranya, K., Mahaboob John, Y.M. et al. Stochastic Poisson-embedded privacy framework for federated learning with secure homomorphic encryption in medical AI. Sci Rep 16, 10931 (2026). https://doi.org/10.1038/s41598-026-41469-4

Anahtar kelimeler: federated learning, tıbbi görüntüleme, veri gizliliği, homomorfik şifreleme, röntgen tanısı