Clear Sky Science · tr

Önyargı giderme teknikleri kullanarak gliom derece tahmininde adalet ile performans arasındaki dengeyi ele almak

Tümörlere adil davranmanın önemi

Doktorlar beyin tümörlerinin tanısında yapay zekâdan yardım aldığında bilgisayarın tarafsız olduğunu varsayabiliriz. Ancak bu araçları eğitmek için kullanılan veriler mevcut sağlık eşitsizliklerini yansıtıyorsa, yazılım bazı hastalara sessizce daha az adil davranabilir. Bu çalışma, yetişkinlerde yaygın bir beyin tümörü türü olan gliomların şiddetini tahmin eden makine öğrenimi sistemlerinin istemeden belirli ırksal veya cinsiyet gruplarını kayırabileceğini inceliyor ve bu tahminleri çok fazla doğruluktan ödün vermeden nasıl daha adil hale getirebileceğini pratik yollarla test ediyor.

Beyin tümörleri ve bilgisayar destekçileri

Gliomlar, daha yavaş büyüyen ve daha iyi tedavi edilebilen formlardan, kötü sağkalıma sahip çok agresif kanserlere kadar değişen beyin tümörleridir. Bu tümörlerin doğru derecelendirilmesi hayati öneme sahiptir, çünkü cerrahi, radyasyon ve ilaç tedavisini yönlendirir. Araştırmacılar, düşük dereceli gliom veya agresif glioblastoma tanısı almış 839 yetişkini içeren herkese açık bir veri setiyle çalıştılar. Her hasta için yaş, cinsiyet, ırk ve tümördeki 20 yaygın genetik belirteç vardı. Bu özellikleri kullanarak iki tümör derecesini ayırt etmek için lojistik regresyon, rastgele ormanlar ve gradyan artırma olmak üzere üç standart tahmin modeli eğittiler; sonra modellerin genel doğruluğunu ve hastaların farklı gruplarına nasıl davrandığını kontrol ettiler.

Gizli dengesizliği aramak

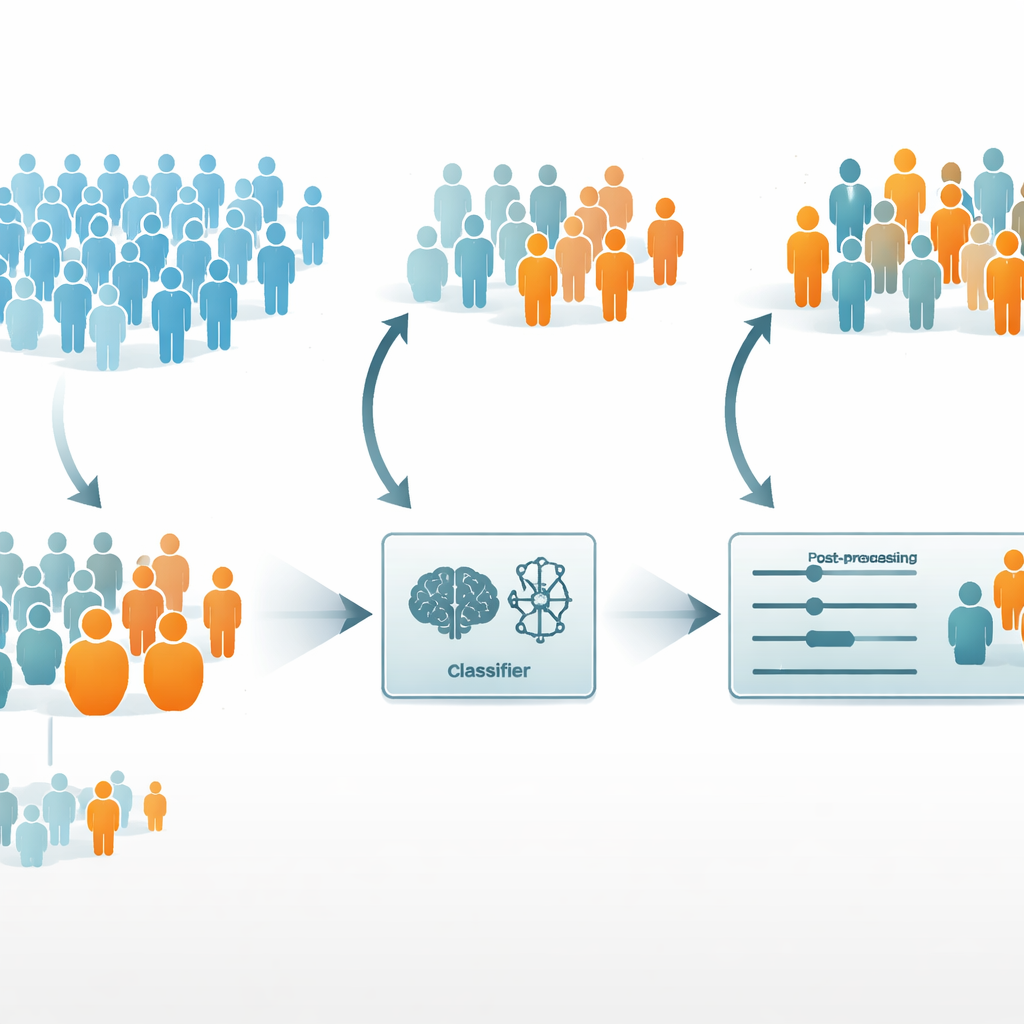

Adaleti incelemek için ekip iki “korunan” özelliğe odaklandı: ırk (Beyaz vs. Beyaz olmayan) ve cinsiyet (erkek vs. kadın). Veri seti kendi başına çarpıktı—hastaların yüzde 90’ından fazlası Beyazdı ve erkek sayısı kadınlardan belirgin şekilde fazlaydı. Yazarlar, farklı grupların ne sıklıkla doğru bir “yüksek derece” tahmini aldığını ve modelin her grup için ne sıklıkta hata yaptığını karşılaştıran grup düzeyinde adalet ölçümleri kullandılar. Üç model de genel olarak oldukça doğruydu ve en iyi performansı lojistik regresyon gösterdi. Ancak bu başarıların altında, adalet kontrolleri Beyaz olmayan hastaların genellikle Beyaz hastalardan daha kötü sonuçlar aldığını ortaya koydu; özellikle daha az agresif tümörleri doğru tanımlamada fark belirgindi. Buna karşılık, erkekler ve kadınlar arasındaki performans çok daha dengeliydi ve cinsiyetler arasında yalnızca küçük farklılıklar vardı.

Önyargıyı düzeltmeye çalışma

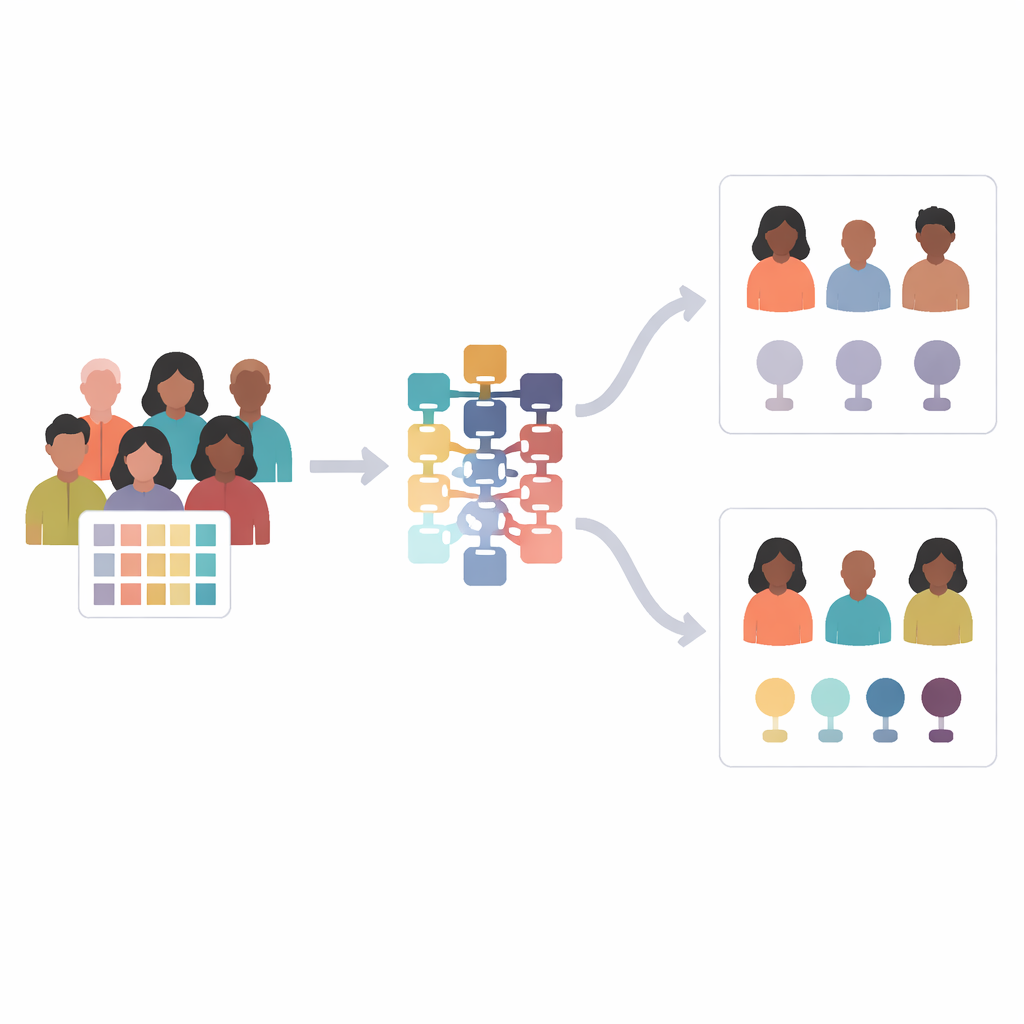

Araştırmacılar sonra adaleti ciddi şekilde zayıflatmadan iyileştirip iyileştiremeyeceklerini sordular. Üç model arasında hem en doğru hem de en adil olanı olduğu için temel model olarak lojistik regresyonu seçtiler. İki yaygın önyargı giderme stratejisini denediler. Eğitim öncesi bir yaklaşım olan yeniden ağırlıklandırma, eğitim sırasında az temsil edilen hastalara ekstra önem vererek modelin onlara daha fazla dikkat etmesini sağladı. Eğitim sonrası bir yaklaşım olan eşit hata oranları (equalized odds) ise eğitilmiş modeli koruyup çıktıları ayarlayarak hata oranlarının gruplar arasında daha benzer olmasını sağladı.

Model ayarlandığında neler değişti

Cinsiyet için her iki strateji genel olarak yardımcı oldu: kadınların tahmin kalitesi iyileşti ve erkekler ile kadınlar arasındaki farklılıklar büyük ölçüde azaldı. Verideki dengesizlik ırk için çok daha güçlü olduğunda durum daha karmaşıktı. Yeniden ağırlıklandırma bazen ters tepki verip Beyaz olmayan hastalar için performansı biraz kötüleştirdi ve bazı ölçütlere göre adaletsizliği artırdı. Buna karşılık, eğitim sonrası yöntem hata oranlarındaki ırksal uçurumları önemli ölçüde azaltırken modelin genel doğruluğunu yüksek tuttu, ancak çoğunluk grubunun performansını biraz düşürdü. Yazarlar ayrıca çok daha küçük olan Beyaz olmayan grup için adalet sayıların istatistiksel olarak kararsız olduğunu gösterdiler—bir kişinin tahminini değiştirmek adalet puanlarını belirgin şekilde kaydırabiliyor—bu yüzden bu sonuçlar dikkatle yorumlanmalı.

Hastalar ve doktorlar için anlamı

Çalışma, bedava bir öğün olmadığını gösteriyor: tıbbi yapay zekâda adaleti iyileştirmek genellikle performansta ödünler gerektirir ve en iyi çözüm, verilerin ne kadar çarpık olduğuna ve hangi adalet hedefinin önceliklendirildiğine bağlıdır. Bu beyin tümörü örneğinde, eğitim sonrası model çıktılarının ayarlanması, ırk ve cinsiyet arasında tedavi önerilerini daha dengeli hale getirmenin en pratik yoluydu ve güçlü tahmin gücünü korudu. Çalışma, özellikle gliom gibi ciddi durumlarda yapay zekâ sağlık uygulamalarına yerleştirilirken adalet kontrollerinin rutin olması gerektiğini ve bu araçları daha adil hâle getirecek yöntemlerin var olduğunu, ancak bunların dikkatle seçilip yorumlanması gerektiğini vurguluyor.

Atıf: Sánchez-Marqués, R., García, V. & Sánchez, J.S. Addressing the balance between fairness and performance in glioma grade prediction using bias mitigation techniques. Sci Rep 16, 9785 (2026). https://doi.org/10.1038/s41598-026-40555-x

Anahtar kelimeler: gliom derecelendirmesi, tıbbi yapay zeka adaleti, algoritmik önyargı, beyin tümörleri, önyargı giderme