Clear Sky Science · tr

Kural tabanlı açıklanabilir bir evrişimli sinir ağı kullanarak kaynak kamera ataması

Fotoğraflarınızın düşündüğünüzden daha fazlasını söyleyebilmesinin nedeni

Çektiğiniz her fotoğraf, onu yakalayan kameraya dair gizli ipuçları taşır. Dijital soruşturmacılar için bu ipuçları, bir görüntünün gerçek olup olmadığını doğrulamaya, hangi cihazdan geldiğini izlemeye veya farklı suç mahallerindeki fotoğrafları ilişkilendirmeye yardımcı olabilir. Günümüzde güçlü yapay zeka (YZ) araçları bu desenleri insanlardan daha iyi tespit edebiliyor—ancak genellikle gizemli “kara kutu” gibi çalışırlar. Bu makale o kutuyu açmanın bir yolunu sunuyor: derin öğrenme modelinin bir fotoğrafın hangi kameradan geldiğine nasıl karar verdiğini insan inceleyicilerin anlayıp güvenebileceği bir biçimde açıklayan kural tabanlı bir yöntem.

Akıllı adli araçlara güvenme zorluğu

Modern dijital adli tıp, insan analistlerin elle inceleyebileceğinin çok ötesinde—akıllı telefonlar, bulut yedeklemeleri ve sosyal medyadan gelen—büyük veri hacimlerini ele almak zorunda. Derin öğrenme sistemleri görüntüleri hızla işaretleyebilir veya hangilerinin önemli olabileceğini önerebilir, ancak iç işleyişleri genellikle kapalı kutudur. Mahkeme gibi hassas ortamlarda “sinir ağı böyle düşünüyor” demek yeterli değildir. Mevcut açıklama araçları genellikle modelin önemli bulduğu görüntü bölgelerini vurgular; bu, yüz veya nesne tanıma gibi görevler için yararlıdır. Ancak kaynak kamera tanımlamada kritik sinyal görünür bir özellik değil, insanlarca görülemeyen ince sensör parmak izidir—örnek olarak zayıf gürültü desenleri. Sonuç olarak, bugünkü görsel açıklama araçları bir modelin bir görüntünün belirli bir kameradan geldiğini neden düşündüğünü açıkça göstermez ve inceleyicilerin modelin yanlış olduğu durumları fark etmesine yardımcı olmaz.

Bir sinir ağının düşünmesini izlemenin yeni yolu

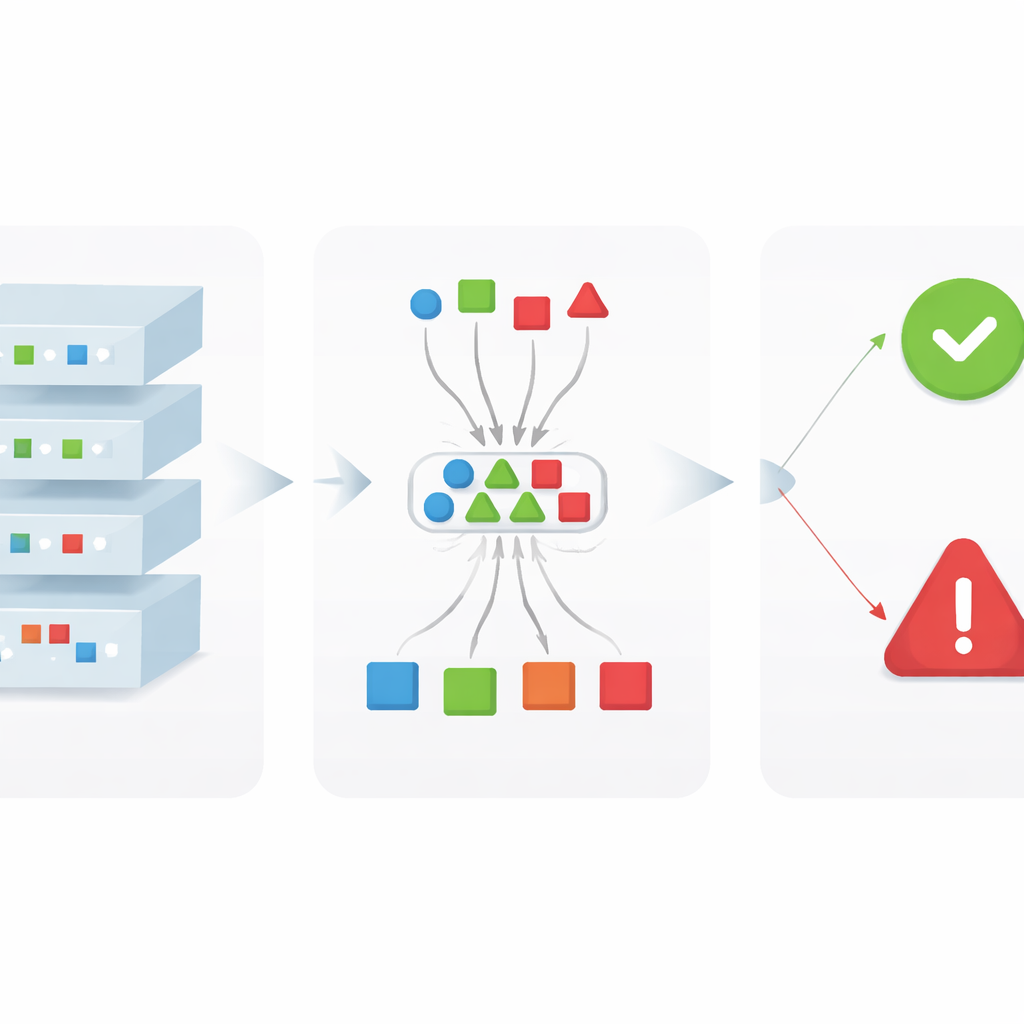

Yazarlar, xDFAI adını verdikleri, özgün modeli değiştirmeden bir evrişimli sinir ağının (CNN) kararlarına nasıl vardığını açıklayan dijital adli tıp için özel olarak tasarlanmış bir çerçeve tanıtıyor. Ağı tek bir opak kutu olarak ele almak yerine xDFAI katman katman içe bakıyor. Her katman ve her kamera sınıfı için, model bir görüntünün o kameraya ait olduğuna inandığında tutarlı şekilde etkinleşen tekrar eden içsel desenler—“izler” olarak adlandırılan—belirleniyor. Bu izler, eğitilmiş bir modelden mevcut atıf yöntemleri kullanılarak çıkarılıyor ve daha sonra birçok eğitim görüntüsünde güvenilir şekilde ortaya çıkan desenler saklanacak şekilde filtreleniyor. Birlikte bu izler, görüntü ağ boyunca ilerledikçe kamera kimliğine dair ipuçlarının nasıl evrildiğine dair yapılandırılmış bir harita oluşturuyor.

Katmanlara oy hakkı tanımak ve oyları kurallara dönüştürmek

İzler belirlendikten sonra xDFAI bunları yeni, görülmemiş görüntüleri incelemek için kullanıyor. Belirli bir test fotoğrafı için, çerçevenin her katmandaki depolanmış izlerle içsel aktivasyonlarının ne kadar benzer olduğu ölçülüyor. Her katman, en çok eşleştiği izlere sahip kamera modelleri için etkin bir şekilde oy veriyor. Katmanlar arası bir “çoğunluk oyu” ise tüm ağın her aday kamera için ne kadar güçlü destek sağladığını özetliyor. Önemli olarak, yazarlar bu oyu modelin tahmininin yerine kullanmıyor; bunun yerine bir kontrol olarak kullanıyorlar. Basit mantıksal kurallar çoğunluk oyu ile orijinal tahmini karşılaştırıyor: tahmin edilen kamera birçok katmandan güçlü destek alıyorsa karar onaylanıyor; oylar dağınıksa veya farklı bir kamerayı destekliyorsa davranış anormal olarak işaretleniyor ve potansiyel bir model hatası olarak inceleyiciye gösteriliyor.

Çerçeveyi teste koymak

xDFAI’yi göstermek için yazarlar, 27 kamera modelinden hangisinin bir görüntüyü yakaladığını tanımlamak üzere eğitilmiş yedi katmanlı bir CNN’e uyguluyor, tanınmış bir adli veri seti kullanıyorlar. Temel CNN tek başına zaten çok iyi performans gösteriyor ve test görüntülerinin yaklaşık %97’sini doğru sınıflandırıyor. xDFAI’nin kuralları uygulandığında, sistem yanlış yapılan 37 tahminden 27’sini otomatik olarak şüpheli olarak işaretliyor. İşaretlenen bu vakalar artık kendinden emin tanımlamalar olarak sayılmıyor; bu da kabul edilen kararların gerçekten doğru olanlarının oranı olan kesinliği %97.33’ten %99.2’ye yükseltiyor ve genel doğruluğu yalnızca hafifçe azaltıyor. Tek bir yanlış atamanın ciddi sonuçlara yol açabileceği adli çalışmalarda, bu ödünleşme oldukça arzu edilir: analistlerin güvenmeyi seçtiği sonuçlar arasında daha az yanlış kabul.

Gerçek dünya soruşturmaları için bunun anlamı

Bu çalışma, özgün modeli yeniden eğitmeden, modelle oynamadan ve belirsiz ısı haritalarına yalnızca dayanmak zorunda kalmadan modern derin öğrenme modellerinin tüm gücünü korurken insan dostu açıklamalar eklemenin mümkün olduğunu gösteriyor. Kararlı içsel izleri açığa çıkararak, bunları şeffaf bir oy toplama şemasıyla birleştirerek ve sonucu basit kurallar halinde ifade ederek xDFAI, inceleyicilere YZ tarafından üretilen kamera atamalarını doğrulama veya sorgulama yolu sunuyor. Çalışma kamera kaynak tanımlamaya odaklansa da aynı fikirler diğer adli atıf görevlerine de genişletilebilir. Uzun vadede, bu tür yaklaşımlar yüksek doğruluklu YZ sistemleri ile mahkemeler ve soruşturma uygulamalarında gerekli şeffaflık ve güvenilirlik düzeyi arasındaki boşluğu kapatmaya yardımcı olabilir.

Atıf: Nayerifard, T., Amintoosi, H. & Ghaemi Bafghi, A. Source camera attribution using a rule-based explainable convolutional neural network. Sci Rep 16, 9137 (2026). https://doi.org/10.1038/s41598-026-40387-9

Anahtar kelimeler: dijital adli tıp, açıklanabilir yapay zeka, kamera tanımlama, evrişimli sinir ağları, görüntü adli bilimi