Clear Sky Science · tr

Dikkat odaklı filigranlama ve blok zinciri tabanlı özgünlük doğrulaması ile proaktif deepfake azaltımı için entegre çerçeve

Sahte videolar neden herkesin sorunu

Gerçek gibi görünen ve işiten videolar artık hazır yazılımlarla kolayca üretilebiliyor; bu durum çevrimiçi ortamda hakikat ile kurgu arasındaki sınırı bulanıklaştırıyor. Sözde deepfake’ler dolandırıcılık, taciz ve siyasi manipülasyonlarda zaten kullanılıyor. Yayıldıktan sonra sahteyi yakalamaya çalışmak yerine bu çalışma farklı bir soru soruyor: ya gerçek videolar oluşturulurken sessizce korunabilseydi, böylece sonradan yapılan herhangi bir müdahale açıkça ortaya çıkmış olur muydu?

Sahte peşinde koşmaktan orijinalleri korumaya

Mevcut araştırmaların çoğu, üretici modellerin geride bıraktığı küçük kusurları tespit etmek için algoritmalar eğiterek deepfake’leri olay sonrasında yakalamaya çalışıyor. Ancak bu modeller geliştikçe bu kedi‑fare oyunu kazanılması zor bir hale geliyor. Yazarlar proaktif bir yaklaşımı savunuyor: izleyicilerin ve platformların daha sonra gördüklerinin değişmemiş orijinaller olup olmadığını doğrulayabilmesi için özgün görüntüyü kaydedildiği anda korumak. Çerçeve üç katmanı birleştiriyor: nerede korunmanın en önemli olduğunu belirleyen akıllı bir video çözümlayıcı, her kareye gizlenmiş görünmez bir dijital işaret ve dosyanın bütünlüğünü kilitleyen blok zinciri kaydı.

Sisteme videoda gerçekten neyin önemli olduğunu öğretmek

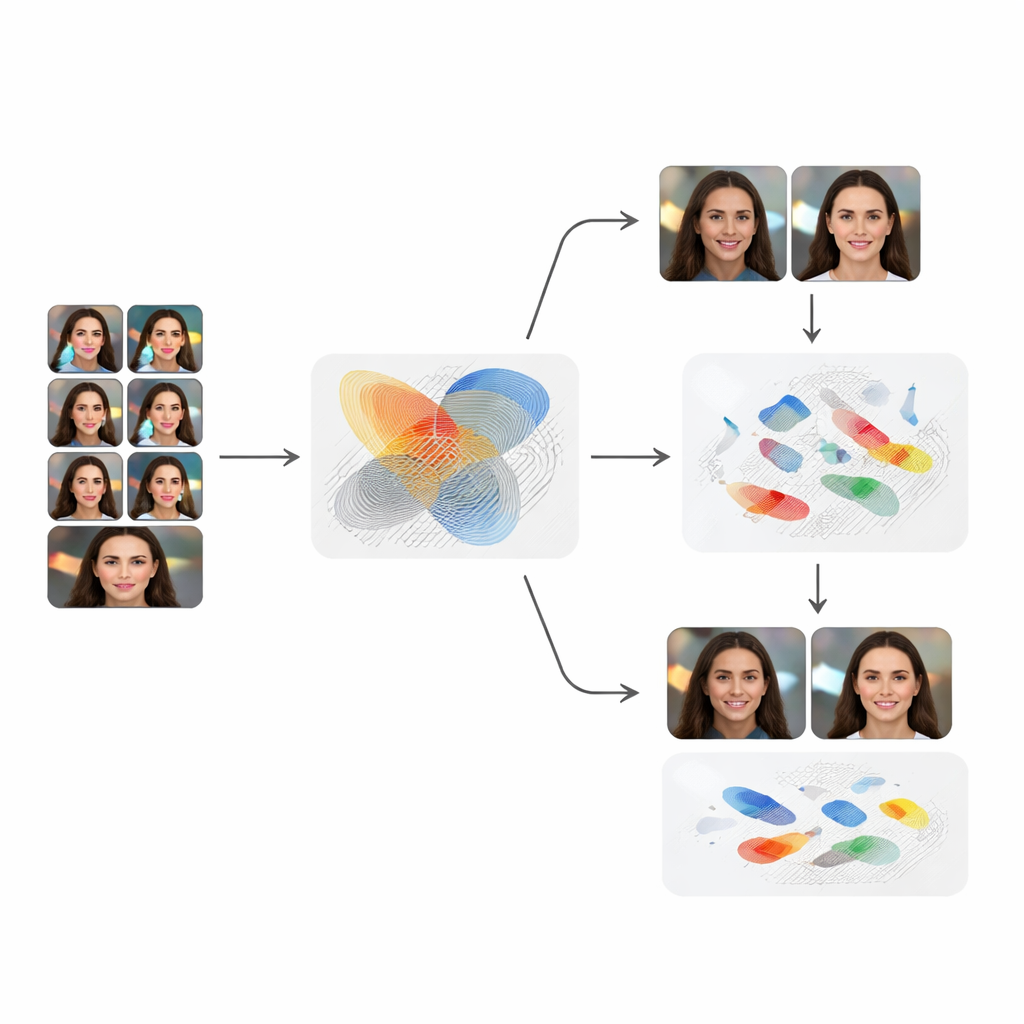

İlk katman, bir videoda zaman içinde en anlamlı hareket ve detay taşıyan bölgeleri öğrenen bir dikkat modeli. Ekip, insanların eylemlerini gösteren binlerce günlük klip üzerinde kompakt ama güçlü bir ağ eğitiyor. Ağın bir bölümü her kareyi bir fotoğraf gibi incelerken, başka bir bölüm 16 karelik dilimlerde hareketin nasıl değiştiğine bakıyor. Birlikte, standart bir eylem tanıma testinde %97’den fazla doğruluk elde ederek sistemin insanlar ve sahnelerin zaman içindeki değişimlerine dair zengin örüntüler öğrendiğini gösteriyorlar. Bu örüntüler daha sonra videonun anlattığı hikâyeyi en çok etkileyecek müdahalelerin odaklanacağı bölgeleri vurgulayan dikkat haritalarına dönüştürülüyor.

Sahtekarların en çok zarar vereceği yere gizli bir işaret saklamak

Sırada görünmez bir dijital işaret — bir filigran — her kareye gömülüyor, ancak basit ve düzgün bir şekilde değil. Bir üretici ağ, dikkat modelinin önemli olarak işaretlediği yüzler veya hareket eden eller gibi bölgelerde daha güçlü, başka yerlerde görsel kaliteyi korumak için daha zayıf olacak şekilde harmanlanan ince, gürültü benzeri bir desen oluşturuyor. İzleyiciler fark etmiyor ve kalite skorları işaretlenmiş karelerin orijinallerden neredeyse ayırt edilemediğini doğruluyor. Buna rağmen desen, bir eşlikçı ağın — bir tür çözücü olarak eğitilmiş — özgün görüntülerden kare kare gizli imzayı daha sonra geri çıkarabilecek kadar güçlü ve karmaşık kalıyor.

Deepfake’leri ve sıradan bozulmaları teste sokmak

Bu korumanın gerçek dünyada dayanıp dayanmadığını görmek için yazarlar bir dizi stres testi yapıyor. Önce çeşitli kısa stok videolar filigranlanıyor ve sonra ikna edici deepfake’ler oluşturmak için en yaygın kullanılan yüz değiştirme araçlarından biri olan DeepFaceLab’e veriliyor. Manipüle edilmiş 50 klibin her birinde gizli işaret ya yok edilmiş ya da ciddi şekilde karıştırılmış ve sistem videoyu değiştirilmiş olarak doğru şekilde işaretliyor. Yöntem ayrıca klipler çevrimiçi paylaşıldığında sıkça gerçekleşen güçlü yeniden sıkıştırma, yeniden boyutlandırma ve bulanıklaştırma gibi yaygın işleme adımlarına da iyi dayanıyor; ancak çok güçlü rastgele gürültü nihayetinde gizli sinyali aşabiliyor. Titiz deneyler, hem dikkat rehberliğinin hem de zaman içindeki hareket bilgisinin kullanımının kritik olduğunu gösteriyor; bu bileşenlerden herhangi biri kaldırıldığında koruma belirgin şekilde zayıflıyor.

Kalıcı bir parmakizi ile güveni kilitlemek

Son katman karelerin içeriğinin ötesine geçiyor ve video dosyasını güvence altına alıyor. Filigranlamadan sonra tamamlanmış dosya kriptografik bir işlevden geçirilerek kısa bir dijital parmak izi üretiliyor. Bu parmak izi ile klip hakkında temel bilgiler blok zinciri defterine yazılıyor; burada iz bırakmadan değiştirilemez. Daha sonra herkes bir kopya yükleyebilir: sistem filigranı geri çıkarmayı dener ve ayrıca parmak izini yeniden hesaplar. Hem gizli işaret hem de kriptografik parmak izi orijinal kayıtlarla eşleşiyorsa video yüksek güvenle özgün kabul edilebilir; herhangi biri başarısız olursa izleyiciler görüntülerin değiştirildiğini bilirler.

Gördüğünüz videolar için bunun anlamı

Basitçe söylemek gerekirse, bu çalışma bir videonun sahte olup olmadığını tahmin etmekten gerçek olduğunu kanıtlamaya geçebileceğimizi gösteriyor. Her karenin en anlamlı parçalarına sessizce, taklit edilmesi zor ve akıllı bir işaret örerek ve bunu değiştirilemez bir defter girdisi ile destekleyerek çerçeve test edilen tüm yüz değiştirme saldırılarını yakalıyor ve birçok sıradan bozulmaya dayanıyor. Aşırı görsel gürültü altında hâlâ zorlanıyor ve daha geniş testlere ihtiyaç var, ancak bu yaklaşım kameraların, platformların ve haber odalarının videoları yerleşik özgünlük kanıtıyla gönderebildiği bir geleceğe işaret ediyor — bu da deepfake’lerin gerçeğe dönüşmesini çok daha zorlaştırır.

Atıf: Hajjej, F., Hamid, M. & Alluhaidan, A.S. An integrated framework for proactive deepfake mitigation via attention-driven watermarking and blockchain-based authenticity verification. Sci Rep 16, 9545 (2026). https://doi.org/10.1038/s41598-026-40166-6

Anahtar kelimeler: deepfake koruması, video özgünlüğü, dijital filigranlama, blok zinciri doğrulaması, medya güvenliği