Clear Sky Science · tr

Dinamik güven yayılımı ve uyarlanabilir normalizasyon ile derin sınıflandırıcıların kalibrasyonu

Yapay zekâ güvenine inanmanın önemi

Günümüz yapay zekâ sistemleri yalnızca bir fotoğrafta veya sensör okumada ne olduğunu söylemekle kalmıyor—aynı zamanda ne kadar emin olduklarını da bildiriyor. Bu öz‑raporlanan güven, tıbbi görüntüleme, otonom sürüş veya endüstriyel izleme gibi güvenliğin kritik olduğu ortamlarda çok önemli; yanlış yerleştirilmiş bir kesinlik hissi tehlikeli olabilir. Ancak günümüz derin sinir ağları hatalarında aşırı emin olmalarıyla kötü üne sahip ve mevcut düzeltmeler genellikle veri dengesiz olduğunda veya ortamlar değiştiğinde başarısız oluyor. Bu makale, gerçekçi, değişen koşullarda yapay zekâ sistemlerinin güven skorlarını daha dürüst, kararlı ve verimli hâle getirmeyi amaçlayan Dinamik Güven Yayılımı ile Alterneli Normalizasyon (DCP‑AN) adlı yeni bir yöntemi tanıtıyor.

Akıllı makineler kendilerinden çok emin olduğunda

Çoğu popüler derin öğrenme modeli doğru etiketi tahmin edecek şekilde eğitilir, her tahminin ne kadar güvenilir olduğunu yargılamak için değil. Sonuç olarak, bir ağ bir görüntünün kedi olduğunu %99 “emin” olabilirken aslında köpek olabilir. Sıcaklık ölçeklemesi veya tahminleri güvenlik aralıklarına bölme gibi standart kalibrasyon teknikleri, eğitimden sonra küresel ayarlamalar uygulayarak bunu düzeltmeye çalışır. Ancak bu yöntemler tüm kategorilere ve tüm örneklere aynı muameleyi yapar. Gerçek dünyada veriler nadiren dengelidir: birkaç yaygın “baş” sınıfın çok sayıda örneği varken, nadir “kuyruk” sınıfları yalnızca birkaç kez görünebilir. Ağlar yaygın sınıflarda aşırı emin olma, nadir sınıflarda ise yetersiz emin olma eğilimindedir; bu fark, statik ve tek‑beden‑herkese uyan düzeltmelerle kapanmaz—özellikle veri dağılımı sanat çizimlerinden gerçek dünya fotoğraflarına gibi alanlar arasında değiştiğinde.

Veri ve etiketler arasında bilgi paylaşmanın yeni bir yolu

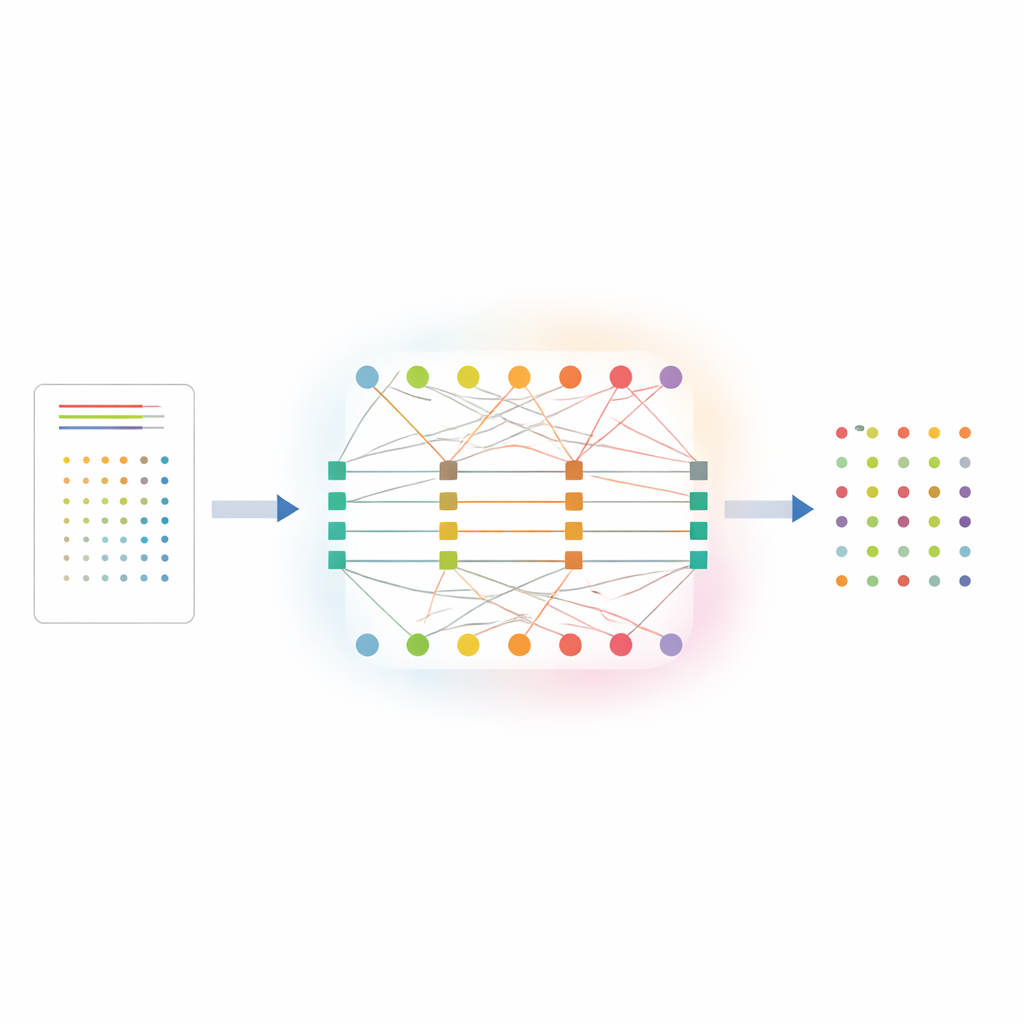

DCP‑AN bu sorunu, güvenin bireysel örnekler ile ait oldukları sınıflar arasında nasıl akması gerektiğini açıkça modelleyerek ele alır. Yöntem, örnekler ile sınıflar arasındaki ilişkiyi iki katmanlı bir ağ olarak temsil eder: bir katman örnek düğümleri, diğeri sınıf düğümleri için ve başlangıç tahmin güçlerini kodlayan ağırlıklı bağlantılarla birbirine bağlıdır. Güven daha sonra iki adımlı bir etkileşimle inceltilir. İlk adımda, bilgi örneklerden sınıflara akar ve her sınıfın tahminlerinin ne kadar yaygın olduğunu, o sınıfın şu anda ne kadar belirsiz göründüğü kılavuzluğunda ayarlar. İkinci adımda ise bilgi sınıflardan örneklere geri akar ve her örneğin güven profiline, önceki tahminlerle ne kadar tutarlı olduğuna bağlı olarak ince ayar yapılır. Bu ileri‑geri süreci sınırlı sayıda tekrarlayarak sistem, örnekler ile etiketler arasında daha iyi bir “takım çalışması” teşvik eder; böylece nadir sınıflar, yaygın sınıflar tarafından bastırılmak yerine daha net sinyaller alır.

Gerektiğinde ısıyı artırmak

DCP‑AN’deki temel yeniliklerden biri, yöntemin güveni yeniden şekillendirme gücünü yerel ve küresel belirsizliğe göre değiştiren uyarlanabilir bir “sıcaklık alanı”dır. Tüm tahminler için tek bir sıcaklık değeri kullanmak yerine, yöntem zaman içinde belirsizlik ve uyumsuzluk ölçümlerine dayanarak sınıflar ve örnekler için ayrı ayarlama güçleri hesaplar. Ağın zaten kendinden emin şekilde işlediği baş sınıflar için etkin sıcaklık hafifçe düşürülür, aşırı düzleştirmeyi önler ve keskin ayrımları korur. Kuyruk sınıflar ve belirsiz örnekler için sıcaklık yükselir; bu, haklı görüldüğünde güvenlerini artıracak ve hatalı zirveleri sönümlendirecek daha güçlü düzeltmelere izin verir. Bu dinamik davranış, ilkeli bir güncelleme kuralından kaynaklanır ve belirsizlik arttığında hızlı yanıt verirken, model zaten iyi hizalanmış olduğunda kararlı kalır.

Görevler ve donanım arasında güvenilir gelişme

Yazarlar DCP‑AN’i birkaç yaygın görüntü veri kümesi üzerinde dikkatle değerlendirir. Bazı kategorilerin diğerlerinden yüzlerce kat daha fazla görüntüye sahip olduğu uzun‑kuyruklu bir ImageNet sürümünde, yöntem nadir kuyruk sınıflardaki doğruluğu yaklaşık 10 puan artırır ve standart bir kalibrasyon hata ölçüsünü düzeltimsiz temele göre yarıdan fazla azaltır. Bir sanat eserinden gerçek dünya fotoğraflarına transfer edilen çapraz‑alan testinde DCP‑AN, yeni alandaki doğruluğu artırırken kaynak ve hedef veriler arasındaki farkın istatistiksel bir ölçüsünü de düşürür. Önemli olarak, bu kazanımlar yoğun hesaplama maliyetiyle gelmez: modern bir grafik kartında çalıştırıldığında yöntem yalnızca bir milisaniyeden biraz fazla gecikme ve yarım megabayttan az ek bellek gerektirir; bu da gerçek zamanlı ve uç cihazlar için pratik kalmasını sağlar.

Günlük yapay zekâ için anlamı

Basitçe söylemek gerekirse, bu çalışma yapay zekâ sistemlerini yalnızca daha akıllı yapmakla kalmayıp, ne zaman yanılabilecekleri konusunda daha kendinin farkında hâle getirebileceğimizi gösteriyor. Güven bilgisinin örnekler ve kategoriler arasında ileri‑geri akmasına izin vererek ve değişen belirsizliğe göre ne kadar agresif düzeltme yapacağını uyarlayarak, DCP‑AN nadir olaylar ve değişen ortamlarda bile olasılık tahminlerini gerçeğe daha iyi uyan biçimde sunuyor. Yine, yöntem yine hatalar yapacak olsa da, yineleyici güncellemelerinin hızla durağanlaştığına dair matematiksel bir garantisi ve minimal ek yükle çalışması sebebiyle, bu çerçeve sağlık, robotik ve güvenlik izleme gibi alanlardaki mevcut sinir ağlarına entegre edilebilir. Sonuç, hatalar yapan ama ne kadar emin olduğuna dair çok daha dürüst olan—insanların güvenle dayanabileceği—bir yapay zekâdır.

Atıf: He, P., Fu, W., Wang, L. et al. Calibrating deep classifiers with dynamic confidence propagation and adaptive normalization. Sci Rep 16, 10959 (2026). https://doi.org/10.1038/s41598-026-39842-4

Anahtar kelimeler: güven kalibrasyonu, derin sinir ağları, uzun kuyruklu tanıma, belirsizlik tahmini, alan uyarlaması