Clear Sky Science · tr

AsynDBT: büyük dil modelleriyle bağlam içi öğrenmede verimli, eşzamanlı olmayan dağıtılmış iki seviyeli ayarlama

Daha akıllı istemlerin günlük yapay zeka için önemi

Büyük dil modelleri artık birçok kişinin her gün kullandığı sohbet robotları, arama motorları ve yazım yardımcılarına güç veriyor. Yine de faydalı yanıtlar almak büyük ölçüde sorularımızı nasıl formüle ettiğimize ve modele hangi örnekleri gösterdiğimize bağlı kalıyor. Bu makale, bu istemleri ve örnekleri birçok cihaz arasında otomatik olarak iyileştirmenin yeni bir yolunu tanıtıyor; her kullanıcının verileri ise gizli tutuluyor. Sonuç, özellikle telekom ağ bakımı gibi uzmanlık gerektiren görevlerde daha doğru ve verimli yanıtlar veren bir yapay zeka sistemi oluyor.

Yeniden eğitmek yerine göstererek öğretmek

Devasa yapay zeka modellerini sürekli yeniden eğitmek yerine, yükselen bir eğilim onları ‘‘anında’’ öğretmek; görev istemine birkaç dikkatle seçilmiş örnek ekleyerek—bu sürece bağlam içi öğrenme deniyor. Örneğin film incelemelerini olumlu veya olumsuz olarak sınıflandırmak için modele küçük bir etiketli örnek kümesi gösterip yeni bir yorumu etiketlemesini isteyebilirsiniz. Sorun şu ki, örnek seçimi ve talimatların tam ifadeleri modelin performansını dramatik şekilde değiştirebiliyor. El ile iyi kombinasyonlar bulmak yavaş ve maliyetli; kuruluşlar arasında ham veri paylaşımı da gizlilik kuralları nedeniyle çoğu zaman imkânsızdır.

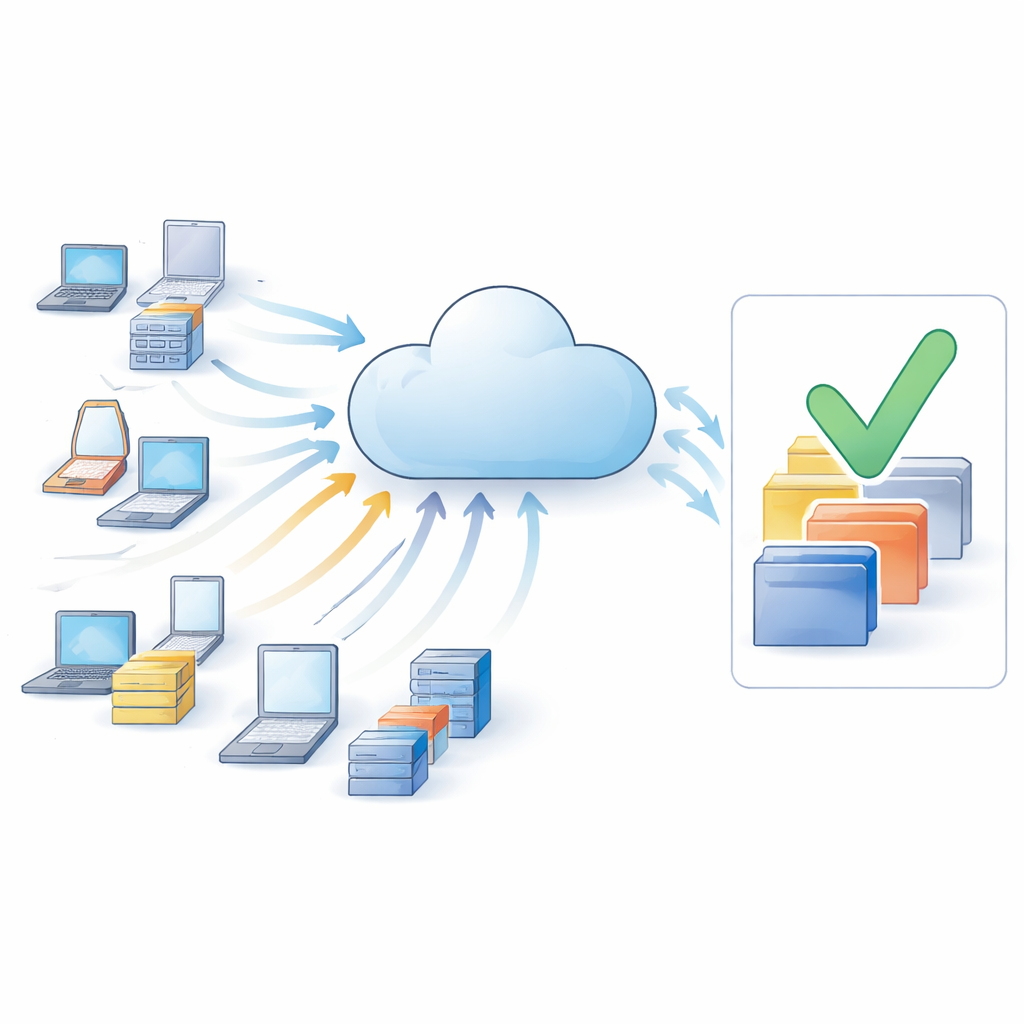

Özel verileri paylaşmadan işbirliği

Veri paylaşımı engellerini aşmak için yazarlar, birçok ayrı cihazın veya kuruluşun verilerini yerel tutup merkezi bir sunucu aracılığıyla işbirliği yaptığı federated learning yaklaşımını temel alıyor. Her bir işçi—örneğin bir telekom baz istasyonu veya şirket sunucusu—aynı bulut tabanlı dil modeliyle iletişim kuruyor, ama ham metni yüklemiyor. Bunun yerine, farklı istemlerin ve örnek seçimlerinin ne kadar iyi çalıştığına dair yalnızca geri bildirim sinyalleri gönderiyor. AsynDBT (asenkron dağıtılmış iki seviyeli ayarlama) adlı yeni bir algoritma, bu işçileri koordine ederek ortak bir istem stratejisini geliştirmelerini sağlıyor; böylece gizlilik korunuyor ve yavaş ya da güvenilmez ağ bağlantularıyla başa çıkılıyor.

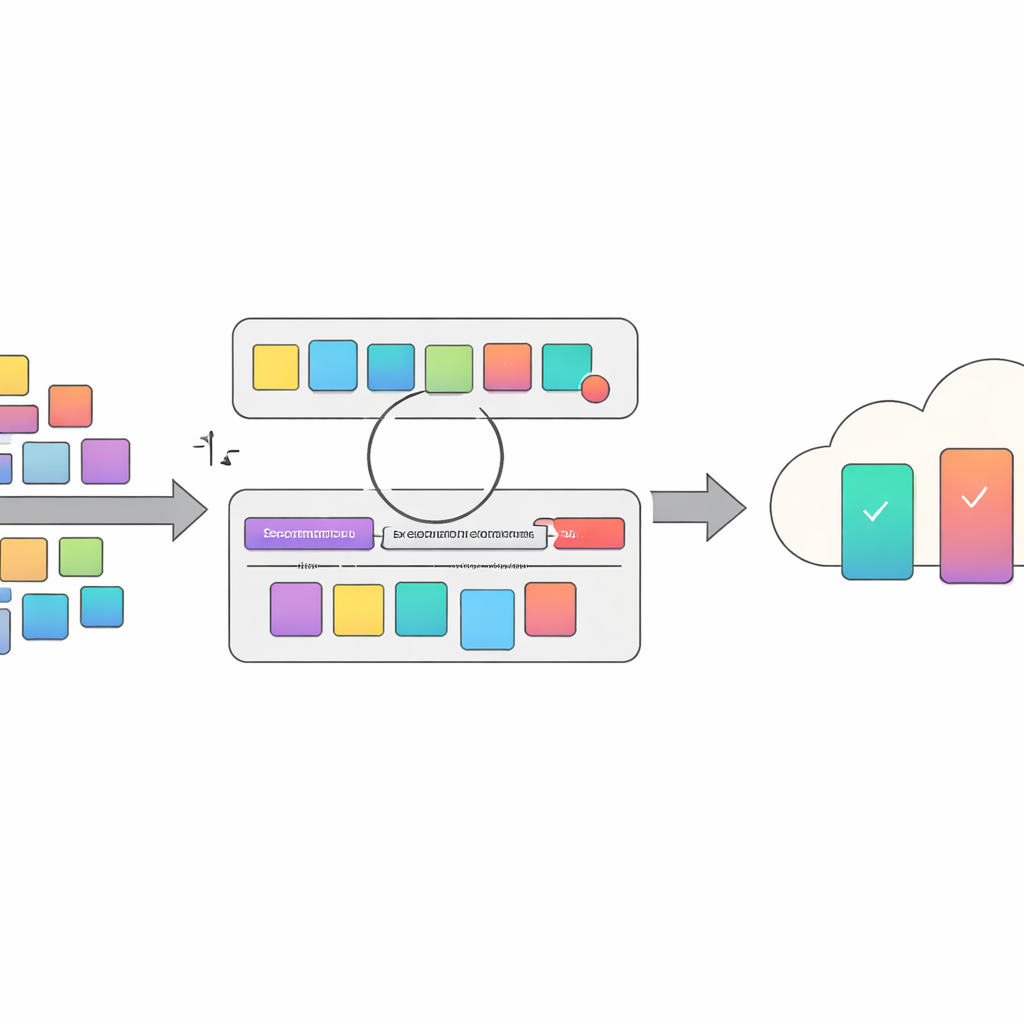

Soruyu ve örnekleri aynı anda optimize etmek

Makalenin kilit fikri, istem tasarımını iki katmanlı bir optimizasyon problemi olarak ele almak. Alt katmanda, görev talimatına eklenen kısa parçacıklar ayarlanıyor—ifade farklılıkları modelin daha iyi muhakeme yapmasını tetikleyebilir. Üst katmanda ise hangi etiketli örneklerin gösterim olarak dahil edileceğine karar veriliyor. Bu iki katman etkileşiyor: farklı örnek kümeleri farklı istem ayarlamaları gerektiriyor ve tam tersi de geçerli. AsynDBT bu ilişkiyi matematiksel olarak formüle ediyor ve her bir işçinin yerel tercihlerini kademeli olarak güncellerken merkezi bir sunucunun alt katman kararlarının tutarlı bir küresel görünümünü korumasını sağlayan verimli bir yaklaşım kullanıyor.

Yavaş cihazlar ve kötü niyetli katılımcılarla başa çıkma

Gerçek ağlarda bazı cihazlar geç yanıt verebilir veya bağlantı kesilebilir; bu ‘‘geride kalanlar’’ standart senkron eğitimleri tıkayabilir. AsynDBT bunun yerine asenkron çalışıyor: sunucu herkes beklemeksizin bir alt küme işçi raporladığında değişkenlerini güncelliyor. Yöntem ayrıca yanlış yönlendirici güncellemeler gönderebilecek işçilerden—kasıtlı veya hata sonucu—korunmayı sağlıyor. Düzenleme (regularization) teknikleri ile sağlam toplama kurallarını harmanlayarak algoritma, zehirlenmiş veya düşük kaliteli örnek seçimlerinin küresel strateji üzerindeki etkisini azaltıyor; bu da saldırı altında bile sistemin istikrarını ve güvenilirliğini korumaya yardımcı oluyor.

Dil ve telekom görevlerinde kanıtlanmış kazanımlar

Araştırmacılar AsynDBT’yi, bağlam olarak yalnızca telekom standartlarının parçacıklarını kullanarak uzman teknik terimlerin ilişkili olup olmadığını değerlendirmesi gereken zorlu bir 5G ağ veri kümesi de dahil olmak üzere altı metin sınıflandırma probleminde test etti. Mevcut çeşitli istem ve örnek seçimi yöntemleriyle karşılaştırıldığında, yeni yaklaşım neredeyse tüm görevlerde en iyi veya ikinci en iyi doğruluğu elde etti. Özellikle 5G görevinde, en güçlü kıyas yönteme göre doğruluk yaklaşık on yüzde puan arttı. Aynı zamanda, asenkron tasarım, işi dağıtmayan benzer bir merkezi yönteme göre eğitim süresini yaklaşık %40 azalttı.

Geleceğin yapay zeka araçları için anlamı

Uzman olmayanlar için çıkarım şu: daha iyi istemler ve daha akıllı örnek seçimleri, temel modeli değiştirmeden yapay zeka sistemlerinin davranışını belirgin şekilde iyileştirebilir. AsynDBT, çok sayıda işbirliği yapan cihaz arasında bunu otomatik ve gizliliği koruyan bir şekilde yapma olanağı sunuyor; telekom operasyonları, müşteri desteği ve diğer uzmanlaşmış alanlar için daha doğru ve verimli dil araçları sağlıyor. İleriye bakıldığında yazarlar, istemlerin güncel olgusal bilgiye de başvurabilmesi için çerçeveyi grafik tabanlı bilgi getirme yöntemleriyle birleştirmeyi planlıyor; bu da halüsinasyonları azaltıp yüksek riskli ortamlarda yapay zeka yardımcılarını daha güvenilir kılacaktır.

Atıf: Ma, H., Dou, S., Liu, Y. et al. AsynDBT: asynchronous distributed bilevel tuning for efficient in-context learning with large language models. Sci Rep 16, 9381 (2026). https://doi.org/10.1038/s41598-026-39582-5

Anahtar kelimeler: bağlam içi öğrenme, istek (prompt) optimizasyonu, federated learning, büyük dil modelleri, gizliliği koruyan yapay zeka