Clear Sky Science · tr

Bir büyük dil modelini ödül güncellenmiş GRPO ile diğer bir büyük dil modelinin muhakemesini geliştirmek için kullanmak

Makinelere Düşünmeyi Öğretmek

Günümüzün birçok dil modeli sohbet edebiliyor, çeviri yapabiliyor ve soruları yanıtlayabiliyor, ancak iyi bir matematik öğrencisi ya da dikkatli bir analist gibi çalışmaları nasıl gösterileceği konusunda hâlâ zorlanıyor. Bu makale, bir yapay zekâ sisteminin başka bir sistemin muhakeme becerilerini nasıl geliştirebileceğini ve bunun büyük, özel veri setlerini elle oluşturmak zorunda kalmadan nasıl yapılabileceğini inceliyor. Finans, tıp veya bilimsel araştırma gibi alanlarda yapay zekânın nasıl daha güvenilir hale gelebileceğiyle ilgilenen okuyucular için çalışma, modellerin yanıtlarını daha açık ve tutarlı biçimde açıklamalarını sağlamak üzere uygulanabilir bir reçete sunuyor.

Ham Belgelerden Öğretilebilir Örneklere

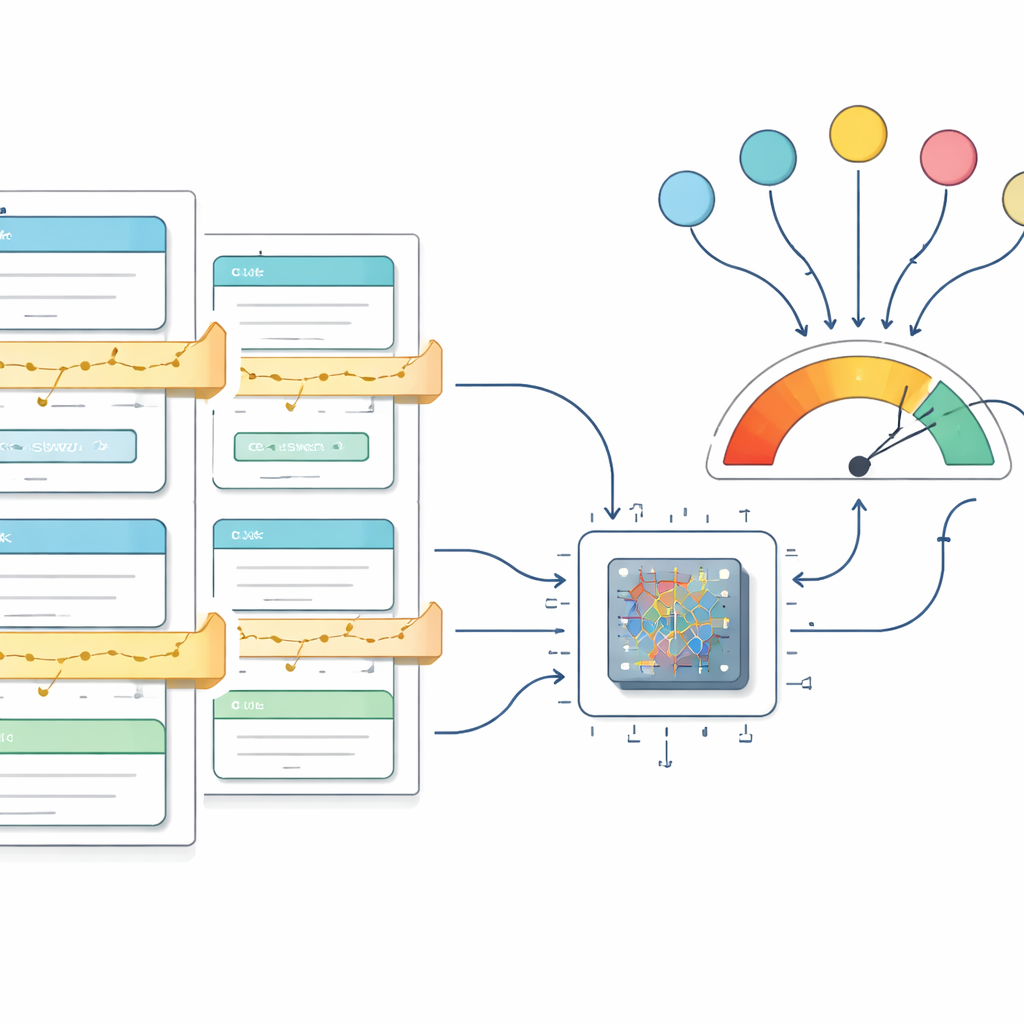

Yazarlar basit bir gözlemden başlıyor: gerçek dünyadaki bilgi çoğunlukla raporlar, hissedar mektupları veya web sayfaları gibi dağınık biçimlerde yaşar, düzenli soru-cevap formatında değil. Bu boşluğu kapatmak için Huggify-Data ve CoT Data Generator adında iki yazılım aracı sunuyorlar. Bu araçlar yapılandırılmamış metni alıp otomatik olarak soru-cevap çiftlerine ayırıyor, ardından güçlü bir dil modelinden arasındaki eksik muhakeme adımlarını doldurmasını istiyor. Sonuç her örnek için yapılandırılmış bir üçlü: bir soru, bir muhakeme zinciri ve bir yanıt. Kritik olarak, bu işlem hattı okul matematiğinden kurumsal finansmana kadar neredeyse her alana uygulanabilir, böylece insan anotatör ordularına gerek kalmadan muhakeme odaklı eğitim verisi oluşturmak mümkün oluyor.

Bir Modelin Diğerini Nasıl Eğittiği

Bu soru–muhakeme–yanıt üçlüleri oluşturulduktan sonra, aynı yapılandırılmış şekilde düşünmeyi öğrenmesi için daha küçük bir “öğrenci” modeli eğitmekte kullanılıyor. Öğrenciden yalnızca nihai yanıtı vermesi değil, açıkça ayrılmış bir açıklama ve ardından sonuç üretmesi isteniyor. Eğitim, aynı soruya verilen birkaç aday yanıtı karşılaştıran ve modeli daha iyi olanlara doğru iten Grup Göreli Politika Optimizasyonu (Group Relative Policy Optimization) adlı bir yöntemle yönlendiriliyor. Makale, model çıktısının istenen formatı izleyip izlemediğini, hatta iyi biçimlenmiş bir referans örnekle ne kadar yakından eşleştiğini kontrol eden ek bir ödül terimiyle bu yöntemi güncelliyor. Bu ödül, karışık veya eksik açıklamalara hafifçe ceza vererek modeli düzenli, yorumlanabilir yanıtlara doğru itiyor.

Yaklaşımı Teste Sokmak

Çerçevenin pratikte işe yarayıp yaramadığını görmek için yazarlar iki oldukça farklı veri setine uyguluyorlar. Birincisi, çok adımlı aritmetik muhakemeyi gerektiren okul çağındaki sözcük problemlerinden oluşan GSM8K. İkincisi ise Warren Buffett’ın hissedarlara yazdığı yıllık mektuplardan derlenmiş; amaç, yatırım ve kurumsal kararlar hakkında uzun biçimli muhakemeyi yakalamak. Her iki durumda da boru hattı ham metni yapılandırılmış eğitim verisine dönüştürüyor ve Qwen 2.5 adlı orta boy bir modeli ince ayar yapıyor. Eğitim sırasında basit bir puanlama kuralı doğru, iyi biçimlendirilmiş yanıtları ödüllendiriyor; öğrenme ilerledikçe ortalama ödül istikrarlı şekilde yükseliyor ve teorik maksimumunda dengeleniyor, bu da modelin eğitim verisindeki hedef davranışı büyük ölçüde öğrendiğini gösteriyor.

Geliştirilmiş Model Ne Kadar İyi

Performans, kabaca modelin çıktılarındaki küçük metin parçalarının (tokenların) beklenenlerle ne kadarının eşleştiğini soran “ortalama token doğruluğu” kullanılarak ölçülüyor. Bu, olağan tümüyle-doğru veya-yanlış sınav puanlamasından farklı olsa da açıklamaların ve yanıtların doğru yapıda üretilip üretilmediğini değerlendirmek için uygun. GSM8K üzerinde en iyi model %98,2 token doğruluğuna, Buffett mektuplarında ise %98,5’e ulaşıyor. Bu puanlar aynı metrik altında GPT‑4 ve Claude 3.5 Sonnet gibi yaygın bilinen sistemlerin rapor ettiklerinden daha yüksek ve bunlar yalnızca iki günden kısa sürede kiralanmış donanım üzerinde eğitilebilen 3 milyar parametreli bir model kullanılarak elde ediliyor. Yazarlar ayrıca hesaplama maliyetleri ve donanım düzenleri hakkında ayrıntılar paylaşıyor ve diğerlerinin inceleyip geliştirebilmesi için tüm kodu, modelleri ve veri setlerini yayımlıyorlar.

Günlük Yapay Zekâ Kullanımı İçin Ne Anlama Geliyor

Uzman olmayanlar için ana çıkarım, yapay zekâ sistemlerinin yalnızca yanıt vermeyi değil, sıradan belgelerden otomatik olarak çıkarılan verileri kullanarak disiplinli ve takip etmesi kolay bir biçimde yanıt vermeyi de öğrenebileceği. Muhakeme bakımından zengin bir öğretmen modeli, esnek bir veri boru hattı ve doğrulukla birlikte açıklığı da değerleyen bir ödül şeması birleştirilerek yazarlar, daha küçük modelleri daha güvenilir problem çözücülere nasıl dönüştüreceklerini gösteriyorlar. Gerçek anlayış ve güvenlik için daha güçlü testlere ihtiyaç duyulması gibi sınırlamalara dikkat çekseler de, bu çerçeve kuruluşların kendi metin arşivlerini eğitimli, şeffaf yapay asistanlara dönüştürebilecekleri bir geleceğe işaret ediyor.

Atıf: Yin, Y. Use large language model to enhance reasoning of another large language model through reward updated GRPO. Sci Rep 16, 8360 (2026). https://doi.org/10.1038/s41598-026-39296-8

Anahtar kelimeler: büyük dil modelleri, düşünce zinciri muhakemesi, ödül optimizasyonu, veri kürasyonu, alanına özgü yapay zeka