Clear Sky Science · tr

Düşük durum tehdidi modelinde farklılığa dayalı gizlilikli stokastik gradyan inişinin daha sıkı gizlilik denetimi

Günlük teknoloji için neden önemli

Günümüz uygulamaları fotoğraflardan mesajlara ve tıbbi kayıtlara kadar verilerimizden sürekli öğreniyor. Bu eğitim sürecini güvenli tutmanın önde gelen yollarından biri, tek bir kişinin verisinin öne çıkmaması için dikkatle ayarlanmış gürültü ekleyen farklılıkla gizliliktir. Ancak özellikle günümüzde kullanılan derin sinir ağları bağlamında bu korumaların pratikte gerçekten işe yaradığını nasıl bilebiliriz? Bu makale bu soruyu inceliyor ve bir modelin “eğitim filminin” gizlenmesinin gizliliğe gerçekten ne zaman yardımcı olduğunu — ve ne zaman olmadığını — gösteriyor.

Gizli öğrenmenin nasıl çalışması beklenir

Farklılığa dayalı stokastik gradyan inişi (DP-SGD), gizliliği koruyan makine öğrenimi için temel algoritmadır. Modelleri küçük veri partileri üzerinde adım adım eğitir, her adımın gradyanını (iyileşme yönünü) kırpar ve model güncellemeden önce rastgele gürültü ekler. Teori, herhangi bir kişinin verisinin nihai modeli ne kadar etkileyebileceğine dair üst sınırlar sağlar; bu genellikle epsilon adı verilen bir gizlilik sayısıyla özetlenir. Paralel olarak, “gizlilik denetimi” eğitilmiş modele saldırmayı ve pratikte gerçekte ne kadar bilgi çıkarılabileceğini test etmeyi amaçlar. Teori ve denetim örtüşürse gizlilik hesaplamamıza güvenebiliriz; örtüşmezse, önemli bir şey gözden kaçıyor demektir.

Sadece nihai model açığa çıktığında ne değişir

Çoğu önceki denetim, eğitim sırasında her ara model kontrol noktasını görebilen güçlü bir saldırgan varsayıyordu. Gerçekte birçok kuruluş tüm eğitim geçmişini değil, yalnızca nihai modeli yayımlar. Bu daha gerçekçi ortam, gizli durum tehdit modeli olarak adlandırılır. Son teorik çalışmalar, en azından basit konveks problemler için, ara modelleri gizlemenin zaman içinde gizliliği artırabileceğini öne sürdü: eğitimde erken kullanılan veriler sonraki gürültülü güncellemelerle “yıkanarak” etkisini kaybedebilir. Ancak modern derin öğrenme, kayıp yüzeyi engebeli ve karmaşık olan yüksek derecede konveks olmayan modellere dayanır. Aynı güçlendirme gerçekten orada oluyor mu, yoksa mevcut saldırılar gerçek gizlilik kaybını ortaya çıkaracak kadar güçlü değiller mi, belirsizdi.

Saldırganların modeli zorlaması için yeni bir yol

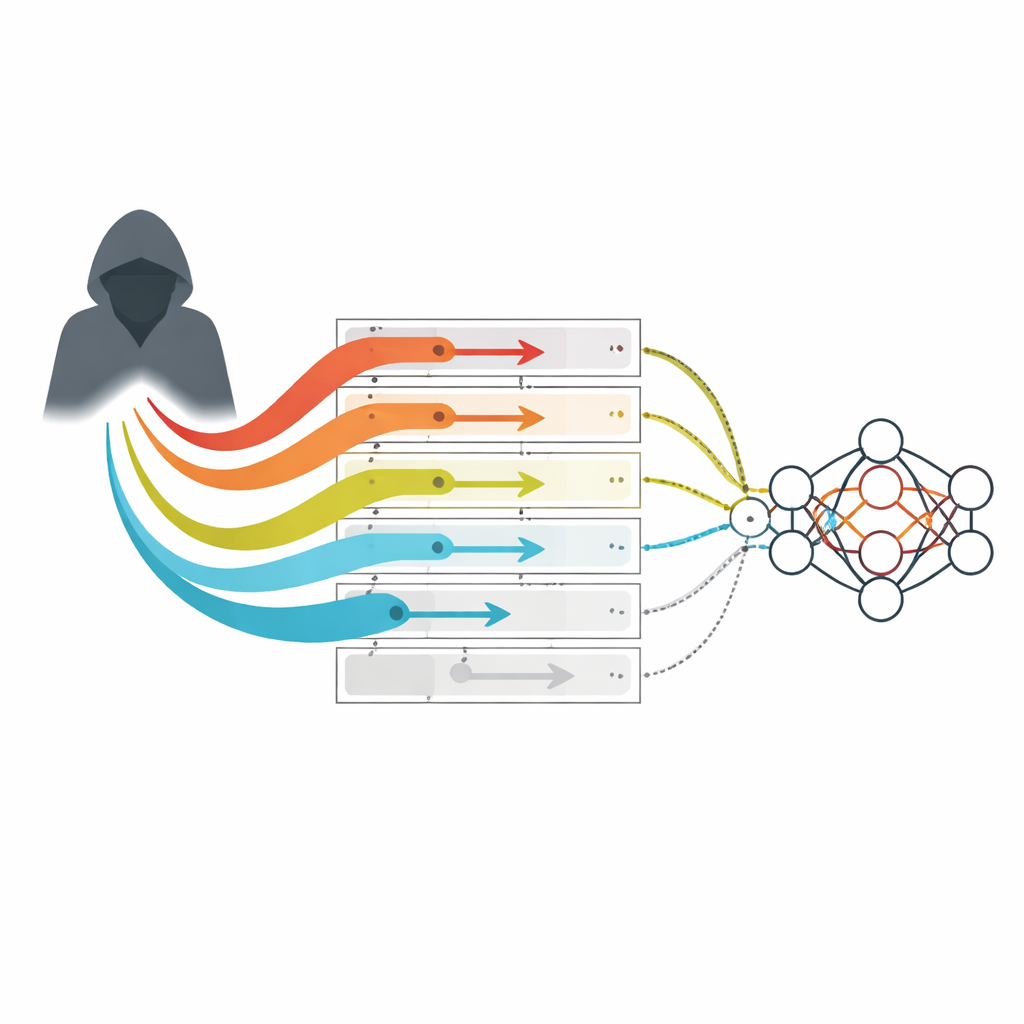

Yazar, gizli durum modeli için uyarlanmış yeni bir “gradyan oluşturma” saldırgan ailesi tanıtıyor. Geleneksel kayıp-tabanlı saldırılarda olduğu gibi özel bir veri noktasını tasarlayıp eğitim sırasında kaybının nasıl değiştiğini izlemek yerine, bu saldırganlar en kötü durum veri noktası varmış gibi uygulanacak gradyan dizisini doğrudan belirtiyor. Her zaman kırpma eşiklerine değen ve nadiren kullanılan parametre yönleriyle hizalanan gradyanları tercih ederek, ara modelleri görmeden bile etkilerini tespit etmeyi kolaylaştırıyorlar. İki basit varyant inceleniyor: birisi rastgele bir parametre yönü seçiyor, diğeri ise güçlü tekrarlayan gradyanları en az güncellenen yön boyunca enjekte etmeden önce eğitim sürecini simüle ederek en az güncellenen yönü buluyor.

Deneylerin gerçek gizlilik riski hakkında gösterdikleri

Bu çerçeveyi kullanarak makale, evrişimli ve artık ağları (residual networks) gibi yaygın mimariler ile küçük tam bağlantılı bir modeli içeren görüntü ve tabular veri kümelerinde DP-SGD’yi denetliyor. Oluşturulmuş gradyan her eğitim adımında kullanıldığında, yeni saldırganlar yalnızca nihai modeli görmelerine rağmen katı teorik gizlilik sınırlarına ulaşıyor. Bu, bu aşırı durumda ara kontrol noktalarının gizlenmesinin hiçbir ek gizlilik sağlamadığı anlamına geliyor. Oluşturulmuş gradyan daha az sıklıkta eklendiğinde durum değişiyor: gürültü seviyesine kıyasla büyük partiler için denetimler teoriye yakın kalıyor (yine az güçlendirme olduğunu gösteriyor), ancak daha küçük partiler ve daha yüksek gürültü için bir boşluk ortaya çıkıyor; bu da konveks olmayan ayarlarda gerçek, ancak mütevazı bir gizlilik güçlenmesine işaret ediyor.

En kötü durum sınırına göz atmak

Gizli durum modelindeki gizliliğin mutlak sınırlarını anlamak için makale, yalnızca gradyan oluşturmakla kalmayıp ayrıca özel bir veri noktasının etkinliğini yinelemeler boyunca canlı tutacak tüm bir kayıp manzarasını da tasarlayan daha aşırı teorik bir saldırganı inceliyor. Bu kontrol altındaki ortamda sonuçlar iki rejimi net biçimde ayırıyor: büyük parti boyutlarıyla standart teoriye dayalı gizlilik hesaplaması temelde sıkı, ancak küçük partiler ve kayda değer gürültüyle bir veri noktasına dair erken bilgi zamanla kısmen unutuluyor. Kritik olarak, bu güçlenme basit konveks problemler için bilinen düzeyden daha zayıf ve gizlilik riskini tamamen ortadan kaldırmıyor.

Kullanıcılar ve uygulayıcılar için ne anlama geliyor

Uzman olmayanlar için alınacak ders, bir derin öğrenme modelinin eğitim geçmişini gizlemenin sihirli biçimde çok daha güçlü gizlilik sağlamadığıdır. Bir kişinin verisi eğitim sırasında çok sık kullanılıyorsa, riski bugün öngörülen muhafazakâr teorinin öngördüklerine yakındır. Daha elverişli rejimlerde — küçük partiler ve önemli gürültü — bir miktar ek koruma ortaya çıkıyor, ancak bu mütevazı düzeydedir ve riski sıfıra indirmiyor. Bu bulgular mevcut gizlilik hesaplamasının bazı yönlerini doğrularken sınırlamalarını da ortaya koyuyor ve yalnızca nihai model paylaşıldığında DP-SGD’nin ne kadar koruma sağlayabileceğine dair daha net, daha gerçekçi bir tablo sunuyor.

Atıf: Bhuekar, A. Tighter privacy auditing of differentially private stochastic gradient descent in the hidden state threat model. Sci Rep 16, 8365 (2026). https://doi.org/10.1038/s41598-026-38537-0

Anahtar kelimeler: farklılıkla gizlilik, DP-SGD, gizlilik denetimi, makine öğrenimi güvenliği, gizli durum modeli