Clear Sky Science · tr

Sorgu verimliliği yüksek, karar tabanlı düşük sorgu bütçeli saldırı

Görüntülerdeki küçük bozulmalar neden akıllı makineleri yanıltabilir

Modern yapay zeka yüzleri, hayvanları ve sıradan nesneleri etkileyici bir doğrulukla tanıyabiliyor. Buna karşın, aynı sistemler insanların zar zor görebildiği kadar küçük görüntü değişiklikleriyle kolayca kandırılabiliyor. Bu makale, yapay zekaya mümkün olduğunca az soru sorarak bu tür “aldatıcı” görüntüler oluşturmanın yeni bir yolunu inceliyor; hem günümüz modellerinin ne kadar kırılgan olabileceğini hem de saldırganların bunlardan gerçek dünyada nasıl yararlanabileceğini gösteriyor.

Saldırganlar yapay zeka sistemlerini dışarıdan nasıl sorgular

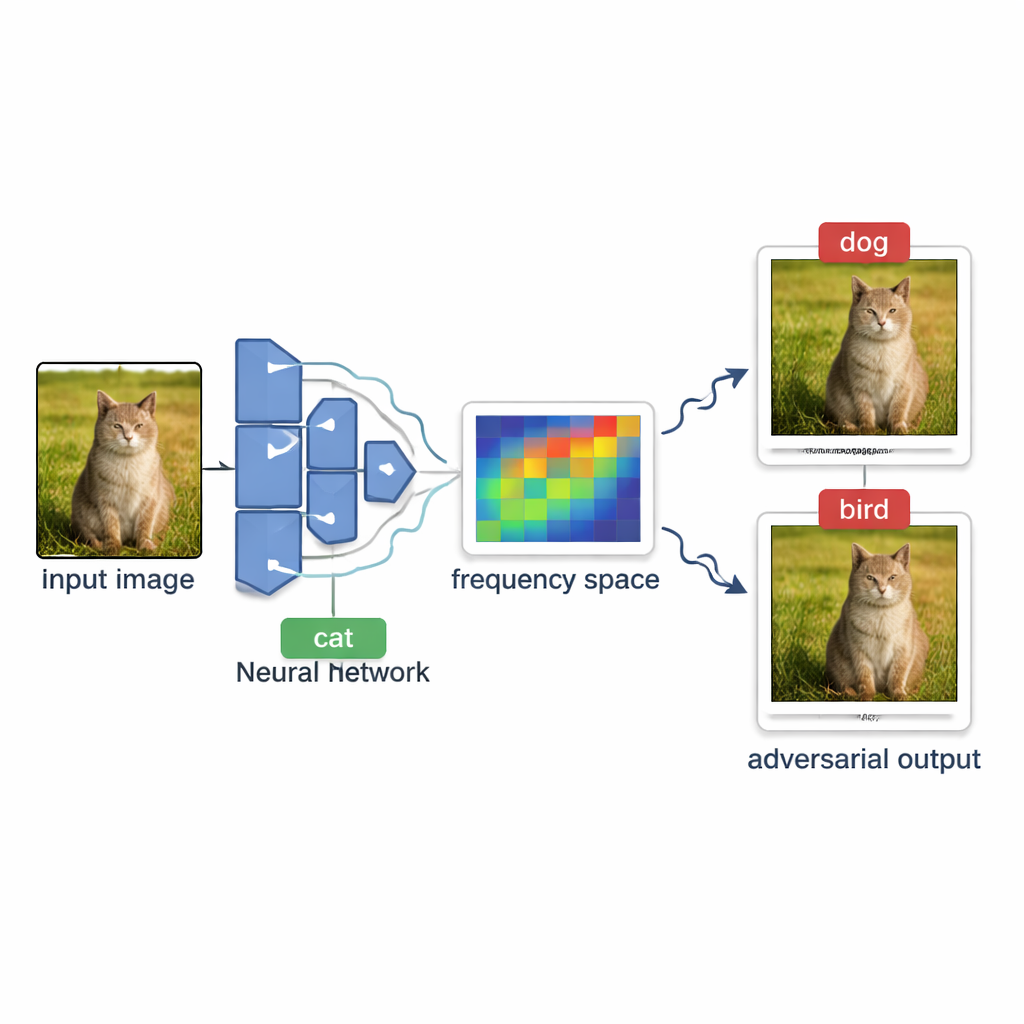

Çevrimiçi fotoğraf etiketleme veya içerik filtreleri gibi birçok gerçek hizmette model bir kara kutu gibi davranır. Dışarıdan biri bir görüntü yükleyip yalnızca “köpek” veya “dur işareti” gibi nihai etiketi görebilir; modelin içsel güven skorları veya yapısı asla açığa çıkmaz. Bu koşullar altında yanıltıcı bir görüntü oluşturmak karar tabanlı kara kutu saldırısı olarak adlandırılır. Zorluk, modelin fikrini değiştirmeye ne kadar yakın olduğunu göremeden ve sistemi fark edilecek veya sorgulaması maliyetli hale getirecek kadar çok test görüntüsü göndermeden normal bir resmi nazikçe itip yanlış etiket almasını sağlamaktır.

Çok az sorguyla yeni bir arama yöntemi

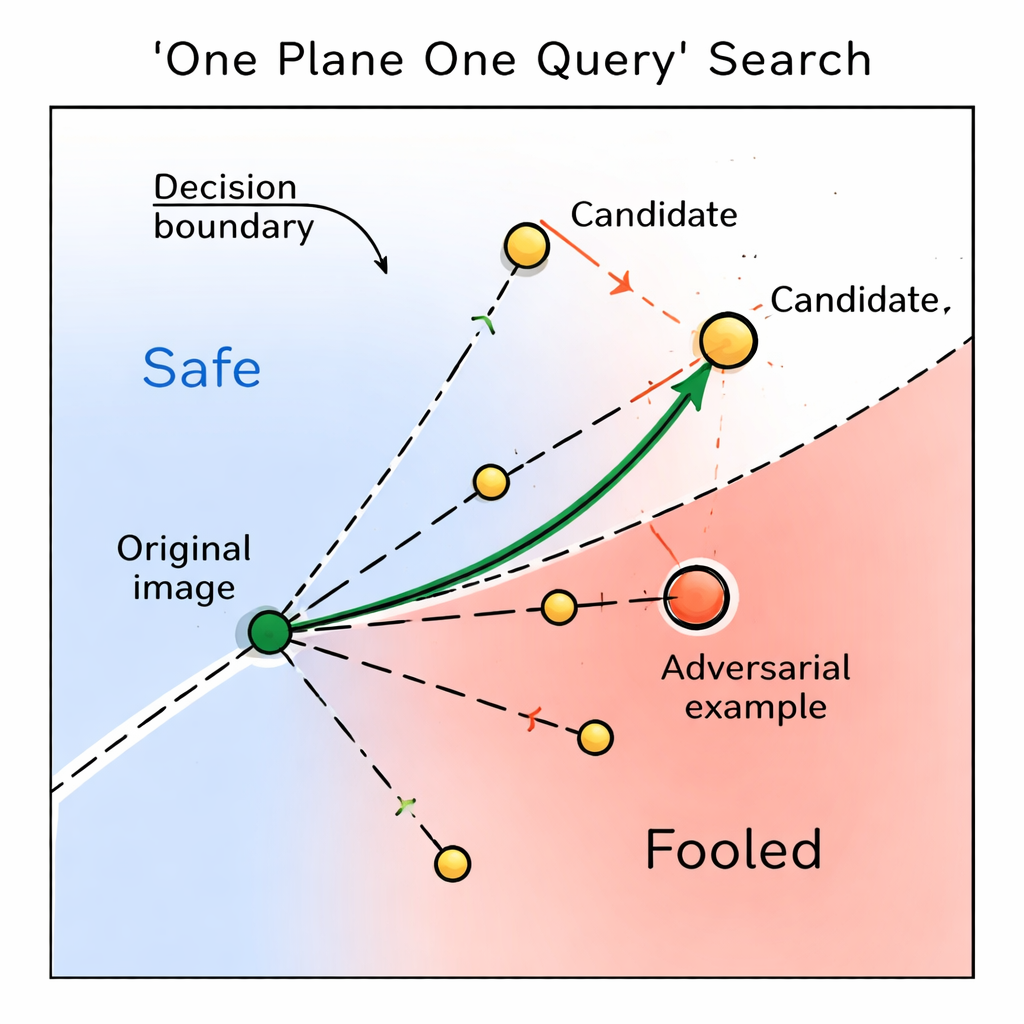

Yazarlar OPOQA (One Plane One Query Attack) adlı, sorgu konusunda tutumlu olup yine de yüksek kaliteli düşmanca görüntüler üreten bir yöntem sunuyor. Tek bir tahmin yönünde tekrar tekrar sondaj yapmak yerine OPOQA turlarla çalışır. Her turda, hâlihazırda yanıltıcı bir görüntü ile orijinal temiz görüntüden başlayıp, özenle seçilmiş yönlerde yer alan birkaç yeni aday görüntü önerir. Önemli olarak, her yön en fazla bir kez sorgulanır; bu da sınırlı sorgu bütçesini tek bir tahmini aşırı derecede iyileştirmeye değil, çok daha fazla olasılığı keşfetmeye ayırmayı sağlar.

Görüntüdeki pürüzsüz dalgaların peşinden gitmek

Ümit vaat eden yönleri seçmek için OPOQA, en etkili ve zor fark edilen değişikliklerin sık sık keskin piksel gürültüsünden ziyade pürüzsüz, geniş kaymalar olduğunu varsayar. Yöntem, görüntüyü bir “frekans” görünümüne taşıyan ayrık kosinüs dönüşümü adlı matematiksel bir araç kullanır; burada yavaş, nazik değişimler kompakt bir bölgede toplanır. Bu düşük frekanslı bileşenlerden birkaçını rastgele örnekleyip bunları normal piksel değişikliklerine geri çevirir ve keşif için temel yönler olarak kullanır. Her örneklenen yön, orijinal görüntü, mevcut düşmanca görüntü ve yeni bir aday arasında düz bir iki boyutlu yüzey tanımlar. OPOQA bu yüzeylerin her birinde, orijinal resme daha yakınlaşmayı ve hâlâ modeli yanlış karara itme olasılığını dengelerken test edilecek tek bir nokta seçer.

En iyi adayı seçmek ve anlık uyarlama

OPOQA küçük bir aday seti oluşturduktan sonra, her birinin orijinal görüntüden ne kadar uzak olduğunu ölçer ve bunları en az değişenden en çok değişene doğru sıralar. Ardından modeli bu sırayla sorgular. Modeli yanlış sınıflandıran bir aday bulduğu anda durur ve o görüntüyü bir sonraki turun yeni başlangıç noktası olarak kabul eder. Eğer adayların hiçbiri modeli kandıramazsa, OPOQA önceki en iyi düşmanca görüntüyü korur ancak bir sonraki adım grubunun ne kadar muhafazakâr veya agresif olacağını kontrol eden içsel bir düğmeyi ayarlar. Her zaman eldeki en iyi yanlış sınıflandırılmış görüntüyü kabul eden ve adım büyüklüğünü dinamik olarak ayarlayan bu “aç gözlü” strateji, umut vadetmeyen yönlere sorgu israf etmeden ince, etkili bozulmalara odaklanmayı sağlar.

Deneyler yapay zekanın zayıf noktaları hakkında ne ortaya koyuyor

Araştırmacılar OPOQA’yı büyük ölçekli ImageNet kıyaslamasından 200 görüntü ve Inception-v3, ResNet, VGG, DenseNet ve görsel dönüştürücüler de dahil olmak üzere altı yaygın sinir ağı modelinde test etti. Görüntü başına katı bir 1.000 model sorgusu sınırı altında OPOQA birkaç önde gelen saldırı yöntemini eşledi veya geride bıraktı. Örneğin Inception-v3 üzerinde görüntülerin yüzde 94’ünde modeli başarıyla kandırırken, insan gözü için neredeyse görünmez derecede küçük değişiklikler yapmayı başardı ve önceki en iyi yönteme göre birkaç puanlık iyileşme sağladı. Modeller genelinde OPOQA genellikle daha az sorguyla daha yüksek başarı oranlarına daha erken ulaştı; ancak bazı rakip yöntemler çok geniş sorgu bütçeleri ve ince ayar zamanı verildiğinde yakaladı veya aştı.

Günlük yapay zeka güvenliği için ne anlama geliyor

Çalışma, bugün görsel sistemlerin yalnızca nihai kararları gören ve modeli sınırlı sayıda sorgulama fırsatı olan saldırganlar tarafından bile aldatılabileceğini gösteriyor. Nazik, düşük frekanslı değişimleri akıllıca keşfederek ve her sorguyu dikkatle paylaştırarak OPOQA, insanlar için aynı görünen ancak makineleri ciddi şekilde şaşırtan görüntüler yaratabiliyor. Uzman olmayanlar için çıkarım şu: Yapay zekânın “görmesi” hâlâ oldukça kırılgan; fark edilmesi zor ince yollarla yanlış yöne itilebilir. Bu tür verimli saldırıları tanımak ve incelemek, güvenlik kameraları, tıbbi görüntü araçları ve otonom araçlar gibi gerçek dünya sistemlerini tespit edilmeden manipülasyona karşı güçlendirmek için atılacak önemli bir adımdır.

Atıf: Tuo, Y., Yin, M. & Che, S. Query-efficient decision-based adversarial attack with low query budget. Sci Rep 16, 6886 (2026). https://doi.org/10.1038/s41598-026-38428-4

Anahtar kelimeler: tehdit örnekleri, siyah kutu saldırıları, derin öğrenme güvenliği, görüntü sınıflandırması, sorgu verimli saldırı