Clear Sky Science · tr

RiemannInfer: Riemann geometrisi aracılığıyla dönüştürücü çıkarımını iyileştirme

Günlük AI kullanıcıları için bunun önemi

Modern sohbet botları ve yapay zeka asistanları matematik problemlerini çözebilir, makaleler yazabilir ve hatta tıbbi konuları açıklayabilir; yine de nasıl karara vardıklarını —ya da onların daha güvenilir şekilde akıl yürütmesini nasıl sağlayacağımızı— gerçekten bilmiyoruz. Bu makale, büyük dil modellerinin (LLM) içsel etkinliğini eğri bir geometrik yüzey üzerindeki hareket olarak ele alarak içlerini görmenin yeni bir yolunu tanıtan “RiemannInfer”i ortaya koyuyor. Bu bakış açısı, sistemlerin nasıl düşündüğüne dair daha sezgisel bir görüntü sunmakla kalmıyor, aynı zamanda onların akıl yürütmesini daha hızlı ve daha doğru hale getiriyor.

AI düşüncesini geometrik bir yolculuğa dönüştürmek

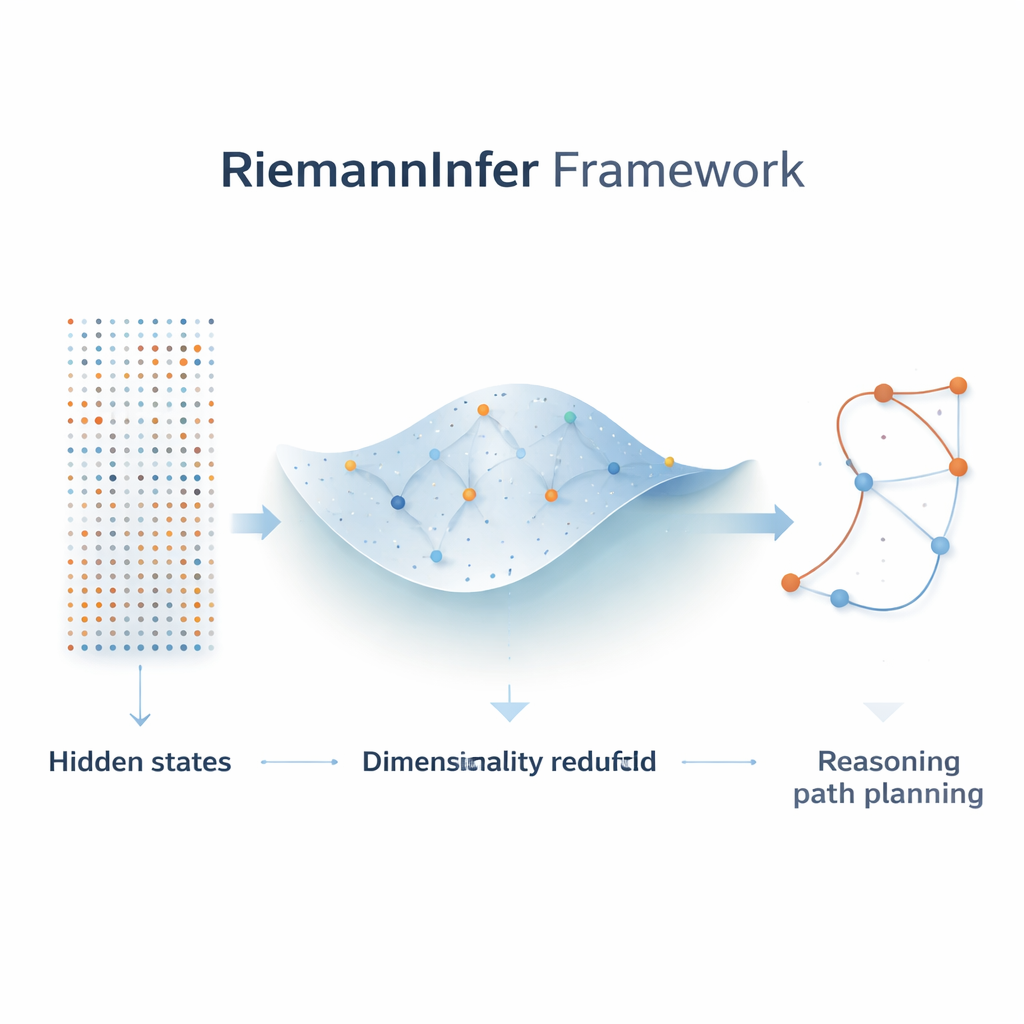

GPT-4 veya Llama gibi bir LLM içinde, bir cümledeki her kelime yüksek boyutlu bir vektörle temsil edilir ve katmanlardaki “dikkat” hangi kelimenin diğerini ne kadar etkilediğine karar verir. Yazarlar, bu gizli durumların, modelin dil anlayışını kodlayan genel şeklin bulunduğu geniş bir uzaydaki noktalar olarak görülebileceğini gözlemliyor. Akıl yürütmeyi metinler üzerindeki olasılık hesapları dizisi olarak ele almak yerine, onu bir yol bulma problemi olarak yeniden yorumluyorlar: model bu uzayda başlangıç durumu (soru) ile son durum (cevap) arasında bir rotada hareket eder. Eğri yüzeylerin matematiği olan Riemann geometrisinden alınan araçları kullanarak, dikkat kalıplarının bu iç manzarayı nasıl büktüğünü ve gerdiğini yakalayan eğri bir manifold inşa ediyorlar.

Büyük resmi kaybetmeden karmaşıklığı sıkıştırmak

Bir LLM’nin ham iç uzayı muazzam olduğu için, RiemannInfer’in ilk adımı onu özsel yapısını koruyarak küçültmektir. Yazarlar, noktaların nasıl bağlandığını inceleyen topolojiden gelen teknikleri, UMAP adlı popüler bir boyut indirgeme algoritmasıyla birleştiriyor. Boyut sayısını azaltmadan önce, gizli durum bulutunun “şeklini” analiz ederek sıkıştırma sırasında önemli bağlantı kalıplarının korunduğundan emin oluyorlar. Ortaya çıkan, token’lar arasındaki önemli ilişkilerin —örneğin hangi kelimelerin birbirine güçlü dikkat verdiği— büyük ölçüde korunduğu daha düşük boyutlu bir uzaydır. Bu kompakt geometrik harita, uzaklıklar, en kısa yollar ve eğrilik üzerinde hassas hesaplamalar yapılmasını mümkün kılar.

Dikkatten eğri bir harita inşa etmek

Çekirdek yenilik, dikkat ağırlıklarını geometrik bir mesafe ölçüsüne çevirmektir. Model iki token arasında güçlü dikkat gösterdiğinde, RiemannInfer onları manifold üzerinde birbirine yakın olarak ele alır; zayıf dikkat onları daha uzak koyar. Bu ilişkilerden yazarlar bir metrik —uzunlukları ve açıları belirleyen matematiksel bir kural— tanımlar ve bunu geodezikleri (eğri düzlemlerdeki düz çizgilerin karşılığı) ve uzayın ne kadar keskin büküldüğünü ölçen eğriliği hesaplamak için kullanır. Çok başlıklı dikkat doğal olarak dilbilgisi veya anlam gibi dilsel yapının farklı yönlerini yakalayan birden fazla metriğin karışımı haline gelir. Bu yapı ile model kararları, bilginin yoğun veya seyrek olduğu yerleri yansıtan tepeler ve vadiler boyunca belirli yolları seçmek olarak yorumlanabilir.

Düşük çaba gerektiren akıl yürütme yolları planlamak

Manifold kurulduktan sonra, yazarlar akıl yürütmeyi soru ile cevap arasında toplam yapılan işi minimize eden “kolay” bir yol bulma olarak yeniden formüle ediyor. Bir dağa tırmanma benzetmesi ödünç alıyorlar: dik, engebeli bir rota aynı zirveye ulaşmak için daha fazla enerji gerektirirken, daha düzgün bir sırtı takip etmek daha az enerji ister. LLM bağlamında eğrilik diklik rolünü oynar ve modelin akıl yürütme işi bir yol boyunca içsel belirsizliğinin ne kadar azaldığına karşılık gelir. Yaklaşık geodezik ve eğrilik formülleriyle birlikte verimli bir grafik arama algoritması (Dijkstra’nın algoritması) kullanarak, RiemannInfer bu işi minimize eden rotaları hızlıca belirler ve modeli daha verimli düşünme zincirlerine yönlendirir.

Gerçek modellerde deneylerin gösterdikleri

Yazarlar RiemannInfer’i GPT-4o, Llama-3-405B ve DeepSeek-V2-400B dahil olmak üzere birkaç en ileri LLM üzerinde, GSM8K, MATH500, StrategyQA ve AGIEval gibi zorlayıcı matematik ve muhakeme ölçütlerinde test ediyorlar. Her durumda, bu modelleri RiemannInfer çerçevesiyle sarmak doğruluklarını birkaç yüzde puanı artırıyor —performans sınırında küçük ama anlamlı sayılar— ve hızı koruyor veya hafifçe iyileştiriyor. Saf doğrusal, daha basit bir yöntemle yapılan karşılaştırma, gizli durumların eğri geometrisini görmezden gelmenin performansı dramatik biçimde düşürdüğünü gösteriyor; bu da manifold bakışının önemini vurguluyor.

Büyük resim: AI akıl yürütmesine fiziksel bir his kazandırmak

Günlük okuyucu için ana çıkarım, yazarların büyük dil modellerinin opak iç işleyişini daha somut bir şeye dönüştürmüş olmalarıdır: iyi akıl yürütmenin düz, düşük çaba gerektiren patikaları takip etmekle eşdeğer olduğu eğri bir manzara boyunca bir yolculuk. Dikkat kalıplarını ve akıl yürütme adımlarını mesafe, eğrilik ve iş gibi geometrik ve fiziksel kavramlarla temellendirerek RiemannInfer hem sonuçları iyileştirmek için pratik bir yol sunuyor hem de AI ile sürekli uzayların fiziği arasında kavramsal bir köprü kuruyor. Mevcut yöntemler yaklaşık olsa da ve birçok detayın rafine edilmesi gerekse de, bu çerçeve düşünce süreçlerinin analiz edilebileceği, optimize edilebileceği ve belki de geometrinin ve fiziğin dili kullanılarak tasarlanabileceği gelecekteki AI sistemlerine işaret ediyor.

Atıf: Mao, R., Zhang, Z., Yang, M. et al. RiemannInfer: improving transformer inference through Riemannian geometry. Sci Rep 16, 6636 (2026). https://doi.org/10.1038/s41598-026-37328-x

Anahtar kelimeler: büyük dil modelleri, geometrik derin öğrenme, Riemann manifoldu, dikkat mekanizmaları, akıl yürütme verimliliği