Clear Sky Science · tr

Güvenli getirme ile zenginleştirilmiş üretim sistemleri için anlamsal önbellekte saldırgan dayanıklılığının artırılması

Neden daha akıllı yapay zeka belleği önemli

Sohbet botları ve yapay zeka asistanları iş yerlerine, sınıflara ve hatta hastanelere girdikçe, benzer soruları daha hızlı ve daha ucuza yanıtlamak için geçmiş soruları “hatırlama” numarasına giderek daha fazla güveniyorlar. Bu bellek, anlamsal önbellek olarak bilinir; maliyetleri ve gecikmeleri önemli ölçüde azaltabilir—ancak aynı zamanda saldırganların sistemleri kandırıp sır sızdırmasına veya yanlış cevaplar verilmesine kapı açabilir. Bu makale bu gizli riskleri inceliyor ve AI’nın belleğini hızlı tutarken kötüye kullanımı çok daha zor hale getirmeyi amaçlayan yeni bir tasarım olan SAFE-CACHE’i tanıtıyor.

Günümüz yapay zeka asistanlarının geçmiş yanıtları nasıl yeniden kullandığı

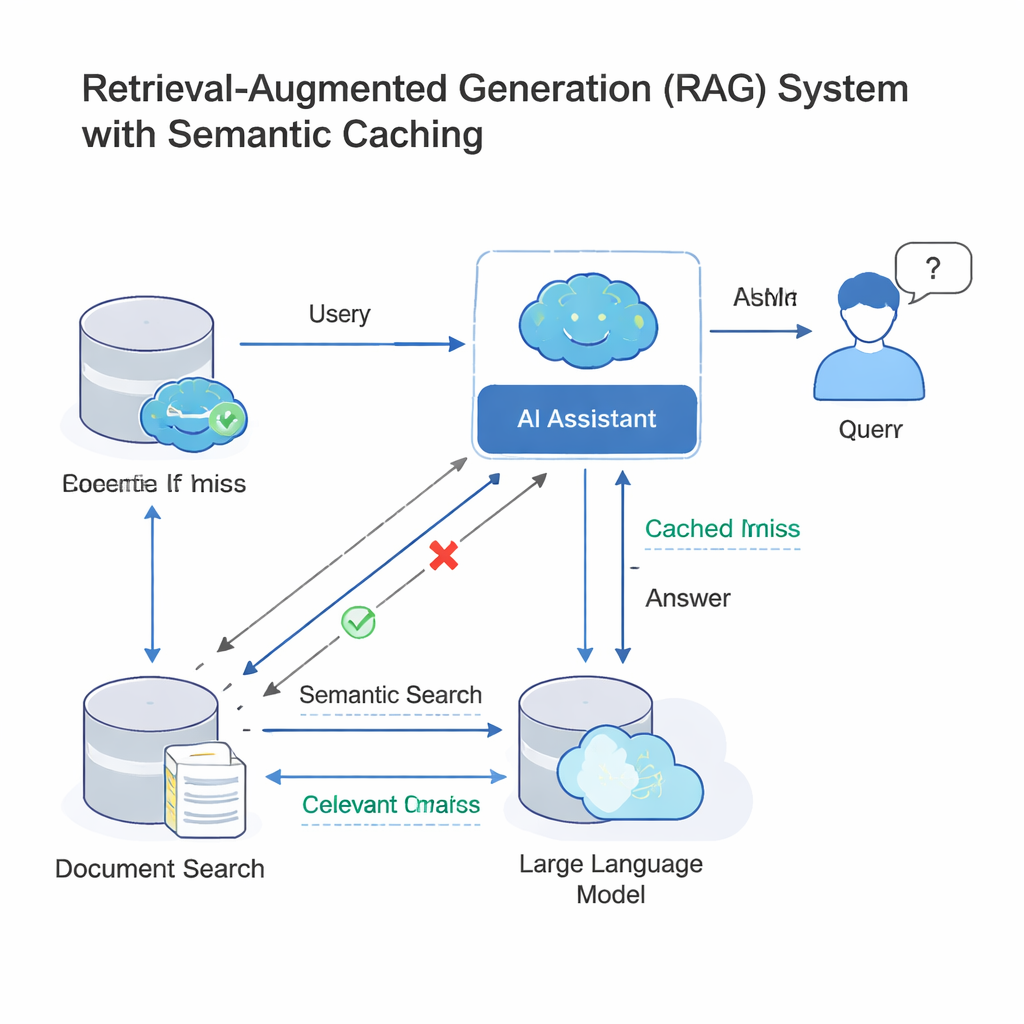

Modern büyük dil modelleri (LLM’ler) genellikle getirme ile zenginleştirilmiş üretim (RAG) adı verilen bir düzende çalışır. Bir soru sorduğunuzda sistem önce ilgili belgeleri arar, ardından LLM bu materyali kullanarak bir yanıt yazar. Birçok kişi neredeyse aynı soruyu farklı kelimelerle sorduğundan, şirketler şimdi bir anlamsal önbellek ekliyor: eski soru ve yanıtların yanı sıra bunların anlamlarının sayısal parmak izlerini saklayan bir yapı. Yeni bir sorgu geldiğinde sistem, onun parmak izinin önbellekteki bir parmak izine “yeterince yakın” olup olmadığını kontrol eder; öyleyse tüm arama ve üretim sürecini yeniden çalıştırmak yerine eski yanıtı yeniden kullanır. GPTCache ve Microsoft ile Google’ın bulut platformları gibi araçlar tarafından uygulanan bu fikir, müşteri destek botları, kurumsal sohbet araçları ve diğer yüksek trafikli AI hizmetlerinde maliyet tasarrufu sağlar ve yanıtları hızlandırır.

Zeki sözcük seçimi nasıl bir güvenlik açığına dönüşür

Hızı artıran aynı kestirme yol aynı zamanda sisteme karşı da kullanılabilir. Saldırganlar, yapısal olarak benzer görünen ama anlam olarak farklı olan sorgular oluşturabilir—bir tarihi değiştirmek, bir kişiyi ya da yeri takas etmek veya bir sorunun anlamını tersine çevirmek gibi. Günümüz önbellekleri çoğunlukla gömülü vektörlerin (anlam parmak izleri) sayısal benzerliğine güvendiği için kötü niyetli bir sorgu bu vektör uzayında güvenli bir sorguyla “çakışabilir”, oysa niyet değişmiştir. Bu çakışma önbelleğin yanlış yanıt döndürmesine yol açabilir; bu, gizli bilgilerin açığa çıkmasına veya kötü verilerin daha sonra yeniden kullanılmak üzere depolanmasına sebep olabilir. Önceki çalışmalar, vektör veritabanlarının ve anlamsal önbelleklerin özellikle çok kiracılı sistemlerde birçok kullanıcının aynı temel önbelleği paylaşması durumunda bu şekilde zehirlendiğini zaten göstermiştir.

Dağınık soruları istikrarlı niyet kümelerine dönüştürmek

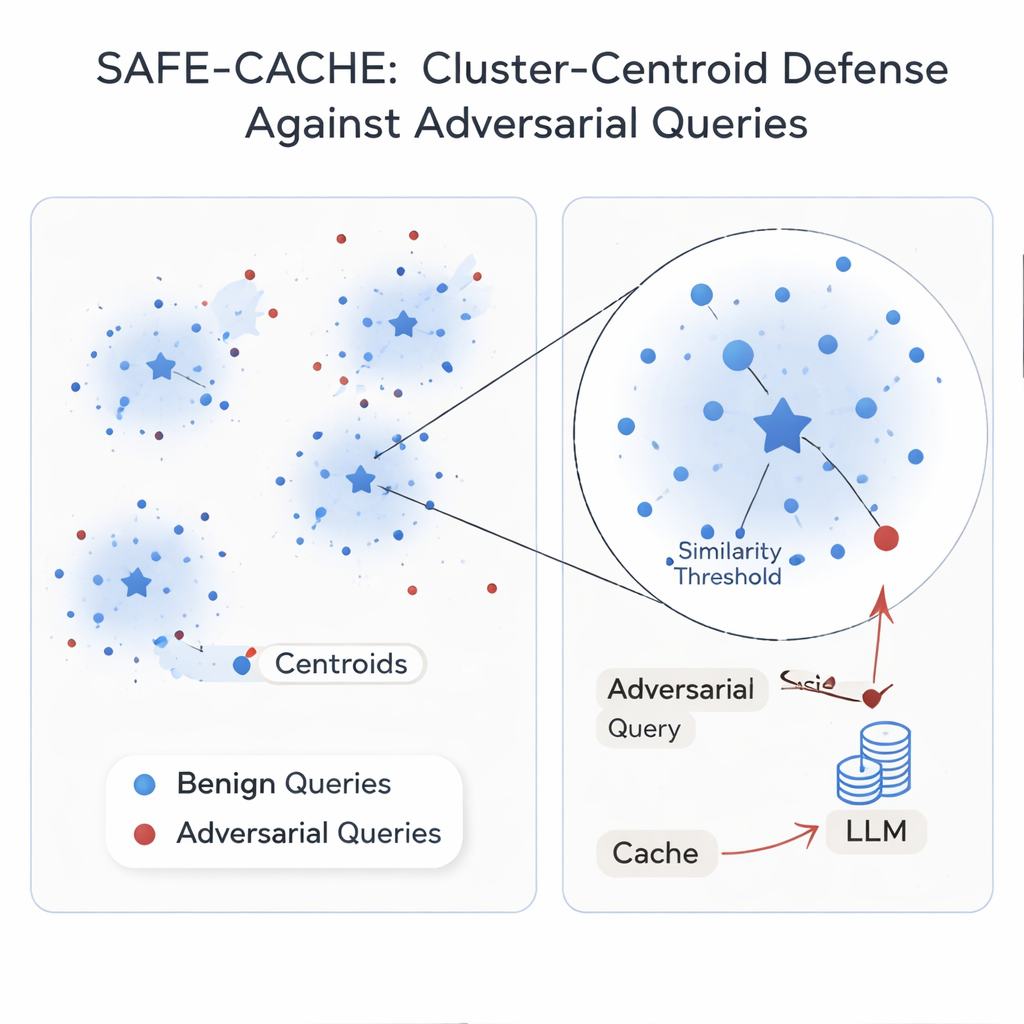

Yazarlar, kök sorunun her sorguyu izole ele almak olduğunu savunuyor. Çözüm olarak SAFE-CACHE, geçmiş soru–yanıt çiftlerini “kim kazandı” gibi alt niyetleri temsil eden kümelere ayırıyor—örneğin “2022 Arizona Senato yarışını kim kazandı?” veya “Tesla’nın Tam Otonom Sürüş yazılımının fiyatı nedir?” gibi. Yeni sorguları doğrudan tekil eski sorgularla eşleştirmek yerine SAFE-CACHE, bunları her kümenin merkezi veya centroidi ile karşılaştırır. Bu kümeleri oluşturmak için önce her tam soru artı yanıtı gömme (sadece soruyu değil) yöntemiyle kodluyor; böylece hassas verileri ifşa etmeyi reddetme gibi yanıt farklılıkları da gruplaşmayı etkiliyor. Ardından doğal kümeleri bulmak için bir topluluk algılama algoritması kullanıyor ve farklı niyetleri veya saldırgan girdileri karıştırabilecek gürültülü grupları işaretlemek için istatistiksel testler uyguluyor. Şüpheli kümeler, dürüst örnekleri yakınlaştırmayı ve zehirlenmiş olanları ayırmayı öğrenmiş özel olarak eğitilmiş bir iki-encoder (bi-encoder) ile temizlenip bölünüyor.

Yapay zekanın belleğini güçlendirmek için küçük bir modele öğretmek

Bazı niyetler gerçek trafikte sadece birkaç kez görünür, bu da kümelerini kırılgan hale getirir. Bunları istikrara kavuşturmak için SAFE-CACHE, aynı niyeti korurken ifadeyi değiştiren paraphrase’ler (yeniden ifade) üretmek üzere ince ayarlı hafif bir dil modeli (1 milyar parametreli Gemma-3 varyantı) kullanır. Bu ek örnekler kümeleri daha yoğun ve centroidlerini daha güvenilir kılar, binlerce varyantı insan etiketlemesine gerek bırakmaz. Çalışma zamanında her yeni sorgu gömülür ve bu centroidlerle karşılaştırılır. En iyi eşleşen centroid ile benzerliği dikkatle ayarlanmış eşik değerinin üzerindeyse önbellekteki yanıt döndürülür; aksi halde sistem tam RAG hattına geri döner ve daha sonra yeni çifti nasıl kümeleneceğine karar verir. Metamorfik yeniden yazma ve GPT‑4.1 tabanlı güçlü saldırı yöntemlerini kullanan deneylerde SAFE-CACHE, GPTCache tarzı bir tasarıma kıyasla başarılı zehirleme girişimlerini yaklaşık üçte iki ila dörtte üç oranında azalttı ve yanıt hızını esasen aynı tuttu.

Günlük yapay zeka kullanıcıları için anlamı

Uzman olmayanlar için çıkarılacak ders, yapay zeka sistemlerine “bellek” kazandırmanın bedava olmadığıdır: saf tasarımlar sırların sızmasına veya kötü cevapların yayılmasına yol açabilir. SAFE-CACHE gösteriyor ki belleği daha derin, niyet düzeyindeki örüntüler çevresinde düzenleyip bu örüntüleri hedeflenmiş paraphraselerle güçlendirerek, anlamsal önbelleklemenin hız ve maliyet avantajlarını korurken saldırı riskini keskin şekilde azaltmak mümkün. Yapay zeka asistanları şirket kayıtlarından kişisel bilgilere kadar hassas verilere açılan bir ön kapı haline geldikçe, SAFE-CACHE gibi yaklaşımlar AI’nın hatırladıklarının kolayca aleyhimize çevrilmesini zorlaştırmak için kilit önemde olacak.

Atıf: Afiffy, M., Fakhr, M.W. & Maghraby, F.A. Enhancing adversarial resilience in semantic caching for secure retrieval augmented generation systems. Sci Rep 16, 5936 (2026). https://doi.org/10.1038/s41598-026-36721-w

Anahtar kelimeler: anlamsal önbellek, getirme ile zenginleştirilmiş üretim, saldırgan saldırıları, küme tabanlı savunma, LLM güvenliği