Clear Sky Science · tr

ALBERT kaynaklı bağlam ve EHO ile optimize edilen mimariyi birleştiren derin duygu modeli

Daha Akıllı Duygu Okumanın Önemi

Her gün milyonlarca insan ürünler, hizmetler, siyaset ve olaylar hakkında internet üzerinde görüşlerini paylaşıyor. Bu metin akışını güvenilir içgörülere dönüştürmek şirketler, hükümetler ve araştırmacılar için hayati önem taşıyor. Ancak çevrimiçi dilimiz düzensiz: alaycı şakalar, argo, yazım hataları ve nadir duygular bilgisayarları kolayca yanıltabilir. Bu makale, bu duyguları daha doğru okumayı hedefleyen ve birçok güncel yapay zeka modeline göre daha az hesaplama gücü kullanan yeni bir duygu analizi sistemi sunuyor.

Basit Kelime Sayımından Bağlamı Anlayan Okumaya

Erken duygu analizi araçları metni bağlantısız kelimeler torbası olarak ele alıyor, “iyi” veya “berbat” gibi terimlerin kaç kez göründüğünü sayıyordu. Bu yaklaşım, “kötü değil” ifadesinin aslında “oldukça iyi” anlamına geldiği gibi kelime sırasını ve ince bağlamı görmezden geliyordu. Derin öğrenme yöntemleri metni diziler olarak işleyerek bu konuda ilerleme sağladı, ancak genellikle büyük etiketli veri setleri ve yoğun hesaplama gerektiriyordu. BERT gibi dönüştürücü modeller doğruluğu daha da artırdı, ancak büyük boyutları müşter hizmetleri platformları veya sosyal medya izleme sistemleri gibi gerçek dünya ortamlarında çalıştırmayı maliyetli kılıyor. Bu makalenin yazarları bu zorluğa, birkaç daha hafif ama güçlü bileşeni tek bir sadeleştirilmiş sistemde birleştirerek yanıt veriyorlar.

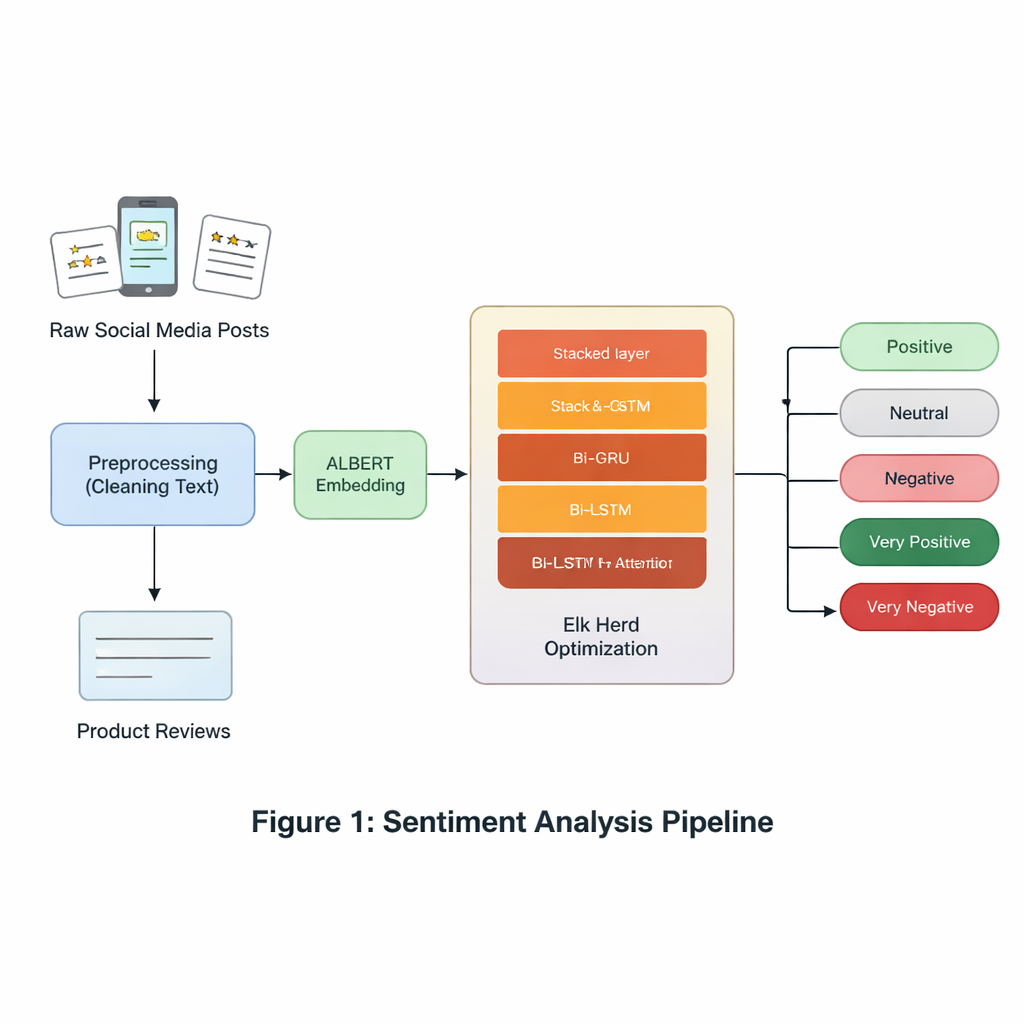

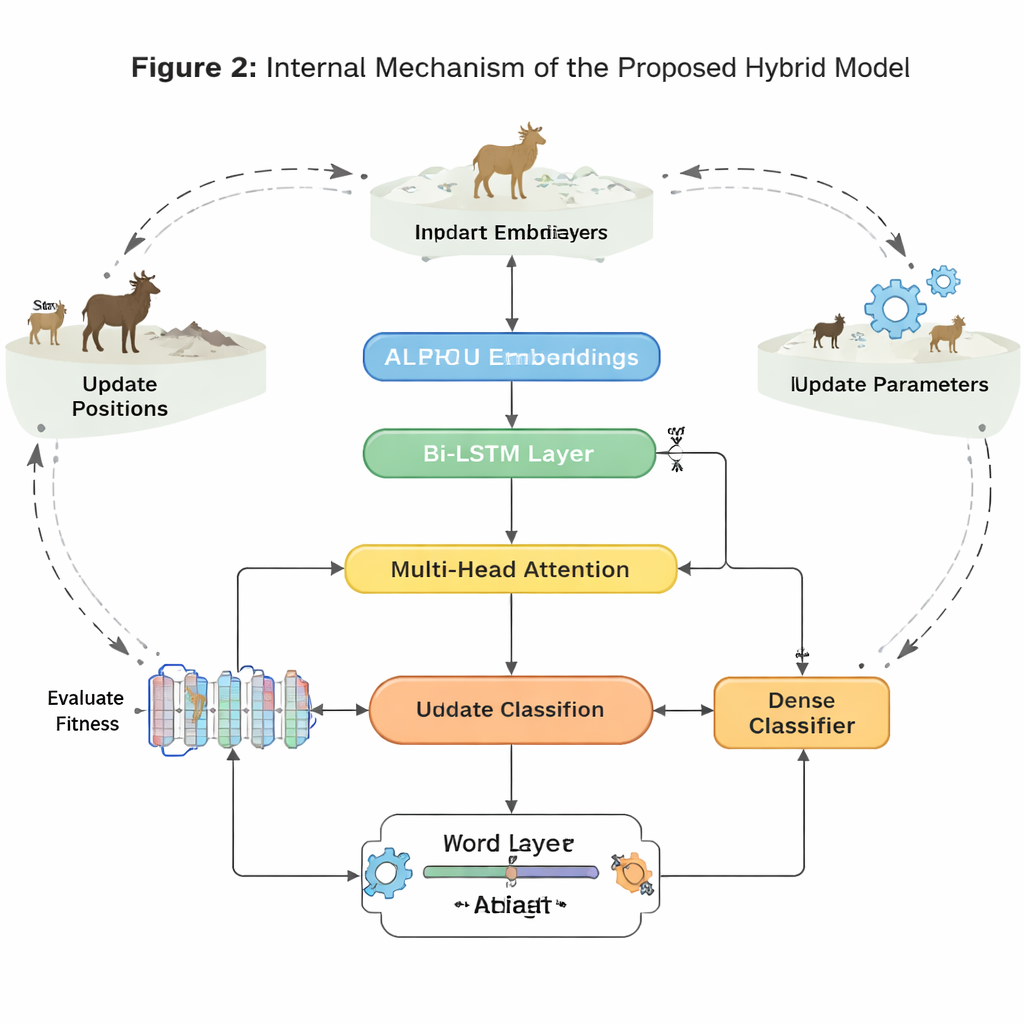

Metni Anlamak İçin Daha İnce Bir Zihin

Modelin çekirdeğinde BERT’in kompakt bir akrabası olan ALBERT bulunuyor. ALBERT, bir cümledeki her kelimeyi komşu kelimelere göre anlamların nasıl değiştiğini yakalayan bağlam farkında sayısal temsillere dönüştürüyor. Daha büyük modellerin aksine ALBERT, katmanlar arasında parametre paylaşımı yapıp kelime sözlüğünü sıkıştırarak bellek kullanımını azaltıyor. Bu, standart donanımda çalıştırmayı anlamadan fazla fedakârlık yapmadan kolaylaştırıyor. Bu ALBERT tabanlı kelime temsilcileri, duyguların bir cümle boyunca nasıl ortaya çıktığına odaklanan uzmanlaşmış katman dizisinin girdiği haline geliyor.

İki Bellek Sisteminin Birlikte Çalışmasına İzin Vermek

Anlamın kelimeden kelimeye nasıl değiştiğini izlemek için sistem iki tür tekrarlayan ağ kullanıyor: hem ileri hem geri yönde çalıştırılan GRU’lar (Gated Recurrent Units) ve LSTM’ler (Long Short-Term Memory birimleri). GRU’lar daha az parametreyle kısa ifadeleri izlemek konusunda verimli iken, LSTM’ler metnin daha uzun bölümlerindeki bilgiyi hatırlamakta daha başarılıdır. Bidirectional LSTM katmanının üzerine yığılmış bir bidirectional GRU katmanı ve bir dikkat mekanizmasının eklenmesiyle model, her cümlenin duygu açısından en yoğun parçalarını—örneğin ağırlıklı olarak olumlu bir incelemede geçen “pil ömrü hariç” ifadesi gibi—ön plana çıkarabiliyor. Bu hibrit tasarım, yüzeydeki hızlı ton değişimlerini ve genel duyguyu tersine çevirebilecek daha uzun menzilli bağlamı yakalamayı amaçlıyor.

Zorlu Durumlar İçin Doğadan İlham Alan Ayar

Mimariye ek olarak yazarlar önemli bir gerçek dünya engeliyle de uğraşıyor: duygu veri setleri genellikle dengesiz ve gürültülüdür. Tiksinme veya şaşırma gibi duygular ve nötr ifadeler, belirgin şekilde olumlu veya olumsuz olanlara göre daha az görülür ve birçok model bu durumları göz ardı edebilir. Bunu dengelemek için makale, geyiklerin hareket etme, rekabet etme ve grup oluşturma davranışlarına modellenmiş doğadan esinlenen bir arama stratejisi olan Elk Herd Optimization (EHO) kullanıyor. Sinir ağı iç duygu vektörlerini ürettikten sonra bu optimizasyon adımı, özellikle nadir sınıflar için bu vektörlerin her sınıfı nasıl temsil ettiğini yinelemeli olarak bir “uygunluk” skorunu iyileştirerek ince ayar yapıyor. Bu süreç modelin yüzeysel çözümlerden kaçınmasına yardımcı oluyor ve ince veya az temsil edilen duyguları ayırt etme yeteneğini geliştiriyor.

Modeli Teste Sokmak

Yazarlar sistemlerini Twitter gönderileri, restoran ve dizüstü bilgisayar incelemeleri ile çok olumlu ve çok olumsuz görüşleri daha ılımlılardan ayıran beş düzeyli bir film inceleme kıstası dahil olmak üzere yaygın kullanılan altı veri kümesinde değerlendiriyor. Bu farklı kaynaklar boyunca yeni yaklaşım, doğruluk ve doğru yakalamalarla kaçırılan durumları dengeleyen F1 puanı açısından birkaç gelişmiş grafik-tabanlı ve dönüştürücü-tabanlı rakibini tutarlı şekilde geride bırakıyor. Kazanımlar özellikle beş sınıflı film inceleme görevinde ve az temsil edilen duygu sınıflarında güçlü; bu da yöntemin hem ince ayrıntılı duyguları hem de dengesiz veriyi ele alabileceğini gösteriyor. Bileşenlerin birer birer çıkarıldığı bir yoklama çalışması (ablation study), ALBERT’in, birleşik GRU–LSTM tasarımının, dikkat mekanizmasının ve geyik ilhamlı optimizasyonun her birinin genel performansa katkıda bulunduğunu doğruluyor.

Günlük Uygulamalar İçin Anlamı

Uzman olmayanlar için temel çıkarım, bu araştırmanın çevrimiçi görüşlerin büyük hacimlerini yorumlamak için daha verimli ve güvenilir bir yol sunduğudur. Kompakt bir dil modelini tamamlayıcı bellek katmanları ve biyolojik ilhamlı bir ayar adımıyla harmanlayarak sistem, özellikle duygular ince veya veriler eğilmiş olduğunda satır aralarını daha doğru okuyor. Bu, müşteri memnuniyetini izleme, halk sağlığı tutumlarını takip etme veya politika ve olaylara verilen tepkileri ölçme gibi hem doğruluk hem de hesaplama maliyetinin önemli olduğu gerçek dünya kullanım alanları için umut veriyor.

Atıf: Oqaibi, H., Sharma, S. A deep sentiment model combining ALBERT-driven context and EHO-optimized architecture. Sci Rep 16, 5784 (2026). https://doi.org/10.1038/s41598-026-36389-2

Anahtar kelimeler: duygu analizi, ALBERT, derin öğrenme, metin sınıflandırma, meta-sezgisel optimizasyon