Clear Sky Science · tr

Az örnekle öğrenme için meta-öğrenme: az örnekle açık görev tanıma

Yapay zekiyi çok az örnekle eğitmenin önemi

Günümüz yapay zeka sistemleri yüzleri, hayvanları ve günlük nesneleri dikkat çekici doğrulukla tanıyabiliyor—ancak genellikle milyonlarca etiketli görüntü gördükten sonra. Nadir bir hastalığın teşhisi ya da fabrika hattında yeni bir tip kusurun tespiti gibi birçok gerçek durumda elimizde bu kadar veri olmaz. Bu makale, bir modelin eğitildiği dağılımdan oldukça farklı görünen yeni görsel görevleri yalnızca birkaç örnekten öğrenebilecek şekilde nasıl eğitilebileceğini araştırıyor. Esnek ve düşük veri gereksinimli öğrenmeyi daha güvenilir ve öngörülebilir kılmayı amaçlayan Open-MAML adlı bir yöntemi tanıtıyor.

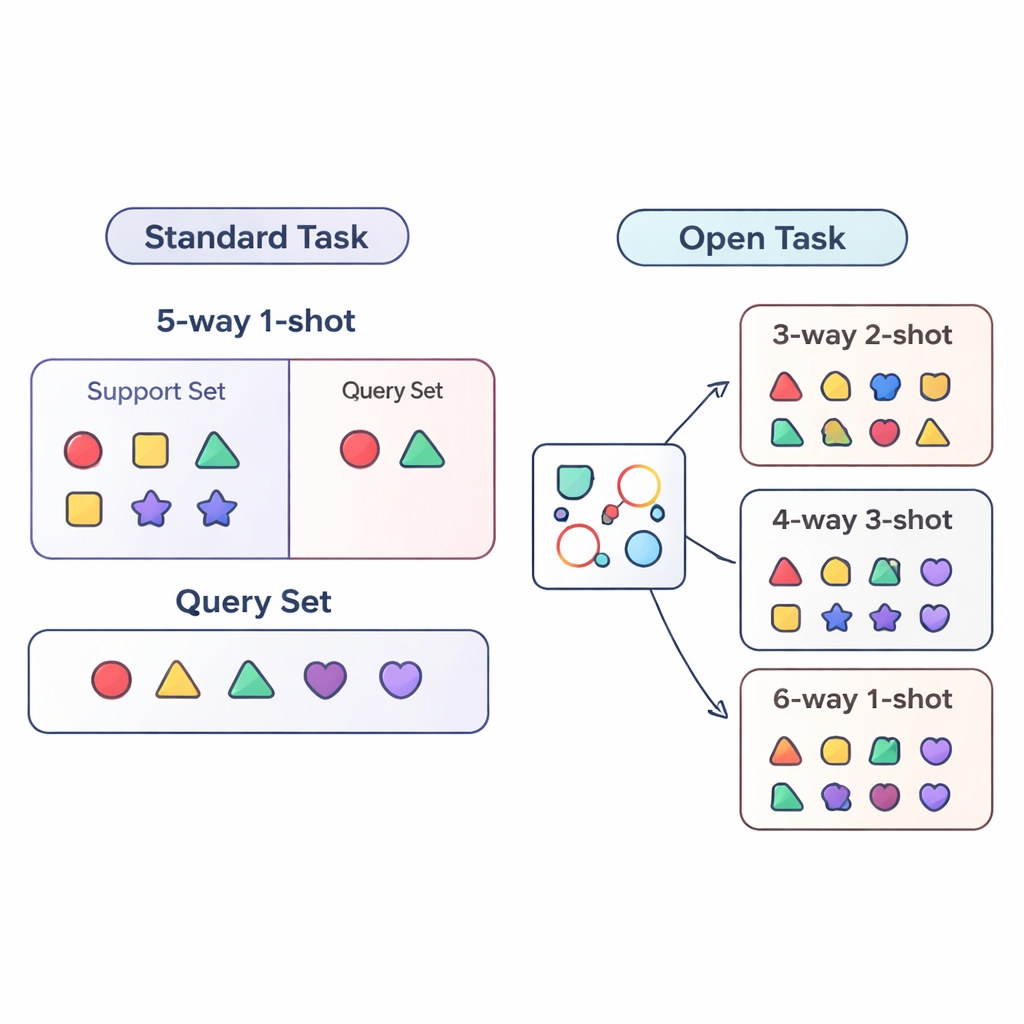

Sabit sınıf alıştırmalarından açık uçlu pop quizlere

“Az örnekle öğrenme” üzerine yapılan çoğu araştırma, yapay zeka sistemlerini sıkı kontrollü koşullar altında değerlendirir. Model genellikle çok benzer görevlerde eğitilip test edilir; örneğin her zaman beş kategori arasında ayrım yapması ("5-yollu") ve kategori başına bir örnek bulunması ("1-örnek") gibi. Bu, bir öğrenciyi yalnızca her soru türü için bir pratik örnek içeren beş soruluk sınavlarla alıştırmak gibidir. Gerçek dünyadaki dağıtımlar çok daha düzensizdir: kategori sayısı değişebilir ve her kategori için etiketli veri miktarı zamanla artıp azalabilir. Yazarlar bu daha gerçekçi duruma açık görev durumu adını veriyor; burada modeller, eğitimde gördüklerinden farklı sayıda sınıf ve örnek içeren görevleri ele almak zorundadır.

Az örnekle öğrenenleri yeniden nasıl test ederiz

Bu açık görev dünyasını sistematik şekilde incelemek için makale üç değerlendirme rejimi öneriyor. Çapraz-yol (cross-way) rejiminde yalnızca sınıf sayısı değişir: model beş sınıfta eğitilmiş olabilir ama üç veya on beş sınıfla test edilebilir. Çapraz-örnek (cross-shot) rejiminde ise sınıf başına düşen örnek sayısı tek bir etiketli görüntüden birkaç görüntüye kadar değişir. En zor durum, hem sınıf sayısının hem de sınıf başına veri miktarının birlikte değiştiği çapraz-yol–çapraz-örnek (cross-way–cross-shot) durumudur. Yazarlar ayrıca verinin görsel tarzı değiştiğinde neler olduğunu inceliyor; örneğin genel bir nesne veri kümesinde eğitip, ayrıntılı bir kuş veri kümesinde test etmek. Bu düzenlemeler, bir yöntemin tek, sabit bir eğitim reçetesinin ötesine gerçekten genelleme yapıp yapamayacağını ortaya koymak için tasarlanmıştır.

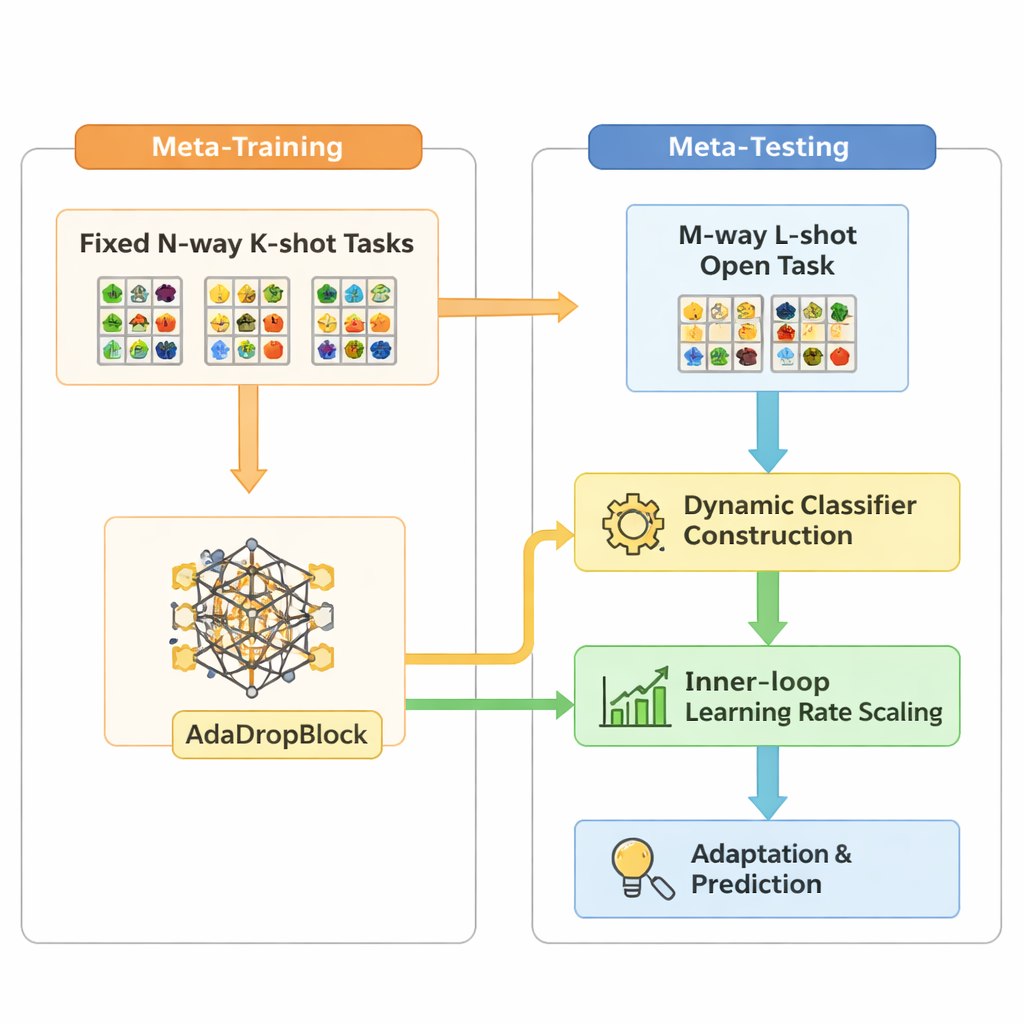

Open-MAML nasıl anında uyum sağlıyor

Open-MAML, Model-Agnostic Meta-Learning (MAML) olarak bilinen popüler bir meta-öğrenme stratejisi üzerine kuruludur; MAML, modeli birkaç gradyan adımıyla yeni bir göreve hızla uyum sağlayacak şekilde eğitir. Ancak standart MAML, test zamanındaki sınıf sayısının eğitimle aynı olduğunu varsayar ve sabit bir son sınıflandırma katmanı kullanır. Open-MAML bu sınırlamayı aşmak için üç önemli değişiklik getirir. Birincisi, dinamik sınıflayıcı oluşturma kullanır: yeni bir görev önceki görevlerden daha fazla sınıfa sahipse, eksik çıkış birimlerini mevcut birimlerin ortalamasını kopyalayarak oluşturur; bu, modele nötr ama mantıklı bir başlangıç noktası sağlar. İkincisi, iç öğrenme hızını görevin sahip olduğu sınıf ve örnek sayısına göre ayarlar, böylece veri az veya çok olsun uyum kararlı kalır. Üçüncüsü, eğitim sırasında özellik haritalarında bitişik bölgeleri geçici olarak gizleyen ve modelin küçük, kırılgan detaylara fazla uymak yerine daha çeşitli görsel ipuçlarını kullanmasını teşvik eden AdaDropBlock adlı bir düzenleyici ekler.

Esnek öğrenmeyi teste sokmak

Araştırmacılar Open-MAML’i standart az örnekli kıyaslama setlerinde ve yeni açık görev senaryoları altında değerlendiriyor, onu birkaç tanınmış temel yöntemle karşılaştırıyorlar. Bunlar arasında her görev için sıfırdan eğitilmiş modeller, güçlü önceden eğitilmiş bir özellik çıkarıcı ile ince ayarlanmış bir sınıflayıcı kullananlar ve görüntüleri sınıf “prototiplerine” olan uzaklığa göre sınıflandıran metrik tabanlı yöntemler bulunuyor. Tüm yöntemler aynı omurga ağı paylaştığı için farklar mimariden değil öğrenme stratejisinden kaynaklanıyor. On binlerce test görevi boyunca Open-MAML tutarlı şekilde daha yüksek doğruluk elde ediyor—yalnızca sınıf sayısı veya örnek sayısı değiştiğinde genellikle 1–7 puan daha iyi, her ikisi birlikte değiştiğinde ise 3–6 puan daha iyi. Kazançlar, daha fazla sınıfın, daha çok örneğin veya kuş veri kümesine geçişin olduğu daha zor ayarlarda daha belirgin; bu da uyum mekanizmalarının karmaşık, yabancı alanlarda gerçekten yardımcı olduğunu gösteriyor.

Gerçek dünya yapay zeka sistemleri için anlamı

Genel okuyucu için çıkarılacak ana mesaj, laboratuvarın konfor alanını bıraktığımızda tüm az örnekle öğrenenlerin eşit olmadığıdır. Tek bir sabit kıyaslamada başarılı olan bir yöntem, kategori sayısı veya etiketli veri miktarı değiştiğinde tökezleyebilir. Open-MAML, sınıflayıcının büyüyüp küçülmesine izin vererek, öğrenme hızını görev boyutuyla ölçeklendirerek ve özellikleri görevten bağımsız şekilde düzenleyerek bu tür yapısal değişiklikler için açıkça plan yapmanın, yapay zekâ sistemlerinin pratikte karşılaşacakları değişen koşullarla daha iyi başa çıkmasını sağladığını gösteriyor. Kategori setinin ve etiket erişilebilirliğinin sürekli değiştiği tıbbi görüntüleme, uydu izleme veya endüstriyel muayene gibi uygulamalarda, bu tür açık görev sağlamlığı az örnekle öğrenmeyi dikkatle seçilmiş araştırma kıyaslarının ötesinde çok daha kullanılabilir kılabilir.

Atıf: Han, X., Shi, D., Wang, Z. et al. Meta-learning for few-shot open task recognition. Sci Rep 16, 5624 (2026). https://doi.org/10.1038/s41598-026-36291-x

Anahtar kelimeler: az örnekle öğrenme, meta-öğrenme, açık görev tanıma, görüntü sınıflandırma, genelleme